【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

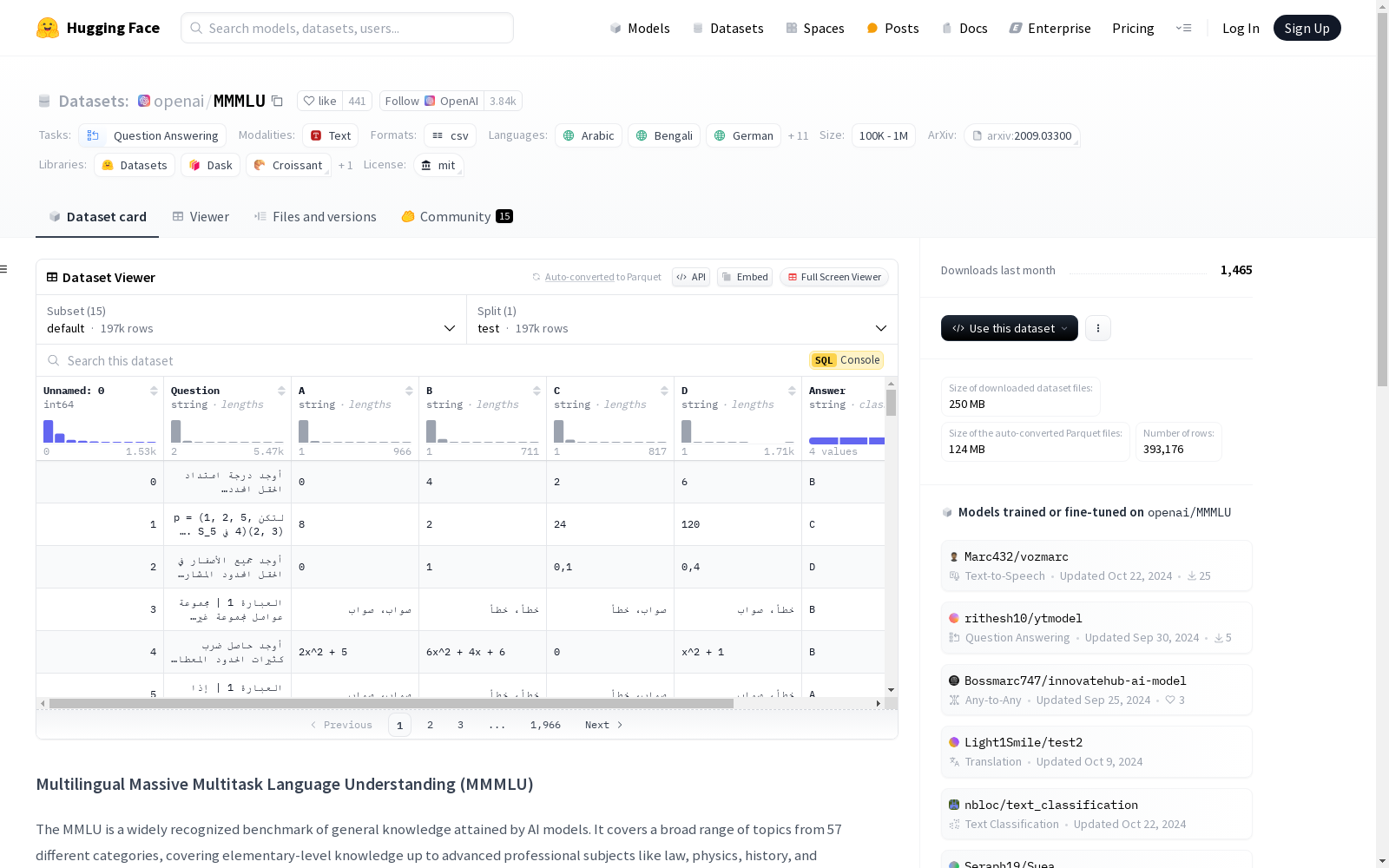

MMMLU

收藏Hugging Face2024-09-24 更新2024-12-12 收录

下载链接:

https://huggingface.co/datasets/openai/MMMLU

下载链接

链接失效反馈官方服务:

资源简介:

多语言大规模多任务语言理解(MMMLU)数据集是一个广泛认可的AI模型通用知识基准,涵盖了从基础知识到高级专业学科的57个不同类别。该数据集包括了MMLU测试集的14种语言的专业翻译版本,这些翻译由专业的人类翻译完成,以确保翻译的准确性,特别是对于低资源语言如Yoruba。数据集的发布反映了提高AI模型多语言能力的承诺,确保其在不同语言中的准确表现,特别是对于未被充分代表的社区。

The Multilingual Massive Multitask Language Understanding (MMMLU) dataset is a widely recognized general knowledge benchmark for AI models, covering 57 distinct categories ranging from foundational knowledge to advanced specialized disciplines. This dataset includes professionally translated versions of the MMLU test set across 14 languages, with translations conducted by professional human translators to guarantee translation accuracy, especially for low-resource languages such as Yoruba. The release of this dataset reflects the commitment to improving the multilingual capabilities of AI models and ensuring their accurate performance across different languages, particularly for underrepresented communities.

提供机构:

OpenAI

创建时间:

2024-09-14

搜集汇总

数据集介绍

构建方式

MMMLU数据集的构建基于广泛认可的MMLU基准测试,该测试涵盖了从基础到高级的57个不同学科领域的知识。为了提升数据集的多语言能力,研究团队通过专业人工翻译将MMLU测试集翻译为14种语言,包括阿拉伯语、孟加拉语、德语、西班牙语、法语、印地语、印尼语、意大利语、日语、韩语、巴西葡萄牙语、斯瓦希里语、约鲁巴语和简体中文。这一过程确保了翻译的准确性,尤其是针对低资源语言如约鲁巴语的高质量翻译。

特点

MMMLU数据集的特点在于其广泛的多语言覆盖和高质量的人工翻译。数据集不仅涵盖了57个学科领域的知识,还通过专业翻译确保了14种语言的准确性,特别是对低资源语言的关注。这种多语言特性使得该数据集能够有效评估AI模型在不同语言环境下的表现,尤其适用于多语言理解和跨文化应用的研究。此外,数据集的构建反映了对AI技术包容性的承诺,旨在为全球用户提供更公平的AI评估工具。

使用方法

MMMLU数据集的使用方法主要围绕多语言问答任务的评估展开。用户可以通过加载不同语言配置的测试文件,评估AI模型在特定语言环境下的表现。数据集提供了14种语言的测试集,用户可以根据需求选择相应的语言配置进行测试。通过使用该数据集,研究人员能够深入分析模型在多语言环境中的表现差异,特别是在低资源语言上的表现,从而推动多语言AI模型的优化与改进。

背景与挑战

背景概述

MMMLU(Multilingual Massive Multitask Language Understanding)数据集是一个广泛认可的基准测试,旨在评估AI模型在多语言环境下的综合知识理解能力。该数据集由Hendrycks等人于2021年提出,涵盖了57个不同领域的知识,从基础学科到高级专业领域如法律、物理、历史和计算机科学。MMMLU的独特之处在于其测试集被专业翻译人员翻译成14种语言,包括阿拉伯语、孟加拉语、德语、西班牙语、法语、印地语、印尼语、意大利语、日语、韩语、葡萄牙语、斯瓦希里语、约鲁巴语和简体中文。这一努力不仅提升了AI模型在多语言环境下的表现,还为低资源语言社区提供了更公平的技术支持,推动了AI技术的全球包容性发展。

当前挑战

MMMLU数据集在构建和应用过程中面临多重挑战。首先,多语言翻译的准确性是关键,尤其是对于低资源语言如约鲁巴语,确保翻译质量直接影响模型评估的可靠性。其次,数据集的广泛覆盖领域要求模型具备跨领域的知识整合能力,这对模型的泛化能力提出了极高要求。此外,如何在多语言环境中保持一致的评估标准,避免因语言差异导致的偏差,也是一个亟待解决的问题。这些挑战不仅考验了数据集的构建技术,也对未来AI模型的多语言理解和应用能力提出了更高的期望。

常用场景

经典使用场景

MMMLU数据集作为多语言大规模多任务语言理解基准,广泛应用于评估AI模型在跨语言环境下的知识理解能力。其涵盖57个不同领域的知识,从基础学科到高级专业领域,如法律、物理、历史和计算机科学,为研究者提供了一个全面的测试平台。

解决学术问题

MMMLU数据集通过提供高质量的多语言翻译测试集,解决了AI模型在低资源语言环境下表现不佳的问题。其专业人工翻译确保了数据的准确性,特别是在如约鲁巴语等资源匮乏的语言中,显著提升了模型的多语言理解能力,推动了多语言AI技术的发展。

衍生相关工作

MMMLU数据集催生了一系列经典研究工作,如多语言模型的微调与评估框架的开发。基于该数据集的研究成果已被广泛应用于自然语言处理领域,推动了多语言模型的性能提升,并为低资源语言的AI应用提供了重要参考。

以上内容由遇见数据集搜集并总结生成