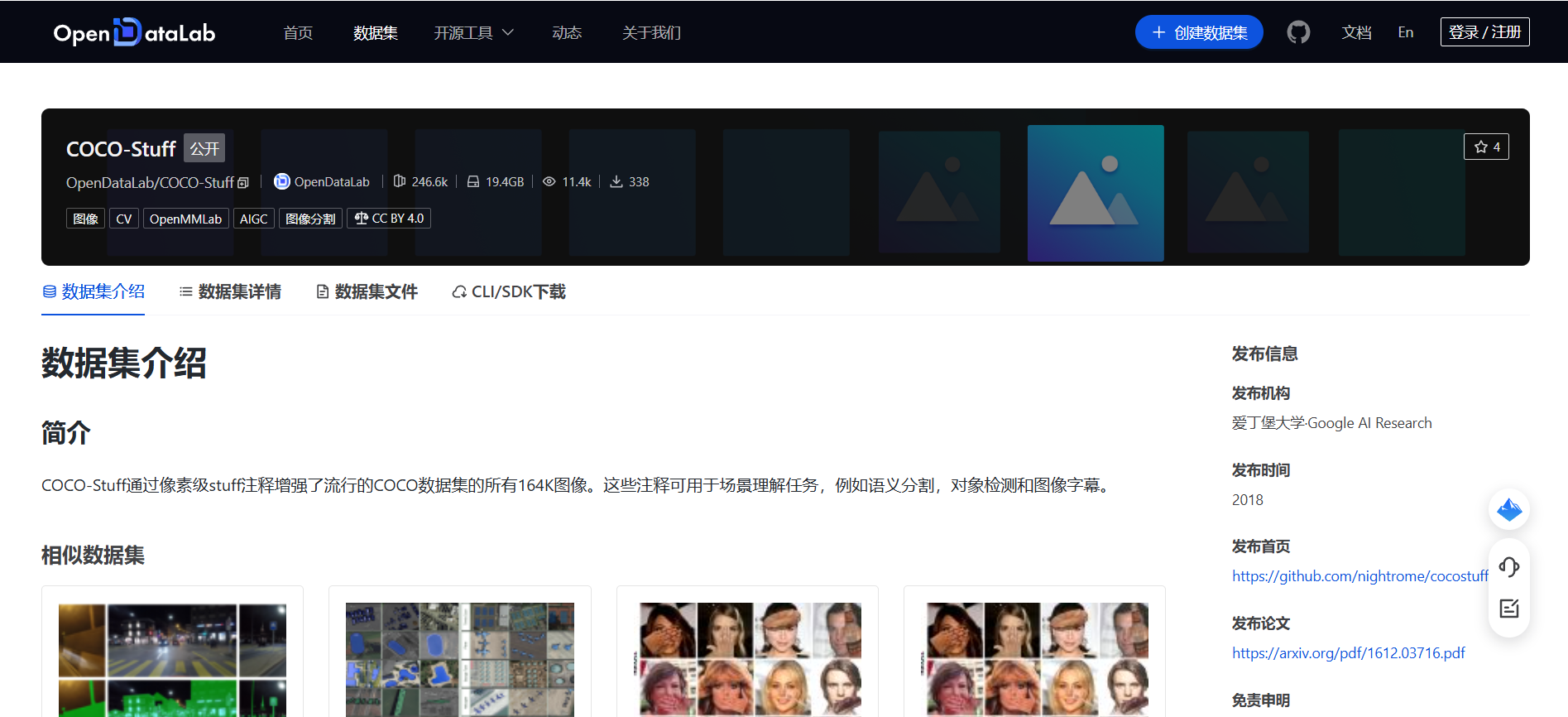

COCO-Stuff

收藏OpenDataLab2026-05-31 更新2024-05-09 收录

下载链接:

https://opendatalab.org.cn/OpenDataLab/COCO-Stuff

下载链接

链接失效反馈官方服务:

资源简介:

COCO-Stuff通过像素级stuff注释增强了流行的COCO数据集的所有164K图像。这些注释可用于场景理解任务,例如语义分割,对象检测和图像字幕。

COCO-Stuff enhances all 164K images of the popular COCO dataset with pixel-level stuff annotations. These annotations can be used for scene understanding tasks such as semantic segmentation, object detection, and image captioning.

提供机构:

OpenDataLab

创建时间:

2023-01-30

搜集汇总

数据集介绍

构建方式

COCO-Stuff数据集的构建基于广泛应用的COCO数据集,通过引入额外的语义类别,将原有的80个对象类别扩展至171个语义类别。这一过程涉及对原始图像进行精细的像素级标注,确保每个像素都被准确分类。此外,数据集还包含了场景级别的标注,以捕捉图像中复杂的场景结构。通过这种多层次的标注方式,COCO-Stuff不仅丰富了对象识别的维度,还为场景理解提供了更为详尽的信息。

特点

COCO-Stuff数据集的显著特点在于其高度细化的语义标注和丰富的场景信息。相较于传统的对象识别数据集,COCO-Stuff提供了更为细致的像素级分类,涵盖了从常见物体到细微背景元素的广泛类别。这种细致的标注使得数据集在处理复杂场景时表现尤为出色,适用于需要高精度语义分割和场景理解的深度学习任务。此外,数据集的规模和多样性也为模型训练提供了充足的样本,有助于提升模型的泛化能力。

使用方法

COCO-Stuff数据集主要用于支持语义分割、场景理解和图像标注等高级计算机视觉任务。研究人员和开发者可以利用该数据集训练深度学习模型,以实现对图像中每个像素的精确分类。具体使用时,用户可以通过加载数据集中的图像和标注文件,进行模型的训练和验证。数据集的场景级别标注也为场景解析和理解提供了有力支持,使得模型能够更好地捕捉图像中的上下文信息。此外,COCO-Stuff的开放性和标准化格式也便于与其他计算机视觉工具和框架集成,促进研究成果的快速应用和推广。

背景与挑战

背景概述

COCO-Stuff数据集是计算机视觉领域的一个重要资源,由加州大学伯克利分校的研究团队于2016年创建。该数据集扩展了原有的COCO数据集,增加了172类语义对象,涵盖了从天空到地面、从动物到植物的广泛类别。COCO-Stuff的核心研究问题在于提升图像分割和场景理解的精度,特别是在复杂背景和多对象场景中的表现。这一数据集的引入极大地推动了语义分割和场景解析技术的发展,为研究人员提供了丰富的数据资源,从而促进了相关算法的创新与优化。

当前挑战

尽管COCO-Stuff数据集在语义分割和场景理解方面提供了宝贵的资源,但其构建和应用过程中仍面临诸多挑战。首先,数据集的标注复杂性极高,需要对图像中的每个像素进行细致分类,这不仅耗时且成本高昂。其次,数据集中包含的类别多样性增加了模型训练的难度,特别是在处理类别不平衡和边界模糊的问题时。此外,如何有效利用COCO-Stuff数据集进行跨领域研究,如结合自然语言处理进行图像描述生成,也是一个亟待解决的挑战。

发展历史

创建时间与更新

COCO-Stuff数据集于2016年首次发布,作为COCO数据集的扩展,旨在提供更丰富的语义分割标注。该数据集在2018年进行了重大更新,增加了更多的类别和实例,以满足日益增长的计算机视觉研究需求。

重要里程碑

COCO-Stuff数据集的一个重要里程碑是其在2018年的更新,此次更新不仅增加了172个新的语义类别,还改进了原有的标注质量,使其成为语义分割和场景理解领域的重要基准。此外,COCO-Stuff还引入了Stuff和Things的区分,为研究者提供了更细致的场景分析工具。这一更新极大地推动了相关领域的研究进展,特别是在多类别语义分割和场景解析方面。

当前发展情况

当前,COCO-Stuff数据集已成为计算机视觉领域中语义分割和场景理解研究的核心资源。其丰富的标注和多样的场景类别为算法开发和评估提供了坚实的基础。COCO-Stuff不仅在学术研究中广泛应用,还被工业界用于开发和测试先进的图像处理技术。随着深度学习技术的不断进步,COCO-Stuff数据集的持续更新和扩展将继续推动该领域的创新和发展,为实现更精确和全面的场景理解提供支持。

发展历程

- COCO-Stuff数据集首次发表,由Holger Caesar、Jasper Uijlings和Vittorio Ferrari等人提出,旨在扩展COCO数据集的语义分割任务,包含164,000张图像和172个语义类别。

- COCO-Stuff数据集首次应用于计算机视觉领域的研究,特别是在语义分割和场景理解任务中,展示了其在多类别语义分割中的有效性。

- COCO-Stuff数据集被广泛用于多个国际计算机视觉会议(如CVPR、ECCV)的研究论文中,成为评估语义分割算法性能的标准数据集之一。

- COCO-Stuff数据集的更新版本发布,增加了更多的图像和类别,进一步提升了其在复杂场景理解任务中的应用价值。

常用场景

经典使用场景

在计算机视觉领域,COCO-Stuff数据集以其丰富的多类别标注和高质量的图像数据,成为语义分割和场景理解任务的经典基准。该数据集不仅涵盖了常见的物体类别,还包含了大量的背景元素,使得模型能够更全面地理解复杂场景。研究者们利用COCO-Stuff进行深度学习模型的训练和评估,以提升其在实际应用中的表现。

实际应用

在实际应用中,COCO-Stuff数据集被广泛用于自动驾驶、智能监控和增强现实等领域。例如,在自动驾驶系统中,利用COCO-Stuff训练的模型能够更准确地识别道路、行人、车辆等元素,从而提高驾驶安全性。在智能监控系统中,该数据集帮助实现了对复杂场景的精准分析,提升了监控效果。

衍生相关工作

基于COCO-Stuff数据集,研究者们开发了多种先进的语义分割和场景理解算法。例如,一些研究工作利用该数据集进行多任务学习,结合物体检测和语义分割任务,提升了模型的整体性能。此外,COCO-Stuff还激发了关于数据增强和模型鲁棒性研究的兴趣,推动了计算机视觉领域的技术革新。

以上内容由遇见数据集搜集并总结生成