HaluEval

收藏arXiv2023-10-23 更新2024-06-21 收录

下载链接:

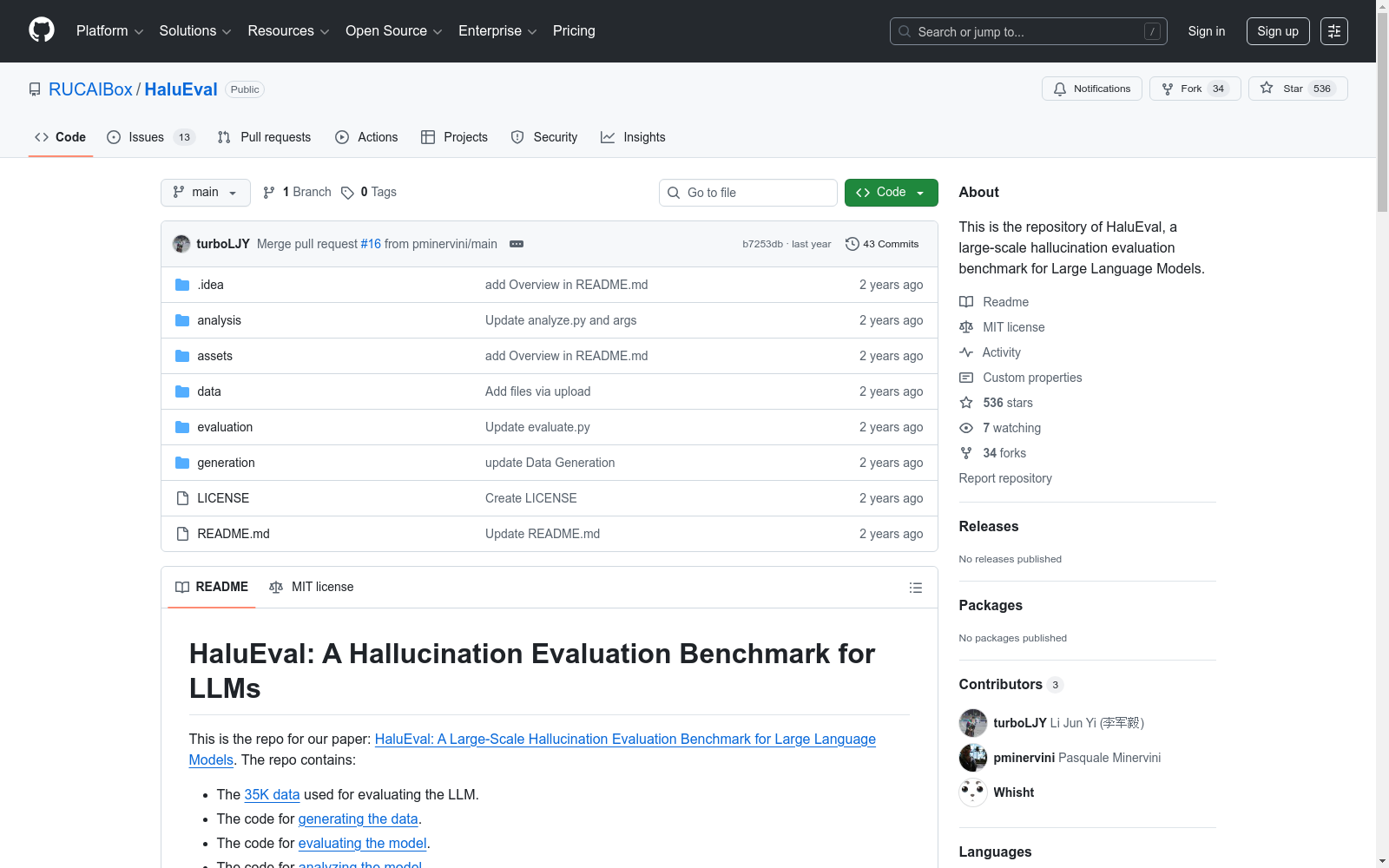

https://github.com/RUCAIBox/HaluEval

下载链接

链接失效反馈资源简介:

HaluEval是由中国人民大学高瓴人工智能学院创建的大规模语言模型幻觉评估基准,包含35,000个人工标注的幻觉样本,用于评估大型语言模型在识别幻觉方面的性能。数据集涵盖了问答、知识驱动对话和文本摘要三个任务,通过自动生成和人工标注相结合的方式构建。HaluEval旨在帮助研究者理解语言模型在何种内容上容易产生幻觉,并探索减轻这一问题的方法,从而推动构建更有效和可靠的语言模型。

提供机构:

高瓴人工智能学院

创建时间:

2023-05-19

搜集汇总

数据集介绍

构建方式

在大型语言模型幻觉评估领域,HaluEval数据集通过自动化生成与人工标注双轨并行的方式构建。自动化生成采用“采样-过滤”两阶段框架:首先基于HotpotQA、OpenDialKG和CNN/Daily Mail等种子数据集,利用ChatGPT通过单次指令与对话式两种策略生成多样化幻觉样本;随后设计基于真实答案增强的过滤指令,筛选出最具迷惑性的样本。人工标注方面,从Alpaca指令调优数据集中筛选出响应分歧度最高的5000条查询,由经过严格筛选的标注员对ChatGPT回复进行幻觉标注,最终形成包含35000个样本的大规模基准。

特点

该数据集具备多维度评估特性,涵盖通用查询响应与三大任务场景(问答、知识对话、文本摘要),形成立体化评估体系。其幻觉样本设计具有高度隐蔽性,通过精细化指令控制生成与真实样本语义相近但存在关键事实偏差的内容,极大提升了识别难度。数据分布呈现主题敏感性特征,幻觉现象在技术、气候、电影等特定主题领域尤为显著。样本标注体系科学严谨,针对不同任务定义了细粒度幻觉模式分类,并为通用查询标注了可验证性、事实性与相关性三重评估维度。

使用方法

研究者可通过该数据集开展三方面探索:首先利用标注样本分析语言模型产生幻觉的内容类型与分布规律;其次评估模型在生成文本中识别幻觉的能力,例如给定问答对时判断答案是否包含幻觉信息;最后可将基准与人工标注结合,系统评估模型输出的幻觉程度。使用时可调用项目仓库代码进行标准化评估,亦可将提供的指令模板迁移至自定义数据集。实验表明,引入外部知识检索能显著提升幻觉识别性能,而样本对比策略因幻觉样本的高仿真性反而可能降低模型判断准确率。

背景与挑战

背景概述

随着以ChatGPT为代表的大语言模型在自然语言处理领域取得突破性进展,其生成内容与事实源冲突或无法被验证的“幻觉”问题日益凸显,成为制约模型可靠部署的关键瓶颈。为系统评估大语言模型的幻觉生成与识别能力,中国人民大学高瓴人工智能学院联合蒙特利尔大学的研究团队于2023年推出了HaluEval基准。该数据集聚焦于回答大语言模型倾向于在何种内容、何种程度上产生幻觉这一核心科学问题,通过自动化生成与人工标注相结合的方式,构建了包含35,000个幻觉/正常样本的大规模集合,涵盖通用查询与三大任务场景,为深入理解并缓解模型幻觉提供了至关重要的实证基础。

当前挑战

HaluEval致力于解决大语言模型幻觉评估这一核心领域挑战,其核心在于如何精准识别模型生成的、看似合理实则违背事实或无法验证的内容。构建过程面临双重挑战:其一,在领域问题层面,幻觉形式多样且隐蔽,要求评估基准能覆盖不同任务(如问答、对话、摘要)中的多种幻觉模式(如事实矛盾、推理错误、无关生成),并确保生成的幻觉样本具有高迷惑性,以有效检验模型的识别盲区。其二,在构建技术层面,挑战在于设计可靠的自动化流程以大规模生成高质量、多样化的幻觉样本,同时需确保人工标注的严谨性,这涉及设计复杂的指令引导模型生成、制定严格的过滤策略筛选高难度样本,以及招募并培训合格的标注人员以应对需要深度阅读理解与事实核查的标注任务。

常用场景

经典使用场景

在自然语言处理领域,大型语言模型生成内容的可靠性评估是当前研究的热点与难点。HaluEval数据集通过构建大规模幻觉样本集合,为模型幻觉识别能力提供了标准化测试平台。该数据集最经典的使用场景是系统性地评估各类LLM在问答、知识对话和文本摘要任务中识别幻觉内容的性能,研究者可基于其设计的分类任务,精确量化模型在区分事实性内容与虚构信息方面的准确率,从而揭示模型在特定主题和语境下的认知盲区。

衍生相关工作

HaluEval数据集的发布催生了一系列围绕幻觉检测与缓解的衍生研究。例如,基于其构建的样本,研究者开发了更精细的幻觉模式分类体系,并探索了检索增强生成与链式推理等策略在降低幻觉率方面的有效性。该数据集亦促进了如SelfCheckGPT等零资源黑盒检测方法的发展,以及针对多模态场景的幻觉评估基准的构建。这些工作共同推动了可信人工智能领域从单一任务评估向跨任务、跨模型统一评测框架的演进。

数据集最近研究

最新研究方向

在大型语言模型(LLMs)的幻觉问题研究领域,HaluEval数据集作为一项大规模幻觉评估基准,正推动着前沿探索的深化。该数据集通过自动生成与人工标注相结合的方式,构建了涵盖通用查询与任务特定场景的幻觉样本,为系统分析LLMs的幻觉生成与识别能力提供了关键资源。当前研究聚焦于利用该基准揭示幻觉的内容类型与分布特征,尤其是在事实矛盾、上下文误解等模式下的表现差异。热点方向包括探索外部知识检索与链式推理等策略对幻觉识别的增强效果,以及评估不同模型在跨任务场景中的鲁棒性。这些工作不仅深化了对LLMs可靠性局限的理解,也为构建更安全、可信的人工智能系统奠定了实证基础。

相关研究论文

- 1HaluEval: A Large-Scale Hallucination Evaluation Benchmark for Large Language Models高瓴人工智能学院 · 2023年

以上内容由遇见数据集搜集并总结生成