MMScan

收藏github2024-10-24 更新2024-10-25 收录

下载链接:

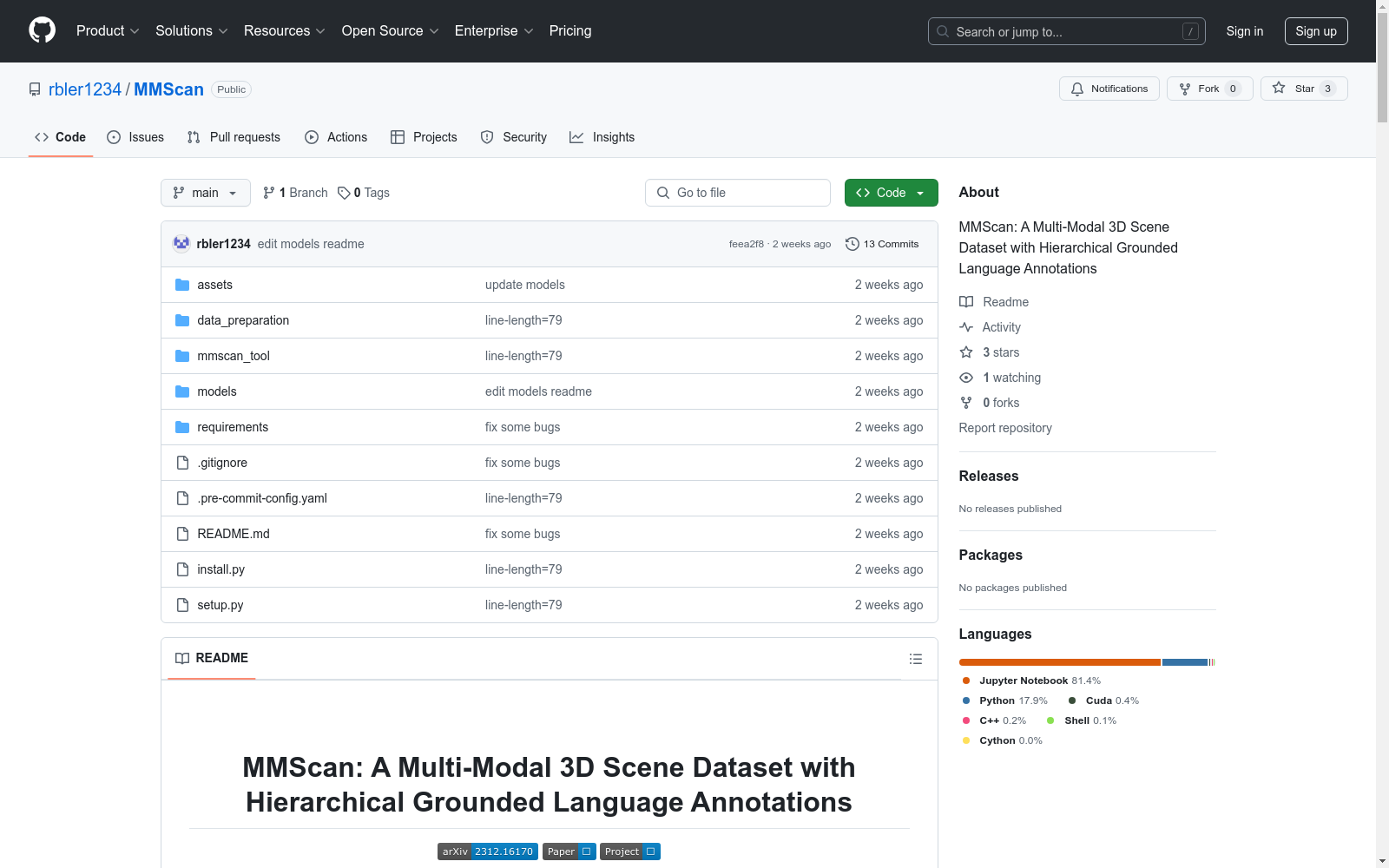

https://github.com/rbler1234/MMScan

下载链接

链接失效反馈资源简介:

MMScan是一个多模态3D场景数据集,包含层次化的接地语言注释。它基于自上而下的逻辑构建,从区域到对象级别,从单一目标到目标间关系,涵盖了空间和属性理解的各个方面。数据集包含1.4M个元注释的描述,涉及109k个对象和7.7k个区域,以及超过3.04M个多样化的样本用于3D视觉接地和问答基准测试。

MMScan is a multimodal 3D scene dataset with hierarchical grounded language annotations. It is constructed under a top-down logical framework, ranging from region to object level, from individual targets to inter-target relationships, covering all aspects of spatial and attribute understanding. The dataset contains 1.4 million meta-annotated descriptions, involving 109k objects and 7.7k regions, as well as over 3.04 million diverse samples for 3D visual grounding and question answering benchmarks.

创建时间:

2024-10-24

原始信息汇总

MMScan: A Multi-Modal 3D Scene Dataset with Hierarchical Grounded Language Annotations

概述

MMScan是一个多模态3D场景数据集,具有分层接地语言注释。该数据集基于自上而下的逻辑构建,从区域到对象级别,从单个目标到目标间关系,涵盖了空间和属性理解的各个方面。数据集包含1.4M个元注释的描述,涉及109k个对象和7.7k个区域,以及超过3.04M个多样化的样本用于3D视觉接地和问答基准测试。

数据集特点

- 多模态3D场景:结合了3D扫描数据和语言注释。

- 分层接地语言注释:从区域到对象级别,涵盖空间和属性理解。

- 大规模数据:包含1.4M个描述,涉及109k个对象和7.7k个区域。

- 多样化的样本:超过3.04M个样本用于3D视觉接地和问答基准测试。

数据准备

- 下载Embodiedscan和MMScan注释数据。

- 解压文件并放置在

MMScan_data/目录下。 - 准备点云文件,参考指南。

数据加载与评估

数据加载

- 使用MMScan DataLoader工具获取模型所需数据。

- 支持通过

__get_item__访问数据,每个条目包含3D、语言和2D模态信息。

评估工具

- 视觉接地评估:计算AP、AR、multi-topk等指标。

- 问答评估:计算Bleu-X、Metor、CiDer、Spice、Simcse、Sbert、EM、Refine EM等指标。

未来计划

- 提供更便捷的安装和调用方式。

- 更新视觉接地和描述基准。

- 完整发布和进一步更新。

AI搜集汇总

数据集介绍

构建方式

MMScan数据集的构建基于一种自上而下的逻辑,从区域到对象级别,从单一目标到目标间的关系,涵盖了空间和属性理解的全面方面。该数据集利用强大的视觉语言模型(VLMs)通过精心设计的提示进行初始化,并结合人工校正以确保标注的自然性、正确性和全面性。基于现有的3D扫描数据,MMScan数据集包含了1.4M个元标注的描述,覆盖了109k个对象和7.7k个区域,以及超过3.04M个多样化的样本用于3D视觉定位和问答基准测试。

特点

MMScan数据集的主要特点在于其多模态的3D场景数据,结合了层次化的接地语言标注,使得数据集在理解和描述3D场景中的对象及其关系方面具有高度的复杂性和准确性。此外,数据集还包含了大量的视觉和语言模态信息,支持多种任务如视觉定位、问答和语言生成等。其多样化的样本和详细的标注使其成为研究多模态3D感知和语言模型的理想资源。

使用方法

使用MMScan数据集,首先需要克隆GitHub仓库并安装相关依赖。接着,用户需下载并解压数据集文件,并按照指南准备点云文件。数据集API提供了便捷的接口,用户可以通过导入MMScan API来获取所需的数据,并使用内置的评估工具对模型输出进行评估。具体使用方法包括加载数据集、访问数据项以及利用评估器计算模型性能指标,如AP、AR等。

背景与挑战

背景概述

随着大型语言模型(LLMs)与其他数据模态的整合,多模态3D感知因其与物理世界的连接而受到越来越多的关注,并取得了显著进展。然而,现有数据集的局限性使得先前的研究主要集中在理解3D场景中的对象属性或对象间空间关系上。为了解决这一问题,本研究构建了首个最大规模的多模态3D场景数据集MMScan,该数据集具有层次化的接地语言注释。MMScan基于自上而下的逻辑构建,从区域到对象级别,从单一目标到目标间关系,涵盖了空间和属性理解的全面方面。通过精心设计的提示,结合强大的视觉语言模型(VLMs)进行初始注释,并进一步引入人工校正,确保注释的自然性、正确性和全面性。该数据集基于现有的3D扫描数据,包含了1.4M个元注释的描述,涉及109k个对象和7.7k个区域,以及超过3.04M个多样化的样本用于3D视觉接地和问答基准测试。

当前挑战

MMScan数据集在构建过程中面临多项挑战。首先,如何高效地整合多模态数据,包括3D点云、语言描述和2D图像,是一个复杂的技术难题。其次,层次化接地语言注释的生成需要精确的算法和人工校正,以确保注释的准确性和自然性。此外,数据集的规模和多样性要求高效的存储和处理技术,以支持大规模的模型训练和评估。最后,如何设计有效的评估基准和指标,以全面衡量模型在多模态3D场景理解中的表现,也是一个重要的研究方向。这些挑战不仅推动了数据集构建技术的发展,也为未来的多模态3D感知研究提供了丰富的资源和方向。

常用场景

经典使用场景

MMScan数据集在多模态3D场景理解领域中具有经典应用,主要用于视觉定位(Visual Grounding)和问答(Question Answering)任务。通过结合3D点云、语言和2D图像数据,该数据集能够训练模型理解复杂的三维空间关系和对象属性,从而实现精确的视觉定位和智能问答系统。

实际应用

在实际应用中,MMScan数据集可用于增强机器人导航、智能家居和增强现实等领域的智能系统。通过精确的3D视觉定位和问答能力,这些系统能够更好地理解和响应用户需求,提升用户体验和操作效率。

衍生相关工作

基于MMScan数据集,研究者们开发了多种先进的3D视觉定位和问答模型,显著提升了现有基准测试的性能。此外,该数据集还激发了多模态学习领域的进一步研究,推动了跨模态信息融合和场景理解技术的发展。

以上内容由AI搜集并总结生成