BBT-FinCorpus

收藏arXiv2023-02-26 更新2024-06-21 收录

下载链接:

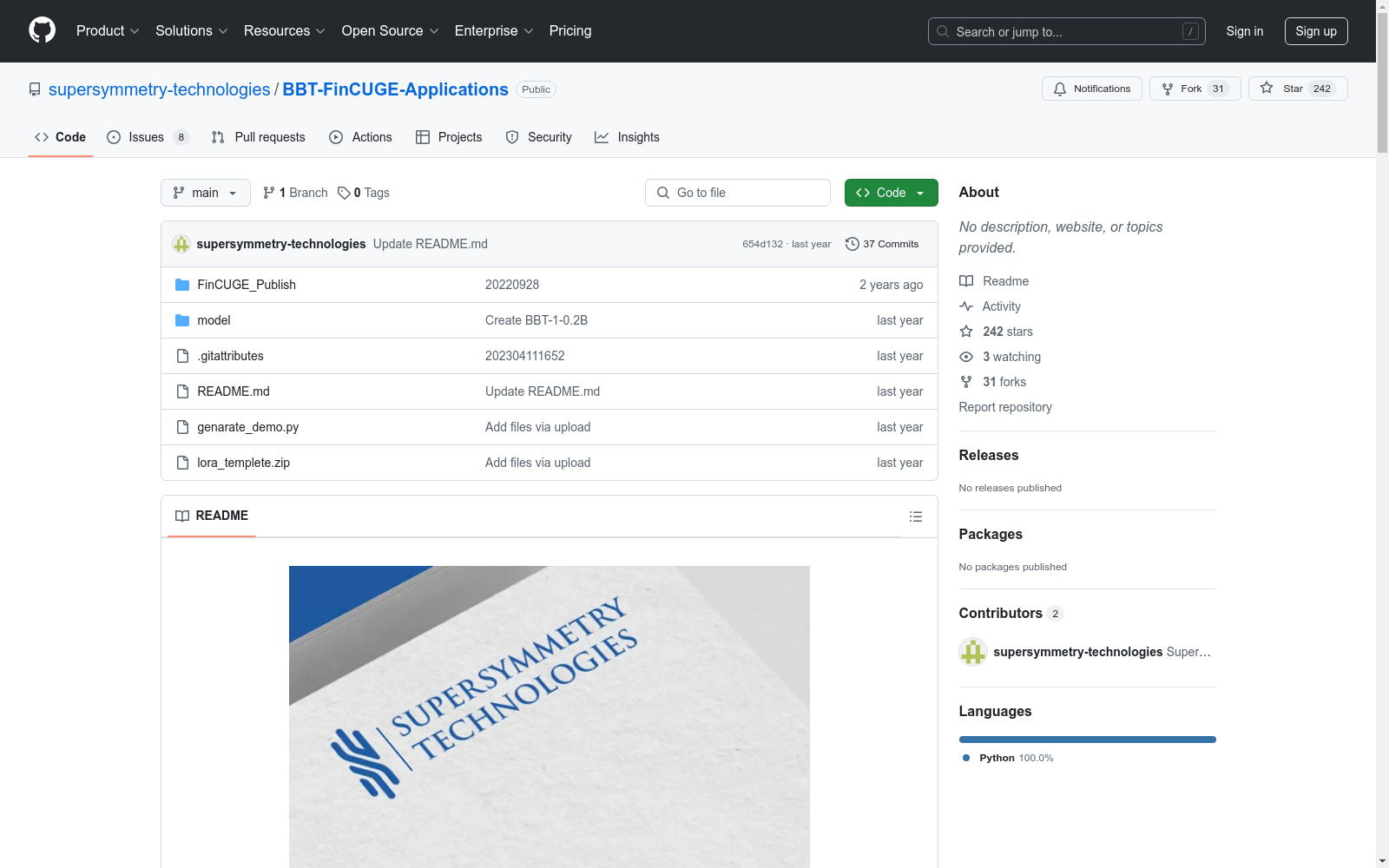

https://github.com/ssymmetry/BBT-FinCUGE-Applications

下载链接

链接失效反馈资源简介:

BBT-FinCorpus是由上海数据科学重点实验室创建的大型中文金融领域数据集,包含约300GB的原始文本,来源于金融新闻、公司公告、研究报告和社交媒体等四个不同渠道。该数据集的创建旨在丰富金融领域的文本多样性,支持金融预训练语言模型的开发。通过精细的收集和处理,BBT-FinCorpus覆盖了金融NLP任务中的主要文本类型,为金融领域的语言理解和生成任务提供了丰富的数据资源。该数据集的应用领域广泛,特别适用于金融信息提取、情感分析等任务,旨在提升中文金融NLP的整体水平。

The BBT-FinCorpus is a large-scale Chinese financial domain dataset created by Fudan University, containing approximately 300GB of raw text sourced from four different channels, including financial news, company announcements, research reports, and social media. The establishment of this dataset aims to enrich the diversity of text in the financial field and support the development of financial pre-trained language models. Through meticulous collection and processing, the BBT-FinCorpus covers the main text types in financial NLP tasks, providing a rich data resource for language understanding and generation tasks in the financial field. The dataset has a wide range of applications and is particularly suitable for tasks such as financial information extraction and sentiment analysis, with the goal of enhancing the overall level of Chinese financial NLP.

提供机构:

上海数据科学重点实验室

创建时间:

2023-02-19

搜集汇总

数据集介绍

构建方式

BBT-FinCorpus 数据集的构建基于对中文金融领域自然语言处理任务的深入分析,涵盖了金融新闻、公司公告、研究报告和社交媒体等多种文本来源。研究团队通过分布式爬虫技术从多个权威金融网站和社交媒体平台抓取了约300GB的原始文本数据,并经过严格的清洗和处理,确保了数据的质量和多样性。此外,数据集的构建还参考了现有金融NLP任务的文本分布,以确保数据集能够全面覆盖金融领域的主要文本类型,从而为预训练语言模型提供丰富的语料支持。

使用方法

BBT-FinCorpus 数据集主要用于金融领域预训练语言模型的构建和评估。研究者可以通过该数据集进行大规模的预训练,以提升模型在金融文本理解与生成任务中的表现。具体使用方法包括:首先,利用数据集进行模型的初始预训练,以捕捉金融领域的特定语言特征;其次,在预训练的基础上,进一步微调模型以适应具体的金融NLP任务,如信息抽取、情感分析等。此外,数据集还可用于构建和评估金融领域的语言理解与生成基准,推动该领域的研究进展。

背景与挑战

背景概述

随着自然语言处理(NLP)技术在金融领域的广泛应用,构建高质量的金融领域预训练语言模型成为迫切需求。复旦大学数据科学重点实验室与SuperSymmetry Technologies合作,于2023年推出了BBT-FinCorpus数据集,该数据集包含约300GB的金融领域中文文本,涵盖了金融新闻、公司公告、研究报告和社交媒体等多种文本来源。该数据集的构建旨在支持BBT-FinT5模型的预训练,该模型基于T5架构,拥有2.2亿至10亿参数,旨在提升中文金融NLP任务的性能。BBT-FinCorpus的发布不仅填补了中文金融领域大规模语料库的空白,还为金融领域的信息提取、情感分析等任务提供了丰富的资源,推动了中文金融NLP研究的发展。

当前挑战

BBT-FinCorpus的构建面临多重挑战。首先,金融领域的文本具有高度的专业性和复杂性,词汇、句法和写作风格与通用文本存在显著差异,这使得模型在处理金融文本时面临较大的挑战。其次,金融领域语料库的规模和多样性对模型的预训练效果至关重要,但现有中文金融语料库规模较小、多样性不足且不开放,这限制了模型的性能提升。此外,金融NLP任务如信息提取和情感分析对模型的实体知识理解和记忆能力提出了更高的要求,而现有的预训练方法在处理这些任务时仍存在不足。最后,缺乏公开的中文金融NLP基准测试使得不同模型之间的性能比较变得困难,阻碍了该领域研究的快速发展。

常用场景

经典使用场景

BBT-FinCorpus 数据集的经典使用场景主要集中在金融领域的自然语言处理任务中,特别是在信息提取和情感分析方面。该数据集为预训练语言模型提供了丰富的金融文本资源,涵盖了新闻、公司公告、研究报告和社交媒体等多种文本类型。通过使用 BBT-FinCorpus,研究者可以训练出更适用于金融领域的语言模型,从而提升模型在金融文本理解与生成任务中的表现。

解决学术问题

BBT-FinCorpus 数据集解决了金融领域自然语言处理中常见的学术问题,特别是在域内语言模型的预训练方面。由于金融文本与通用文本在词汇、句法和写作风格上存在显著差异,通用预训练模型在处理金融文本时表现不佳。通过使用 BBT-FinCorpus,研究者可以针对性地预训练金融领域的语言模型,从而显著提升模型在金融任务中的性能,推动了金融自然语言处理领域的发展。

实际应用

BBT-FinCorpus 数据集在实际应用中具有广泛的应用场景,尤其是在金融行业的信息提取、情感分析和新闻分类等任务中。例如,金融机构可以利用该数据集训练的模型来自动化处理大量的金融新闻和公告,快速提取关键信息并进行情感分析,从而为投资决策提供支持。此外,该数据集还可以用于构建金融知识图谱,帮助企业更好地理解和利用金融数据。

数据集最近研究

最新研究方向

BBT-FinCorpus 数据集的最新研究方向主要集中在金融领域自然语言处理(NLP)的深度应用上。该数据集通过构建大规模的中文金融语料库,支持了基于 T5 架构的 BBT-FinT5 预训练语言模型的开发,旨在提升金融文本的理解与生成能力。研究者们通过引入知识增强的预训练方法,进一步优化了模型在金融领域的实体知识理解和记忆能力。此外,BBT-CFLEB 基准的提出,为金融 NLP 任务提供了全面的评估框架,涵盖了语言理解和生成任务,推动了该领域模型性能的快速迭代与提升。这些研究不仅填补了中文金融 NLP 领域的空白,还为金融行业的信息提取、情感分析等实际应用提供了强有力的技术支持。

相关研究论文

- 1BBT-Fin: Comprehensive Construction of Chinese Financial Domain Pre-trained Language Model, Corpus and Benchmark上海数据科学重点实验室 · 2023年

以上内容由遇见数据集搜集并总结生成