ASQA, ANTIQUE, Wikieval

收藏arXiv2025-04-25 更新2025-04-29 收录

下载链接:

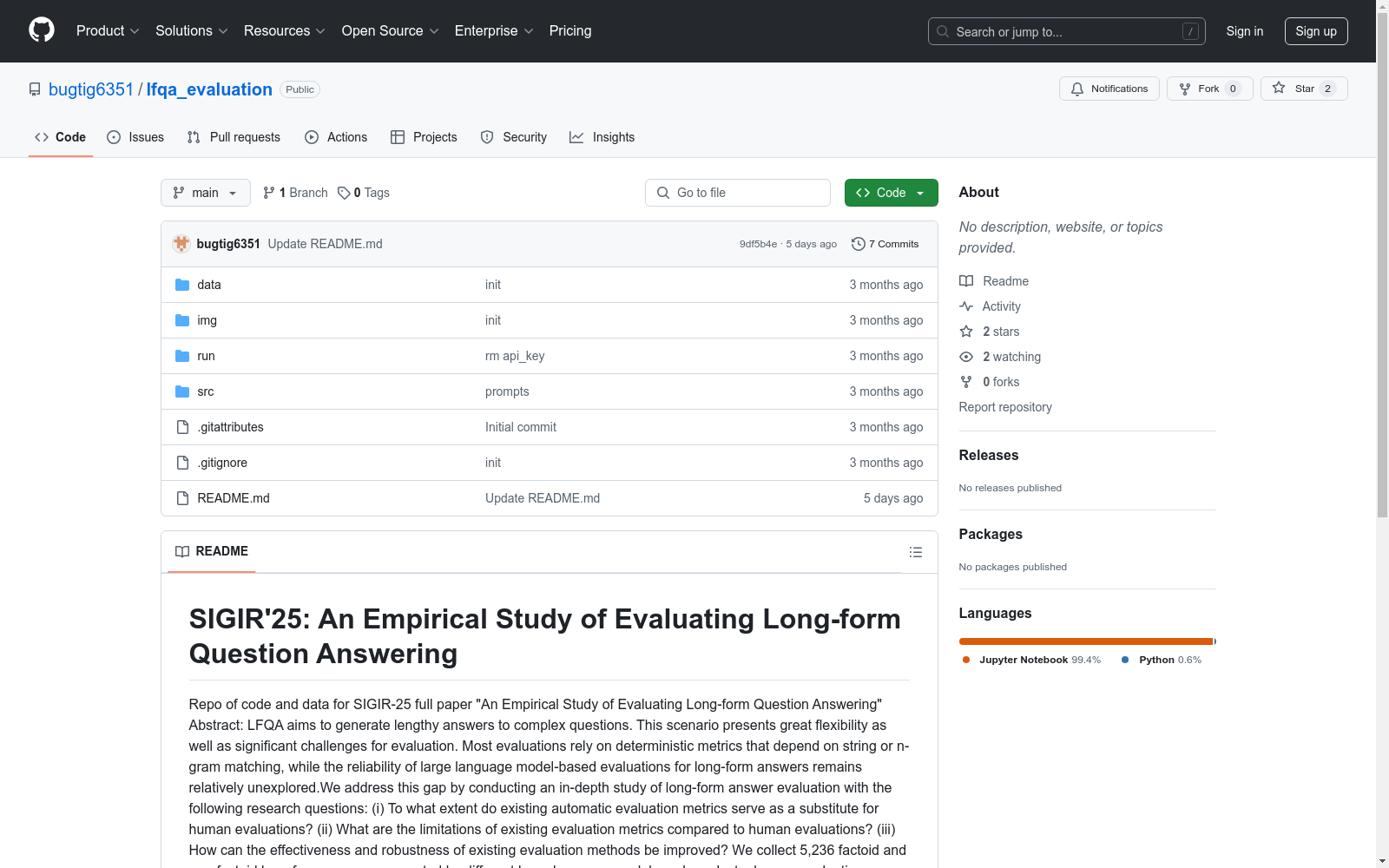

https://github.com/bugtig6351/lfqa_evaluation

下载链接

链接失效反馈官方服务:

资源简介:

本文研究的数据集包括ASQA、ANTIQUE和Wikieval三个数据集,它们分别代表了模糊、事实和开放式问答的场景。这些数据集包含了由不同大型语言模型生成的5236个事实和非事实的长篇答案。其中,2079个答案经过了人工评估,主要关注正确性和信息性。该数据集旨在评估长篇问答(LFQA)的自动评估指标的有效性和鲁棒性,并与人工评估进行对比。数据集的创建过程包括从不同的LLM中收集答案,并使用人工评估来检验自动评估指标的准确性。数据集的应用领域是信息检索和问答系统,旨在解决长篇问答评估中存在的问题。

The dataset investigated in this paper comprises three datasets: ASQA, ANTIQUE, and Wikieval, which respectively correspond to the scenarios of ambiguous, factual, and open-domain question answering. These datasets contain 5,236 long-form factual and non-factual answers generated by diverse large language models. Of these, 2,079 answers have been manually evaluated, with the primary focus on correctness and informativeness. This dataset is designed to evaluate the effectiveness and robustness of automatic evaluation metrics for long-form question answering (LFQA), and to enable comparison with manual evaluation results. The dataset's creation process involves collecting answers from various LLMs and utilizing manual evaluation to validate the accuracy of automatic evaluation metrics. The application domains of this dataset cover information retrieval and question answering systems, aiming to address the challenges inherent in long-form question answering evaluation.

提供机构:

中国科学院计算技术研究所

创建时间:

2025-04-25

原始信息汇总

数据集概述

数据集基本信息

- 数据集名称: SIGIR25: An Empirical Study of Evaluating Long-form Question Answering

- 存储位置:

data文件夹 - 数据格式: JSON

数据集内容

- 数据量: 5,236个长形式答案(包含事实性和非事实性答案)

- 人工评估样本量: 2,079个答案

- 评估维度: 正确性和信息性

研究背景

- 研究领域: 长形式问答(LFQA)评估

- 研究问题:

- 现有自动评估指标在多大程度上可以替代人工评估

- 现有评估指标相比人工评估的局限性

- 如何提升现有评估方法的有效性和鲁棒性

数据特征

- 答案类型: 由不同大语言模型生成

- 影响因素: 答案风格、长度和问题类别会影响自动评估指标的偏差

相关资源

- 代码位置:

src文件夹(包含模型调用接口、提示词和工具函数) - 实验代码:

run文件夹(以Jupyter Notebook形式存储) - 完整资源: https://github.com/bugtig6351/lfqa_evaluation

搜集汇总

数据集介绍

构建方式

ASQA、ANTIQUE和Wikieval数据集是针对长形式问答(LFQA)任务设计的,旨在评估复杂问题的详细回答。ASQA数据集包含模糊事实性问题,每个问题配有多个人工标注的长回答;ANTIQUE数据集则聚焦于开放式问答,包含来自Yahoo! Answers的用户问题及专家标注的答案;Wikieval数据集则基于维基百科页面生成,涵盖事实性问答。数据集的构建过程涉及从不同来源收集问题,并通过人工标注或专家验证确保回答的质量和多样性。

特点

这三个数据集各具特色:ASQA专注于模糊事实性问题的多角度回答,ANTIQUE强调开放式问题的多样性和用户真实需求,Wikieval则侧重于事实性问题的精确性。它们共同覆盖了长形式问答的多种类型,为评估模型的全面性提供了丰富资源。数据集中的回答由不同的大型语言模型生成,并经过人工评估,确保了数据的可靠性和代表性。

使用方法

这些数据集主要用于评估长形式问答模型的性能,特别是回答的正确性和信息丰富性。研究人员可以通过比较自动评估指标(如ROUGE、BERTScore等)与人工评估的一致性,分析不同模型的表现。此外,数据集还可用于研究评估方法的鲁棒性和公平性,例如通过引入微小扰动或分析不同问题类型对评估结果的影响。使用时需注意数据集的特定领域和问题类型,以确保评估的针对性和有效性。

背景与挑战

背景概述

ASQA、ANTIQUE和Wikieval数据集是针对长形式问答(LFQA)任务而设计的,旨在评估生成模型在回答复杂、开放式问题时的表现。这些数据集由中国科学院计算技术研究所和荷兰阿姆斯特丹大学的研究团队于2025年创建,核心研究问题聚焦于如何有效评估长形式答案的正确性和信息丰富性。LFQA任务因其答案的灵活性和复杂性,对传统评估方法提出了挑战,而ASQA、ANTIQUE和Wikieval的引入填补了这一领域的空白,推动了自动评估技术的发展。这些数据集通过结合人类评估和自动评估方法,为研究社区提供了宝贵的资源,促进了长形式问答模型的优化与改进。

当前挑战

ASQA、ANTIQUE和Wikieval数据集在构建和应用过程中面临多重挑战。首先,长形式问答的评估问题本身具有复杂性,传统基于字符串匹配的评估指标(如ROUGE和BLEU)难以捕捉答案的语义准确性和信息丰富性,导致与人类评估的一致性较低。其次,数据集的构建过程中,如何确保参考答案的质量和多样性是一大难题,尤其是对于开放式的非事实性问题。此外,基于大语言模型(LLM)的评估方法虽然表现出更高的稳定性,但仍存在对答案长度、问题类型和自我生成答案的偏好等偏差。这些挑战需要通过更精细的评估策略和多样化的评估方法来逐步解决。

常用场景

经典使用场景

ASQA、ANTIQUE和Wikieval数据集在长形式问答(LFQA)研究中扮演了重要角色。这些数据集通常用于评估生成模型在回答复杂、开放性问题时的表现。ASQA专注于模糊事实性问题,ANTIQUE则包含开放性问题,而Wikieval则侧重于事实性问题。研究者通过这些数据集来测试模型生成答案的正确性和信息丰富性,从而推动LFQA领域的发展。

衍生相关工作

基于这些数据集,研究者提出了多项经典工作。例如,Su等人提出了一个框架,利用细粒度的答案相关信息来增强模型响应的忠实性;Tao等人则开发了一个链式讨论框架,利用多个开源LLM的协同作用生成更准确的答案。此外,LLM-based评估方法如GPTScore和RAGAS也在这些数据集上得到了验证和优化。

数据集最近研究

最新研究方向

在长文本问答(LFQA)领域,ASQA、ANTIQUE和Wikieval数据集的最新研究方向聚焦于自动评估指标的优化与可靠性验证。随着大型语言模型(LLM)生成能力的提升,传统基于字符串匹配的评估方法(如ROUGE、BLEU)在长答案评估中暴露语义捕捉不足的缺陷,而基于LLM的评估方法(如GPT-4o、Claude-3.5)虽展现出更高的人类评估一致性,但仍受答案长度、问题类型及自我强化偏见的干扰。当前研究通过细粒度提示工程和多维度偏差分析(如逆文档频率统计、温度参数敏感性测试),探索提升评估鲁棒性的路径,尤其在事实性问答(ASQA)与非事实性开放问答(ANTIQUE)的交叉场景中,揭示了评估框架需适配任务特性的必要性。

相关研究论文

- 1An Empirical Study of Evaluating Long-form Question Answering中国科学院计算技术研究所 · 2025年

以上内容由遇见数据集搜集并总结生成