EchoMind

收藏arXiv2025-10-27 更新2025-10-29 收录

下载链接:

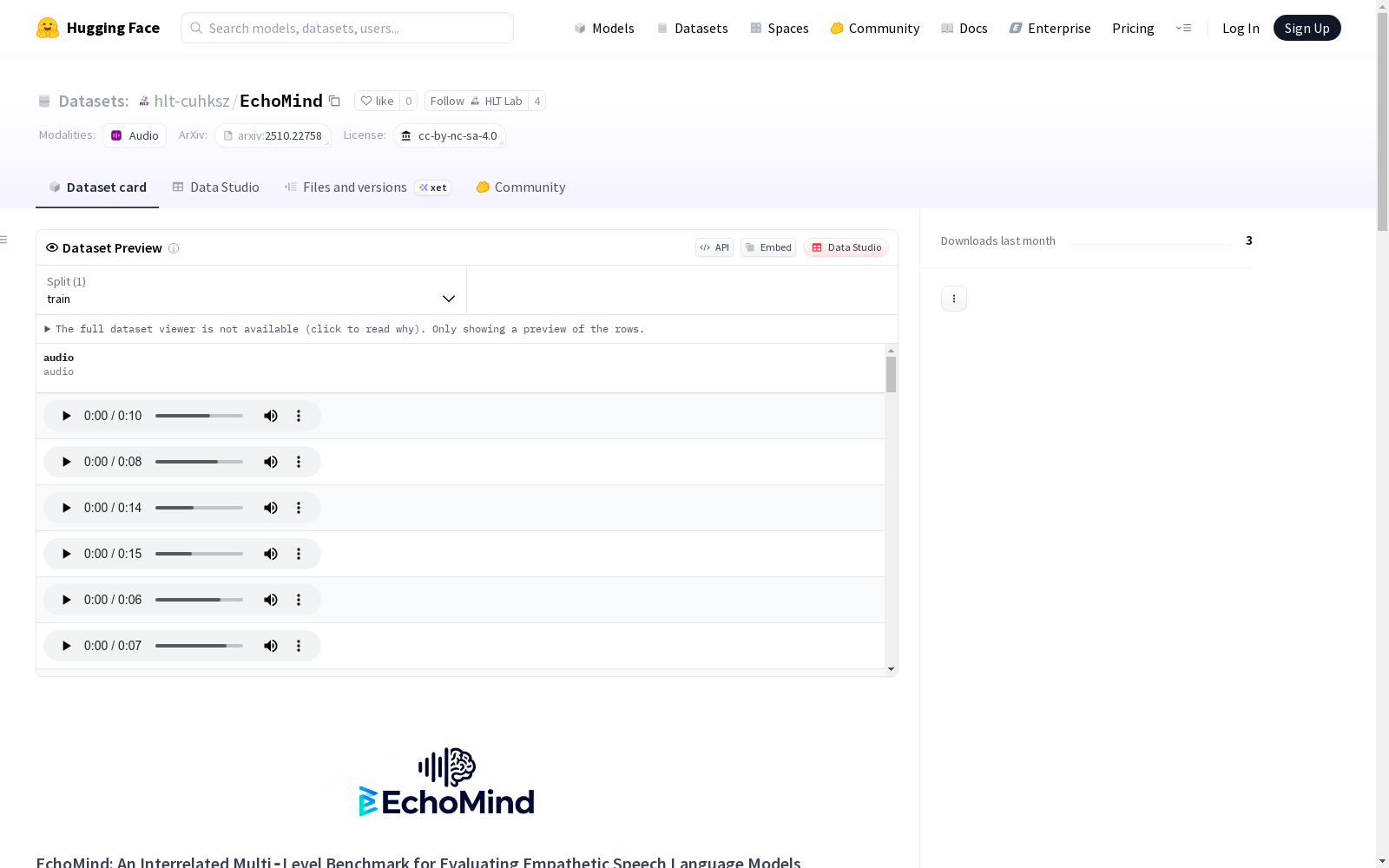

https://huggingface.co/datasets/hlt-cuhksz/EchoMind

下载链接

链接失效反馈官方服务:

资源简介:

EchoMind是一个多层次的对话评估基准,旨在全面评估语音语言模型(SLMs)的共情能力。该数据集模拟了人类对话的认知过程,通过三个相互关联的阶段进行评估:理解(内容理解和语音感知)、推理(综合推理)和对话(开放式回复生成)。EchoMind的数据集包含1,137个对话脚本,每个脚本都有三种语音风格变体,用于测试语音表达对模型的影响。该数据集的构建旨在解决SLMs在理解和生成共情式对话方面的挑战,以促进更高级的语音语言模型的发展。

EchoMind is a multi-level dialogue evaluation benchmark designed to comprehensively evaluate the empathic capabilities of Spoken Language Models (SLMs). This dataset simulates the cognitive process of human dialogue, and conducts evaluations across three interrelated stages: comprehension (content understanding and speech perception), reasoning (comprehensive reasoning), and dialogue (open-ended response generation). The EchoMind dataset contains 1,137 dialogue scripts, each with three speech style variants to test the impact of vocal expression on models. This benchmark is constructed to address the challenges faced by SLMs in understanding and generating empathic dialogues, so as to promote the development of more advanced spoken language models.

提供机构:

香港中文大学(深圳)大数据研究院

创建时间:

2025-10-27

原始信息汇总

EchoMind数据集概述

数据集基本信息

- 数据集名称: EchoMind

- 维护机构: 香港中文大学人类语言技术中心

- 许可证: CC-BY-NC-SA-4.0

- 联系方式: lizhou21@cuhk.edu.cn

数据集定位

EchoMind是首个相互关联的多阶段基准测试,专门用于评估语音语言模型的共情对话能力。该基准通过顺序的、上下文关联的任务模拟共情对话的认知过程。

核心特征

- 多级评估框架: 包含三个主要层级

- 层级1: 通过内容理解和语音感知进行评估

- 层级2: 整合内容和语音进行推理

- 层级3: 生成上下文和情感对齐的开放域响应

- 控制变量设计: 所有任务共享相同的语义中性脚本,同时通过受控的语音风格变化测试表达效果

- 共情导向框架: 涵盖3个粗粒度和12个细粒度维度,包含39个语音属性

评估维度

- 评估方法: 结合客观指标和主观指标

- 核心能力: 口语内容理解、非词汇语音线索感知、整合推理、响应生成

- 测试范围: 已测试12个先进的语音语言模型

主要发现

- 现有最先进模型在处理高表达性语音线索方面存在困难

- 在指令遵循、自然语音变化的适应性以及有效利用语音线索实现共情方面存在持续弱点

相关资源

- 论文: https://arxiv.org/abs/2510.22758

- 官方网站: https://hlt-cuhksz.github.io/EchoMind/

- 排行榜: https://hlt-cuhksz.github.io/EchoMind/

- HuggingFace数据集页面: https://huggingface.co/datasets/hlt-cuhksz/EchoMind

搜集汇总

数据集介绍

构建方式

在语音语言模型研究领域,构建高质量数据集对评估模型共情能力至关重要。EchoMind数据集通过精心设计的流程构建,首先利用GPT-4o生成语义中立的对话脚本,确保文本不包含显性情感或语境线索。每个用户话语对应三种响应:基于目标声音属性的高情商回复、仅基于文本的无关声音回复,以及基于替代声音属性的共情回复。随后采用多方法语音合成策略,针对不同声音维度(如说话者信息采用Doubao TTS,副语言特征结合语音克隆与提示工程)生成目标、中性和替代三种声音风格变体。为确保数据真实性,还招募专业配音演员录制了包含491个脚本的人类语音版本,最终形成包含1,137个脚本的完整数据集。

使用方法

该数据集的使用遵循分层评估范式,研究人员可通过其提供的多级任务框架系统测试语音语言模型的共情能力。在理解层级,模型需完成自动语音识别任务评估内容理解能力,并通过多选题形式测试声音特征识别精度。推理层级要求模型整合语音内容与声学特征进行综合推断,解决涉及说话者意图识别、情境推理等复杂任务。对话层级则采用开放域响应生成模式,评估模型生成语境连贯且情感契合的回复能力。评估过程支持三种提示设置(零提示、基础提示和增强提示),便于分析模型对指令的敏感性。数据集提供标准化评估指标,包括词错误率、准确率等客观指标,以及基于模型评判和人工评定的主观维度评分,确保评估结果的全面性与可靠性。

背景与挑战

背景概述

EchoMind数据集由香港中文大学(深圳)与深圳市大数据研究院于2025年联合发布,旨在系统评估语音语言模型在共情对话中的综合能力。该数据集围绕语音中非词汇性声学线索的感知与响应,构建了一个涵盖说话者信息、副语言特征和环境背景的39维声学属性框架。通过设计语义中性的对话脚本并控制声学风格变化,EchoMind模拟人类共情认知过程,依次考察语音内容理解、声学线索感知、多模态推理和对话生成能力,填补了现有评测基准在跨任务关联性与情感智能评估方面的空白。

当前挑战

EchoMind面临的领域挑战在于解决语音语言模型对高表达性声学线索的感知薄弱问题,现有模型在整合语言内容与声学特征生成情感对齐响应时表现局限。构建过程中的挑战包括:需在保持语义中立性的前提下设计覆盖多维度声学属性的对话脚本;通过人工审核与多阶段过滤确保数据质量;平衡合成语音与真实人声的变异性以提升模型鲁棒性;建立跨任务关联的评测体系以准确反映共情对话中的认知递进过程。

常用场景

经典使用场景

在语音语言模型评估领域,EchoMind数据集通过模拟人类共情对话的认知流程,构建了理解、推理与对话生成的三级任务框架。该数据集采用语义中立的对话脚本与受控的语音风格变体,系统性地考察模型对非词汇声学线索的感知能力。其经典应用场景在于为端到端语音对话系统提供多维度的共情能力基准测试,尤其聚焦于声学特征与语义内容的协同理解机制。

解决学术问题

EchoMind有效解决了语音语言模型在共情对话中的核心学术挑战:传统基准测试往往孤立评估语言理解或声学特征,难以衡量多模态信息的融合能力。该数据集通过构建覆盖39种声学属性的统一框架,突破了非词汇线索与语义内容割裂评估的局限。其意义在于首次建立了声学特征与共情响应的关联范式,为情感智能语音模型的跨模态对齐研究提供了可量化的理论支撑。

实际应用

该数据集在智能语音助手、情感陪护机器人等实际场景中具有重要价值。通过模拟真实对话中的咳嗽、叹息等生理声学特征,以及环境音与语音的混合输入,能够训练系统识别用户潜在的健康状态或情绪波动。在远程医疗、智能客服等领域,基于EchoMind训练的模型可实现对用户非言语信息的精准感知,生成兼具语境适应性与情感温度的交互响应。

数据集最近研究

最新研究方向

在语音语言模型领域,EchoMind数据集推动了共情对话能力评估的前沿研究,聚焦于多模态线索的整合与认知过程模拟。该数据集通过设计语义中性脚本与可控声学风格变体,系统评估模型对非词汇声学线索的感知能力,涵盖说话者信息、副语言特征和环境上下文等39种声学属性。当前研究热点在于解决高表现力声学线索下的模型瓶颈,探索提示策略优化、自然语音鲁棒性增强以及声学-语义对齐机制。这些进展对构建具有情感智能的对话系统具有重要意义,为医疗辅助、教育陪伴等现实应用场景提供了理论基础与评估范式。

相关研究论文

- 1EchoMind: An Interrelated Multi-level Benchmark for Evaluating Empathetic Speech Language Models香港中文大学(深圳)大数据研究院 · 2025年

以上内容由遇见数据集搜集并总结生成