GeoComp Dataset

收藏github2025-04-12 更新2025-04-13 收录

下载链接:

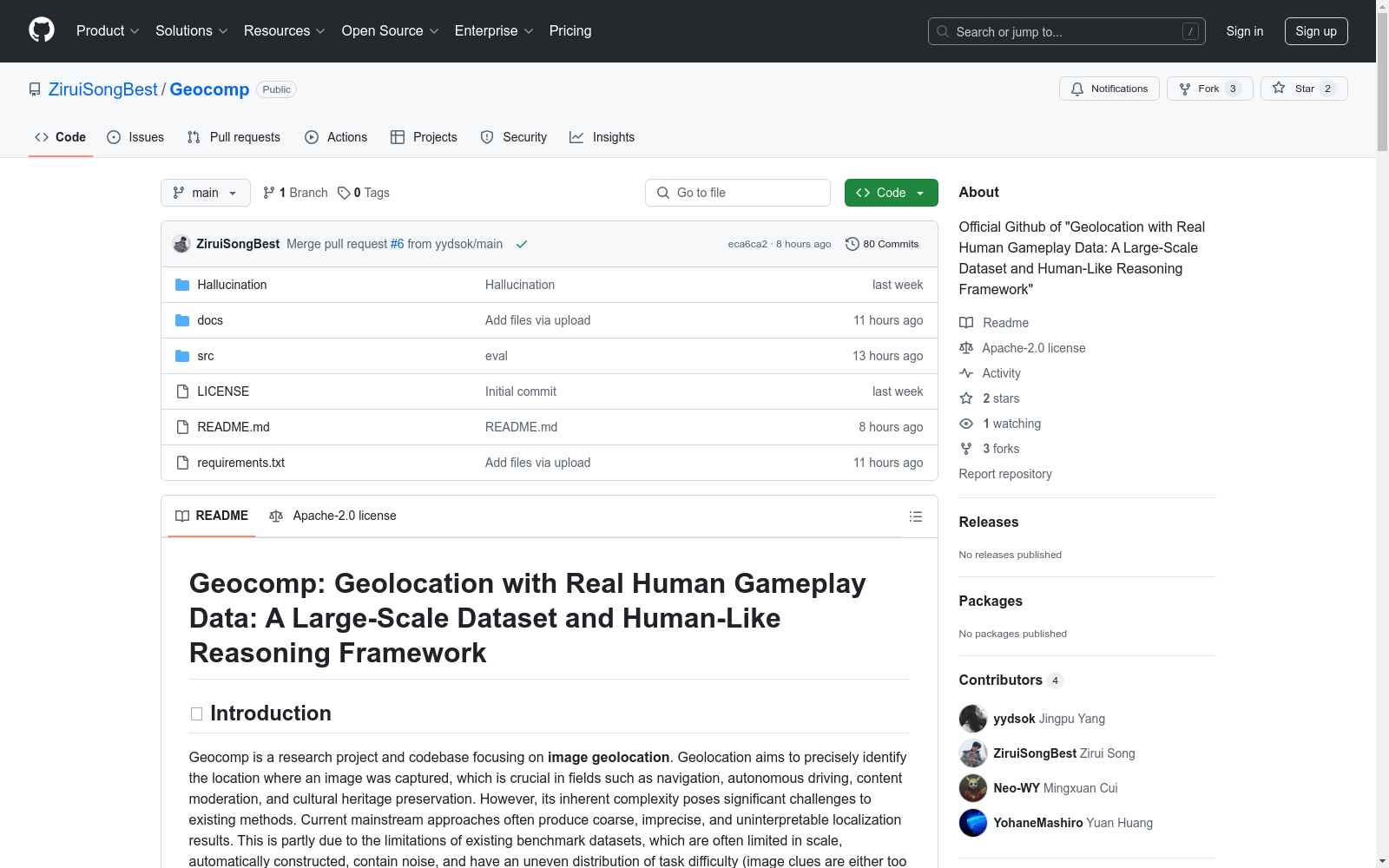

https://github.com/ZiruiSongBest/Geocomp

下载链接

链接失效反馈资源简介:

GeoComp数据集是一个大规模、高质量的数据集,源自真实人类参与的地理定位竞赛数据。包含来自在线地理定位游戏平台(tuxun.fun)超过740,000名用户两年多的真实交互数据,拥有2500万条元数据和超过300万条地理标记的街景位置,覆盖广泛的全球区域。每个位置都经过数千甚至数万次人类玩家的定位尝试,嵌入了丰富的任务难度信息和有价值的真实人类表现基准。

The GeoComp dataset is a large-scale, high-quality dataset derived from real human-participated geolocation competition data. It contains real interaction data spanning more than two years from over 740,000 users on the online geolocation game platform tuxun.fun, with 25 million metadata entries and over 3 million geotagged street view locations covering a wide range of global regions. Each location has undergone geolocation attempts by thousands or even tens of thousands of human players, embedding rich task difficulty information and valuable real human performance benchmarks.

创建时间:

2025-04-05

原始信息汇总

GeoComp数据集概述

数据集简介

GeoComp是一个专注于图像地理定位的研究项目和代码库。地理定位旨在精确识别图像拍摄位置,在导航、自动驾驶、内容审核和文化遗产保护等领域至关重要。当前主流方法由于现有基准数据集的限制(规模有限、自动构建、包含噪声、任务难度分布不均),往往产生粗糙、不精确且难以解释的定位结果。

核心组件

- GeoComp数据集:源自真实人类参与地理定位竞赛的大规模高质量数据集。

- GeoCoT推理方法:模仿人类思维链(CoT)的地理空间推理框架,旨在增强大型视觉语言模型(LVMs)的地理定位能力。

- GeoEval评估套件:专门设计的指标和工具,用于全面评估地理定位模型的性能和推理过程。

主要特点

- 大规模真实世界数据集(GeoComp):

- 源自在线地理定位游戏平台(tuxun.fun)740,000用户两年多的真实交互数据。

- 包含2500万条元数据和超过300万个地理标记的街景位置,覆盖广泛的全球区域。

- 每个位置经过数千甚至数万次人类玩家的定位尝试,嵌入丰富的任务难度信息和有价值的真实人类性能基准。

- 类人推理框架(GeoCoT):

- 提出新颖的多步骤地理空间思维链(GeoCoT)框架,显著增强大型视觉语言模型(LVMs)在复杂地理定位任务中的推理能力。

- 模仿人类从宏观层面(气候、地形、植被)到微观细节(标志语言、建筑风格、车辆特征)的推理过程。

- 实验表明,GeoCoT可显著提高地理定位准确率(最高25%),同时增强模型决策过程的可解释性。

- 全面评估套件(GeoEval):

- 包括比较模型推理过程与人类专家标注的“黄金”推理的指标,以及模型自身推理链内部一致性的评估。

- 引入详细的幻觉评估维度(对象幻觉OH、事实幻觉FH、归因幻觉AH),全面确保模型推理结果的可靠性和真实性。

- 基准模型与完整代码:

- 提供各种地理定位基准模型的实现(

baseline),供研究人员公平比较。 - 开源完整代码,包括数据处理(

Dataset)、核心方法(Geocot)和评估(Geoeval),支持社区复现和扩展。

- 提供各种地理定位基准模型的实现(

数据集对比

GeoComp数据集与其他数据集相比,具有更大规模、更高质量和更丰富的真实人类性能基准。

许可证

本项目采用MIT许可证,详细信息请参阅项目根目录中的LICENSE文件。

AI搜集汇总

数据集介绍

构建方式

GeoComp数据集构建于一个在线地理定位游戏平台(tuxun.fun)的真实用户交互数据,历时两年多,汇集了74万用户的参与。该数据集包含2500万条元数据记录和超过300万个地理标记的街景位置,覆盖了广泛的全球区域。每个位置都经历了数千甚至数万次人类玩家的定位尝试,从而嵌入了丰富的任务难度信息和真实人类表现基准。

特点

GeoComp数据集以其大规模和高质量著称,数据来源于真实人类参与的地理定位竞赛,确保了数据的多样性和真实性。数据集不仅覆盖全球多个区域,还包含了详细的街景图像和元数据,为研究提供了丰富的空间和上下文线索。此外,数据集还包含了人类玩家的多次尝试记录,为评估模型性能提供了宝贵的基准。

使用方法

使用GeoComp数据集时,研究人员可以通过提供的代码库(`src/Dataset`)加载和处理数据,与街景API(如Google Street View)交互以获取图像数据。数据集支持多种基准模型的实现(`src/baseline`),并提供了完整的评估工具(`src/Geoeval`)来计算地理距离误差和分类/回归指标。用户还可以通过运行`src/Geocot/run_geocot.py`来应用GeoCoT推理框架进行地理定位任务。

背景与挑战

背景概述

GeoComp数据集是由在线地理定位游戏平台(tuxun.fun)上的真实用户交互数据构建而成,旨在解决图像地理定位领域的核心问题。该数据集创建于2023年,由Zirui Song等研究人员主导,涵盖了全球范围内超过300万条地理标记的街景位置数据,源自74万用户两年多的真实游戏记录。地理定位技术在导航、自动驾驶、内容审核及文化遗产保护等领域具有重要应用价值,但现有方法常因数据集规模有限、自动构建噪声多、任务难度分布不均等问题,导致定位结果粗糙且难以解释。GeoComp数据集的推出为提升模型的推理能力和定位精度提供了高质量基准,推动了地理定位领域的研究进展。

当前挑战

GeoComp数据集面临的挑战主要体现在两方面:领域问题方面,传统地理定位方法依赖分类或检索策略,存在定位精度低、对新区域泛化能力弱及结果可解释性差等瓶颈;构建过程方面,需处理海量用户生成数据的噪声过滤、全球区域覆盖均衡性,以及整合人类玩家定位行为中的隐含难度信息。此外,数据集中图像线索的显隐程度差异显著,要求模型具备从宏观环境到微观细节的多层次推理能力,这对现有视觉-语言大模型的时空推理机制提出了更高要求。

常用场景

经典使用场景

在图像地理定位领域,GeoComp数据集因其大规模、高质量的特性,成为评估和提升模型性能的黄金标准。该数据集广泛应用于训练和测试视觉语言大模型,特别是在需要复杂空间推理的场景中,如通过街景图像中的气候、地形、植被等宏观线索,以及标志语言、建筑风格等微观细节进行精确定位。研究人员利用GeoComp数据集验证模型在多层次推理任务中的表现,推动地理定位技术从粗粒度到细粒度的跨越。

衍生相关工作

围绕GeoComp数据集,学术界衍生出多项经典研究工作。其中包括基于GeoCoT框架的扩展模型,如融合多模态信息的增强型推理系统,以及针对特定地理区域优化的定位算法。该数据集还催生了新的评估标准GeoEval,被后续研究广泛采用作为模型性能的基准测试工具。部分工作进一步挖掘数据集中的人类行为模式,开发出结合群体智能的地理定位新方法。

数据集最近研究

最新研究方向

在图像地理定位领域,GeoComp数据集以其大规模、高质量的特性成为研究热点。该数据集源自真实人类参与的740,000用户的地理定位游戏数据,覆盖全球范围,包含超过300万个地理标记的街景位置,为模型训练提供了丰富的真实世界场景。前沿研究主要聚焦于如何利用GeoCoT推理框架提升大型视觉语言模型(LVMs)的地理定位能力,通过模仿人类从宏观到微观的多步推理过程,显著提高了定位精度和结果可解释性。此外,GeoEval评估套件的引入为全面评估模型性能提供了新标准,特别是在幻觉检测方面,为提升模型推理的可靠性开辟了新路径。这些进展不仅推动了地理定位技术的边界,也为自动驾驶、文化遗产保护等应用场景提供了更精准的解决方案。

以上内容由AI搜集并总结生成