MMSU

收藏arXiv2025-06-05 更新2025-06-07 收录

下载链接:

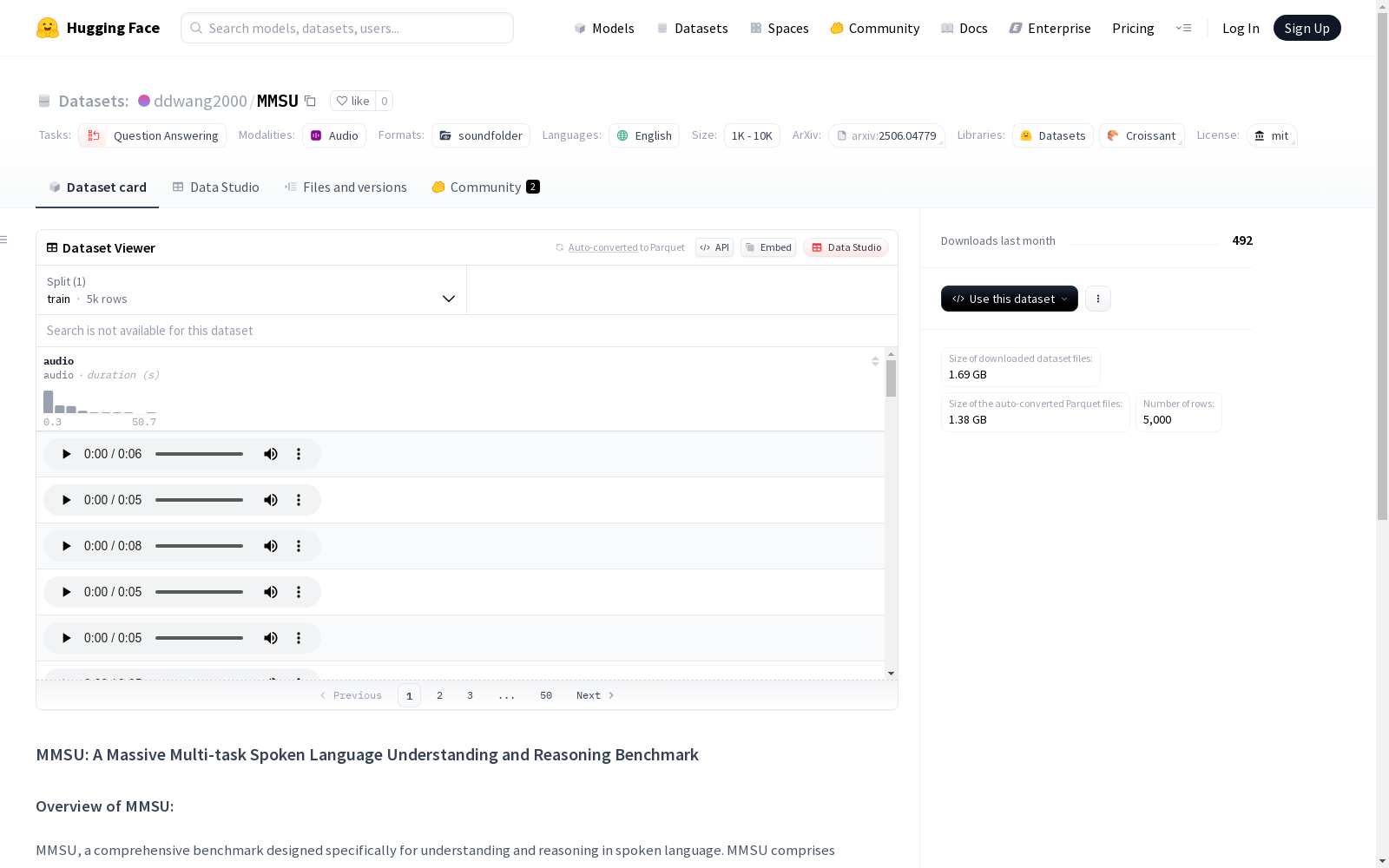

https://huggingface.co/datasets/ddwang2000/MMSU

下载链接

链接失效反馈官方服务:

资源简介:

MMSU是一个大规模的多任务口语理解和推理基准,由香港中文大学的研究团队创建。该数据集包含5000个经过精心策划的音频-问题-答案三元组,跨越47个不同的任务。数据集系统地融入了广泛的语音现象,包括语音学、韵律、修辞、句法学、语义学和副语言学。MMSU旨在通过评估14个先进的SpeechLLMs来建立口语理解的新标准,并为开发更复杂的人机语音交互系统提供有价值的见解。

MMSU is a large-scale multi-task spoken language understanding and reasoning benchmark developed by the research team at The Chinese University of Hong Kong. This dataset includes 5,000 carefully curated audio-question-answer triples spanning 47 distinct tasks. It systematically incorporates a wide range of speech phenomena, including phonetics, prosody, rhetoric, syntax, semantics, and paralinguistics. MMSU aims to establish new standards for spoken language understanding by evaluating 14 state-of-the-art SpeechLLMs, and provide valuable insights for the development of more sophisticated human-machine speech interaction systems.

提供机构:

香港中文大学

创建时间:

2025-06-05

搜集汇总

数据集介绍

构建方式

MMSU数据集的构建过程分为四个阶段:首先,通过与语言学专家合作设计基于语言学理论的47项任务;其次,从权威教材和在线资源收集多选题,并利用GPT-4o生成干扰项;第三,优先采用开源真实语音数据,针对特定语音学任务进行专业录音;最后经过多轮人工审核确保数据质量。该数据集包含5,000个经过专家评审的音频-问题-答案三元组,其中76.74%采用真实录音,13.44%为专业录制,9.82%使用Azure TTS合成。

特点

作为首个系统整合语言学理论的语音理解基准,MMSU具有三大特征:1) 涵盖10类非语言声音、13种英语口音等细粒度声学特征;2) 基于语音学、韵律学等六大语言学分支设计47项任务,包括语码转换问答、语调推理等创新任务;3) 通过专业录音和专家评审确保数据质量,建立包含感知与推理能力的双层评估体系。数据集平均音频时长7.01秒,问题平均长度12.45个词,实现任务间的均衡分布。

使用方法

MMSU采用标准化四选项单选题形式进行评估,研究者需为待测语音大语言模型提供音频片段及包含问题和选项的文本指令。为避免位置偏差,答案选项随机排列且分布均衡。评估时需使用统一优化的指令跟随提示,确保模型间对比公平性。该基准支持细粒度分析模型在语义、音系学和副语言学等维度的表现,其分层任务结构(感知/推理×语言学/副语言学)为诊断模型能力短板提供系统框架。

背景与挑战

背景概述

MMSU(Massive Multi-task Spoken Language Understanding and Reasoning Benchmark)是由香港中文大学的研究团队于2025年提出的一个大规模多任务口语语言理解与推理基准数据集。该数据集旨在填补当前语音大语言模型(SpeechLLMs)在细粒度感知和复杂推理能力评估方面的空白。MMSU包含5,000个精心设计的音频-问题-答案三元组,覆盖47个不同的任务,系统地整合了语音学、韵律学、修辞学、句法学、语义学及副语言学等多个语言学分支的理论。数据集的构建基于真实场景的语音数据,并经过语言学专家的严格审核,确保了数据的质量和代表性。MMSU为口语语言理解领域的研究提供了全面的评估框架,推动了语音交互系统的发展。

当前挑战

MMSU数据集面临的挑战主要体现在两个方面:领域问题的挑战和构建过程的挑战。在领域问题方面,口语语言理解需要模型同时处理语义内容、副语言特征(如情感、语速、音高)和音韵特征(如韵律、语调、节奏),这对现有模型的细粒度感知和复杂推理能力提出了极高要求。在构建过程中,挑战包括:1)如何系统整合多维度语言学理论设计评估任务;2)如何确保真实语音数据的多样性和代表性;3)如何通过专家审核机制保证数据质量;4)如何平衡不同任务的数据分布以进行全面评估。这些挑战使得MMSU成为当前最具综合性和理论深度的口语理解评估基准。

常用场景

经典使用场景

MMSU数据集作为大规模多任务口语语言理解与推理基准,其经典使用场景集中在评估语音大语言模型(SpeechLLMs)对自然语音中复杂声学特征和语言现象的感知与推理能力。通过涵盖47项跨语音学、韵律学、修辞学等语言学子领域的任务,该数据集为研究者提供了系统化测试模型在真实对话场景中处理非语言声音、口音识别、语调推理等核心能力的标准化平台。在语音交互系统开发中,研究人员常利用其5000个专家标注的音频-问题-答案三元组,验证模型对副语言特征(如情绪、语速)和语音学特征(如爆破音、音节结构)的联合理解性能。

解决学术问题

MMSU有效解决了当前语音理解研究中的三个关键学术问题:首先,填补了缺乏整合语言学理论的多维度口语评估基准的空白,通过系统纳入语音学、韵律学等六大语言学分支,建立了理论驱动的评估框架;其次,突破了传统语音数据集仅关注语音识别或情感检测的局限,首次实现了对语音中隐含语义(如双关语解读)、复杂推理(如基于语调的意图推断)等高层认知任务的量化评估;最重要的是,揭示了现有SpeechLLMs在副语言信息处理上的显著缺陷,如实验显示最优模型在韵律相关任务上准确率仅为53.6%,为模型优化提供了明确方向。

衍生相关工作

MMSU的发布催生了一系列重要衍生研究,包括Qwen2.5-Omni和Kimi-Audio等开源模型的优化,这些模型在数据集上的竞争性表现(60.57%准确率)推动了端到端语音理解架构的发展。基于其多任务框架,研究者进一步开发了针对特定子任务(如讽刺检测、长语音摘要)的专用模型。数据集构建方法论也影响了后续基准设计,如采用专家循环增强策略生成干扰项的方案被Dynamic-SUPERB等基准借鉴,其语言学理论驱动的任务分类体系更成为语音理解领域的新范式。

以上内容由遇见数据集搜集并总结生成