MiE-X

收藏arXiv2022-09-20 更新2024-06-21 收录

下载链接:

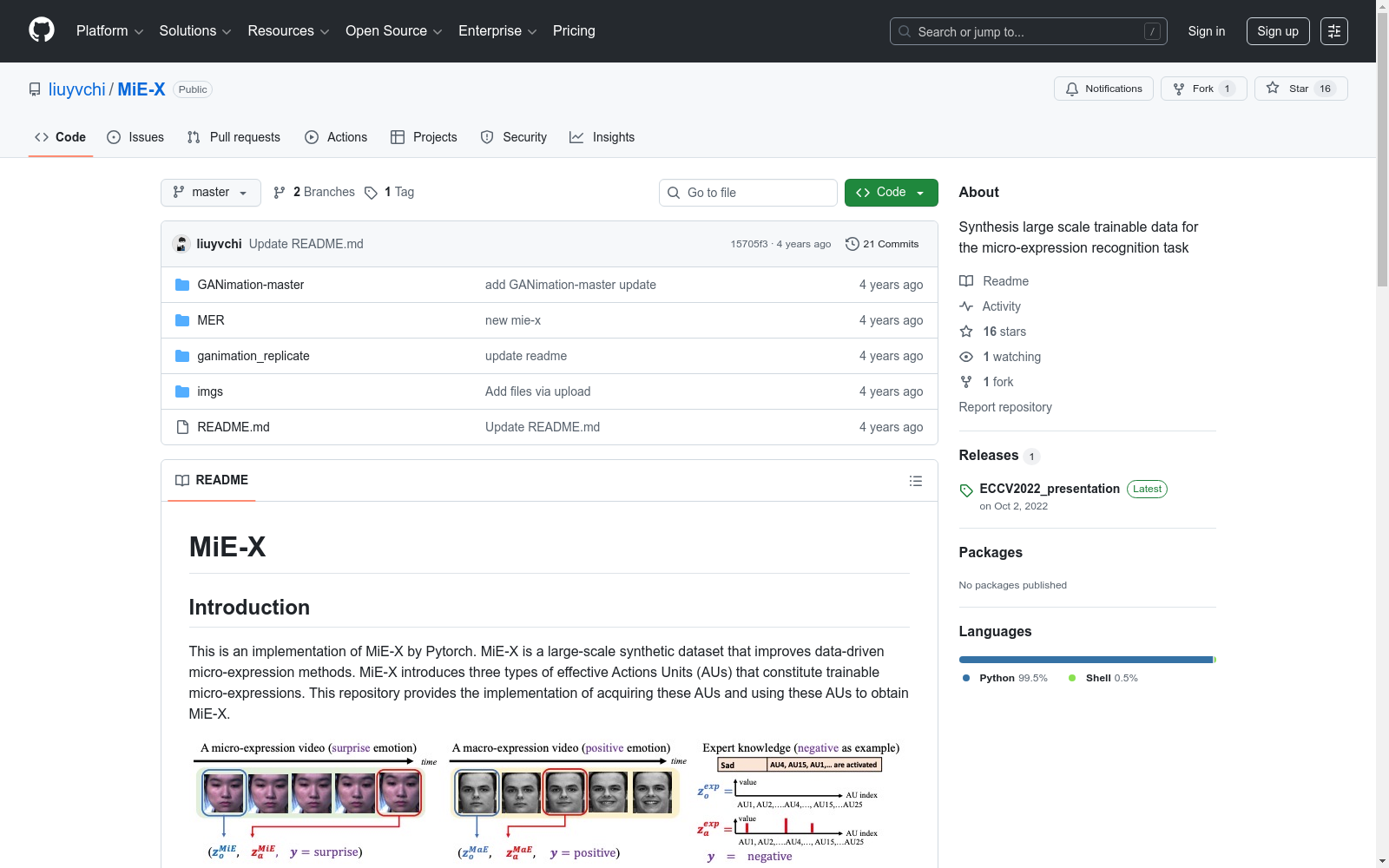

https://github.com/liuyvchi/MiE-X

下载链接

链接失效反馈资源简介:

MiE-X是由澳大利亚国立大学和清华大学合作创建的大规模微表情训练数据集,旨在解决微表情识别领域数据不足的问题。该数据集通过自动合成技术,利用真实微表情、早期宏表情视频和专家定义的情感类别之间的关系,生成高质量的训练样本。MiE-X包含45,000个样本,覆盖5,000个不同身份,每个身份有9个微表情样本,涵盖积极、消极和惊讶三种基本情感类别。该数据集的应用领域包括谎言检测、刑事司法和心理咨询等,旨在提高微表情识别算法的准确性和泛化能力。

提供机构:

澳大利亚国立大学

创建时间:

2021-12-03

AI搜集汇总

数据集介绍

构建方式

在微表情识别领域,数据稀缺长期制约模型发展。MiE-X数据集通过创新的合成协议构建,其核心在于整合三种互补的动作单元来源:从真实微表情数据中提取的AU系数、从宏表情早期帧中挖掘的AU模式,以及基于心理学专家知识定义的AU组合。该协议首先从大规模人脸数据集中随机选择面部图像作为模板,随后将上述AU系数作为生成条件,利用预训练的GANimation模型将微表情特征迁移至模板面部,最终生成包含起始帧与顶点帧的微表情样本。整个过程实现了自动化合成,有效突破了传统数据收集的成本与规模限制。

特点

MiE-X数据集最显著的特征在于其前所未有的规模与多样性。该数据集包含来自5000个不同身份的45000个样本,在样本量与身份数量上均比现有真实微表情数据集高出两个数量级。其合成样本覆盖了积极、消极与惊讶三种基本情绪类别,并通过对三种AU来源的融合,确保了面部动作模式的丰富性与互补性。这种大规模、高身份多样性的合成数据,有助于模型学习身份不变的表情特征,显著缓解了在小规模真实数据上容易出现的过拟合问题,为数据驱动的微表情识别算法提供了更稳健的训练基础。

使用方法

MiE-X数据集主要作为训练资源,用于提升微表情识别模型的性能。其使用方法灵活,可根据目标任务的标签空间是否与数据集一致而采取两种策略:当目标数据集与MiE-X具有相同的情绪标签空间时,可直接使用MiE-X训练识别模型,所得模型在真实测试集上已展现出极具竞争力的准确率。若标签空间不同,则可将MiE-X作为预训练数据集,利用其大规模合成数据学习通用的微表情特征表示,随后在目标真实数据集上进行微调。实验表明,这种预训练策略的效果优于使用ImageNet等通用数据集,能持续提升多种基准识别方法在真实微表情数据集上的性能。

背景与挑战

背景概述

微表情识别作为计算机视觉与心理学交叉领域的重要研究方向,其核心在于捕捉人类面部短暂且细微的非自主表情变化,以揭示真实情感状态。然而,该领域长期面临数据稀缺的困境,因微表情的诱发与标注均需高昂成本,导致现有数据集规模有限,通常仅包含数百样本,制约了数据驱动模型的性能提升。为突破这一瓶颈,澳大利亚国立大学与清华大学的研究团队于2022年提出了MiE-X数据集,通过创新性的合成协议,整合来自真实微表情、宏表情早期帧及专家知识的三类动作单元,利用生成模型在野外人脸图像上构建大规模可训练的微表情数据。这一工作不仅显著扩充了训练资源,还深化了对微表情计算机制的理解,为微表情识别算法的优化提供了关键支撑。

当前挑战

微表情识别领域固有的挑战在于数据收集与标注的极端困难,微表情的非自主性与瞬时性使得其在受控环境中亦难以诱发,而专业标注依赖心理学知识,且常存在歧义,导致现有真实数据集规模小、多样性不足,限制了深度学习模型的泛化能力。在MiE-X数据集的构建过程中,研究团队需克服合成协议设计的核心难题:如何确保合成的微表情具备足够的真实性与可训练性。具体而言,这涉及从有限真实数据中提取有效动作单元、从宏表情视频中挖掘与微表情相似的早期帧动作模式,以及依据专家知识定义动作单元强度与情感类别的映射关系,同时需平衡合成数据的多样性、身份不变性与表情保真度,以弥合合成数据与真实数据之间的领域差距。

常用场景

经典使用场景

在微表情识别领域,数据稀缺长期制约着深度学习模型的性能提升。MiE-X数据集通过合成大规模、可训练的微表情样本,为模型训练提供了丰富的资源。其最经典的使用场景是作为预训练数据集,提升各类微表情识别模型的泛化能力。实验表明,基于MiE-X预训练的模型在多个真实微表情测试集上均取得了显著优于传统预训练方式的识别准确率,有效缓解了因真实数据规模不足导致的过拟合问题。

实际应用

在实际应用层面,MiE-X数据集为基于微表情分析的应用系统开发提供了关键的数据支撑。在测谎、刑事司法、心理评估等对真实性要求极高的场景中,微表情识别技术依赖高精度模型。利用MiE-X进行模型训练或微调,能够显著提升系统在真实复杂环境下的鲁棒性和准确性。此外,该数据集支持开发更高效的轻量级识别模型,为嵌入式或实时分析系统的落地创造了条件,拓宽了微表情分析技术的实用边界。

衍生相关工作

MiE-X数据集的发布催生了一系列围绕合成数据有效性、跨域微表情识别及数据生成方法改进的相关研究。其构建协议启发了后续工作探索更精细的动作单元控制策略与更逼真的时序微表情视频生成。同时,以MiE-X为基准的预训练范式被广泛采纳,推动了如ApexME、Branches等识别架构的性能边界。该数据集也促进了对于“合成数据如何弥合与真实数据域间差距”这一更广泛机器学习问题的深入探讨,成为验证数据增强与域自适应算法的重要平台。

以上内容由AI搜集并总结生成