EgoCVR|视频检索数据集|视觉-语言模型数据集

收藏EgoCVR 数据集概述

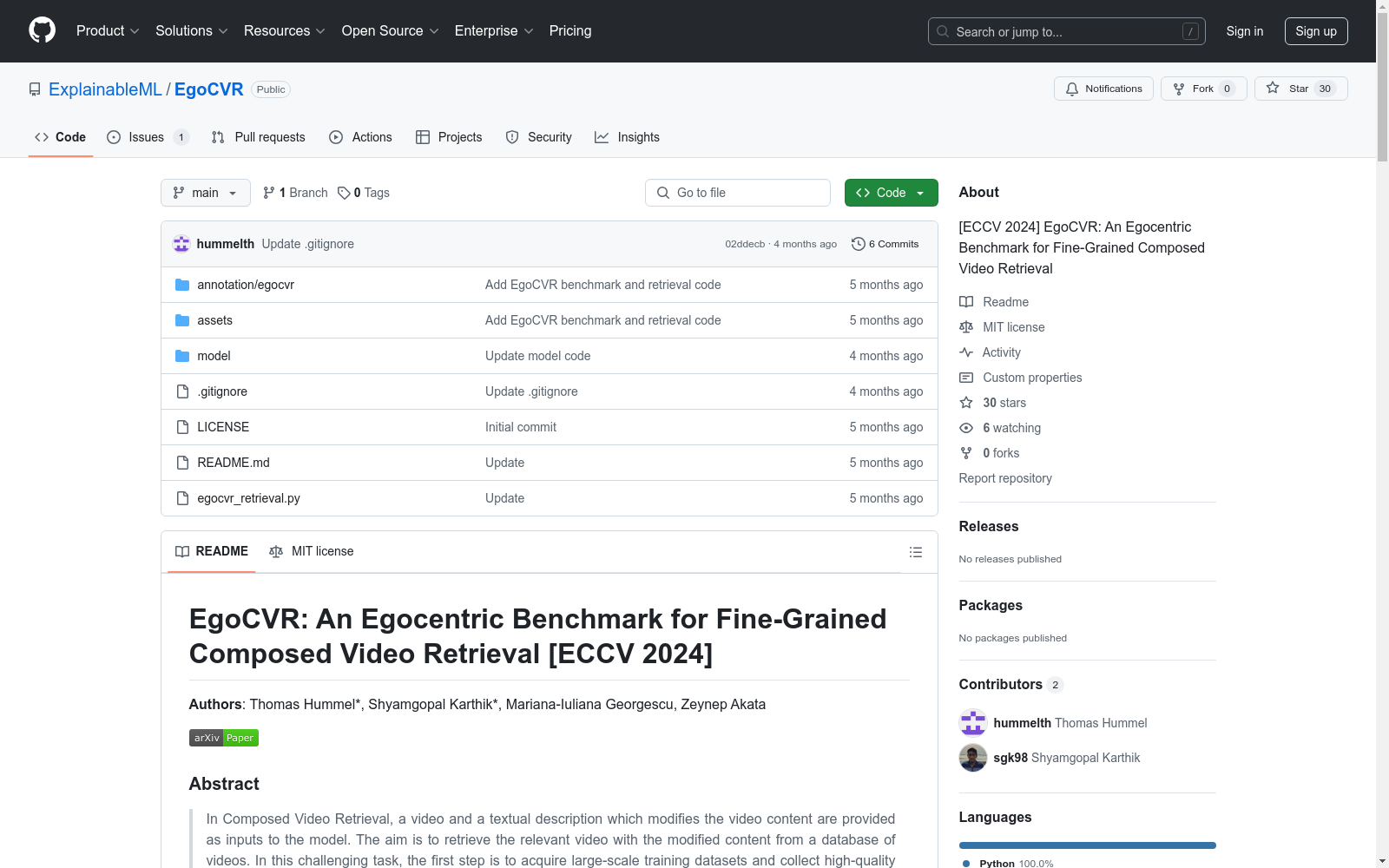

数据集简介

EgoCVR 是一个用于细粒度组合视频检索的评估基准,包含 2,295 个查询,专注于高质量的时间视频理解。数据集的视频和相应注释从 Ego4D FHO 任务 收集。

数据集结构

注释

注释文件存储在 annotation/egocvr/egocvr_annotations.csv,每行对应一个查询,包含以下列:

video_clip_id: 查询视频剪辑的唯一标识符。target_clip_ids: 目标视频剪辑的唯一标识符。video_clip_narration: 查询视频剪辑的叙述。target_clip_narration: 目标视频剪辑的叙述。instruction: 查询的视频修改指令。modified_captions: 用于检索目标视频剪辑的修改后字幕。

评估

EgoCVR 支持两种评估设置:

global: 标准组合图像/视频检索设置,画廊包含一个长视频列表。local: 本地搜索通过限制画廊仅包含来自同一视频序列的剪辑来模拟在长视频中搜索特定时刻的场景。

画廊信息存储在 annotation/egocvr/egocvr_annotations_gallery.csv,除了查询注释的列外,还包含以下列:

global_idx: 全局评估的视频画廊索引。local_idx: 本地评估的视频画廊索引。

下载信息

- 画廊信息下载链接:下载

- 视频剪辑下载链接:

- 预计算模型嵌入下载链接:

- 模型权重下载链接:

评估命令

bash

全局设置评估

python egocvr_retrieval.py --evaluation global

本地设置评估

python egocvr_retrieval.py --evaluation local

评估参数

--model: 评估的模型,可选值包括egovlpv2,languagebind,blip,clip。--modalities: 使用的查询模态,可选值包括visual,text,visual-text。--text: 使用的查询文本源,可选值包括instruction,tfcvr,gt。

示例

bash

CLIP 全局评估

python egocvr_retrieval.py --evaluation global --model clip --modalities visual-text --text instruction

BLIP 全局评估

python egocvr_retrieval.py --evaluation global --model blip --modalities visual-text --text instruction

LanguageBind 全局评估

python egocvr_retrieval.py --evaluation global --model languagebind --modalities visual-text --text instruction

BLIP_CoVR 全局评估

python egocvr_retrieval.py --evaluation global --model blip --modalities visual-text --text instruction --fusion crossattn --finetuned

LFW

人脸数据集;LFW数据集共有13233张人脸图像,每张图像均给出对应的人名,共有5749人,且绝大部分人仅有一张图片。每张图片的尺寸为250X250,绝大部分为彩色图像,但也存在少许黑白人脸图片。 URL: http://vis-www.cs.umass.edu/lfw/index.html#download

AI_Studio 收录

学生课堂行为数据集 (SCB-dataset3)

学生课堂行为数据集(SCB-dataset3)由成都东软学院创建,包含5686张图像和45578个标签,重点关注六种行为:举手、阅读、写作、使用手机、低头和趴桌。数据集覆盖从幼儿园到大学的不同场景,通过YOLOv5、YOLOv7和YOLOv8算法评估,平均精度达到80.3%。该数据集旨在为学生行为检测研究提供坚实基础,解决教育领域中学生行为数据集的缺乏问题。

arXiv 收录

UniProt

UniProt(Universal Protein Resource)是全球公认的蛋白质序列与功能信息权威数据库,由欧洲生物信息学研究所(EBI)、瑞士生物信息学研究所(SIB)和美国蛋白质信息资源中心(PIR)联合运营。该数据库以其广度和深度兼备的蛋白质信息资源闻名,整合了实验验证的高质量数据与大规模预测的自动注释内容,涵盖从分子序列、结构到功能的全面信息。UniProt核心包括注释详尽的UniProtKB知识库(分为人工校验的Swiss-Prot和自动生成的TrEMBL),以及支持高效序列聚类分析的UniRef和全局蛋白质序列归档的UniParc。其卓越的数据质量和多样化的检索工具,为基础研究和药物研发提供了无可替代的支持,成为生物学研究中不可或缺的资源。

www.uniprot.org 收录

VoxBox

VoxBox是一个大规模语音语料库,由多样化的开源数据集构建而成,用于训练文本到语音(TTS)系统。

github 收录

中国1km分辨率逐月降水量数据集(1901-2023)

该数据集为中国逐月降水量数据,空间分辨率为0.0083333°(约1km),时间为1901.1-2023.12。数据格式为NETCDF,即.nc格式。该数据集是根据CRU发布的全球0.5°气候数据集以及WorldClim发布的全球高分辨率气候数据集,通过Delta空间降尺度方案在中国降尺度生成的。并且,使用496个独立气象观测点数据进行验证,验证结果可信。本数据集包含的地理空间范围是全国主要陆地(包含港澳台地区),不含南海岛礁等区域。为了便于存储,数据均为int16型存于nc文件中,降水单位为0.1mm。 nc数据可使用ArcMAP软件打开制图; 并可用Matlab软件进行提取处理,Matlab发布了读入与存储nc文件的函数,读取函数为ncread,切换到nc文件存储文件夹,语句表达为:ncread (‘XXX.nc’,‘var’, [i j t],[leni lenj lent]),其中XXX.nc为文件名,为字符串需要’’;var是从XXX.nc中读取的变量名,为字符串需要’’;i、j、t分别为读取数据的起始行、列、时间,leni、lenj、lent i分别为在行、列、时间维度上读取的长度。这样,研究区内任何地区、任何时间段均可用此函数读取。Matlab的help里面有很多关于nc数据的命令,可查看。数据坐标系统建议使用WGS84。

国家青藏高原科学数据中心 收录