AGIEval

收藏arXiv2023-09-18 更新2024-06-21 收录

下载链接:

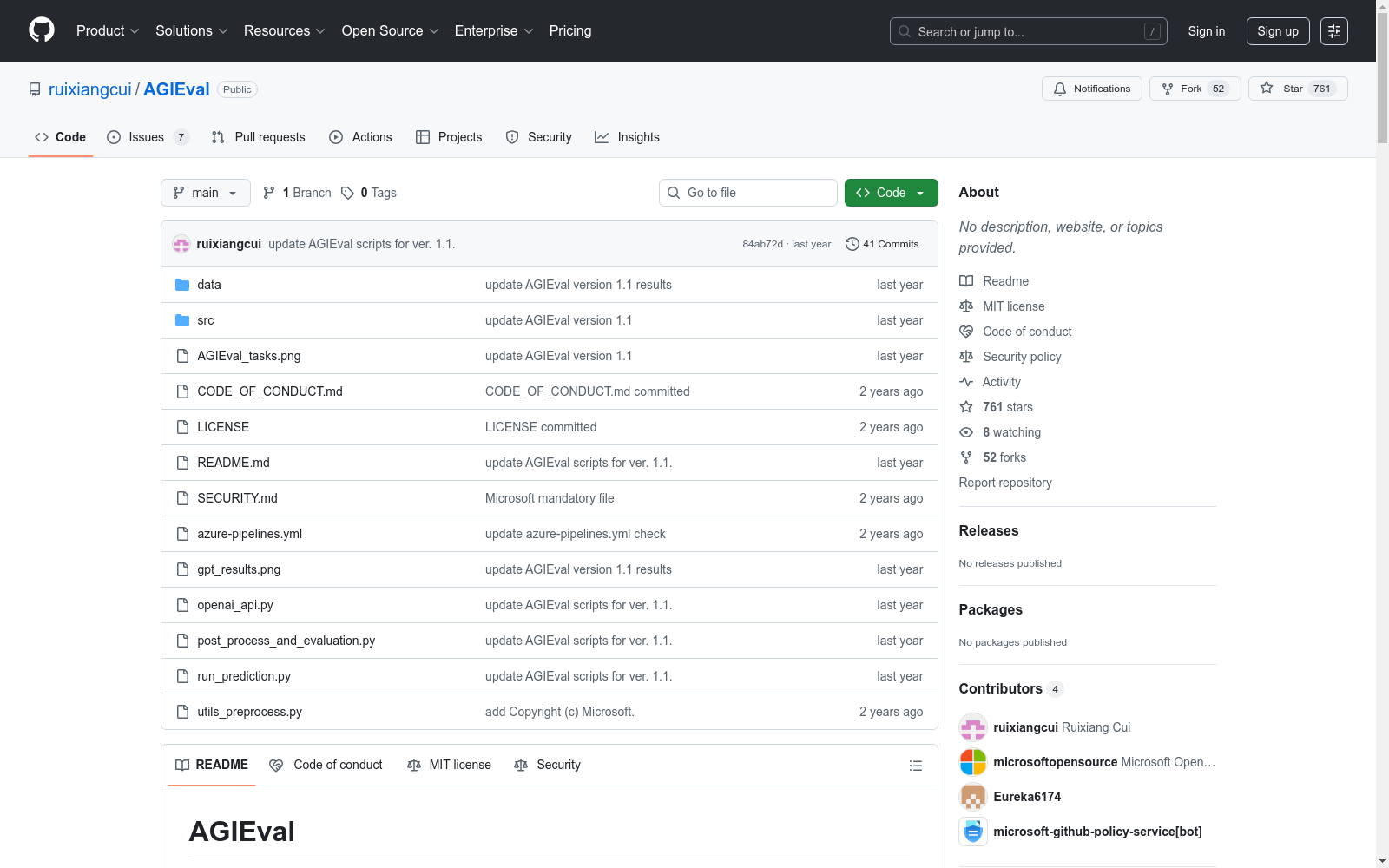

https://github.com/ruixiangcui/AGIEval

下载链接

链接失效反馈资源简介:

AGIEval数据集由微软研究团队创建,包含8062个问题,这些问题来源于官方的高标准入学考试和资格测试,如高考、法学院入学考试、数学竞赛等。数据集旨在评估基础模型在处理与人类认知和问题解决相关的任务上的能力。此外,AGIEval支持中英文双语,覆盖广泛的学科领域,如数学、物理、化学、生物、地理、历史等,以及专业领域如法律和商业。数据集的构建过程涉及从公开可用的资源中收集问题,并确保问题的质量和标准化。AGIEval的应用领域包括教育评估、专业资格认证和人工智能模型的性能测试,旨在解决模型在复杂和多变的现实世界场景中的表现问题。

The AGIEval dataset was developed by the Microsoft Research team, comprising 8,062 questions sourced from official high-stakes entrance examinations and qualification assessments, including the National College Entrance Examination (Gaokao), Law School Admission Test, mathematics competitions, and other similar tests. Its core objective is to evaluate the performance of foundation models on tasks related to human cognitive processes and problem-solving capabilities. In addition, AGIEval supports both Chinese and English languages, covering a broad spectrum of academic disciplines such as mathematics, physics, chemistry, biology, geography, and history, alongside professional fields including law and business. The dataset construction process entails collecting questions from publicly accessible resources, while rigorously ensuring the quality and standardization of all included questions. AGIEval has applications in educational assessment, professional qualification certification, and performance benchmarking of AI models, aiming to address the performance limitations of models in complex and dynamic real-world scenarios.

提供机构:

微软

创建时间:

2023-04-13

搜集汇总

数据集介绍

构建方式

AGIEval数据集的构建方式主要基于人类中心化的标准化考试,如大学入学考试、法学院入学考试、数学竞赛和律师资格考试等。这些考试涵盖了广泛的人类认知和解决问题的任务,并且每年都有数百万人参加,从而建立了官方认可的人类能力评估标准。为了确保评估的准确性和标准化,AGIEval只包含了客观问题,例如选择题和填空题,并采用了标准的分类准确率和精确匹配度作为评估指标。

特点

AGIEval数据集的特点主要体现在以下几个方面:首先,它以人类为中心,专注于评估基础模型在人类认知和解决问题的任务上的能力;其次,它涵盖了广泛的任务领域,包括语言、数学、逻辑推理和法律等;第三,它包含了中英文双语任务,能够更全面地评估模型的能力;最后,它采用了官方的、公开的和高标准的考试数据,确保了评估的准确性和可靠性。

使用方法

使用AGIEval数据集的方法主要包括以下几个步骤:首先,选择合适的基础模型进行评估,例如GPT-4、ChatGPT和Text-Davinci-003等;其次,根据实验需求,选择零样本、少样本或思维链推理等评估设置;第三,使用Azure OpenAI Service提供的API进行模型评估,并记录模型输出;最后,使用标准分类准确率和精确匹配度等指标对模型性能进行评估,并结合人工评估结果进行更深入的分析。

背景与挑战

背景概述

随着人工智能领域的发展,大型基础模型(如ChatGPT3和GPT-4)在各个领域展现出令人瞩目的通用性和适应性。然而,传统的评估基准往往基于人工数据集,无法准确反映模型在处理人类级任务时的能力。为了解决这一问题,Zhong等人于2023年9月提出了AGIEval,这是一个专门为评估基础模型在人类中心化标准化考试(如高考、LSAT、数学竞赛和律师资格考试)中的能力而设计的基准。AGIEval包含了20个与人类认知和决策相关的任务,涵盖了从高考到律师资格考试等多个领域的考试题目,并采用了双语设计,包括中文和英文。AGIEval的推出为评估基础模型在真实世界场景中的表现提供了有力的工具,并为推动人工智能向通用人工智能(AGI)方向发展提供了重要的参考。

当前挑战

尽管AGIEval在评估基础模型的能力方面取得了显著成果,但仍面临着一些挑战。首先,该基准主要关注与人类认知和决策相关的任务,而忽略了其他重要领域,如视觉、听觉和交互式任务。其次,AGIEval的评估指标主要集中在任务特定准确性上,而缺乏对模型理解、知识和推理能力的全面评估。此外,AGIEval的数据集可能存在数据污染问题,这可能会影响评估结果的可靠性。因此,未来需要进一步改进AGIEval,使其能够更全面地评估基础模型的能力,并提高其评估结果的可靠性。

常用场景

经典使用场景

AGIEval数据集旨在评估基础模型在人类水平任务上的通用能力,例如大学入学考试、法学院入学考试、数学竞赛和律师资格考试。该数据集包含20个人类中心任务,涵盖了广泛的学科和认知领域,如数学、英语、法律、历史、地理、生物、化学和物理。AGIEval数据集的经典使用场景包括评估基础模型在真实世界场景中的推理、知识、理解和计算能力,以及探索模型在不同语言和文化背景下的适应性和表现。

解决学术问题

AGIEval数据集解决了现有基准在评估基础模型通用能力方面的局限性。传统的基准主要依赖于人工数据集,可能无法准确代表人类水平的能力。AGIEval数据集使用官方、公开和高标准的人学考试和资格认证考试,旨在评估模型在人类认知和决策相关任务上的表现。通过关注与人类认知和决策相关的任务,AGIEval数据集提供了更准确和可靠的评估,有助于推动基础模型在通用人工智能(AGI)方面的发展。

衍生相关工作

AGIEval数据集的发布促进了相关研究领域的创新和发展。例如,一些研究人员使用AGIEval数据集来评估和改进基础模型在不同语言和文化背景下的表现,探索多语言推理能力的泛化问题。此外,一些研究人员还使用AGIEval数据集来开发更准确和可靠的自动评估指标,以便更好地评估基础模型在人类中心任务上的表现。AGIEval数据集的发布还促进了多模态评估框架的开发,将视觉、听觉和交互式任务纳入评估范围,以更全面地评估基础模型的能力。

以上内容由遇见数据集搜集并总结生成