【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

OCID-Grasp

收藏github2022-02-11 更新2025-02-19 收录

下载链接:

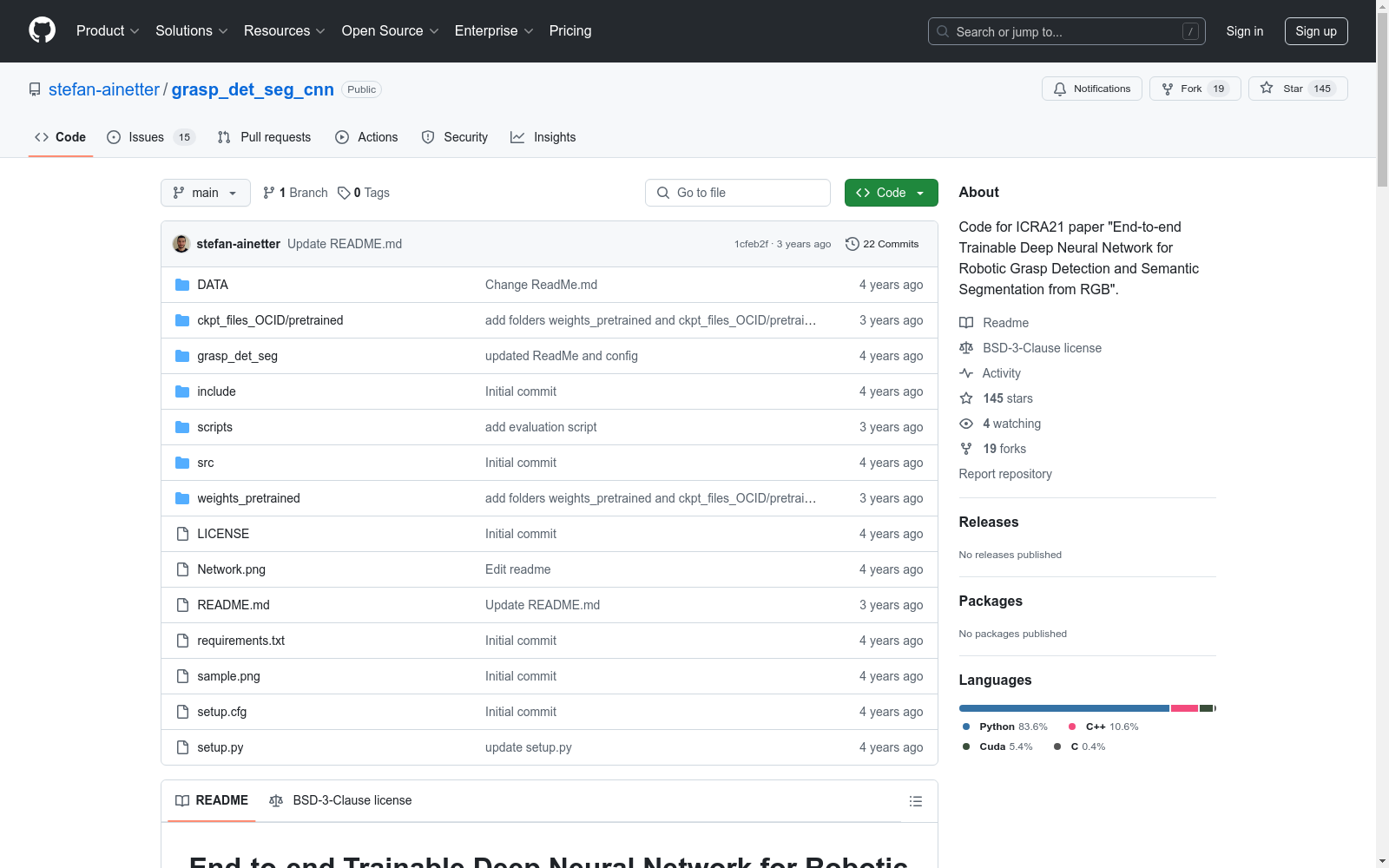

https://github.com/stefan-ainetter/grasp_det_seg_cnn

下载链接

链接失效反馈官方服务:

资源简介:

OCID Grasp 数据集是由奥地利格拉茨理工大学计算机图形与视觉研究所创建的机器人抓取检测扩展数据集。该数据集基于原有的 OCID 数据集扩展而成,包含 1763 张图像,涵盖超过 11.4k 个分割物体掩码和 75k 个手工标注的抓取候选样本。数据集中的每个物体被分类为 31 个类别之一。创建过程中,研究者对 ARID10 和 ARID20 子集进行了手工标注,为每个可抓取物体添加了有效的抓取候选样本和类别信息。OCID Grasp 数据集旨在解决复杂场景中机器人抓取检测的挑战性问题,通过结合语义分割和抓取检测,实现对特定物体的精准抓取。该数据集为机器人视觉和抓取研究提供了宝贵的资源,可用于评估和开发先进的抓取检测算法。

The OCID Grasp dataset is an extended robotic grasp detection dataset created by the Institute of Computer Graphics and Vision, Graz University of Technology, Austria. Built upon the original OCID dataset, it contains 1763 images, covering over 11.4k segmented object masks and 75k manually annotated grasp candidates. Each object in the dataset is classified into one of 31 categories. During its creation, researchers manually annotated the ARID10 and ARID20 subsets, adding valid grasp candidates and category information for each graspable object. The OCID Grasp dataset aims to address the challenging problem of robotic grasp detection in complex scenes, enabling precise grasping of specific objects by combining semantic segmentation and grasp detection. This dataset provides a valuable resource for robotic vision and grasping research, and can be used to evaluate and develop advanced grasp detection algorithms.

提供机构:

格拉茨理工大学

创建时间:

2022-02-11

原始信息汇总

数据集概述

数据集名称

End-to-end Trainable Deep Neural Network for Robotic Grasp Detection and Semantic Segmentation from RGB

数据集简介

该数据集包含了用于机器人抓取检测和语义分割的端到端可训练深度神经网络的相关代码。该代码结合了OCID_grasp数据集进行训练和测试。

数据集相关论文

- 标题:End-to-end Trainable Deep Neural Network for Robotic Grasp Detection and Semantic Segmentation from RGB

- 作者:Stefan Ainetter, Friedrich Fraundorfer

- 会议:IEEE International Conference on Robotics and Automation (ICRA)

- 页码:13452--13458

- 年份:2021

数据集要求

- CUDA 10.1

- Linux操作系统,GCC版本为7或8

- PyTorch版本v1.1.0

数据集获取

数据集描述

OCID_grasp数据集是OCID数据集的扩展,包含了1763张选定的RGB-D图像,超过11.4k个分割的对象掩膜和超过75k个手标注的抓取候选。每个对象被分类到31个对象类别中的一个。

相关工作

OCID_grasp数据集是基于OCID数据集的扩展。如果使用OCID_grasp数据集进行研究,请引用OCID数据集的相关论文。

最新研究

关于联合抓取检测和类别无关对象实例分割的方法已经在BMVC21上发表,更多信息可以在链接找到。

搜集汇总

数据集介绍

构建方式

OCID-Grasp数据集是由OCID数据集扩展而来,精选了1763张RGB-D图像,包含超过11.4k个对象遮罩和75k个手工注释的抓取候选。每个对象被分类到31个类别中的一个。该数据集的构建结合了深度学习技术,通过手工标注与自动化处理相结合的方式,确保了数据的准确性与多样性。

特点

OCID-Grasp数据集的特点在于其详尽的标注信息,包括对象遮罩和抓取候选,以及对象类别分类。它为机器人抓取任务提供了一个端到端训练的深度神经网络模型,并支持从RGB图像中进行抓取检测和语义分割。数据集遵循CC BY-NC-SA 4.0协议,保证了研究的开放性和可扩展性。

使用方法

使用OCID-Grasp数据集,用户需要准备相应的系统环境,包括CUDA、Linux操作系统和特定版本的PyTorch。数据集的准备工作包括下载解压数据集文件,配置训练参数,以及使用PyTorch的分布式启动工具进行模型的训练与测试。详细的安装和使用指南已在数据集的GitHub页面提供。

背景与挑战

背景概述

OCID-Grasp数据集是在2021年由Stefan Ainetter和Friedrich Fraundorfer在IEEE国际机器人与自动化会议上提出的一种端到端训练的深度神经网络,用于机器人抓取检测和RGB图像的语义分割。该数据集是基于OCID数据集的扩展,包含了1763张精心挑选的RGB-D图像,超过11.4k个分割的对象掩码和75k个手注释的抓取候选。每个对象被分类为31个对象类别之一。该数据集的创建旨在推动机器人抓取任务的发展,并在相关研究领域产生了显著影响。

当前挑战

该数据集在研究领域中面临的挑战主要包括:1) 抓取检测的准确性问题,如何提高模型对不同物体和不同场景下抓取的识别能力;2) 语义分割的精确度,尤其是对于复杂场景中的多物体分割;3) 数据集构建过程中的挑战,例如如何确保大量的手注释抓取候选的质量和一致性;4) 模型训练和测试的可重复性问题,需要确保在不同的计算环境下能够稳定运行并复现结果。

常用场景

经典使用场景

OCID-Grasp数据集在机器人抓取任务中具有重要的应用价值,其经典使用场景在于为机器人提供精确的抓取目标检测和语义分割能力,通过训练端到端的深度神经网络,实现对RGB图像的实时处理,从而在复杂环境中识别并抓取目标物体。

衍生相关工作

基于OCID-Grasp数据集,衍生了多项相关工作,包括但不限于深度学习在机器人抓取任务中的应用研究,以及结合RGB-D传感器的多模态抓取策略研究,这些工作进一步拓展了数据集的应用范围,推动了机器人抓取技术的进步。

数据集最近研究

最新研究方向

在机器人抓取领域,OCID-Grasp数据集的引入为深度学习模型提供了丰富的训练资源,其中包含了11.4k个对象掩膜和75k个手标注的抓取候选。近期研究中,基于OCID-Grasp数据集,研究团队提出了一种端到端的深度神经网络模型,用于从RGB图像中进行机器人抓取检测和语义分割,该模型在ICRA21上发表。此研究不仅推动了抓取检测技术的发展,而且对于提升机器人自主操作能力具有重要意义。

以上内容由遇见数据集搜集并总结生成