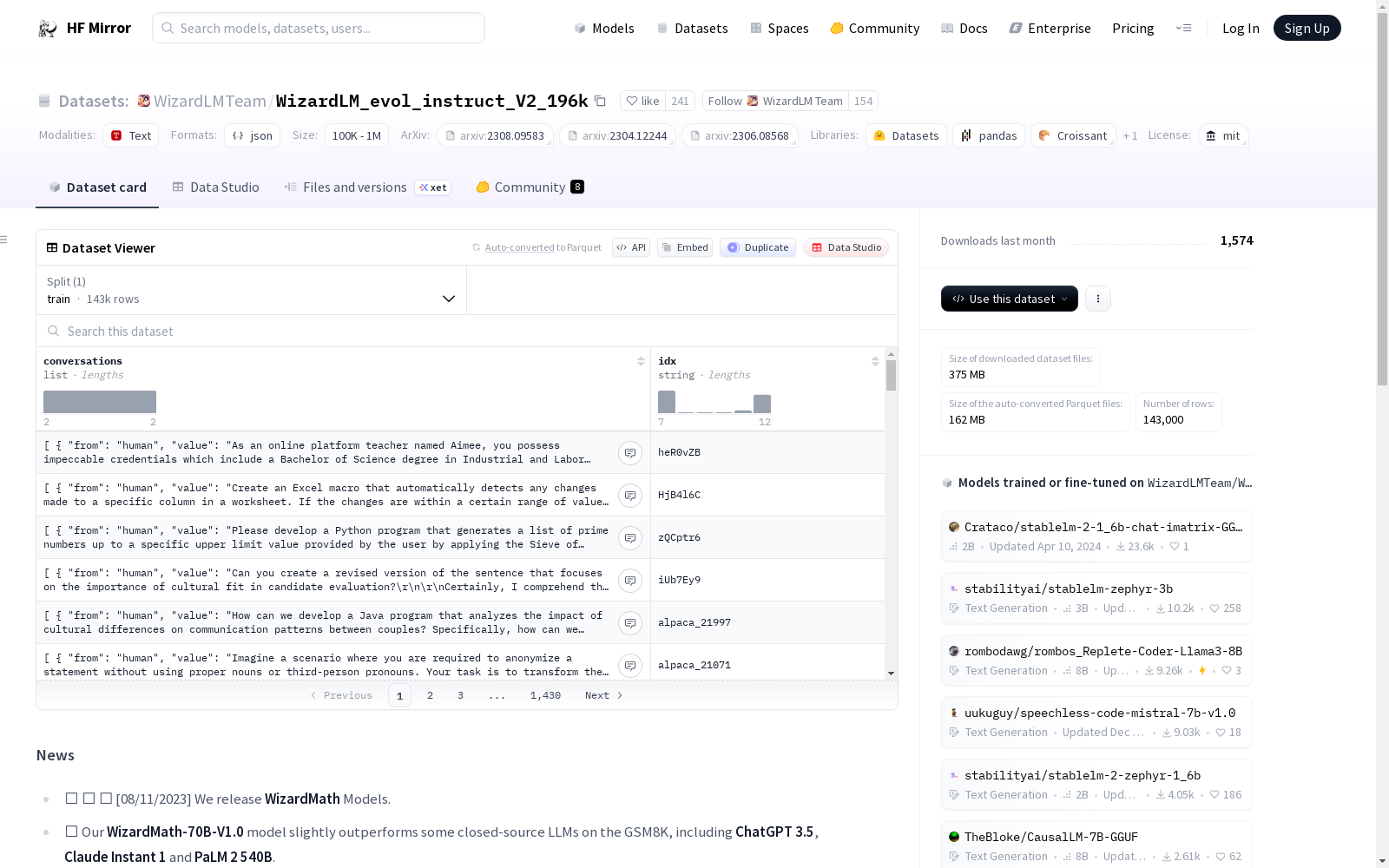

WizardLMTeam/WizardLM_evol_instruct_V2_196k

收藏Hugging Face2024-03-10 更新2024-06-15 收录

下载链接:

https://hf-mirror.com/datasets/WizardLMTeam/WizardLM_evol_instruct_V2_196k

下载链接

链接失效反馈资源简介:

该数据集包含143K混合的Alpaca和ShareGPT数据,是WizardLM模型的最新优化版本的Evol-Instruct训练数据。由于数据使用许可的原因,建议与原始ShareGPT数据集合并以获得完整的196K行数据。

提供机构:

WizardLMTeam

原始信息汇总

数据集概述

数据集内容

该数据集包含143K条混合进化的Alpaca和ShareGPT数据。这是WizardLM模型的最新优化版本的Evol-Instruct训练数据。

数据集合并

由于数据使用许可,请将原始的ShareGPT数据集与此数据集合并,以获得最终的完整数据集,该数据集将包含约196k行数据。

搜集汇总

数据集介绍

构建方式

在大型语言模型训练领域,数据质量直接决定了模型性能的上限。WizardLM_evol_instruct_V2_196k数据集的构建采用了创新的演化指令方法,其核心流程始于对Alpaca和ShareGPT原始数据的高质量混合。通过精心设计的指令演化算法,系统性地对初始指令进行深度改写与复杂化,从而生成多样且富有挑战性的新指令。这一过程模拟了人类思维从简单到复杂的演进路径,确保了生成数据的逻辑严密性与语义丰富度,最终形成了包含约14.3万条演化数据的核心集合。

特点

该数据集最显著的特征在于其通过演化指令技术所实现的高复杂性与多样性。相较于传统的指令数据集,其指令在深度、广度和创造性上均实现了显著提升,能够有效驱动模型学习处理多层次、多步骤的复杂推理任务。数据内容覆盖广泛的主题与场景,兼具Alpaca数据的结构化严谨性与ShareGPT数据的对话自然性。尤为重要的是,为满足完整使用需求,该数据集需与原始ShareGPT数据集合并,从而构成总计约19.6万条数据的完整集合,为模型训练提供了规模与质量的双重保障。

使用方法

为充分发挥该数据集在模型训练中的价值,使用者需遵循特定的数据处理流程。首要步骤是从HuggingFace平台获取本数据集与指定的原始ShareGPT数据集,并依据技术文档指导将两者进行合并,以构建出完整的训练数据集合。随后,该合并后的数据集可直接应用于大型语言模型的监督微调阶段,尤其适用于旨在提升模型复杂指令遵循与推理能力的训练场景。研究人员可根据具体目标,灵活调整数据采样策略或与其他领域数据混合,以优化模型在不同下游任务上的性能表现。

背景与挑战

背景概述

在大型语言模型蓬勃发展的时代背景下,提升指令遵循与复杂推理能力成为核心研究议题。WizardLM团队于2023年推出了WizardLM_evol_instruct_V2_196k数据集,旨在通过进化指令方法系统性地增强模型性能。该数据集构建于Alpaca与ShareGPT数据基础之上,采用迭代演化策略生成高质量、多样化的指令-响应对,其核心目标在于解决现有指令微调数据在复杂性、多样性与逻辑深度上的局限,为训练更强大的对话与推理模型提供了关键数据支撑,对推动开放领域语言模型的发展具有显著影响力。

当前挑战

该数据集致力于应对指令微调领域的关键挑战,即如何使模型不仅能理解简单指令,更能执行需要多步推理、知识融合与创造性思维的复杂任务。构建过程中的主要挑战在于设计自动化且可控的指令演化流程,以确保生成数据的质量与多样性,同时避免引入逻辑谬误或事实性错误。此外,妥善处理不同来源数据(如ShareGPT)的许可协议,并完成最终数据集的合规整合,亦是数据集构建中需克服的实际难题。

常用场景

经典使用场景

在大型语言模型(LLM)的训练与优化领域,WizardLM_evol_instruct_V2_196k数据集以其独特的进化指令机制脱颖而出。该数据集通过精心设计的指令演化策略,将初始的Alpaca与ShareGPT数据混合并迭代优化,生成了涵盖广泛主题与复杂度的多样化指令-响应对。其经典使用场景在于为模型提供高质量、多层次的监督微调数据,特别适用于提升模型在开放式对话、推理任务以及代码生成等方面的能力。研究人员利用该数据集训练出的模型,如WizardLM系列,在多项基准测试中展现了卓越的性能,成为推动指令跟随模型发展的重要基石。

解决学术问题

该数据集有效应对了指令微调数据质量与多样性不足的核心学术挑战。传统指令数据往往局限于简单或同质化的任务,导致模型泛化能力受限。WizardLM_evol_instruct_V2_196k通过进化指令技术,系统性地增加了指令的深度、复杂度和创造性,从而生成了更具挑战性的训练样本。这解决了模型在面对新颖、复杂或需要多步推理的指令时表现不佳的问题,显著提升了模型的理解深度、逻辑连贯性和任务完成度。其意义在于为指令优化研究提供了可扩展的数据生成范式,推动了开放域对话与任务型AI向更智能、更可靠的方向演进。

衍生相关工作

该数据集直接催生并支撑了WizardLM项目系列中的多项经典研究工作。核心的《WizardLM: Empowering Large Language Models to Follow Complex Instructions》论文首次系统阐述了进化指令方法,并基于此数据集训练出初代WizardLM模型。随后衍生的《WizardCoder: Empowering Code Large Language Models with Evol-Instruct》将同一数据生成理念应用于代码领域,创造了性能突出的代码生成模型。最新的《WizardMath: Reinforcing Mathematical Reasoning for Large Language Models via Evol-Instruct》则专门针对数学推理进行优化,在GSM8K和MATH基准上取得了突破性成果。这一系列工作共同构成了以进化指令为核心的技术脉络,持续推动着专业化大模型的发展。

以上内容由遇见数据集搜集并总结生成