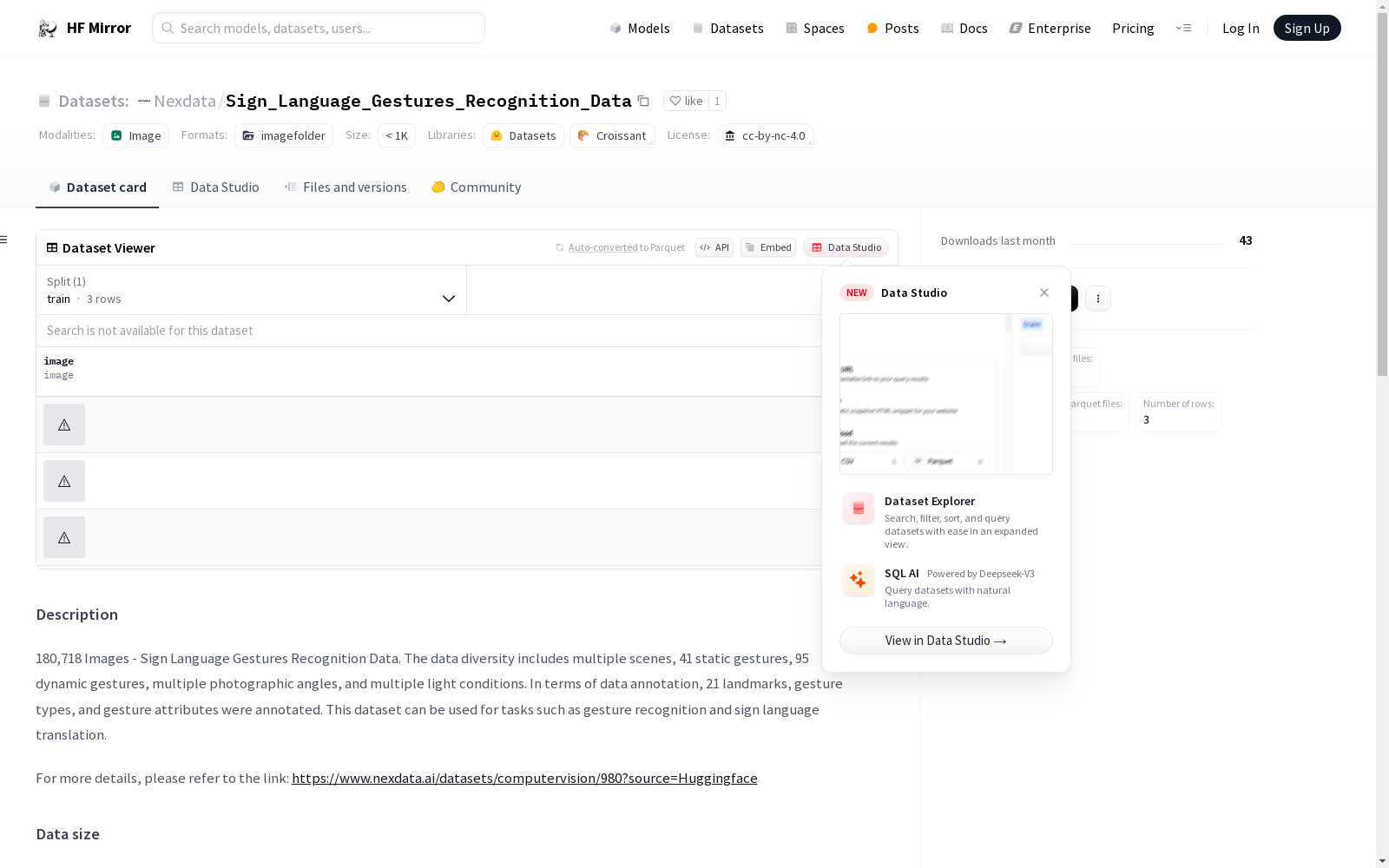

Nexdata/Sign_Language_Gestures_Recognition_Data|手语识别数据集|计算机视觉数据集

收藏数据集概述

数据集规模

- 包含180,718张图像。

数据多样性

- 涵盖多种场景。

- 包括41种静态手势和95种动态手势。

- 涉及多种拍摄角度和光照条件。

数据标注

- 标注了21个地标点。

- 标注了手势类型和手势属性。

应用领域

- 适用于手势识别和手语翻译等任务。

学生课堂行为数据集 (SCB-dataset3)

学生课堂行为数据集(SCB-dataset3)由成都东软学院创建,包含5686张图像和45578个标签,重点关注六种行为:举手、阅读、写作、使用手机、低头和趴桌。数据集覆盖从幼儿园到大学的不同场景,通过YOLOv5、YOLOv7和YOLOv8算法评估,平均精度达到80.3%。该数据集旨在为学生行为检测研究提供坚实基础,解决教育领域中学生行为数据集的缺乏问题。

arXiv 收录

HazyDet

HazyDet是由解放军工程大学等机构创建的一个大规模数据集,专门用于雾霾场景下的无人机视角物体检测。该数据集包含383,000个真实世界实例,收集自自然雾霾环境和正常场景中人工添加的雾霾效果,以模拟恶劣天气条件。数据集的创建过程结合了深度估计和大气散射模型,确保了数据的真实性和多样性。HazyDet主要应用于无人机在恶劣天气条件下的物体检测,旨在提高无人机在复杂环境中的感知能力。

arXiv 收录

MMAUD

MMAUD是一个综合的多模态反无人机数据集,用于检测、分类、跟踪和轨迹估计紧凑型商用无人机威胁。数据集包含多种传感器数据,如3D激光雷达、同步相机、毫米波雷达和音频阵列节点。

github 收录

MedDRA (Medical Dictionary for Regulatory Activities)

MedDRA是一个国际标准化的医学术语词典,主要用于药物和医疗器械的监管活动。它包含了详细的医学术语分类,如症状、诊断、治疗和药物不良反应等,广泛应用于药物安全监测、临床试验报告和监管文件中。

www.meddra.org 收录

CMNEE(Chinese Military News Event Extraction dataset)

CMNEE(Chinese Military News Event Extraction dataset)是国防科技大学、东南大学和清华大学联合构建的一个大规模的、基于文档标注的开源中文军事新闻事件抽取数据集。该数据集包含17,000份文档和29,223个事件,所有事件均基于预定义的军事领域模式人工标注,包括8种事件类型和11种论元角色。数据集构建遵循两阶段多轮次标注策略,首先通过权威网站获取军事新闻文本并预处理,然后依据触发词字典进行预标注,经领域专家审核后形成事件模式。随后,通过人工分批、迭代标注并持续修正,直至满足既定质量标准。CMNEE作为首个专注于军事领域文档级事件抽取的数据集,对推动相关研究具有显著意义。

github 收录