bigcode/humanevalpack

收藏Hugging Face2025-08-19 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/bigcode/humanevalpack

下载链接

链接失效反馈资源简介:

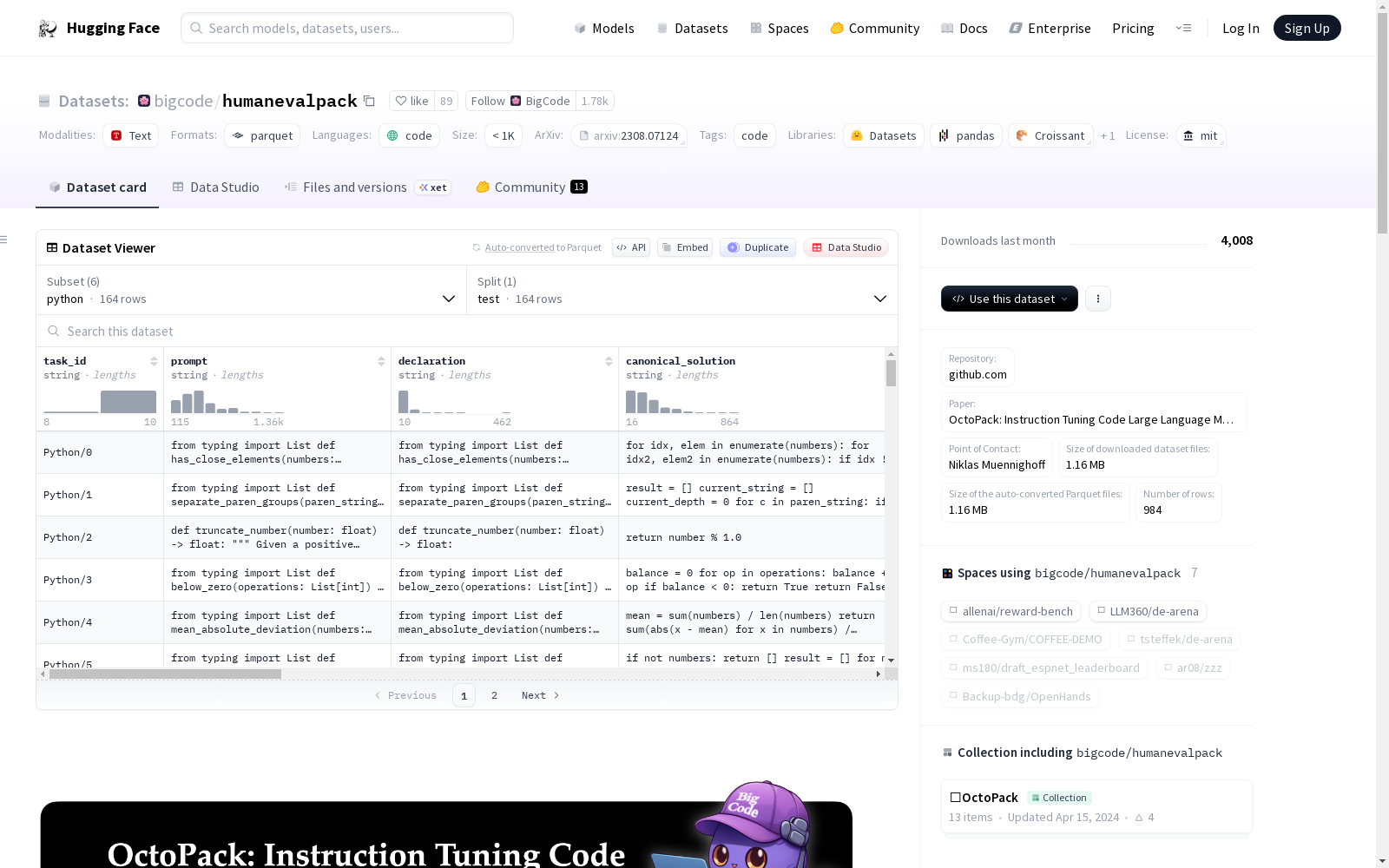

HumanEvalPack是OpenAI的HumanEval的扩展,涵盖了6种编程语言(Python、JavaScript、Java、Go、C++、Rust)和3种任务。Python部分与OpenAI的Python HumanEval完全相同,其他部分由人工翻译并进行了额外的清理。数据集的结构包括数据实例、数据字段和数据分割。数据实例展示了具体的代码示例,数据字段描述了每个字段的含义。

HumanEvalPack is an extension of OpenAI's HumanEval, covering 6 programming languages (Python, JavaScript, Java, Go, C++, Rust) and 3 types of tasks. The Python subset is exactly identical to OpenAI's Python HumanEval, while the remaining parts were manually translated and additionally cleaned up. The structure of the dataset includes data instances, data fields, and data splits. Data instances present specific code examples, and data fields describe the meaning of each field.

提供机构:

bigcode

原始信息汇总

数据集概述

数据集名称

- 名称:HumanEvalPack

- 许可证:MIT

数据集描述

数据集总结

- 概述:HumanEvalPack 是 OpenAI 的 HumanEval 数据集的扩展,涵盖了 6 种编程语言和 3 个任务。Python 部分的分割与 OpenAI 的 Python HumanEval 完全相同。其他部分的分割由人工翻译,并进行了额外的清理。

- 语言:Python, JavaScript, Java, Go, C++, Rust

数据集结构

数据实例

- 示例结构:每个数据实例包括任务ID、提示、函数声明、标准解决方案、错误解决方案、错误类型、失败症状、入口点、导入、测试设置、测试、示例测试、函数签名、文档字符串和指令。

数据字段

- 字段:任务ID、提示、函数声明、标准解决方案、错误解决方案、错误类型、失败症状、入口点、导入、测试设置、测试、示例测试、函数签名、文档字符串、指令。

数据集创建

来源数据

- 数据来源:扩展自 OpenAI 的 HumanEval,其他部分由人工翻译并清理。

注释

- 注释内容:包括错误解决方案、错误类型、失败症状等。

附加信息

许可证信息

- 许可证:MIT

引用信息

- 引用格式: bibtex @article{muennighoff2023octopack, title={OctoPack: Instruction Tuning Code Large Language Models}, author={Niklas Muennighoff and others}, journal={arXiv preprint arXiv:2308.07124}, year={2023} }

搜集汇总

数据集介绍

构建方式

HumanEvalPack数据集是在OpenAI的HumanEval数据集基础上扩展而来,涵盖了Python、JavaScript、Java、Go、C++和Rust六种编程语言。该数据集的构建过程涉及了人类专家的参与,确保了数据的质量和多样性。数据集中的每个编程任务都包括一个正确的解决方案和一个包含人为引入错误的解决方案,以及相关的单元测试和文档字符串。

特点

HumanEvalPack数据集的特点在于其多语言性和对编程任务的全面覆盖。数据集不仅包含了正确和错误的代码实现,还提供了详细的单元测试和文档字符串,有助于研究者和开发者理解和分析编程任务的复杂性和常见错误类型。此外,数据集中的任务和解决方案均经过人类的翻译和校对,确保了跨语言的一致性和准确性。

使用方法

使用HumanEvalPack数据集,研究者可以加载特定语言的子集进行编程任务的研究和模型训练。例如,加载Python子集的代码如下:

python

from datasets import load_dataset

# 选择Python子集

python_dataset = load_dataset('bigcode/humanevalpack', 'python')['test']

# 获取第一个数据实例

first_instance = python_dataset[0]

背景与挑战

背景概述

在编程领域,代码质量与安全性是至关重要的研究课题。为了评估和提升代码质量,研究人员开发了多种工具和方法。HumanEvalPack数据集应运而生,旨在提供一个跨语言的代码评估平台。该数据集由OpenAI的HumanEval扩展而来,涵盖了Python、JavaScript、Java、Go、C++和Rust六种编程语言,并针对每种语言设计了三个不同的任务。HumanEvalPack数据集的创建时间是2023年,由Niklas Muennighoff等研究人员共同完成。该数据集的核心研究问题是评估和提升代码质量,其对相关领域的影响力主要体现在为代码质量评估提供了一个跨语言的基准数据集,有助于推动代码质量评估技术的发展。

当前挑战

HumanEvalPack数据集在构建过程中遇到了一些挑战。首先,数据集的构建需要跨越不同的编程语言,这要求研究人员对每种语言都有深入的了解。其次,数据集中的代码示例需要包含正确的解决方案和包含人为引入的错误的解决方案,这需要研究人员对代码质量有深入的理解。最后,数据集中的代码示例需要包含单元测试,这需要研究人员对编程语言和测试框架有深入的了解。此外,HumanEvalPack数据集还面临着一些领域问题的挑战,例如如何有效地评估和提升代码质量,如何处理跨语言的代码评估问题等。

常用场景

经典使用场景

HumanEvalPack数据集作为代码评估的基准,为研究者和开发者提供了六种编程语言的测试案例。该数据集的经典使用场景在于对代码生成模型进行评估,特别是针对那些旨在生成代码片段或完整函数的模型。研究者可以使用这些案例来测试模型在处理实际问题时的准确性和可靠性。例如,通过比较模型生成的解决方案与数据集中的标准解决方案,可以衡量模型在特定编程任务上的表现。

实际应用

在实际应用中,HumanEvalPack数据集可以帮助开发者提高代码生成工具的准确性和可靠性。通过使用这个数据集,开发者可以测试和验证他们的代码生成模型,确保生成的代码能够满足实际需求。此外,数据集中的错误解决方案和失败症状字段可以帮助开发者识别和修复模型中可能存在的错误,从而提高代码生成工具的整体性能。

衍生相关工作

HumanEvalPack数据集的发布促进了相关领域的研究工作。基于这个数据集,研究人员可以开发新的代码生成和评估方法,进一步提高代码生成模型的性能。此外,HumanEvalPack数据集还为其他研究项目提供了宝贵的资源,例如,可以用于开发代码自动修复工具或代码质量评估工具。这些相关研究工作的开展将有助于推动代码生成和评估领域的发展,并为实际应用提供更多高效和可靠的工具。

以上内容由遇见数据集搜集并总结生成