RAVDESS|情感识别数据集|多模态数据处理数据集

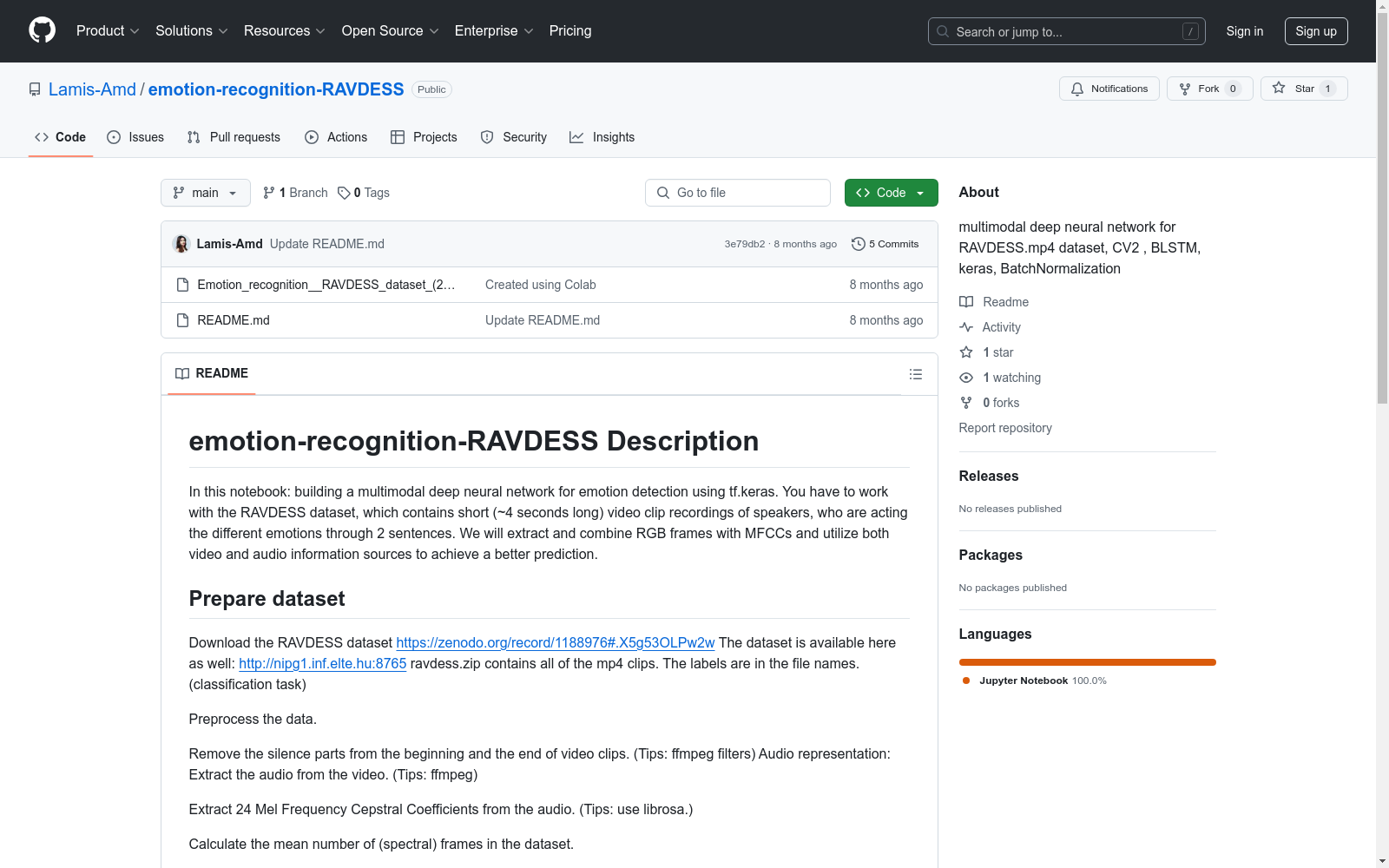

收藏数据集概述:emotion-recognition-RAVDESS

数据集内容

- 数据类型:包含短视频(约4秒),视频中演讲者通过2句话表达不同情绪。

- 数据格式:mp4视频文件,标签信息包含在文件名中。

数据预处理

- 音频处理:

- 去除视频开头和结尾的静音部分。

- 从视频中提取音频。

- 提取24个梅尔频率倒谱系数(MFCCs)。

- 标准化MFCCs,采用零均值和单位方差。

- 使用预填充统一样本长度。

- 视觉处理:

- 从图像中提取面部。

- 将面部图像大小调整为64x64。

- 对帧进行下采样以减少复杂度。

- 应用数据增强和缩放到[0, 1]。

- 数据分割:

- 将数据集分割为训练、验证和测试集,确保同一演讲者的样本不同时出现在多个集合中。

模型构建

- 音频子网络:

- BLSTM(64单元,返回序列)+ Dropout 0.5 + BLSTM(64单元)+ 密集层(128单元,ReLU)。

- 视觉子网络:

- 选择视觉骨干网络,如VGG或ResNet架构,应用帧级处理。

- 应用时间维度上的最大池化以减少复杂度。

- 模型融合:

- 将音频和视觉子网络的最终隐藏表示连接。

- 应用全连接层(256单元,ReLU),随后是另一个密集层(7单元,softmax)。

标签信息

- 类别数量:8类,但通常将第1类(中性)和第2类(平静)合并为一类。

- 标签编码:可选使用one-hot编码或保持标签在[0, 6]范围内,使用sparse_categorical_crossentropy损失。

中国区域地面气象要素驱动数据集 v2.0(1951-2024)

中国区域地面气象要素驱动数据集(China Meteorological Forcing Data,以下简称 CMFD)是为支撑中国区域陆面、水文、生态等领域研究而研发的一套高精度、高分辨率、长时间序列数据产品。本页面发布的 CMFD 2.0 包含了近地面气温、气压、比湿、全风速、向下短波辐射通量、向下长波辐射通量、降水率等气象要素,时间分辨率为 3 小时,水平空间分辨率为 0.1°,时间长度为 74 年(1951~2024 年),覆盖了 70°E~140°E,15°N~55°N 空间范围内的陆地区域。CMFD 2.0 融合了欧洲中期天气预报中心 ERA5 再分析数据与气象台站观测数据,并在辐射、降水数据产品中集成了采用人工智能技术制作的 ISCCP-ITP-CNN 和 TPHiPr 数据产品,其数据精度较 CMFD 的上一代产品有显著提升。 CMFD 历经十余年的发展,其间发布了多个重要版本。2019 年发布的 CMFD 1.6 是完全采用传统数据融合技术制作的最后一个 CMFD 版本,而本次发布的 CMFD 2.0 则是 CMFD 转向人工智能技术制作的首个版本。此版本与 1.6 版具有相同的时空分辨率和基础变量集,但在其它诸多方面存在大幅改进。除集成了采用人工智能技术制作的辐射和降水数据外,在制作 CMFD 2.0 的过程中,研发团队尽可能采用单一来源的再分析数据作为输入并引入气象台站迁址信息,显著缓解了 CMFD 1.6 中因多源数据拼接和气象台站迁址而产生的虚假气候突变。同时,CMFD 2.0 数据的时间长度从 CMFD 1.6 的 40 年大幅扩展到了 74 年,并将继续向后延伸。CMFD 2.0 的网格空间范围虽然与 CMFD 1.6 相同,但其有效数据扩展到了中国之外,能够更好地支持跨境区域研究。为方便用户使用,CMFD 2.0 还在基础变量集之外提供了若干衍生变量,包括近地面相对湿度、雨雪分离降水产品等。此外,CMFD 2.0 摒弃了 CMFD 1.6 中通过 scale_factor 和 add_offset 参数将实型数据化为整型数据的压缩技术,转而直接将实型数据压缩存储于 NetCDF4 格式文件中,从而消除了用户使用数据时进行解压换算的困扰。 本数据集原定版本号为 1.7,但鉴于本数据集从输入数据到研制技术都较上一代数据产品有了大幅的改变,故将其版本号重新定义为 2.0。

国家青藏高原科学数据中心 收录

波士顿房价数据集

波士顿房价数据集是一个经典的机器学习数据集,通常用于回归任务,尤其是房价预测。下方文档中有所有字段顺序的描述。

阿里云天池 收录

UCF-Crime

UCF-犯罪数据集是128小时视频的新型大规模第一个数据集。它包含1900年长而未修剪的真实世界监控视频,其中包含13个现实异常,包括虐待,逮捕,纵火,殴打,道路交通事故,入室盗窃,爆炸,战斗,抢劫,射击,偷窃,入店行窃和故意破坏。之所以选择这些异常,是因为它们对公共安全有重大影响。这个数据集可以用于两个任务。首先,考虑一组中的所有异常和另一组中的所有正常活动的一般异常检测。第二,用于识别13个异常活动中的每一个。

OpenDataLab 收录

学生课堂行为数据集 (SCB-dataset3)

学生课堂行为数据集(SCB-dataset3)由成都东软学院创建,包含5686张图像和45578个标签,重点关注六种行为:举手、阅读、写作、使用手机、低头和趴桌。数据集覆盖从幼儿园到大学的不同场景,通过YOLOv5、YOLOv7和YOLOv8算法评估,平均精度达到80.3%。该数据集旨在为学生行为检测研究提供坚实基础,解决教育领域中学生行为数据集的缺乏问题。

arXiv 收录

中国交通事故深度调查(CIDAS)数据集

交通事故深度调查数据通过采用科学系统方法现场调查中国道路上实际发生交通事故相关的道路环境、道路交通行为、车辆损坏、人员损伤信息,以探究碰撞事故中车损和人伤机理。目前已积累深度调查事故10000余例,单个案例信息包含人、车 、路和环境多维信息组成的3000多个字段。该数据集可作为深入分析中国道路交通事故工况特征,探索事故预防和损伤防护措施的关键数据源,为制定汽车安全法规和标准、完善汽车测评试验规程、

北方大数据交易中心 收录