THUDM/LongBench

收藏Hugging Face2024-12-18 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/THUDM/LongBench

下载链接

链接失效反馈资源简介:

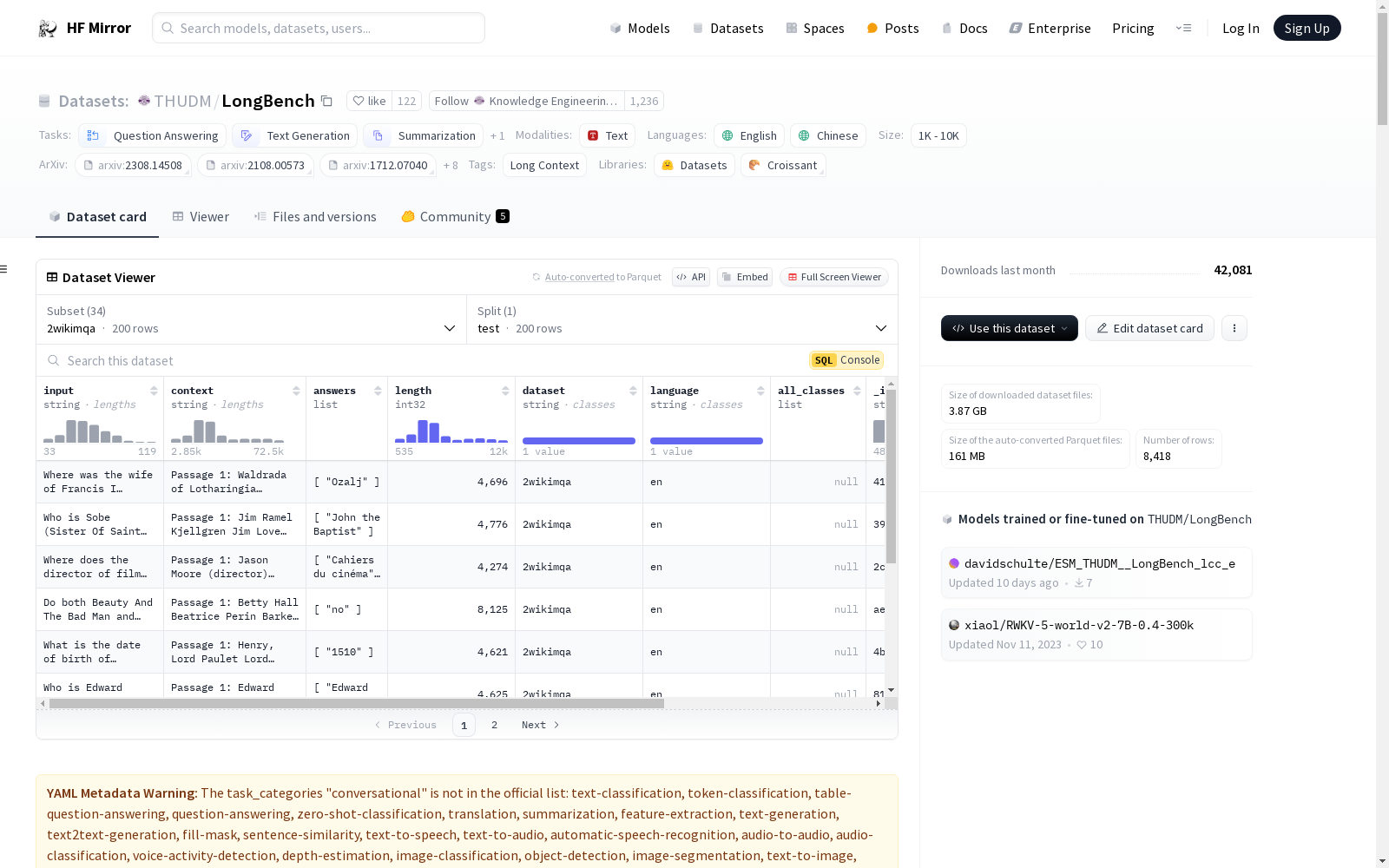

LongBench是首个用于双语、多任务和全面评估大语言模型长上下文理解能力的基准。数据集包含中英文两种语言,涵盖六大类别和二十一个不同任务,涉及单文档问答、多文档问答、摘要生成、少样本学习、合成任务和代码补全等关键长文本应用场景。数据集采用全自动评估方法,旨在以最低成本评估模型的长上下文理解能力。数据集包含14个英文任务、5个中文任务和2个代码任务,平均长度在5k到15k之间,共有4,750个测试数据。此外,还提供了LongBench-E测试集,该测试集通过均匀采样构建,长度分布更均匀,用于分析模型在不同输入长度下的性能变化。

LongBench是首个用于双语、多任务和全面评估大语言模型长上下文理解能力的基准。数据集包含中英文两种语言,涵盖六大类别和二十一个不同任务,涉及单文档问答、多文档问答、摘要生成、少样本学习、合成任务和代码补全等关键长文本应用场景。数据集采用全自动评估方法,旨在以最低成本评估模型的长上下文理解能力。数据集包含14个英文任务、5个中文任务和2个代码任务,平均长度在5k到15k之间,共有4,750个测试数据。此外,还提供了LongBench-E测试集,该测试集通过均匀采样构建,长度分布更均匀,用于分析模型在不同输入长度下的性能变化。

提供机构:

THUDM

原始信息汇总

数据集概述

LongBench 是一个双语、多任务的基准测试数据集,用于评估大型语言模型对长上下文理解的能力。该数据集包含中文和英文两种语言,涵盖了多种长文本应用场景,如单文档问答、多文档问答、摘要、少样本学习、合成任务和代码完成等。

数据集特点

- 任务类别:包括问答、文本生成、摘要、对话、文本分类等。

- 语言:支持中文和英文。

- 标签:涉及长上下文。

- 数据集大小:包含1K至10K的数据量。

数据集构成

- 任务数量:共包含21个不同的任务,分为六大类。

- 数据量:总共有4,750个测试数据。

- 平均长度:大多数任务的平均长度在5k至15k之间。

数据集使用

- 数据加载:可通过Python的

load_dataset函数从THUDM/LongBench加载数据。 - 数据格式:所有数据标准化为JSON格式,包含输入、上下文、答案、长度、数据集名称、语言等信息。

评估方法

- 自动化评估:采用自动化方法评估模型对长上下文的理解能力,以降低成本。

任务统计

- 任务类型:包括单文档问答、多文档问答、摘要、少样本学习、合成任务和代码完成等。

- 评估指标:如F1分数、Rouge-L等。

- 平均长度:根据任务不同,平均长度从1,235到22,337不等。

任务描述

- 具体任务:如HotpotQA、2WikiMultihopQA等,每个任务都有详细的描述和特定的应用场景。

LongBench-E统计

- 数据分布:在0-4k、4-8k、8k+长度区间内,数据分布均匀,用于分析模型在不同输入长度下的性能变化。

数据集详细信息

任务统计

| 任务 | 任务类型 | 评估指标 | 平均长度 | 语言 | 样本数 |

|---|---|---|---|---|---|

| HotpotQA | Multi-doc QA | F1 | 9,151 | EN | 200 |

| 2WikiMultihopQA | Multi-doc QA | F1 | 4,887 | EN | 200 |

| MuSiQue | Multi-doc QA | F1 | 11,214 | EN | 200 |

| DuReader | Multi-doc QA | Rouge-L | 15,768 | ZH | 200 |

| MultiFieldQA-en | Single-doc QA | F1 | 4,559 | EN | 150 |

| MultiFieldQA-zh | Single-doc QA | F1 | 6,701 | ZH | 200 |

| NarrativeQA | Single-doc QA | F1 | 18,409 | EN | 200 |

| Qasper | Single-doc QA | F1 | 3,619 | EN | 200 |

| GovReport | Summarization | Rouge-L | 8,734 | EN | 200 |

| QMSum | Summarization | Rouge-L | 10,614 | EN | 200 |

| MultiNews | Summarization | Rouge-L | 2,113 | EN | 200 |

| VCSUM | Summarization | Rouge-L | 15,380 | ZH | 200 |

| TriviaQA | Few shot | F1 | 8,209 | EN | 200 |

| SAMSum | Few shot | Rouge-L | 6,258 | EN | 200 |

| TREC | Few shot | Accuracy | 5,177 | EN | 200 |

| LSHT | Few shot | Accuracy | 22,337 | ZH | 200 |

| PassageRetrieval-en | Synthetic | Accuracy | 9,289 | EN | 200 |

| PassageCount | Synthetic | Accuracy | 11,141 | EN | 200 |

| PassageRetrieval-zh | Synthetic | Accuracy | 6,745 | ZH | 200 |

| LCC | Code | Edit Sim | 1,235 | Python/C#/Java | 500 |

| RepoBench-P | Code | Edit Sim | 4,206 | Python/Java | 500 |

任务描述

| 任务 | 任务描述 |

|---|---|

| HotpotQA | 基于多个给定文档回答相关问题 |

| 2WikiMultihopQA | 基于多个给定文档回答相关问题 |

| MuSiQue | 基于多个给定文档回答相关问题 |

| DuReader | 基于多个检索到的文档回答相关中文问题 |

| MultiFieldQA-en | 基于一篇长文章回答英语问题,文章来自相对多样化的领域 |

| MultiFieldQA-zh | 基于一篇长文章回答中文问题,文章来自相对多样化的领域 |

| NarrativeQA | 基于故事或剧本回答问题,包括理解重要元素如角色、情节、主题等 |

| Qasper | 基于一篇NLP研究论文回答问题,问题由NLP实践者提出和回答 |

| GovReport | 需要总结政府工作报告的摘要任务 |

| MultiNews | 需要总结多篇新闻的多文档摘要任务 |

| QMSum | 需要基于用户查询总结会议记录的摘要任务 |

| VCSUM | 需要总结中文会议记录的摘要任务 |

| SAMSum | 对话摘要任务,提供几个少样本示例 |

| TriviaQA | 单文档问答任务,提供几个少样本示例 |

| TREC | 需要对问题进行分类的分类任务,总共包含50个类别 |

| LSHT | 需要对新闻进行分类的中文分类任务,总共包含24个类别 |

| PassageRetrieval-en | 给定30篇英文维基百科段落,确定哪一段落与给定摘要相对应 |

| PassageCount | 确定给定重复文章中不同段落总数 |

| PassageRetrieval-zh | 给定几个来自C4数据集的中文段落,确定哪一段落与给定摘要相对应 |

| LCC | 给定一段长代码,预测下一段代码 |

| RepoBench-P | 给定一个GitHub仓库中的多文件代码(包括跨文件依赖),预测下一段代码 |

LongBench-E统计

| 任务 | 任务类型 | 0-4k数据量 | 4-8k数据量 | 8k+数据量 |

|---|---|---|---|---|

| HotpotQA | Multi-doc QA | 100 | 100 | 100 |

| 2WikiMultihopQA | Multi-doc QA | 100 | 100 | 100 |

| MultiFieldQA-en | Single-doc QA | 67 | 70 | 13 |

| Qasper | Single-doc QA | 100 | 100 | 24 |

| GovReport | Summarization | 100 | 100 | 100 |

| MultiNews | Summarization | 100 | 100 | 94 |

| TriviaQA | Few shot | 100 | 100 | 100 |

| SAMSum | Few shot | 100 | 100 | 100 |

| TREC | Few shot | 100 | 100 | 100 |

| PassageRetrieval-en | Synthetic | 100 | 100 | 100 |

| PassageCount | Synthetic | 100 | 100 | 100 |

| LCC | Code | 100 | 100 | 100 |

| RepoBench-P | Code | 100 | 100 | 100 |

数据集引用

@misc{bai2023longbench, title={LongBench: A Bilingual, Multitask Benchmark for Long Context Understanding}, author={Yushi Bai and Xin Lv and Jiajie Zhang and Hongchang Lyu and Jiankai Tang and Zhidian Huang and Zhengxiao Du and Xiao Liu and Aohan Zeng and Lei Hou and Yuxiao Dong and Jie Tang and Juanzi Li}, year={2023}, eprint={2308.14508}, archivePrefix={arXiv}, primaryClass={cs.CL} }

搜集汇总

数据集介绍

构建方式

LongBench数据集的构建旨在全面评估大型语言模型在长上下文理解能力上的表现。该数据集涵盖了六种主要任务类型和二十一项具体任务,包括单文档问答、多文档问答、摘要生成、少样本学习、合成任务和代码补全等。为降低模型评估成本,LongBench采用了全自动化的评估方法。数据集包括14项英语任务、5项中文任务和2项代码任务,平均任务长度在5k到15k之间,总计4750条测试数据。此外,LongBench-E通过均匀采样构建,提供了更均匀的长度分布,以便分析模型在不同输入长度下的性能变化。

特点

LongBench数据集的特点在于其双语、多任务和全面性的评估设计。它不仅涵盖了多种语言(中文和英文),还涉及多个应用场景,如问答、文本生成、摘要和对话等。数据集的平均长度范围广泛,从5k到15k不等,确保了在长上下文环境下的全面评估。此外,LongBench-E的引入进一步增强了数据集的多样性,通过均匀长度分布的测试集,提供了对模型性能在不同输入长度下的细致分析。

使用方法

使用LongBench数据集时,用户可以通过HuggingFace的datasets库加载数据。具体方法包括使用load_dataset函数,指定数据集名称和分割(如'test')。此外,用户也可以通过提供的链接下载数据文件进行本地加载。数据格式标准化,包含输入、上下文、答案、长度、数据集名称、语言、所有类别和随机ID等字段。对于自动化评估,用户可以参考LongBench的GitHub仓库获取更多详细信息。

背景与挑战

背景概述

随着自然语言处理技术的快速发展,大型语言模型在处理长文本理解任务中的能力日益受到关注。THUDM/LongBench数据集由清华大学(THU)和DM研究团队于2023年创建,旨在评估大型语言模型在长上下文理解方面的多语言和多任务能力。该数据集涵盖了包括问答、文本生成、摘要、对话和文本分类在内的六大类别,共21个不同任务,涉及单文档和多文档问答、摘要生成、少样本学习、合成任务和代码完成等关键应用场景。LongBench不仅包括14个英语任务和5个中文任务,还引入了2个代码任务,平均任务长度在5k到15k之间,总共有4,750个测试数据。这一数据集的构建旨在通过全自动化的评估方法,以最低成本衡量和评估模型对长上下文的理解能力,从而推动长文本处理技术的发展。

当前挑战

LongBench数据集在构建和应用过程中面临多项挑战。首先,长上下文场景下的模型评估成本较高,涉及人工标注成本和API调用成本。其次,数据集的多语言特性增加了处理和评估的复杂性,需要确保不同语言间的评估标准一致。此外,数据集涵盖的多任务特性要求模型具备高度的灵活性和适应性,以应对不同任务类型的需求。最后,长文本处理本身的技术挑战,如文本分割、信息提取和上下文关联等,也是该数据集需要解决的关键问题。这些挑战不仅影响数据集的构建质量,也直接关系到模型在实际应用中的表现。

常用场景

经典使用场景

LongBench数据集的经典使用场景主要集中在长文本理解能力的评估上,涵盖了多文档问答、单文档问答、摘要生成、少样本学习和代码补全等多个任务。这些任务不仅涉及英文和中文两种语言,还包含了从5k到15k字符的长度范围,为大型语言模型在处理长上下文时的表现提供了全面的评估框架。

解决学术问题

LongBench数据集解决了在长上下文理解领域中,如何有效评估和提升大型语言模型性能的学术问题。通过提供多语言、多任务的评估基准,LongBench帮助研究者们更好地理解模型在处理长文本时的表现,从而推动相关技术的进步。此外,该数据集通过自动化评估方法,降低了模型评估的成本,使得研究更加高效。

衍生相关工作

LongBench数据集的发布催生了一系列相关研究工作,包括但不限于长上下文理解模型的改进、多语言处理技术的提升以及自动化评估方法的创新。例如,研究者们基于LongBench开发了新的模型架构,以提高长文本处理的效率和准确性;同时,也有工作探讨了如何利用LongBench进行跨语言的模型评估和优化。

以上内容由遇见数据集搜集并总结生成