ChineseWebText 2.0

收藏github2024-12-02 更新2024-12-06 收录

下载链接:

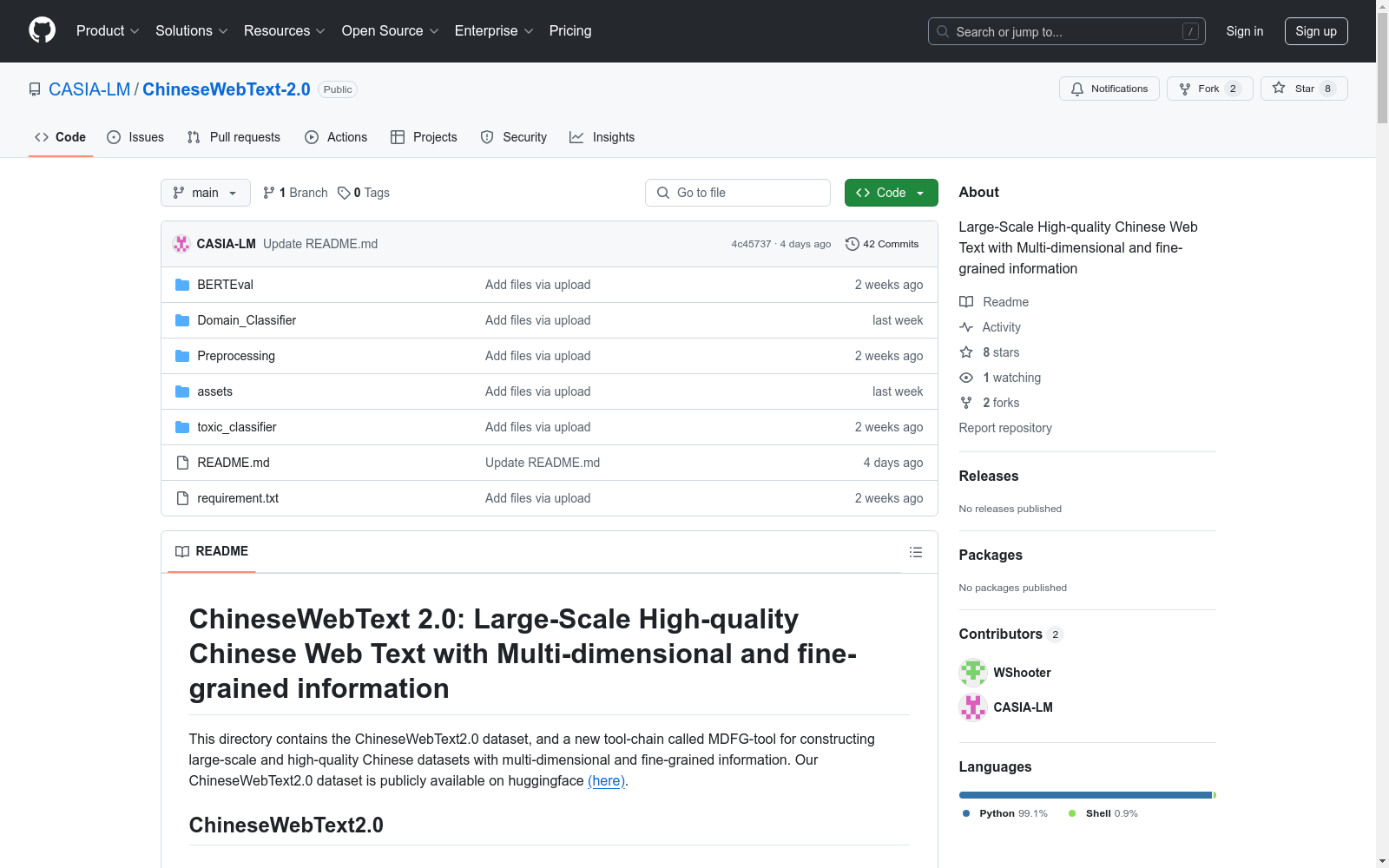

https://github.com/CASIA-LM/ChineseWebText-2.0

下载链接

链接失效反馈官方服务:

资源简介:

这是一个最新且最大的中文数据集,包含3.8 TB的数据。每个文本都附有质量评分、领域单标签和多标签、毒性分类和评分,使LLM研究人员能够根据新的质量阈值选择数据。

This is the latest and largest Chinese dataset with a total size of 3.8 TB. Each text is annotated with quality scores, domain-specific single labels and multi-label annotations, toxicity classification results, and corresponding toxicity scores, enabling LLM researchers to select data based on novel quality thresholds.

创建时间:

2024-11-19

原始信息汇总

ChineseWebText 2.0 数据集概述

数据集概览

- 数据量: 3.8 TB

- 数据类型: 中文网页文本

- 数据特征:

- 每个文本包含质量评分

- 领域单标签和多标签

- 毒性分类和评分

数据示例

json { "text": "近日,黑龙江省高校校报协会第十四届学术年会暨校报工作交流研讨会在东北农业大学举行。我校10件新闻作品喜获2项一等奖,2项二等奖,6项三等奖……", "domain": { "single_label": "news", "multi_label": ["news", "education"] }, "toxicity": { "label": 0, "score": 1.0347155694034882e-05 }, "quality_score": 0.96044921875 }

数据字段说明

- text: 文本内容

- single_label: 领域分类模型生成的高概率标签

- multi_label: 领域分类模型生成的所有概率高于阈值的标签

- label: 毒性分类模型生成的毒性标签(0表示非毒性文本,1表示毒性文本)

- score: 毒性分类模型生成的毒性评分

- quality_score: 质量评估模型生成的质量评分

数据处理工具

- MDFG-tool: 用于构建大规模高质量中文数据集的工具链

- 阶段1: 预处理

- 文本提取

- 数据长度过滤

- 字符比例过滤

- 敏感词过滤

- 内部重复过滤

- 阶段2: 质量评估

- BERTEval模型用于文本质量评分

- 阶段3: 领域评估

- 规则和模型结合的领域分类系统

- 阶段4: 毒性评估

- FastText模型用于毒性分类和评分

- 阶段1: 预处理

引用

shell @misc{zhang2024chinesewebtext20largescalehighquality, title={ChineseWebText 2.0: Large-Scale High-quality Chinese Web Text with Multi-dimensional and fine-grained information}, author={Wanyue Zhang and Ziyong Li and Wen Yang and Chunlin Leng and Yinan Bai and Qianlong Du and Chengqing Zong and Jiajun Zhang}, year={2024}, eprint={2411.19668}, archivePrefix={arXiv}, primaryClass={cs.CL}, url={https://arxiv.org/abs/2411.19668}, }

搜集汇总

数据集介绍

构建方式

ChineseWebText 2.0数据集的构建过程采用了多维度和细粒度的信息处理技术。首先,通过粗粒度过滤模块,利用规则方法清理数据,确保文本长度和敏感词符合标准。随后,使用BERT模型进行质量评估,生成质量评分,并通过设定阈值筛选高质量文本。接着,利用FastText模型进行单标签和多标签分类,同时进行毒性评估,为每段文本分配毒性评分。这一系列步骤确保了数据集的高质量和多维度信息的完整性。

使用方法

使用ChineseWebText 2.0数据集时,研究人员可以首先通过质量评分筛选出高质量的文本数据。随后,根据领域单标签和多标签进行数据分类,以满足特定的研究需求。对于毒性评估,可以通过设定毒性评分阈值来过滤或标记潜在的有害内容。数据集的详细使用方法包括预处理、质量评估、领域分类和毒性评估四个阶段,每个阶段均有相应的工具和脚本支持,确保用户能够高效地利用数据集进行研究和开发。

背景与挑战

背景概述

ChineseWebText 2.0数据集是由中国科学院自动化研究所(CASIA-LM)的研究团队于2024年发布的,旨在为大规模语言模型(LLM)研究提供高质量的中文网络文本。该数据集包含了3.8 TB的数据,每条文本都附有质量评分、领域单标签和多标签、以及毒性分类和评分。这些多维度的信息使得研究人员能够根据新的质量阈值选择数据,从而推动中文自然语言处理领域的发展。主要研究人员包括张万悦、李子勇、杨文、冷春林、白寅南、杜乾龙、宗成庆和张佳俊。

当前挑战

ChineseWebText 2.0数据集在构建过程中面临了多重挑战。首先,数据的质量控制是一个主要问题,需要通过精细的过滤和质量评估模型来确保文本的高质量。其次,领域的分类和毒性评估需要高效且准确的模型支持,以应对大规模数据的处理需求。此外,数据集的构建还涉及对文本长度、字符比例、敏感词和内部重复等多个维度的严格筛选,这些都增加了数据处理的复杂性。最后,如何在保持数据多样性的同时,确保分类和评估模型的准确性和泛化能力,也是该数据集面临的重要挑战。

常用场景

经典使用场景

ChineseWebText 2.0数据集在自然语言处理领域中被广泛用于训练大规模语言模型(LLM)。其经典使用场景包括但不限于:通过数据集中的质量评分、领域标签和毒性分类,研究人员能够筛选出高质量、无毒性的中文文本,用于模型预训练和微调,从而提升模型的语言理解和生成能力。

解决学术问题

ChineseWebText 2.0数据集解决了中文自然语言处理中的多个关键学术问题。首先,它通过提供多维度和细粒度的信息,帮助研究人员在数据筛选和处理过程中更精确地控制数据质量。其次,数据集中的毒性分类和评分机制,有助于构建更安全、更可靠的语言模型,减少模型生成有害内容的风险。此外,数据集的多标签领域分类功能,使得模型能够更好地理解和处理不同领域的文本,提升了模型的泛化能力和应用范围。

实际应用

在实际应用中,ChineseWebText 2.0数据集被广泛应用于各种中文自然语言处理任务,如机器翻译、文本摘要、情感分析和对话系统等。通过使用该数据集,企业可以训练出更准确、更智能的AI模型,提升用户体验和服务质量。例如,在智能客服系统中,使用该数据集训练的模型能够更准确地理解用户意图,提供更精准的回答和解决方案。

数据集最近研究

最新研究方向

在自然语言处理领域,ChineseWebText 2.0数据集的最新研究方向主要集中在多维度质量评估和细粒度信息提取上。该数据集不仅提供了大规模的中文网络文本,还通过质量评分、领域标签和毒性分类等多维度信息,为研究人员提供了丰富的数据资源。前沿研究中,学者们利用这些细粒度信息,开发了基于BERT和FastText的模型,以实现更精确的文本质量评估和毒性检测。此外,数据集的多标签分类功能也促进了领域特定文本的精准识别,这对于构建高质量的语言模型具有重要意义。这些研究不仅提升了模型的性能,还为中文自然语言处理技术的进一步发展奠定了坚实基础。

以上内容由遇见数据集搜集并总结生成