VoiceBench

收藏arXiv2024-10-23 更新2024-10-24 收录

下载链接:

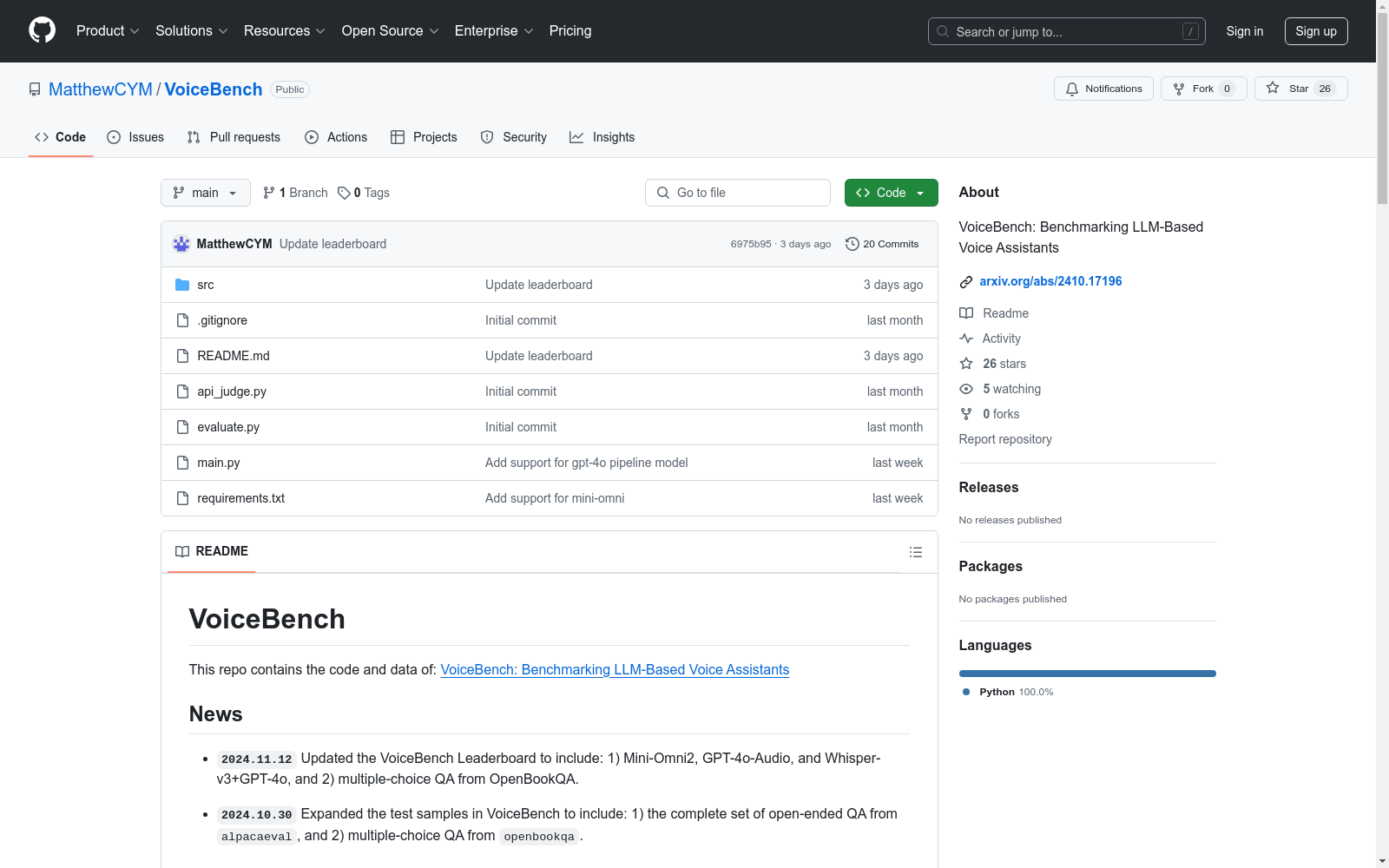

https://github.com/MatthewCYM/VoiceBench

下载链接

链接失效反馈资源简介:

VoiceBench是由新加坡国立大学开发的第一个用于多方面评估基于大型语言模型(LLM)的语音助手的基准数据集。该数据集包含1817条数据,涵盖了真实和合成的语音指令,旨在评估语音助手在不同实际场景中的表现。数据集的创建过程包括利用先进的文本到语音(TTS)和语音克隆模型生成多样化的语音样本,并模拟不同的环境效果。VoiceBench主要应用于语音助手的性能评估,旨在解决当前评估方法在复杂、真实世界场景中的不足,提供一个全面的评估框架。

VoiceBench is the first benchmark dataset developed by the National University of Singapore for multi-faceted evaluation of large language model (LLM)-based voice assistants. It contains 1817 data samples covering both real and synthetic voice commands, aiming to evaluate the performance of voice assistants across various real-world scenarios. The dataset was created by leveraging state-of-the-art text-to-speech (TTS) and voice cloning models to generate diverse speech samples, as well as simulating different environmental audio effects. Primarily applied for performance evaluation of voice assistants, VoiceBench is designed to address the shortcomings of current evaluation methods in complex real-world scenarios, providing a comprehensive evaluation framework.

提供机构:

新加坡国立大学

创建时间:

2024-10-23

原始信息汇总

VoiceBench 数据集概述

数据集描述

VoiceBench 数据集用于评估基于大型语言模型(LLM)的语音助手。该数据集托管在 Hugging Face 上,可通过 Hugging Face 的 datasets 库进行访问和集成。

数据集访问

数据集的访问链接为:VoiceBench Dataset。

数据集使用方法

在 Python 环境中加载数据集的示例如下:

python from datasets import load_dataset

加载 VoiceBench 数据集

可用的子集:alpacaeval, commoneval, sd-qa, ifeval, advbench

dataset = load_dataset("hlt-lab/voicebench", alpacaeval)

引用信息

如果在研究中使用 VoiceBench 数据集,请引用以下论文:

@article{chen2024voicebench, title={VoiceBench: Benchmarking LLM-Based Voice Assistants}, author={Chen, Yiming and Yue, Xianghu and Zhang, Chen and Gao, Xiaoxue and Tan, Robby T. and Li, Haizhou}, journal={arXiv preprint arXiv:2410.17196}, year={2024} }

AI搜集汇总

数据集介绍

构建方式

VoiceBench的构建基于对大型语言模型(LLMs)语音助手能力的全面评估需求。该数据集结合了真实和合成的语音指令,涵盖了多种现实世界中的变量,包括说话者特征、环境和内容因素。通过利用先进的文本到语音(TTS)和语音克隆模型,VoiceBench生成了具有多样说话者属性的语音样本,并模拟了不同的环境效果和内容变异。这些数据旨在评估语音助手在处理复杂语音交互时的性能,从而揭示现有模型在真实应用中的局限性。

特点

VoiceBench的显著特点在于其多维度评估框架,涵盖了语音助手的通用知识、指令遵循能力和安全性。此外,该数据集通过引入真实世界中的说话者、环境和内容变异,提供了对语音助手鲁棒性和泛化能力的深入评估。VoiceBench的独特之处还在于其结合了真实和合成语音数据,确保评估的全面性和可靠性。

使用方法

VoiceBench适用于评估和改进基于大型语言模型的语音助手。研究者和开发者可以使用该数据集来测试和优化语音助手在处理不同说话者特征、环境条件和内容变异时的表现。通过在VoiceBench上进行实验,可以识别现有模型的弱点,并为未来的研究和开发提供有价值的方向。数据集的详细使用方法和评估指标可在相关论文和GitHub仓库中找到。

背景与挑战

背景概述

随着大型语言模型(LLMs)的快速发展,如GPT-4o等模型的出现,基于LLM的语音助手在实时语音交互方面取得了显著进展,提供了比传统文本交互更优越的用户体验。然而,当前缺乏评估这些语音交互能力的基准,阻碍了基于LLM的语音助手的发展。现有的评估主要集中在自动语音识别(ASR)或使用干净语音进行一般知识评估,忽视了涉及多样化说话者特征、环境和内容因素的复杂现实场景。为解决这一问题,我们引入了VoiceBench,这是首个旨在多方面评估基于LLM的语音助手的基准。VoiceBench包括了结合上述三种关键现实变化的实际和合成语音指令。广泛的实验揭示了当前基于LLM的语音助手模型的局限性,并为该领域的未来研究和开发提供了宝贵的见解。

当前挑战

VoiceBench面临的挑战主要包括:1) 解决领域问题的挑战,如语音助手的多方面能力评估,包括一般知识、指令跟随能力和安全性测量;2) 构建过程中遇到的挑战,如生成包含多样化说话者特征、环境和内容因素的合成语音指令。此外,当前评估主要依赖于ASR或合成数据,未能充分捕捉现实世界中的复杂性,导致评估结果的局限性。VoiceBench通过设计测试案例来挑战语音助手在不同说话者风格、环境条件和内容变化下的表现,从而提供了一个更全面的评估框架。

常用场景

经典使用场景

VoiceBench数据集的经典使用场景在于评估基于大型语言模型(LLM)的语音助手在多维度上的性能。通过包含真实和合成的语音指令,VoiceBench能够全面评估语音助手在处理不同说话者特征、环境因素和内容变量时的表现。这一数据集特别适用于研究语音助手在复杂现实场景中的鲁棒性和适应性,从而推动该领域的发展。

衍生相关工作

VoiceBench数据集的引入催生了一系列相关研究工作,特别是在语音助手的鲁棒性和适应性评估方面。例如,基于VoiceBench的研究揭示了现有语音助手在处理不同说话者特征和环境条件下的性能差异,推动了针对这些问题的改进算法和模型的开发。此外,VoiceBench还激发了对语音助手安全性评估的研究,确保这些系统在面对恶意指令时的安全性。

数据集最近研究

最新研究方向

在语音助手领域,基于大型语言模型(LLMs)的进展显著提升了用户体验。然而,现有评估方法主要集中在自动语音识别(ASR)或高质量语音的通用知识评估上,忽略了多样化的说话者特征、环境和内容因素等现实场景。为了填补这一空白,VoiceBench应运而生,成为首个全面评估LLM语音助手性能的基准。VoiceBench不仅包含真实和合成的语音指令,还考虑了上述三种关键的现实变量。通过广泛的实验,VoiceBench揭示了当前语音助手模型的局限性,并为未来的研究和开发提供了宝贵的见解。

相关研究论文

- 1VoiceBench: Benchmarking LLM-Based Voice Assistants新加坡国立大学 · 2024年

以上内容由AI搜集并总结生成