EmoAva

收藏arXiv2024-12-03 更新2024-12-05 收录

下载链接:

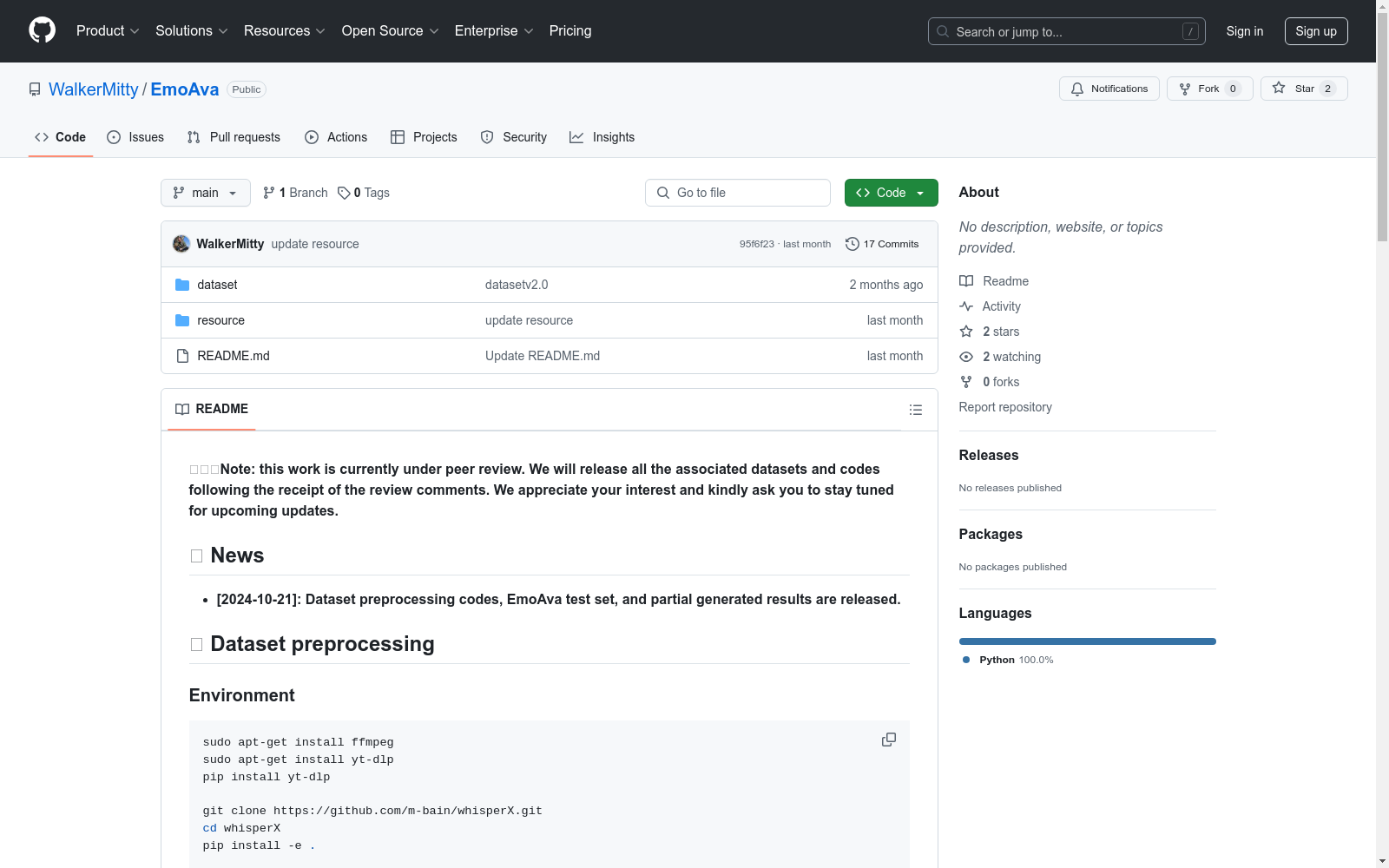

https://github.com/WalkerMitty/EmoAva

下载链接

链接失效反馈资源简介:

EmoAva是由哈尔滨工业大学(深圳)等机构创建的一个大规模、高质量的文本到3D表情映射数据集,包含15,000个实例。该数据集旨在解决从文本生成情感丰富的3D面部表情的问题,通过提供多样化的表情、情感内容一致性和表情流畅性的映射,推动情感计算和3D虚拟形象生成领域的发展。数据集的创建过程结合了先进的3D面部模型FLAME,并通过一系列评估指标确保模型的有效性。EmoAva的应用领域广泛,包括虚拟客服、在线治疗等需要情感表达的场景。

EmoAva is a large-scale and high-quality text-to-3D facial expression mapping dataset created by institutions such as Harbin Institute of Technology (Shenzhen). Comprising 15,000 instances, this dataset is designed to address the challenge of generating emotionally rich 3D facial expressions from text. By providing diverse expressions, consistent emotional content, and fluid expression mapping, it promotes the development of affective computing and 3D virtual avatar generation. The dataset's creation process integrates the advanced 3D facial model FLAME and ensures the effectiveness of the model through a series of evaluation metrics. EmoAva has a wide range of applications, including scenarios requiring emotional expression such as virtual customer service and online therapy.

提供机构:

哈尔滨工业大学(深圳)

创建时间:

2024-12-03

搜集汇总

数据集介绍

构建方式

EmoAva数据集通过大规模高质量的文本到3D表情映射构建,包含15,000个实例。数据集的构建过程包括从电视剧和电影中收集对话视频片段,使用WhisperX进行音频转录,提取对应的文本和时间戳,然后通过FaceNet进行初步筛选和手动精炼,最后使用EMOCA-v2模型从2D视频中提取3D表情向量。整个过程确保了数据的高质量和多样性。

特点

EmoAva数据集的特点在于其大规模、高质量和多样性。它包含了丰富的情感表达,涵盖了从快乐到悲伤等多种情感,且每个文本实例可以对应多种不同的面部表情,体现了表情多样性和情感内容一致性的挑战。此外,数据集的高时间分辨率确保了表情变化的连续性和流畅性。

使用方法

EmoAva数据集可用于训练和评估情感驱动的文本到3D头像生成模型。研究者可以使用该数据集来开发和测试新的算法,特别是在表情多样性、情感内容一致性和表情流畅性方面的挑战。数据集的开放性资源(https://is.gd/ynDMOY)为研究者提供了便利,促进了情感计算和3D头像生成领域的发展。

背景与挑战

背景概述

EmoAva数据集由哈尔滨工业大学(深圳)、澳门大学、新加坡南洋理工大学等机构的研究人员于2015年创建,旨在解决从文本生成情感丰富的3D面部化身(Emo3D)的核心研究问题。该数据集包含15,000个文本到3D表情映射,涵盖表情多样性、情感内容一致性和表情流畅性等关键挑战。EmoAva的引入极大地推动了情感计算和3D化身生成领域的发展,为研究人员提供了一个高质量的基准,以探索和改进情感驱动的文本到3D化身生成技术。

当前挑战

EmoAva数据集在构建过程中面临多个挑战。首先,生成情感丰富的3D面部化身需要解决表情多样性问题,即同一情感文本可能对应多种不同的面部表情。其次,情感内容一致性挑战要求生成的表情与输入文本的情感基调保持一致。最后,表情流畅性挑战涉及在对话过程中面部表情的连续和自然变化。此外,构建过程中还需克服从文本准确映射到3D表情的复杂性,确保数据集的高质量和实用性。

常用场景

经典使用场景

EmoAva数据集的经典使用场景在于情感驱动的3D面部头像生成,特别是在从文本到3D表情映射(T3DEM)和3D头像渲染(3DAR)两个关键步骤中。通过提供大规模、高质量的文本到3D表情映射数据,EmoAva数据集支持研究人员开发和验证能够生成多样化、情感一致且流畅的3D面部表情的模型。

衍生相关工作

EmoAva数据集的发布催生了多项相关研究工作,特别是在情感驱动的3D头像生成和情感计算领域。例如,Continuous Text-to-Expression Generator (CTEG)和Globally-informed Gaussian Avatar (GiGA)等模型都是基于EmoAva数据集开发的,这些模型在生成多样化和情感一致的3D表情方面取得了显著进展。

数据集最近研究

最新研究方向

在情感计算和3D虚拟形象生成领域,EmoAva数据集的最新研究方向集中在通过文本驱动生成具有丰富情感的3D面部虚拟形象。这一研究方向不仅推动了情感识别和表达的技术进步,还为虚拟现实、游戏和电影等应用场景提供了更为逼真和生动的交互体验。通过引入连续文本到表情生成器(CTEG)和全局信息高斯虚拟形象(GiGA)模型,研究人员成功解决了从文本到3D表情映射中的多样性、情感内容一致性和表情流畅性等关键挑战。这些创新不仅提升了3D虚拟形象的真实感和情感表达能力,还为情感计算领域的发展提供了新的基准和方法。

相关研究论文

- 1Towards Rich Emotions in 3D Avatars: A Text-to-3D Avatar Generation Benchmark哈尔滨工业大学(深圳) · 2024年

以上内容由遇见数据集搜集并总结生成