sensitive-word-data

收藏github2025-07-19 更新2025-07-22 收录

下载链接:

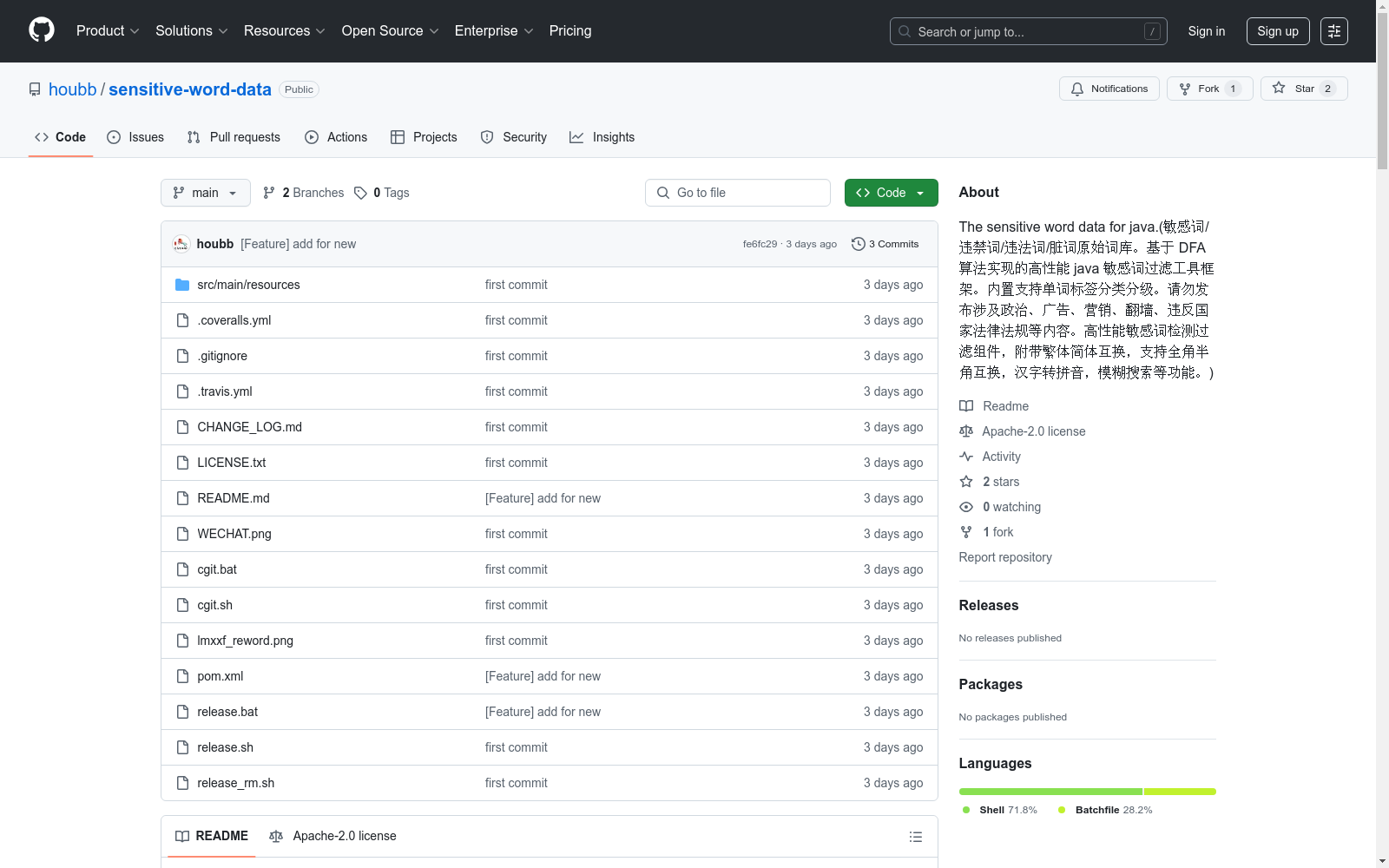

https://github.com/houbb/sensitive-word-data

下载链接

链接失效反馈官方服务:

资源简介:

敏感词/违禁词/违法词/脏词原始词库。基于 DFA 算法实现的高性能 java 敏感词过滤工具框架。内置支持单词标签分类分级。请勿发布涉及政治、广告、营销、翻墙、违反国家法律法规等内容。高性能敏感词检测过滤组件,附带繁体简体互换,支持全角半角互换,汉字转拼音,模糊搜索等功能。

Original lexicon of sensitive, prohibited, illegal and vulgar words. This is a high-performance Java sensitive word filtering tool framework implemented based on the DFA algorithm, with built-in support for word label classification and grading. Please do not publish content involving politics, advertisements, marketing, VPN circumvention, or violations of national laws and regulations. This high-performance sensitive word detection and filtering component also supports functions such as traditional and simplified Chinese conversion, full-width and half-width character conversion, Chinese character to pinyin conversion, and fuzzy search.

创建时间:

2025-07-19

原始信息汇总

sensitive-word-data 数据集概述

基本描述

- 数据集名称:sensitive-word-data

- 配套工具:与 sensitive-word 配套使用

- 许可证:Apache2

- 作者:老马

主要特性

- 词库规模:6W+ 词库,持续优化更新

- 算法性能:基于 DFA 算法,性能为 7W+ QPS

- 核心功能:

- 支持敏感词判断、返回、脱敏等操作

- 支持格式转换(全角半角互换、英文大小写互换等)

- 支持敏感词检测、邮箱检测、数字检测、网址检测等

- 支持自定义替换策略

- 支持用户自定义敏感词和白名单

- 支持数据动态更新,实时生效

- 支持敏感词标签接口+内置分类实现

- 支持跳过特殊字符

- 支持黑白名单单个新增/修改

- 支持词匹配模式的两种模式

快速开始

环境要求

- JDK1.8+

- Maven 3.x+

Maven 引入

xml <dependency> <groupId>com.github.houbb</groupId> <artifactId>sensitive-word-data</artifactId> <version>1.0.0</version> </dependency>

相关项目

| 项目名称 | 描述 |

|---|---|

| sensitive-word | 高性能敏感词核心库 |

| sensitive-word-data-admin | 敏感词控台,前后端分离 |

| sensitive | 高性能日志脱敏组件 |

| auto-log | 统一日志切面组件 |

| encryption-local | 离线加密机组件 |

| encryption | 加密机标准API+本地客户端 |

| encryption-server | 加密机服务 |

拓展阅读

- 敏感词控台实现

- 敏感词标签文件

- 多版本特性更新记录(v0.10.0 至 v0.25.1)

- 相关技术文章(DFA 算法详解、脏词分类标签等)

NLP 开源矩阵

- pinyin 汉字转拼音

- pinyin2hanzi 拼音转汉字

- segment 高性能中文分词

- opencc4j 中文繁简体转换

- nlp-hanzi-similar 汉字相似度

- word-checker 拼写检测

- sensitive-word-data 敏感词

搜集汇总

数据集介绍

构建方式

敏感词数据集sensitive-word-data的构建依托于开源社区的协作贡献,采用动态更新机制确保词库的时效性。开发者通过GitHub平台接收用户提交的PR改进建议,并整合6W+基础词库,辅以自动化校验流程保障数据质量。词库与核心算法分离的设计理念,既满足了安卓端安全检测的特殊需求,也为后续功能拓展预留了空间。数据存储采用标准化字典结构,支持黑白名单的独立维护和实时生效。

特点

该数据集以DFA算法为核心实现7W+ QPS的高性能检测,具备多维度语言处理能力。特性涵盖全角半角转换、繁简体互换等12种文本变形策略,支持IPV4、URL等格式的专项检测。独创的标签分类体系实现敏感词多维度管理,动态加载机制允许用户自定义词条即时生效。跳过特殊字符的灵活匹配策略与黑白名单独立编辑功能,大幅提升了复杂场景下的适用性。

使用方法

用户通过Maven依赖引入数据集后,可基于Fluent API进行链式调用。使用流程包含初始化敏感词引擎、加载自定义词库、配置检测策略三个主要环节。系统提供结果返回、内容脱敏等标准接口,支持通过正则表达式实现高级匹配规则。对于分布式场景,建议搭配敏感词控台组件实现可视化管理和集群同步。开发者可依据result-condition-enhance特性实现多级过滤,或通过word-tag-impl模块进行细粒度分类处理。

背景与挑战

背景概述

sensitive-word-data数据集由开发者老马于2020年创建,旨在为敏感词检测提供高效、全面的词库支持。该数据集与sensitive-word核心库配套使用,专注于解决网络内容安全中的敏感词过滤问题。其核心研究问题在于如何通过大规模词库(6W+词汇)和高效算法(DFA算法,7W+ QPS)实现精准、实时的敏感词识别与处理。该数据集在内容审核、社交平台安全等领域具有重要影响力,支持多种语言特性(如繁简体转换、全角半角互换)和动态更新功能,为开发者提供了灵活的内容过滤解决方案。

当前挑战

该数据集面临的主要挑战包括:1) 敏感词识别领域的核心难题——如何平衡检测精度与性能,尤其在处理变体词(如拼音缩写、谐音字)时需兼顾召回率与误判率;2) 构建过程中的技术挑战,包括多语言符号处理(如全角/半角字符)、动态词库更新的实时性保障,以及特殊场景下的语义理解(如上下文相关的敏感词判定);3) 数据维护的持续性挑战,需要持续跟踪网络新词、黑话变种等动态变化的敏感词汇,同时保持词库分类体系的科学性。

常用场景

经典使用场景

在自然语言处理领域,敏感词过滤是保障内容安全的重要环节。sensitive-word-data数据集凭借其6W+的高质量词库和高效的DFA算法,成为文本内容审核的经典工具。该数据集广泛应用于社交媒体、论坛评论和即时通讯等场景,能够实时检测并处理敏感信息,确保网络环境的健康与合规。其优雅的Fluent-API设计和动态更新机制,使得开发者能够轻松集成并适应不断变化的审核需求。

实际应用

实际应用中,该数据集已形成完整的内容安全解决方案。电商平台利用其过滤商品描述中的违规信息,新闻聚合网站通过API接口实现实时评论审核,移动应用开发者集成SDK保障UGC内容合规。特别在安卓生态中,独立词库设计满足了安全检测的轻量化需求,而敏感词控台系统则为企业提供了可视化的内容管理界面,极大降低了合规运营成本。

衍生相关工作

围绕该数据集已衍生出丰富的技术生态。sensitive-word核心库优化了多模式匹配算法,data-admin项目构建了分布式管理平台,相关研究论文探讨了基于标签的层次化过滤策略。在NLP矩阵中,它与拼音转换、中文分词等项目形成协同效应,共同推进了中文信息处理技术的发展。开源社区基于该数据集开展的敏感词演化分析、跨语言检测等研究,持续拓展着内容安全的技术边界。

以上内容由遇见数据集搜集并总结生成