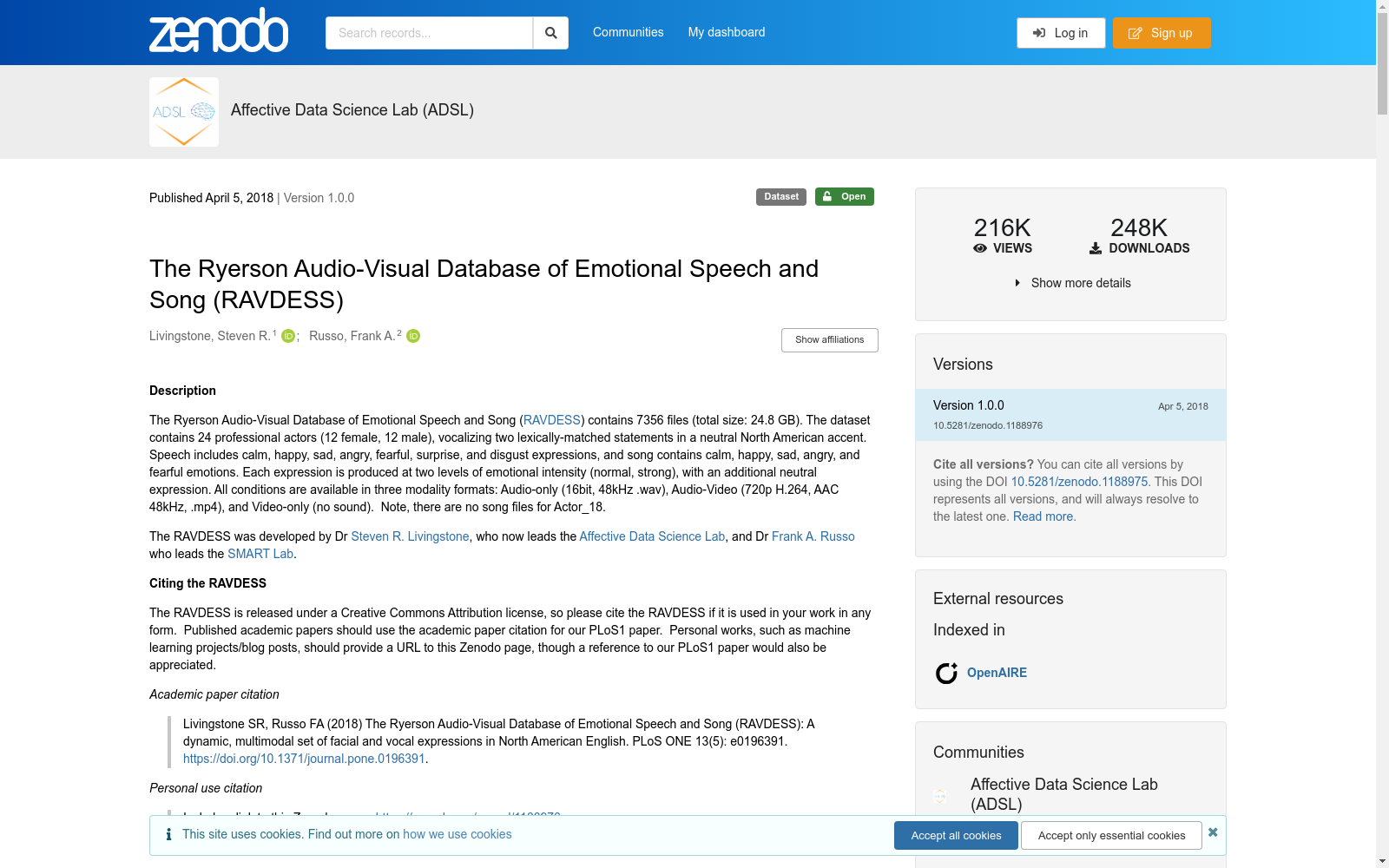

RAVDESS+ (The Ryerson Audio-Visual Database of Emotional Speech and Song+)

收藏zenodo.org2024-11-01 收录

下载链接:

https://zenodo.org/record/1188976

下载链接

链接失效反馈官方服务:

资源简介:

RAVDESS+ 是一个包含情感语音和歌曲的多模态数据集,旨在研究情感识别。数据集包括24名演员(12名女性和12名男性)的音频和视频记录,涵盖8种基本情感(愤怒、兴奋、恐惧、喜悦、悲伤、惊讶、厌恶和中性)。每个演员表演两段脚本,一段是中性情感,另一段是情感表达。数据集还包括歌曲的情感表达。

RAVDESS+ is a multimodal dataset encompassing emotional speech and song, designed for emotion recognition research. The dataset includes audio and video recordings from 24 actors (12 female and 12 male), covering 8 basic emotions: anger, excitement, fear, joy, sadness, surprise, disgust, and neutral. Each actor performs two scripted segments: one with neutral emotion, and the other expressing a targeted emotion. The dataset also includes emotional song recordings.

提供机构:

zenodo.org

搜集汇总

数据集介绍

构建方式

RAVDESS+ 数据集的构建基于多模态情感识别的需求,精心挑选了来自24位专业演员的音频和视频片段,涵盖了8种基本情感(如愤怒、悲伤、快乐等)。每个片段均经过严格标注,确保情感标签的准确性和一致性。此外,数据集还包含了歌曲和演讲两种不同的表达形式,以增强情感识别模型的泛化能力。

特点

RAVDESS+ 数据集的显著特点在于其多模态性和情感多样性。该数据集不仅提供了高质量的音频和视频数据,还通过多角度标注确保了情感表达的全面性。此外,数据集中的情感类别分布均衡,适用于各种情感识别任务。其多模态特性使得研究者可以探索音频、视频以及两者结合的情感识别方法。

使用方法

RAVDESS+ 数据集适用于多种情感识别和分析任务。研究者可以通过提取音频特征(如MFCC、频谱图等)和视频特征(如面部表情、姿态等),结合深度学习模型进行情感分类。此外,数据集的多模态特性允许研究者进行跨模态情感识别研究,探索音频和视频信息在情感识别中的互补作用。数据集的标注信息也为情感分析提供了可靠的基准。

背景与挑战

背景概述

RAVDESS+(The Ryerson Audio-Visual Database of Emotional Speech and Song+)是由加拿大多伦多大学的Ryerson Multimedia实验室于2018年创建的一个综合性情感语音和歌曲数据集。该数据集的核心研究问题在于探索和验证多模态情感识别的有效性,特别是在音频和视觉信息结合的情况下。RAVDESS+不仅包含了24位专业演员的情感表达,还涵盖了8种基本情感类别,如愤怒、悲伤、快乐等,以及中性情感。这一数据集的推出,极大地推动了情感计算和人工智能领域的发展,为研究人员提供了丰富的资源,以开发和测试基于情感识别的算法和系统。

当前挑战

尽管RAVDESS+数据集在情感识别领域具有重要意义,但其构建和应用过程中仍面临诸多挑战。首先,多模态数据的同步和融合是一个复杂的技术问题,需要精确的时间对齐和信息整合。其次,情感表达的主观性和个体差异性使得数据标注和分类变得困难,可能导致模型训练中的偏差。此外,数据集的规模和多样性虽然较大,但仍需不断扩展以涵盖更多文化背景和语言,以提高模型的泛化能力。最后,隐私和伦理问题也是数据集使用中不可忽视的挑战,特别是在涉及个人情感表达的情况下。

发展历史

创建时间与更新

RAVDESS+数据集的创建时间可追溯至2018年,由Ryerson大学的多伦多情感语音和歌曲数据库(RAVDESS)扩展而来。该数据集在2020年进行了首次更新,增加了更多的音频和视频样本,以丰富其情感表达的多样性。

重要里程碑

RAVDESS+数据集的一个重要里程碑是其对情感识别研究的深远影响。通过提供高质量的音频和视频数据,该数据集极大地推动了情感计算领域的发展。此外,RAVDESS+还促进了跨模态情感分析的研究,使得研究人员能够更准确地识别和理解人类情感。这一数据集的成功应用,不仅在学术界引起了广泛关注,也在工业界得到了实际应用,如情感驱动的用户界面设计和心理健康监测。

当前发展情况

当前,RAVDESS+数据集已成为情感识别和分析领域的标杆资源。其丰富的数据样本和多模态特性,为研究人员提供了强大的工具,以开发和验证新的情感识别算法。随着人工智能和机器学习技术的不断进步,RAVDESS+数据集的应用范围也在不断扩大,从智能助手到心理健康评估,其影响力日益显著。此外,该数据集的开放获取政策,促进了全球范围内的合作与创新,进一步推动了相关领域的技术进步和应用普及。

发展历程

- RAVDESS+数据集首次发表,由加拿大瑞尔森大学的研究团队创建,旨在提供一个标准化的音频和视频情感表达数据库。

- RAVDESS+数据集首次应用于情感识别和语音处理领域的研究,为研究人员提供了一个丰富的资源库。

- RAVDESS+数据集在多个国际会议上被广泛引用,成为情感计算和人工智能领域的重要基准数据集。

- RAVDESS+数据集的扩展版本发布,增加了更多的情感类别和多样化的语音样本,进一步丰富了数据集的内容。

常用场景

经典使用场景

在情感计算领域,RAVDESS+数据集被广泛用于情感识别和分析的研究。该数据集包含了来自24位演员的1440段音频和视频样本,涵盖了八种基本情感(如愤怒、悲伤、快乐等)。研究者利用这些样本训练和测试情感识别模型,以提高模型在不同情感状态下的识别准确率。

解决学术问题

RAVDESS+数据集解决了情感计算领域中情感数据稀缺和多样性不足的问题。通过提供多模态的情感表达数据,该数据集促进了跨模态情感识别算法的发展,为研究者提供了丰富的实验材料。其意义在于推动了情感计算技术的进步,为理解和模拟人类情感提供了科学依据。

衍生相关工作

基于RAVDESS+数据集,研究者们开发了多种情感识别算法和模型,如基于深度学习的情感分类器和多模态融合技术。这些工作不仅提升了情感识别的准确性,还推动了相关领域的技术进步。例如,一些研究利用该数据集进行跨文化情感识别研究,探讨不同文化背景下情感表达的差异。

以上内容由遇见数据集搜集并总结生成