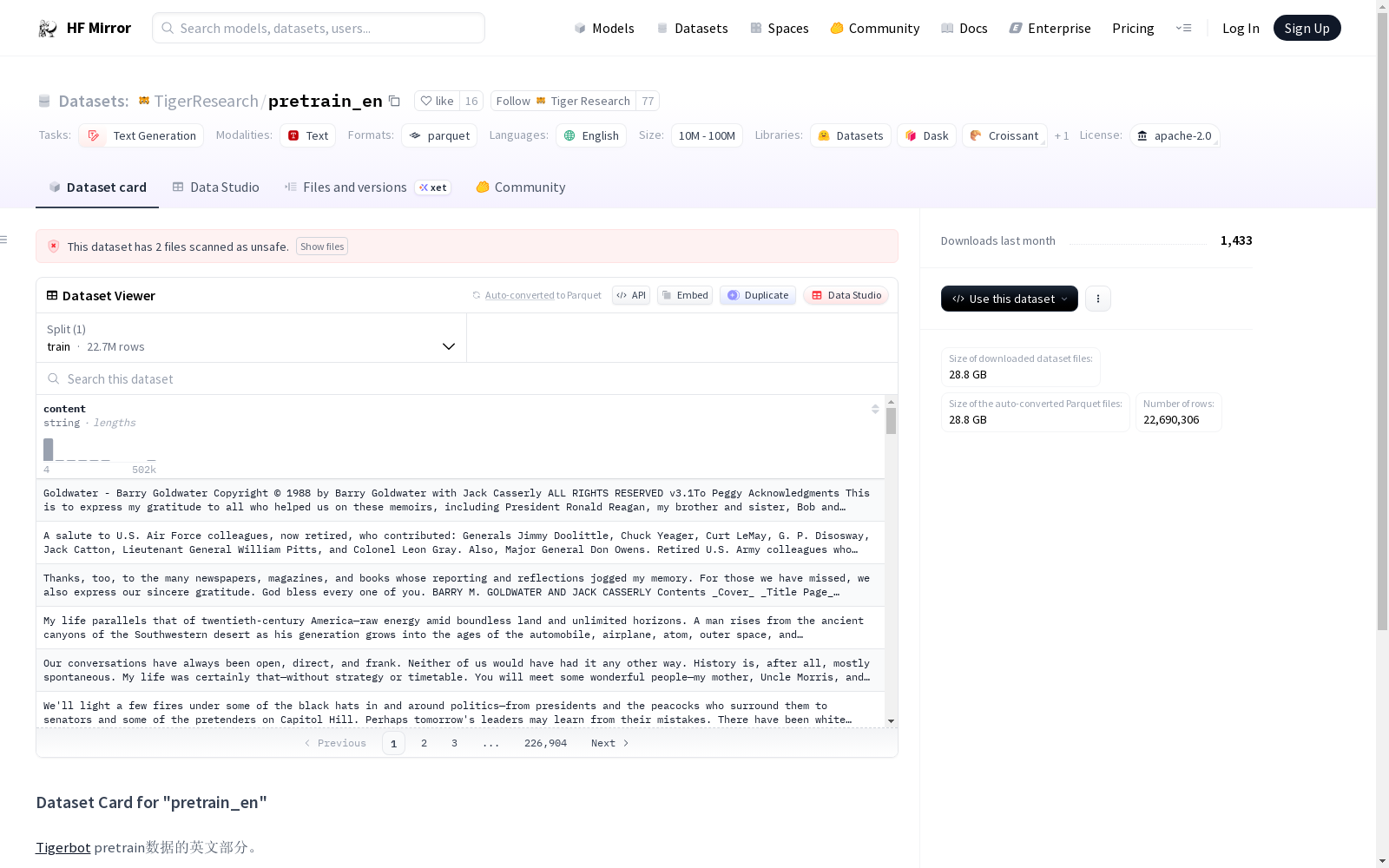

TigerResearch/pretrain_en

收藏Hugging Face2023-05-30 更新2024-03-04 收录

下载链接:

https://hf-mirror.com/datasets/TigerResearch/pretrain_en

下载链接

链接失效反馈资源简介:

这是Tigerbot预训练数据的英文部分。

这是Tigerbot预训练数据的英文部分。

提供机构:

TigerResearch

原始信息汇总

数据集概述

数据集信息

-

特征:

- 名称: content

- 数据类型: string

-

数据分割:

- 名称: train

- 字节数: 48490123196

- 样本数: 22690306

-

下载大小: 5070161762

-

数据集大小: 48490123196

-

许可证: apache-2.0

-

任务类别:

- text-generation

-

语言:

- en

-

大小类别:

- 10M<n<100M

搜集汇总

数据集介绍

构建方式

在自然语言处理领域,大规模文本数据集的构建对于模型的预训练至关重要。TigerResearch/pretrain_en数据集的构建采用了集成大量英文文本的方式,其中包含22690306条训练样本,总大小约为48.49亿字节。数据集通过广泛收集互联网上的英文文本资源,涵盖了丰富的语言表达和知识内容,为模型的预训练提供了坚实基础。

特点

该数据集的特点在于其文本的多样性和大规模性。它不仅包含了大量的文本数据,保证了模型的泛化能力,而且遵循apache-2.0许可,便于研究者在遵守许可协议的前提下自由使用。此外,数据集适用于文本生成等任务,对于提升模型在英文处理上的表现具有显著效果。

使用方法

使用TigerResearch/pretrain_en数据集相当便捷。用户仅需通过datasets库的load_dataset函数,即可轻松加载整个数据集。加载后,数据集被分为训练集,便于研究者直接用于模型的预训练任务。这种高效的数据集成方式,大大降低了数据处理的复杂性,提高了研究效率。

背景与挑战

背景概述

在自然语言处理领域,预训练模型的研究与应用日益广泛,成为推动该领域发展的重要力量。TigerResearch/pretrain_en数据集,作为Tigerbot项目的一部分,由TigerResearch团队创建于近年,旨在为英文预训练模型提供丰富的文本资源。该数据集汇集了大量英文文本,其规模之巨,足以支撑深度学习模型在多种NLP任务上进行有效训练。主要研究人员来自于TigerResearch团队,该数据集的推出,为英文文本生成等任务提供了强有力的数据支撑,对相关领域的研究产生了深远影响。

当前挑战

尽管TigerResearch/pretrain_en数据集在文本生成等任务中表现出色,但其构建过程中亦面临诸多挑战。首先,数据集的规模巨大,如何在保证数据质量的同时,高效地进行数据清洗和预处理,是一大难题。其次,数据集的多样性是保证模型泛化能力的关键,而确保数据覆盖广泛的话题和风格,避免偏见和误导信息的出现,同样是一项艰巨的任务。此外,数据集在遵循apache-2.0协议的同时,还需兼顾数据隐私和版权问题,这对于数据集的构建与维护提出了更高的要求。

常用场景

经典使用场景

在自然语言处理领域,TigerResearch/pretrain_en数据集常被用于文本生成任务。其丰富的文本资源为模型提供了充足的训练素材,使得基于该数据集训练的模型能够生成流畅且语义丰富的文本。

实际应用

在实际应用中,基于TigerResearch/pretrain_en数据集训练的模型可被广泛应用于机器翻译、文本摘要、问答系统等场景,显著提升了相关任务的处理效率和准确度。

衍生相关工作

该数据集催生了众多相关研究工作,包括但不限于对预训练模型的改进、跨语言模型的构建以及特定领域文本生成任务的研究,为自然语言处理领域的学术研究贡献了新的视角和方法。

以上内容由遇见数据集搜集并总结生成