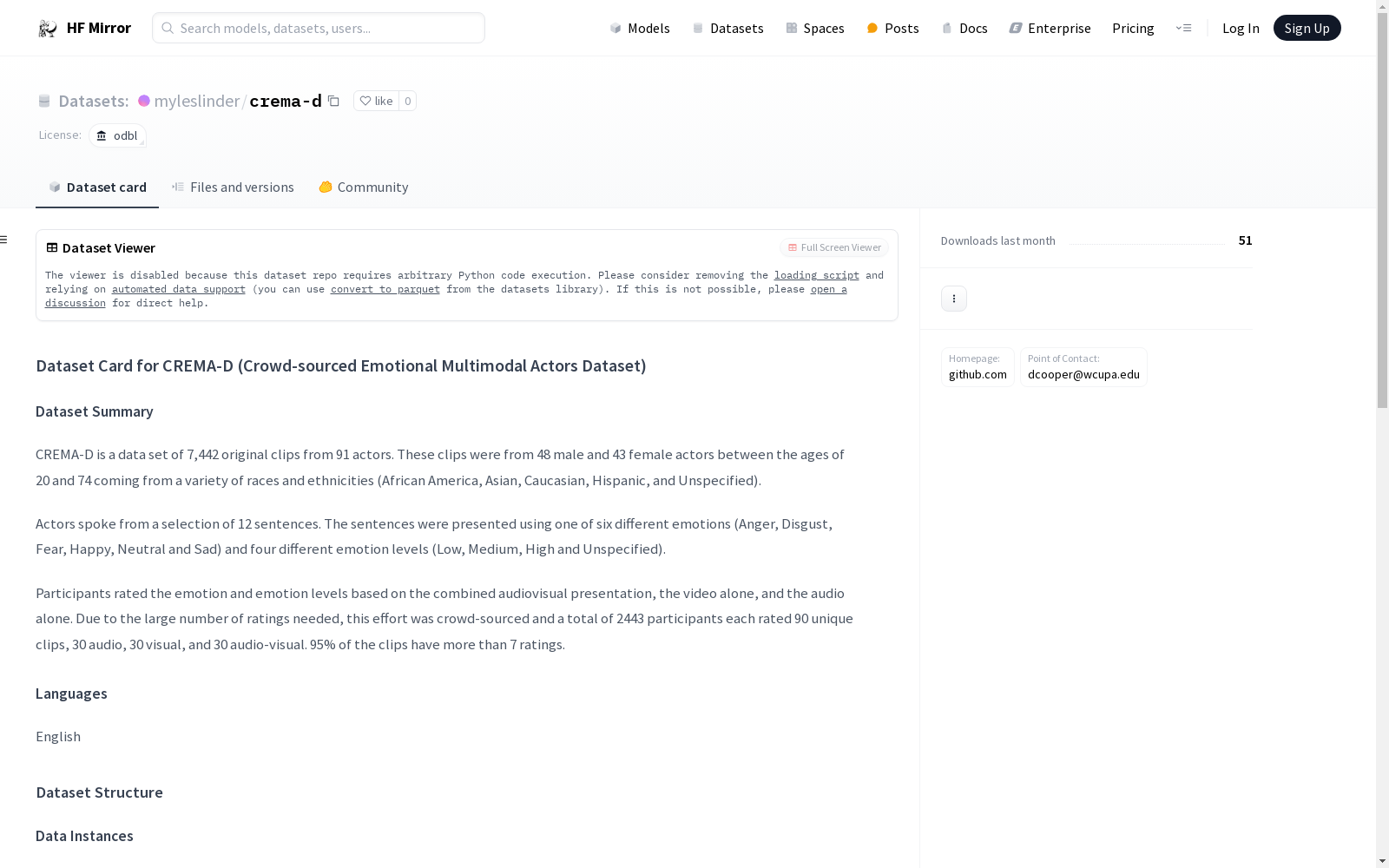

myleslinder/crema-d

收藏数据集卡片 for CREMA-D (Crowd-sourced Emotional Multimodal Actors Dataset)

数据集描述

数据集概述

CREMA-D 是一个包含 7,442 个原始片段的数据集,由 91 名演员录制。这些片段来自 48 名男性和 43 名女性演员,年龄介于 20 至 74 岁之间,来自多种种族和族裔(非洲裔美国人、亚洲人、高加索人、西班牙裔和未指定)。

演员们从 12 个句子中选择进行朗读。这些句子使用六种不同的情绪(愤怒、厌恶、恐惧、快乐、中性、悲伤)和四种不同的情绪强度(低、中、高和未指定)进行表达。

参与者根据视听结合、仅视频和仅音频的方式对情绪和情绪强度进行评分。由于需要大量评分,这一工作是通过众包完成的,共有 2443 名参与者,每人评定了 90 个独特的片段,包括 30 个音频、30 个视频和 30 个视听片段。95% 的片段获得了超过 7 次评分。

语言

英语

数据集结构

数据实例

json { path: .../.cache/huggingface/datasets/downloads/extracted/.../data/AudioWAV/1001_DFA_ANG_XX.wav, audio: { path: .../.cache/huggingface/datasets/downloads/extracted/.../data/AudioWAV/1001_DFA_ANG_XX.wav, array: array([ -1.35336370e-06, -1.84488497e-04, -2.73496640e-04, 1.40174336e-04, 8.33026352e-05, 0.00000000e+00 ]), sampling_rate: 16000 }, actor_id: 1001, sentence: "Dont forget a jacket", emotion_intensity: Unspecified, label: 0 }

附加信息

引用信息

BibTex @article{cao2014crema, title={CREMA-D: Crowd-sourced Emotional Multimodal Actors Dataset}, author={Cao, H. and Cooper, D. G. and Keutmann, M. K. and Gur, R. C. and Nenkova, A. and Verma, R.}, journal={IEEE transactions on affective computing}, volume={5}, number={4}, pages={377--390}, year={2014}, doi={10.1109/TAFFC.2014.2336244}, url={https://doi.org/10.1109/TAFFC.2014.2336244} }