GLUE

收藏github2018-11-01 更新2025-02-07 收录

下载链接:

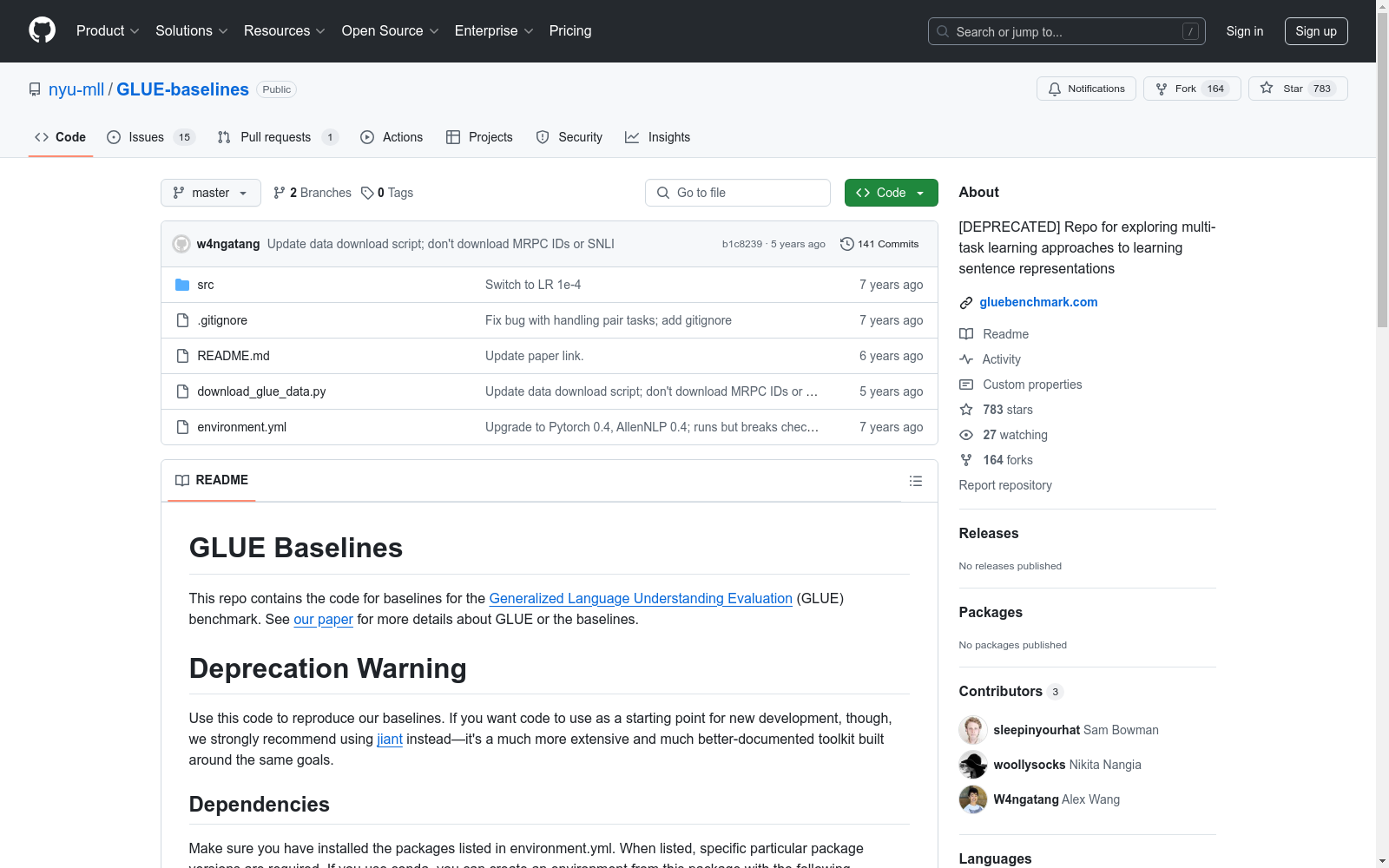

https://github.com/nyu-mll/GLUE-baselines

下载链接

链接失效反馈资源简介:

GLUE数据集包含9个英语自然语言理解(NLU)数据集,分别是CoLA、SST-2、MRPC、STS-B、QQP、MNLI、QNLI、RTE和WNLI。评估的自然语言理解任务包括语法判断、情感分析、语义匹配、文本蕴含、阅读理解以及共指消解。

The GLUE dataset encompasses nine English Natural Language Understanding (NLU) datasets, including CoLA, SST-2, MRPC, STS-B, QQP, MNLI, QNLI, RTE, and WNLI. The evaluated NLU tasks include syntactic classification, sentiment analysis, semantic matching, text entailment, reading comprehension, and coreference resolution.

提供机构:

New York University et al.

创建时间:

2018-11-01

原始信息汇总

GLUE Baselines数据集概述

数据集基本信息

- 数据集名称: GLUE (Generalized Language Understanding Evaluation)

- 基准代码库: 提供GLUE基准测试的基线模型实现代码

- 相关论文: GLUE: A Multi-Task Benchmark and Analysis Platform for Natural Language Understanding

数据集获取

-

下载方式: 提供Python脚本下载所有GLUE数据和标准分割 python python download_glue_data.py --data_dir glue_data --tasks all

-

特殊地区处理: 针对中国用户提供MRPC数据的替代下载方案 python git clone https://github.com/wasiahmad/paraphrase_identification.git python download_glue_data.py --data_dir glue_data --tasks all --path_to_mrpc=paraphrase_identification/dataset/msr-paraphrase-corpus

依赖环境

- 环境配置: 需安装environment.yml中列出的软件包

- 特定版本要求:

- PyTorch 0.4

- 可能需要从源码安装AllenNLP

预训练资源

- GloVe词向量: 使用300维840B版本

- CoVe实现: 来自salesforce/cove

- ELMo实现: 来自AllenNLP

运行方式

- 主程序: src/main.py

- 关键参数:

--exp_dir: 共享预处理结果的目录--run_dir: 保存特定运行信息的目录--train_tasks: 训练任务设置--word_embs_file: GloVe文件路径

替代工具推荐

- 推荐工具: jiant

- 推荐原因: 更全面、文档更完善的工具包

引用信息

bibtex @unpublished{wang2018glue title={{GLUE}: A Multi-Task Benchmark and Analysis Platform for Natural Language Understanding} author={Wang, Alex and Singh, Amanpreet and Michael, Julian and Hill, Felix and Levy, Omer and Bowman, Samuel R.} note={arXiv preprint 1804.07461} year={2018} }

搜集汇总

数据集介绍

构建方式

GLUE数据集是基于多样化自然语言理解任务构建的评估基准。该数据集整合了包括问答、文本分类、句子相似性等在内的多项任务,旨在为研究人员提供一个全面的性能评估平台。其构建过程中,采用了预训练的语言模型以及多种词嵌入技术,如GloVe、CoVe和ELMo,以增强模型对语言的理解能力。

特点

GLUE数据集的特点在于其任务的多样性,涵盖了自然语言处理的核心领域,能够全面评估模型在理解、推理和生成方面的表现。此外,该数据集提供了标准的训练、验证和测试分割,使得不同研究者的实验结果具有可比性。数据集还包含了预训练的词嵌入,方便研究者直接使用或在此基础上进行进一步训练。

使用方法

使用GLUE数据集,首先需要通过提供的Python脚本下载所有数据及其标准分割。用户可以根据需要设置数据存储路径,并选择使用预训练的词嵌入。运行基准测试时,可以通过指定实验和运行目录来共享预处理结果,提高实验效率。具体使用时,用户需要根据所使用的模型和任务调整相应的参数配置。

背景与挑战

背景概述

GLUE(Generalized Language Understanding Evaluation)数据集是由Alex Wang等人于2018年创建,旨在为自然语言理解领域提供一种全面的评估标准。该数据集汇集了多种自然语言处理任务,如文本分类、情感分析、问题回答等,为研究人员提供了一个统一的评测平台。GLUE的创建不仅推动了自然语言处理技术的进步,而且对相关领域的研究产生了深远影响,成为了该领域内衡量模型性能的重要基准之一。

当前挑战

GLUE数据集在构建过程中遇到的挑战主要包括数据的多样性和质量保证。数据集需要涵盖多种语言理解任务,并且保证各个任务的数据质量,以确保评测的准确性和公平性。此外,在研究领域中,如何利用GLUE数据集解决自然语言处理中的实际问题,如跨任务学习、模型泛化能力等,也是当前面临的挑战。同时,随着技术的进步,不断有新的任务被提出,数据集的更新和维护也是一项持续的挑战。

常用场景

经典使用场景

GLUE数据集作为自然语言处理领域的一项重要基准,其经典使用场景主要在于评估和比较不同模型在多项自然语言理解任务上的表现。该数据集整合了包括文本分类、情感分析、实体识别等在内的多样化任务,为研究者提供了一个统一的平台来测试和验证其模型的泛化能力。

衍生相关工作

基于GLUE数据集的研究成果,衍生出了大量相关工作,包括对GLUE任务的扩展、对新任务的提出以及对现有模型的改进等。这些工作进一步推动了自然语言处理领域的发展,促进了跨学科的研究交流和应用落地。

数据集最近研究

最新研究方向

GLUE基准作为自然语言理解领域的重要评估工具,其相关研究集中于提升多任务处理能力与跨任务的语言模型表现。近期研究关注于利用GLUE数据集进行深度学习模型的微调,特别是在模型融合GloVe、CoVe与ELMo等预训练词向量方面取得显著进展,旨在增强模型对语言理解的深度与广度。此外,研究还聚焦于开发更为高效的基准工具,如jiant工具包的运用,以促进自然语言处理技术的快速发展。

以上内容由遇见数据集搜集并总结生成