CliMedBench

收藏arXiv2024-10-04 更新2024-10-08 收录

下载链接:

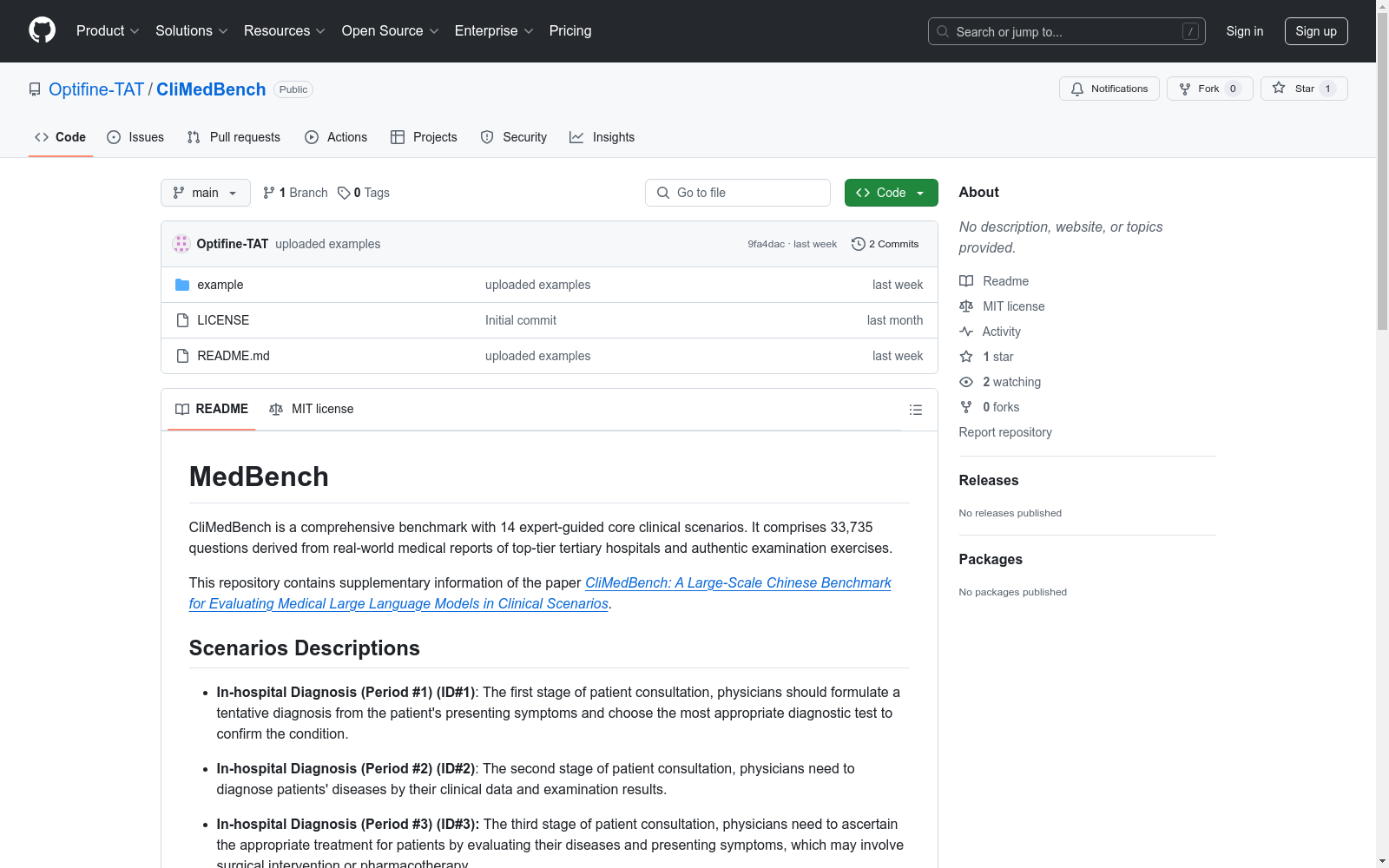

https://github.com/Optifine-TAT/CliMedBench

下载链接

链接失效反馈官方服务:

资源简介:

CliMedBench是一个大规模的中文医疗大语言模型评估基准,由华东师范大学等机构创建。该数据集包含33,735个问题,涵盖14个核心临床场景,主要来源于顶级三级医院的真实电子健康记录和考试练习。数据集的创建过程包括专家指导的数据选择和多轮质量控制,确保数据的真实性和可靠性。CliMedBench旨在评估和提升医疗大语言模型在临床决策支持、诊断和治疗建议等方面的能力,解决医疗领域中模型性能评估的不足问题。

CliMedBench is a large-scale Chinese medical large language model evaluation benchmark developed by institutions including East China Normal University. This dataset comprises 33,735 questions spanning 14 core clinical scenarios, primarily sourced from real electronic health records and practice examinations from top tertiary hospitals. The dataset construction process incorporates expert-guided data selection and multi-round quality control to guarantee the authenticity and reliability of the collected data. CliMedBench aims to evaluate and enhance the capabilities of medical large language models in clinical decision support, diagnosis and treatment recommendations, addressing the shortcomings of model performance assessment in the medical field.

提供机构:

华东师范大学

创建时间:

2024-10-04

原始信息汇总

CliMedBench

搜集汇总

数据集介绍

构建方式

CliMedBench的构建基于中国顶级三级医院的真实电子健康记录(EHR),并辅以考试练习、医学指南、教科书和人工注释的在线咨询。该数据集涵盖了多个医学专业,经过精心筛选以增强多样性。EHR数据由合作医院提供,涵盖2023年1月1日至3月31日的放射记录。考试问题源自2023年NMLEC年度考试,涵盖外科和内科领域的16个科目。数据集构建过程中,医学专家首先根据EHR中的医生笔记内容类型制定指南,将EHR分割成句子,然后由LLM1分类为问题生成组件,通过将正确答案与来自不同但主题相似的EHR段的干扰项配对形成QA对。LLM2审核数据集以检查不一致或模糊之处,标记的项目由医学专家评估,确保仅解决相关问题。通过迭代验证周期,确保至少90%的问题符合质量标准,最终获得33,735个实例,严格基于医生笔记和临床治疗记录。

特点

CliMedBench在多个方面优于现有基准:(1)真实性和独特性,通过使用顶级医院专家注释的EHR,提供最新、真实的见解,减少数据污染的可能性。(2)全面性和多维性,精心设计以符合中国临床实践,涵盖多样化的医学学科和多模态信息,提供广泛的评估视角。(3)实用性,采用基于代理的计算机化自适应测试方法,确保快速评估。

使用方法

CliMedBench适用于评估大型语言模型(LLMs)在临床场景中的医疗能力。用户可以通过提供的14个核心临床场景和33,735个问题,对模型进行全面的测试和分析。评估方法包括自动指标(如准确性、Kendall's τ)和专家级人工评估(如医学正确性、完整性、流畅性和友好性)。此外,还提供了基于代理的计算机化自适应测试方法,以实现快速评估。用户可以根据模型的表现,识别其在临床决策支持、诊断和治疗建议中的优势和局限性,从而指导进一步的研究和改进。

背景与挑战

背景概述

随着大型语言模型(LLMs)在各个领域的广泛应用,特别是在中文临床医疗场景中,对这些模型的全面评估需求日益迫切。CliMedBench数据集由华东师范大学、上海交通大学和Hasso Plattner研究所的研究团队于2023年创建,旨在为评估中文医疗大型语言模型提供一个全面的基准。该数据集包含33,735个问题,源自顶级三级医院的真实医疗报告和考试练习,涵盖14个核心临床场景,评估模型在临床问答、知识应用、推理等多个维度上的能力。CliMedBench的推出填补了中文医疗LLMs评估标准的空白,为医疗研究提供了关键的见解。

当前挑战

CliMedBench数据集在构建过程中面临多重挑战。首先,如何确保数据的真实性和多样性,避免数据污染,是一个重要问题。其次,从电子健康记录(EHRs)中提取高质量数据并进行有效的数据预处理,以确保数据的准确性和一致性,也是一个技术难题。此外,评估模型的临床推理能力和事实一致性,特别是在处理复杂医疗案例时,对模型的性能提出了更高的要求。最后,如何在有限的输入容量下,确保模型在临床场景中的实际应用能力,也是一个亟待解决的问题。

常用场景

经典使用场景

CliMedBench 数据集的经典使用场景在于评估大型语言模型(LLMs)在临床医学场景中的表现。通过包含14个核心临床场景和33,735个问题,该数据集能够全面评估模型在临床问答、知识应用、推理、信息检索、总结能力、幻觉和毒性等方面的能力。这种全面的评估有助于揭示模型在实际临床应用中的优势和局限性。

实际应用

CliMedBench 数据集在实际应用中主要用于临床决策支持、诊断和治疗建议的自动化。通过模拟真实的临床场景和病例,该数据集帮助医疗专业人员和研究人员评估和改进LLMs在实际医疗环境中的表现。此外,该数据集还可用于培训和验证医疗领域的AI系统,提高其在复杂临床环境中的可靠性和准确性。

衍生相关工作

CliMedBench 数据集的发布催生了一系列相关研究工作,特别是在中文医学LLMs的评估和改进方面。例如,基于该数据集的研究揭示了现有模型在医学推理和事实一致性方面的不足,推动了相关技术的进一步发展。此外,该数据集还启发了新的评估方法和工具的开发,如基于计算机自适应测试(CAT)的快速评估方法,这些方法在提高评估效率和准确性方面具有重要意义。

以上内容由遇见数据集搜集并总结生成