FACES

收藏github2024-05-19 更新2024-05-31 收录

下载链接:

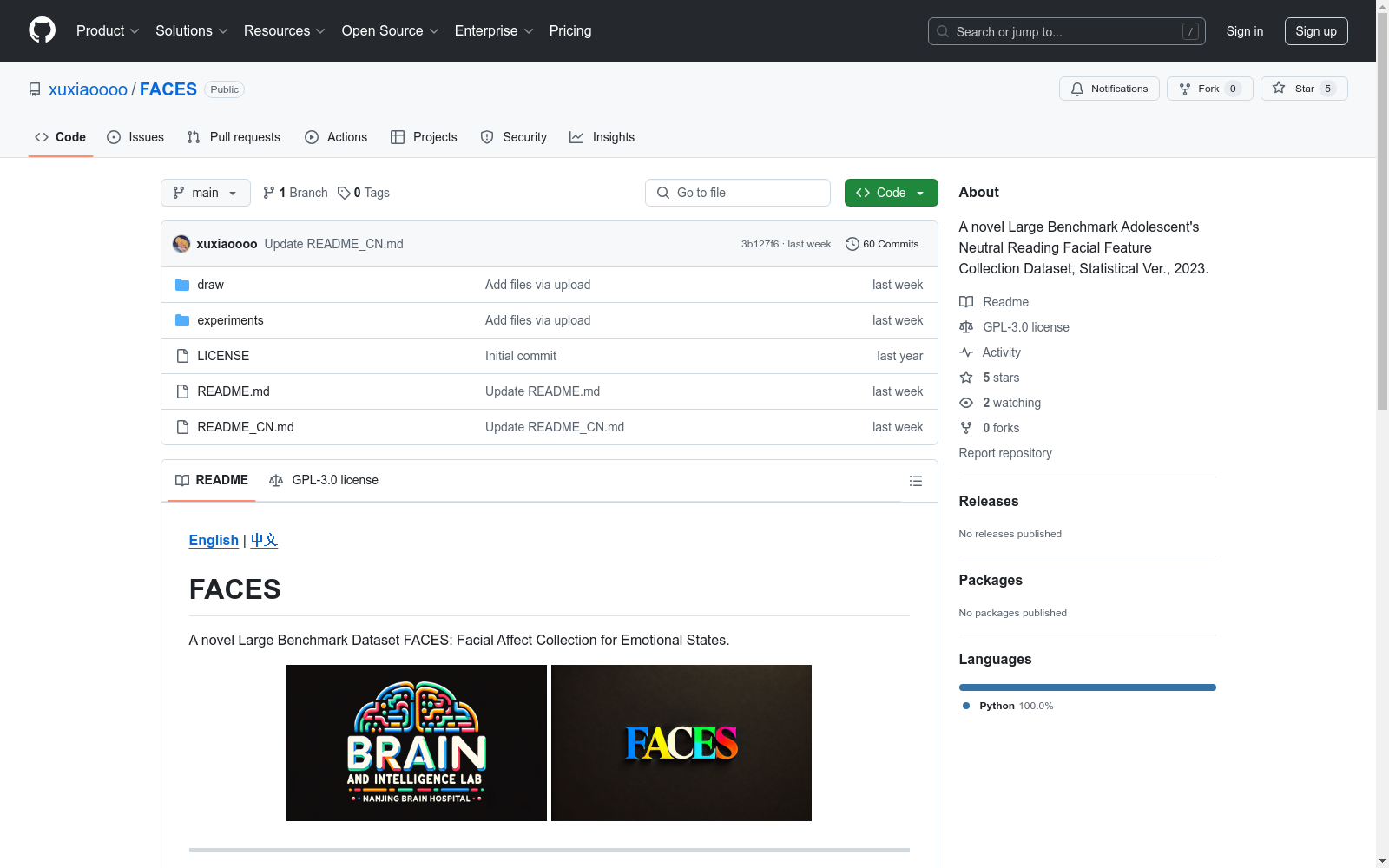

https://github.com/xuxiaoooo/FACES

下载链接

链接失效反馈资源简介:

我们的FACES数据集招募了11,427名健康的学龄儿童,并记录了他们的DASS-21量表和面部视频。据我们所知,这是最大的音视频数据集,具有严格的和标准的采集过程。感谢OpenFace 2.0,我们提取了全面的特征。

Our FACES dataset recruited 11,427 healthy school-aged children and recorded their DASS-21 scales and facial videos. To the best of our knowledge, this is the largest audio-visual dataset with a rigorous and standardized collection process. Thanks to OpenFace 2.0, we extracted comprehensive features.

创建时间:

2023-09-06

原始信息汇总

FACES数据集概述

数据集名称

- FACES: Facial Affect Collection for Emotional States

数据集规模

- 包含11,427名健康学龄儿童的数据

数据类型

- 包含DASS-21量表数据和面部视频

数据集特点

- 目前最大的音视频数据集,具有严格的采集标准

- 利用OpenFace 2.0提取全面的面部特征

数据集应用

- 用于多群体、多模态大数据集的获取和人工智能方法研究

- 关注音频/视频相关数据和研究

数据集验证

- 通过精细分析确认数据集的有效性

- 分析重要面部特征与心理健康之间的关联

引用信息

@article{xu2024faces, title={Faces of the Mind: Unveiling Mental Health States Through Facial Expressions in 11,427 Adolescents}, author={Xu, Xiao and Zhou, Keyin and Zhang, Yan and Wang, Yang and Wang, Fei and Zhang, Xizhe}, journal={arXiv preprint arXiv:2405.20072}, year={2024} }

AI搜集汇总

数据集介绍

构建方式

FACES数据集通过招募11,427名健康的学龄儿童,结合其DASS-21量表和面部视频数据,构建了一个大规模的音频-视觉数据集。该数据集的采集过程严格且标准化,利用OpenFace 2.0工具提取了全面的面部特征,确保了数据的高质量和多样性。

特点

FACES数据集的显著特点在于其规模庞大且数据类型丰富,涵盖了11,427名学龄儿童的面部表情和心理状态数据。此外,数据集采用了严格的标准化采集流程,确保了数据的可靠性和一致性。通过OpenFace 2.0提取的面部特征,进一步增强了数据集在情感分析和心理健康研究中的应用潜力。

使用方法

FACES数据集可广泛应用于情感分析、心理健康评估以及人机交互等领域。研究者可以通过分析面部表情和DASS-21量表数据,探索情感状态与心理健康之间的关系。数据集的结构化设计使得用户能够轻松提取和处理面部特征,为深度学习模型提供了丰富的训练和测试数据。

背景与挑战

背景概述

FACES数据集,全称为Facial Affect Collection for Emotional States,是由Xu Xiao及其团队于2024年创建的一个大规模基准数据集。该数据集旨在通过面部表情分析揭示青少年的心理健康状态,招募了11,427名健康的学童,并结合DASS-21量表和面部视频数据,采用OpenFace 2.0工具提取全面特征。作为目前最大的视听数据集之一,FACES严格遵循标准化的采集流程,为情感计算和心理健康研究领域提供了宝贵的资源,极大地推动了相关领域的研究进展。

当前挑战

FACES数据集在构建过程中面临多项挑战。首先,大规模数据采集和处理需要高度的组织协调和技术支持,确保数据质量和一致性。其次,面部表情与心理健康状态的关联分析复杂,涉及多模态数据的融合与解释,要求高精度的特征提取和模型训练。此外,数据隐私和伦理问题也是一大挑战,需严格遵守相关法规,确保参与者权益。这些挑战不仅考验了数据集构建的技术能力,也对其在实际应用中的有效性和可靠性提出了高要求。

常用场景

经典使用场景

FACES数据集在情感计算与心理健康研究领域中展现了其经典应用场景。通过整合11,427名健康学生的面部视频与DASS-21量表数据,研究者能够深入分析面部表情与情感状态之间的关联。该数据集特别适用于开发和验证基于面部表情识别的情感分析模型,为心理学和计算机视觉的交叉研究提供了丰富的实验数据。

解决学术问题

FACES数据集有效解决了情感计算领域中大规模、高质量数据稀缺的问题。通过提供详尽的面部表情特征与心理健康评估数据,该数据集为研究者提供了探索青少年心理健康状态与面部表情之间复杂关系的工具。这不仅推动了情感计算技术的发展,还为心理健康评估提供了新的量化方法,具有重要的学术价值。

衍生相关工作

FACES数据集的发布激发了众多相关研究,特别是在情感计算和心理健康评估领域。基于该数据集,研究者们开发了多种面部表情识别算法,并探索了这些算法在不同文化背景下的适用性。此外,还有研究利用FACES数据集进行跨学科研究,如结合脑电图(EEG)数据,进一步揭示情感状态与大脑活动之间的关系,推动了情感计算与神经科学的融合。

以上内容由AI搜集并总结生成