NYUDv2

收藏cs.nyu.edu2024-11-01 收录

下载链接:

https://cs.nyu.edu/~silberman/datasets/nyu_depth_v2.html

下载链接

链接失效反馈资源简介:

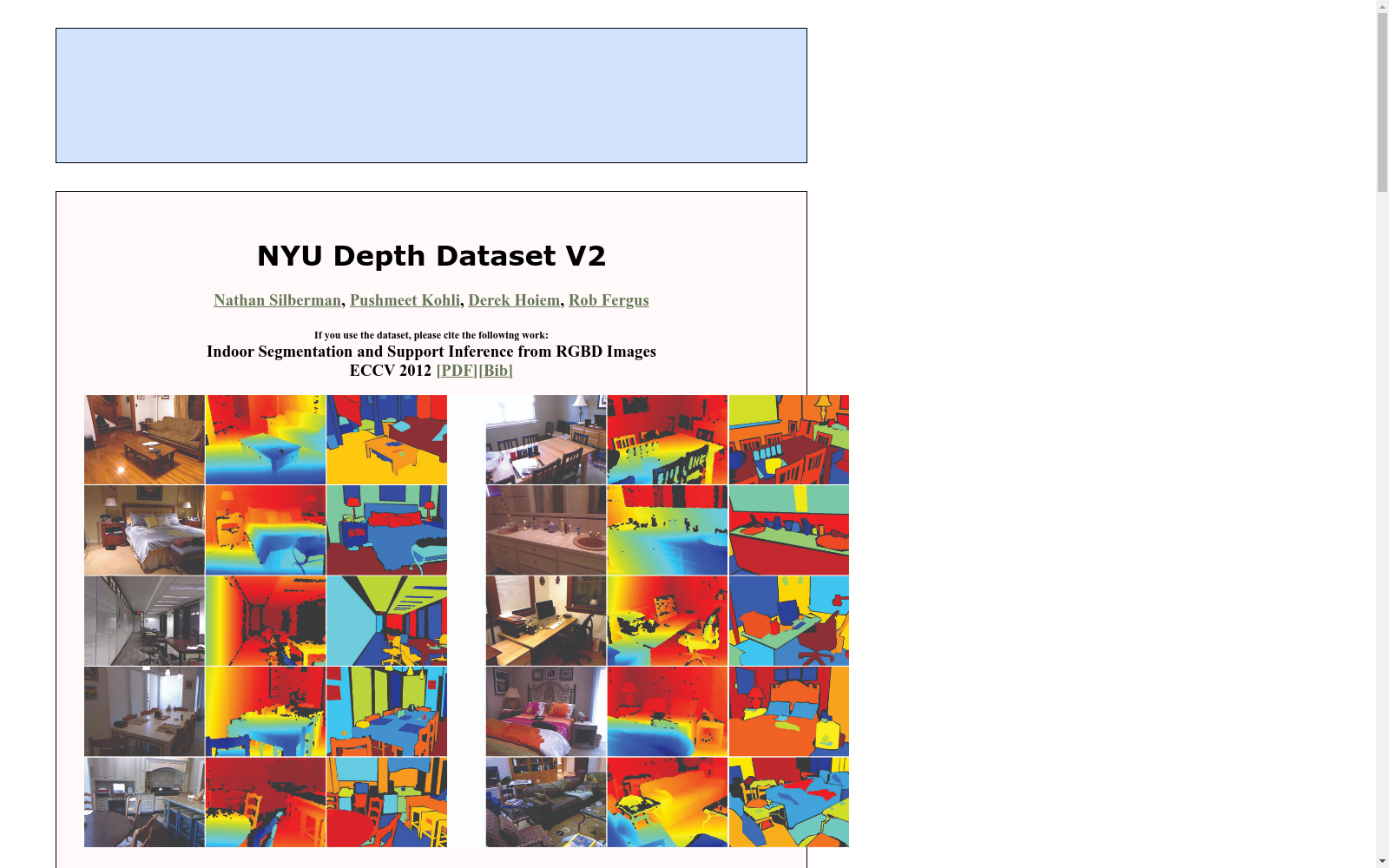

NYUDv2数据集包含1449张RGB-D图像,这些图像来自纽约大学深度图像库。数据集主要用于计算机视觉任务,如语义分割、物体识别和深度估计。每张图像都配有详细的深度信息和语义标签,适用于多种视觉任务的研究和开发。

The NYUDv2 dataset consists of 1,449 RGB-D images sourced from the New York University Depth Image Library. It is primarily targeted at computer vision tasks including semantic segmentation, object recognition, and depth estimation. Each image is paired with detailed depth information and semantic labels, making it suitable for research and development across multiple computer vision tasks.

提供机构:

cs.nyu.edu

AI搜集汇总

数据集介绍

构建方式

NYUDv2数据集的构建基于纽约大学深度图像数据库,通过精心设计的采集流程,涵盖了室内场景的多样化实例。该数据集由1449张高分辨率RGB-D图像组成,每张图像均附有详细的深度信息和语义标签。构建过程中,研究人员采用了先进的图像处理技术,确保了数据的高质量和一致性,为后续的计算机视觉研究提供了坚实的基础。

特点

NYUDv2数据集以其丰富的室内场景和多模态数据著称。该数据集不仅包含了RGB图像,还提供了与之对应的深度图和语义分割标签,使得其在场景理解、物体识别和深度估计等任务中具有广泛的应用价值。此外,数据集中的图像涵盖了多种光照条件和视角变化,增强了模型的泛化能力。

使用方法

NYUDv2数据集适用于多种计算机视觉任务,如场景分类、物体检测和语义分割。研究人员可以通过加载数据集中的RGB图像和深度信息,结合相应的语义标签,训练和评估深度学习模型。数据集的多样性和高质量数据为模型的训练提供了丰富的资源,有助于提升模型在实际应用中的表现。

背景与挑战

背景概述

NYUDv2数据集,由纽约大学于2012年创建,主要研究人员包括Nathan Silberman和Rob Fergus等。该数据集的核心研究问题集中在深度估计和语义分割,旨在通过提供丰富的室内场景图像及其对应的深度和语义标签,推动计算机视觉领域的发展。NYUDv2不仅包含了1449张RGB-D图像,还提供了详细的像素级标注,涵盖了40个语义类别。这一数据集的发布,极大地促进了深度学习和计算机视觉算法在室内场景理解方面的研究,尤其是在机器人导航、增强现实和智能家居等领域,具有深远的影响力。

当前挑战

尽管NYUDv2数据集在室内场景理解方面提供了宝贵的资源,但其构建和应用过程中仍面临诸多挑战。首先,数据集的规模相对较小,仅包含1449张图像,这在深度学习模型训练中可能不足以捕捉到复杂的场景变化。其次,由于数据集主要聚焦于室内环境,其泛化能力受到限制,难以直接应用于户外或其他复杂场景。此外,数据集的标注过程复杂且耗时,尤其是在像素级语义分割方面,需要高度专业化的知识和技能。这些挑战不仅影响了数据集的广泛应用,也对其在推动计算机视觉技术进步中的作用提出了更高的要求。

发展历史

创建时间与更新

NYUDv2数据集由加州大学伯克利分校的团队于2011年创建,旨在推动计算机视觉领域的发展。该数据集在2012年进行了首次公开发布,并在随后的几年中得到了多次更新和扩展,以适应不断变化的算法需求和技术进步。

重要里程碑

NYUDv2数据集的一个重要里程碑是其在2012年的发布,这一事件标志着深度学习在计算机视觉中的应用开始得到广泛关注。该数据集包含了超过1400张由微软Kinect传感器捕获的室内场景图像,每张图像都附有详细的深度信息和语义分割标签。这一丰富的数据资源极大地推动了深度学习模型在场景理解、物体识别和语义分割等任务中的性能提升。此外,NYUDv2还成为了许多国际计算机视觉竞赛的标准基准数据集,进一步巩固了其在学术界和工业界的影响力。

当前发展情况

当前,NYUDv2数据集仍然是计算机视觉领域的重要资源之一,尤其在深度估计和语义分割任务中具有不可替代的地位。随着深度学习技术的不断进步,研究人员对NYUDv2数据集进行了多次扩展和优化,以适应更高分辨率图像和更复杂场景的需求。此外,该数据集还被广泛应用于各种新型算法的开发和验证,推动了计算机视觉技术的整体发展。NYUDv2的成功不仅在于其丰富的数据内容,更在于其持续的更新和扩展,确保了其在快速变化的科技环境中始终保持前沿地位。

发展历程

- NYUDv2数据集首次发表,由Nathan Silberman等人提出,旨在为室内场景提供深度和语义分割信息。

- NYUDv2数据集首次应用于计算机视觉研究,特别是在深度估计和语义分割任务中,展示了其在室内场景理解中的潜力。

- NYUDv2数据集的扩展版本发布,增加了更多的标注信息,包括实例分割和物体边界框,进一步丰富了数据集的应用场景。

- NYUDv2数据集在深度学习领域得到广泛应用,成为室内场景理解和多任务学习的重要基准数据集之一。

- NYUDv2数据集的相关研究成果在多个顶级计算机视觉会议上发表,推动了室内场景理解的理论和方法的发展。

- NYUDv2数据集继续在最新的深度学习模型和算法中被引用和应用,验证了其在室内场景理解中的持续价值。

常用场景

经典使用场景

在计算机视觉领域,NYUDv2数据集以其丰富的室内场景图像和深度信息而著称。该数据集广泛应用于语义分割、深度估计和物体检测等任务中。通过提供多视角的RGB-D图像,NYUDv2为研究人员提供了一个标准化的基准,用于评估和比较不同算法的性能。

解决学术问题

NYUDv2数据集在解决计算机视觉中的多模态数据融合问题上发挥了重要作用。它不仅提供了高质量的RGB图像,还包含了相应的深度信息,这使得研究人员能够探索如何更有效地结合视觉和几何信息来提高模型的准确性和鲁棒性。此外,该数据集还促进了室内场景理解的研究,为智能家居、机器人导航等领域提供了理论支持。

衍生相关工作

基于NYUDv2数据集,许多经典工作得以展开。例如,研究人员开发了多种深度学习模型,用于提高语义分割和物体检测的精度。此外,该数据集还激发了对多模态数据融合技术的深入研究,推动了相关领域的技术进步。许多后续工作也借鉴了NYUDv2的设计理念,进一步扩展了其在不同应用场景中的影响力。

以上内容由AI搜集并总结生成