P-MMEVAL

收藏arXiv2024-11-14 更新2024-11-16 收录

下载链接:

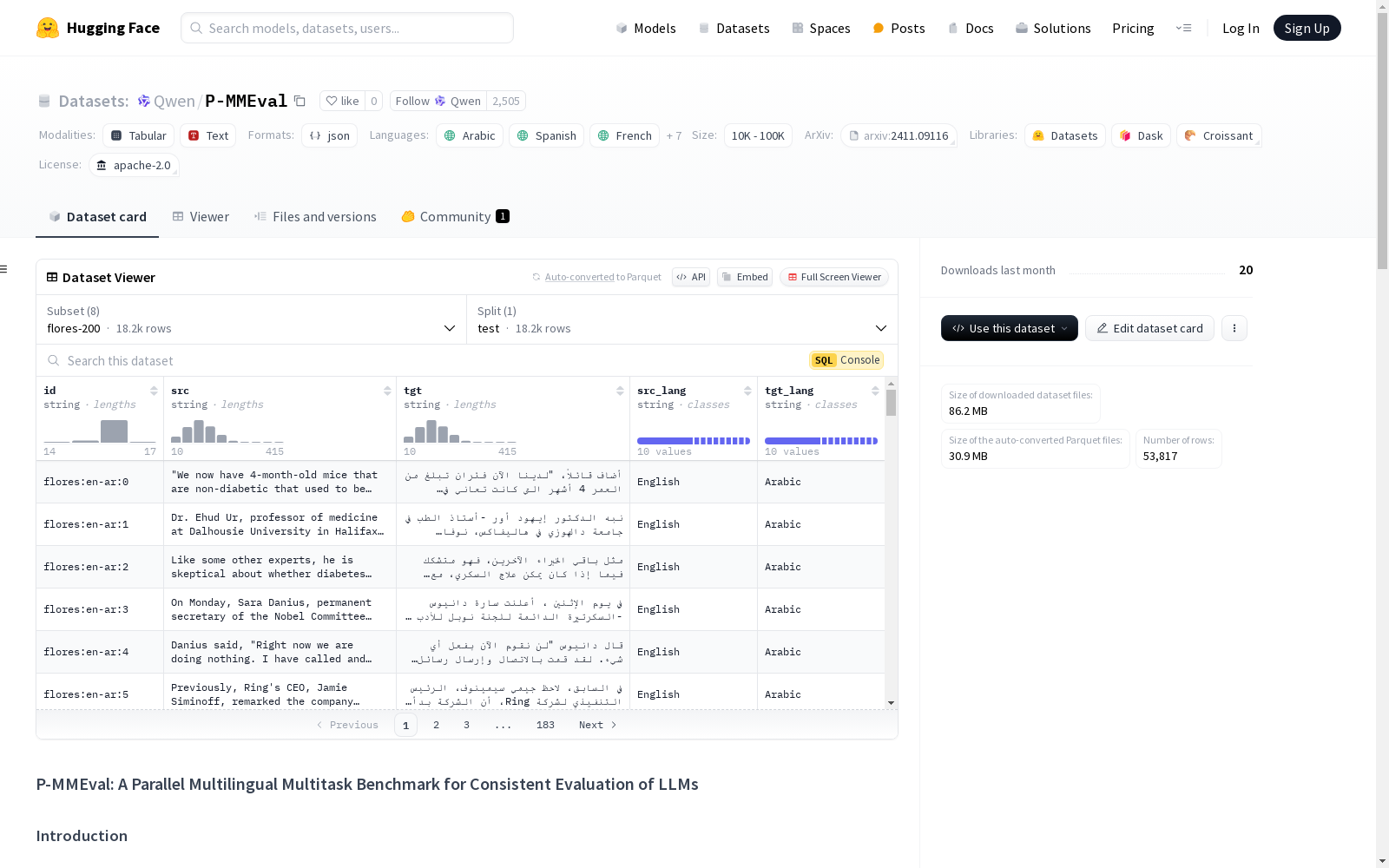

https://huggingface.co/datasets/Qwen/P-MMEval

下载链接

链接失效反馈官方服务:

资源简介:

P-MMEVAL是由阿里巴巴集团通义实验室创建的一个大规模多语言多任务基准数据集,旨在全面评估大型语言模型(LLMs)的多语言能力。该数据集包含三个基础自然语言处理(NLP)数据集和五个高级能力专项数据集,涵盖了代码生成、知识理解、数学推理、逻辑推理和指令跟随等任务。数据集通过专家翻译审查,确保了10种语言的一致覆盖,提供了跨语言的平行样本。P-MMEVAL的应用领域主要集中在LLMs的多语言能力评估和跨语言迁移能力的研究,旨在解决现有评估方法在多语言覆盖和任务多样性上的不足。

P-MMEVAL is a large-scale multilingual multi-task benchmark dataset developed by Tongyi Lab of Alibaba Group, designed to comprehensively evaluate the multilingual capabilities of Large Language Models (LLMs). It consists of three foundational Natural Language Processing (NLP) datasets and five specialized advanced capability datasets, covering a range of tasks including code generation, knowledge understanding, mathematical reasoning, logical reasoning, and instruction following. The dataset has been subjected to expert translation and review to ensure consistent coverage across 10 languages, providing cross-lingual parallel samples. Primarily applied to the evaluation of LLMs' multilingual capabilities and research on cross-lingual transfer abilities, P-MMEVAL aims to address the shortcomings of existing evaluation methods in terms of multilingual coverage and task diversity.

提供机构:

阿里巴巴集团通义实验室

创建时间:

2024-11-14

搜集汇总

数据集介绍

构建方式

P-MMEVAL数据集的构建过程分为三个主要阶段。首先,通过精心筛选和评估大量现有基准,选择出具有代表性和挑战性的数据集,以确保这些基准能够有效区分不同模型的性能。其次,从当前研究中精选出最具影响力的能力专项任务,包括代码生成、知识理解、数学推理、逻辑推理和指令遵循。最后,整合这些数据集,形成一个包含三个基础NLP数据集和五个能力专项数据集的综合基准,确保所有选定数据集在语言覆盖上的一致性,并提供多语言平行样本。

特点

P-MMEVAL数据集的主要特点在于其全面性和多语言一致性。该基准不仅涵盖了基础的自然语言理解和生成任务,还包含了高级的能力专项任务,确保了对大型语言模型(LLMs)多语言能力的全面评估。此外,P-MMEVAL通过提供多语言平行样本,确保了跨语言评估的公平性和一致性,从而能够更准确地衡量和比较不同模型在多语言环境中的表现。

使用方法

P-MMEVAL数据集的使用方法主要包括模型评估和性能分析。研究者可以通过该数据集对不同的大型语言模型进行多语言多任务评估,分析模型在基础NLP任务和能力专项任务上的表现。此外,数据集还提供了多语言平行样本,便于研究者进行跨语言性能比较和分析。通过详细的实验和分析,P-MMEVAL为未来研究提供了宝贵的指导,特别是在平衡和全面的训练数据、有效的提示工程以及特定语言能力的改进方面。

背景与挑战

背景概述

P-MMEVAL数据集由阿里巴巴集团旗下的Tongyi Lab开发,旨在为大规模语言模型(LLMs)提供一个综合的多语言多任务基准。该数据集的创建旨在解决现有评估方法在多语言能力评估上的局限性,特别是那些仅限于基本自然语言处理任务或特定能力任务的评估。P-MMEVAL通过整合基础NLP任务和能力专业化任务,确保了跨不同数据集的语言一致性,并提供了多语言样本,从而促进了多语言能力的全面评估。

当前挑战

P-MMEVAL数据集面临的挑战包括构建一个既包含广泛任务覆盖又具有强大语言并行性的基准。具体挑战包括:1) 在开发和迭代LLMs时,提供准确和并行的评估结果以识别其多语言能力;2) 在测量特定LLM的多语言能力或比较不同LLM生成的多语言响应质量时,确保评估的系统性和一致性。此外,数据集的构建过程中还面临选择有效基准的挑战,以确保这些基准能够有效区分被评估模型之间的性能差异。

常用场景

经典使用场景

P-MMEVAL数据集在评估大型语言模型(LLMs)的多语言和多任务能力方面具有经典应用。它通过涵盖翻译、代码生成和推理等多种任务,提供了一个全面的基准,以系统地评估LLMs在不同语言和任务中的表现。该数据集的经典使用场景包括在学术研究中比较不同LLMs的多语言能力,以及在工业应用中验证模型在多语言环境下的性能。

实际应用

在实际应用中,P-MMEVAL数据集被广泛用于多语言环境下的模型性能验证和优化。例如,在跨国公司中,该数据集可以帮助评估和提升聊天机器人或自动翻译系统在不同语言中的表现。此外,它还可以用于教育领域,帮助开发多语言学习工具和评估系统,以支持全球化的教育需求。

衍生相关工作

P-MMEVAL数据集的推出激发了一系列相关研究和工作。例如,基于该数据集的研究已经产生了多个改进的多语言模型和评估方法。此外,还有研究致力于开发更高效的数据集选择和评估流程,以进一步提升LLMs的多语言能力评估的准确性和效率。这些衍生工作不仅丰富了多语言NLP领域的研究内容,也为实际应用提供了更多可能性。

以上内容由遇见数据集搜集并总结生成