KINS Dataset

收藏github2024-05-18 更新2024-05-31 收录

下载链接:

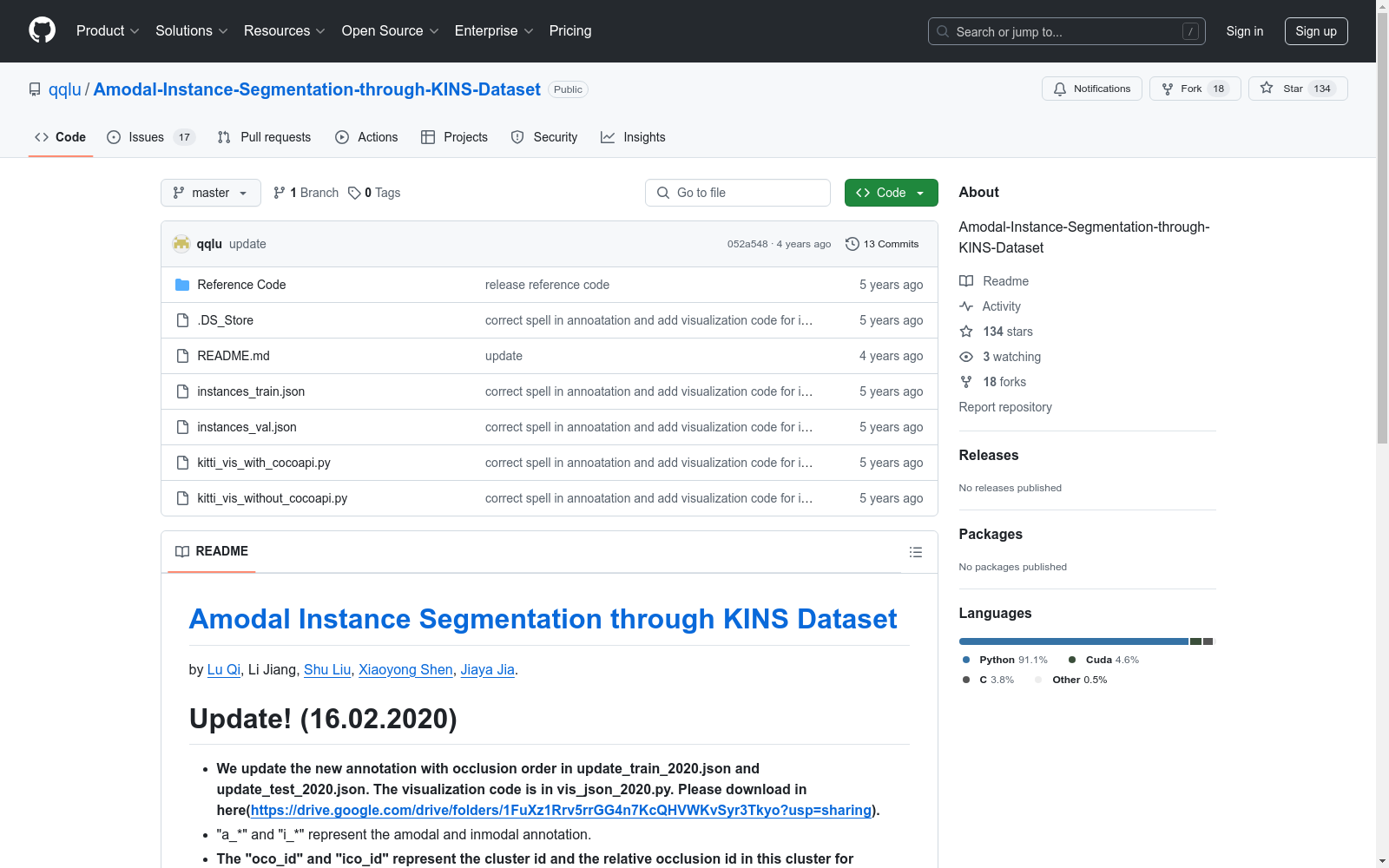

https://github.com/qqlu/Amodal-Instance-Segmentation-through-KINS-Dataset

下载链接

链接失效反馈资源简介:

本仓库发布了KINS的训练和测试集,标注格式遵循COCO风格,可以通过COCOAPI解码掩码。数据集可用于Amodal实例分割,并提供了CVPR 2019论文中方法的参考代码。

This repository releases the training and testing sets of KINS, with annotations following the COCO format, which can be decoded using COCOAPI to extract masks. The dataset is suitable for Amodal instance segmentation and includes reference code for the method described in the CVPR 2019 paper.

创建时间:

2019-06-03

原始信息汇总

数据集名称

Amodal Instance Segmentation through KINS Dataset

数据集作者

- Lu Qi

- Li Jiang

- Shu Liu

- Xiaoyong Shen

- Jiaya Jia

数据集更新

- 2020年2月16日更新了包含遮挡顺序的新标注文件:update_train_2020.json 和 update_test_2020.json。

- 可视化代码位于 vis_json_2020.py。

- 下载链接:Google Drive

标注说明

- "a_" 和 "i_" 分别代表 amodal 和 inmodal 标注。

- "oco_id" 和 "ico_id" 分别代表集群ID和集群内相对遮挡ID。

数据集介绍

- 数据集包含训练和测试集,标注格式遵循COCO风格。

- 掩码可通过COCOAPI解码。

- 参考代码基于 pytorch-detectron。

数据集下载

- 下载地址:KITTI Dataset

- 下载对象数据集的左彩色图像:数据下载

引用信息

@inproceedings{qi2019amodal, title={Amodal Instance Segmentation With KINS Dataset}, author={Qi, Lu and Jiang, Li and Liu, Shu and Shen, Xiaoyong and Jia, Jiaya}, booktitle={Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition}, pages={3014--3023}, year={2019} }

AI搜集汇总

数据集介绍

构建方式

KINS数据集的构建基于KITTI数据集的图像数据,并采用了COCO风格的标注格式。具体而言,数据集通过引入模态和非模态实例分割的标注,进一步细化了遮挡顺序的标注。每个实例被分配到不同的簇中,簇内的实例根据其与摄像机的距离进行遮挡顺序的排序,从而生成详细的遮挡关系标注。这种构建方式旨在为模态实例分割任务提供更为精确和丰富的数据支持。

使用方法

KINS数据集的使用方法相对直观,用户可以通过COCO API解析数据集的标注信息。数据集提供了训练集和测试集,用户可以根据需要下载并使用。此外,数据集还提供了可视化代码,帮助用户更好地理解和分析标注数据。对于希望复现或改进模态实例分割算法的用户,KINS数据集提供了丰富的标注信息和参考代码,基于PyTorch的Detectron框架,用户可以快速上手并进行相关实验。

背景与挑战

背景概述

KINS数据集是由Lu Qi、Li Jiang、Shu Liu、Xiaoyong Shen和Jiaya Jia等研究人员于2019年创建的,旨在推动计算机视觉领域中的模态实例分割(Amodal Instance Segmentation)研究。该数据集基于KITTI数据集,通过引入新的标注方式,特别是遮挡顺序的标注,为研究人员提供了一个更为复杂和真实的场景,以测试和改进模态实例分割算法。KINS数据集的发布不仅丰富了现有的计算机视觉数据资源,还为相关领域的研究提供了新的挑战和机遇,尤其是在处理复杂场景中的遮挡问题方面。

当前挑战

KINS数据集在构建过程中面临了多重挑战。首先,模态实例分割本身就是一个复杂的任务,要求算法不仅能够识别对象的可见部分,还能推断出其被遮挡的部分。其次,数据集的标注过程也极具挑战性,尤其是遮挡顺序的标注,需要精确地确定每个实例的遮挡关系和相对距离。此外,数据集的规模和多样性也对算法的鲁棒性和泛化能力提出了更高的要求。这些挑战不仅推动了模态实例分割技术的发展,也为计算机视觉领域的研究者提供了新的研究方向。

常用场景

经典使用场景

KINS数据集在计算机视觉领域中,特别是模态实例分割(Amodal Instance Segmentation)方面,展现了其经典应用场景。该数据集通过提供详细的遮挡顺序标注,使得研究者能够深入探索物体在不同遮挡情况下的完整形态识别。其COCO风格的标注格式便于与现有算法框架无缝对接,使得研究者可以快速实现并验证新的分割算法。

解决学术问题

KINS数据集解决了计算机视觉中关于物体遮挡和部分可见性识别的关键学术问题。通过提供遮挡顺序和模态与非模态标注,该数据集为研究者提供了一个标准化的测试平台,用以评估和改进模态实例分割算法。这不仅推动了该领域的技术进步,也为相关理论研究提供了丰富的实验数据支持。

实际应用

在实际应用中,KINS数据集的模态实例分割技术可广泛应用于自动驾驶、机器人视觉和增强现实等领域。例如,在自动驾驶系统中,准确识别被部分遮挡的车辆或行人对于确保行车安全至关重要。此外,在增强现实中,精确的物体识别和分割能够提升用户体验,使得虚拟对象与现实环境的融合更加自然。

数据集最近研究

最新研究方向

近年来,KINS数据集在计算机视觉领域,特别是在模态实例分割(Amodal Instance Segmentation)方面,展现了其前沿的研究潜力。该数据集通过引入遮挡顺序的标注(occlusion order),为研究者提供了更为精细的实例分割信息,从而推动了遮挡检测和多物体交互分析的研究。随着深度学习技术的不断进步,KINS数据集的应用范围已扩展至自动驾驶、机器人视觉等实际场景,其对于提升模型在复杂环境下的识别与分割能力具有重要意义。此外,KINS数据集的更新版本进一步优化了标注的细节,为研究者提供了更为丰富的实验数据,促进了相关算法在实际应用中的性能提升。

以上内容由AI搜集并总结生成