OmniFall

收藏arXiv2025-05-26 更新2025-05-28 收录

下载链接:

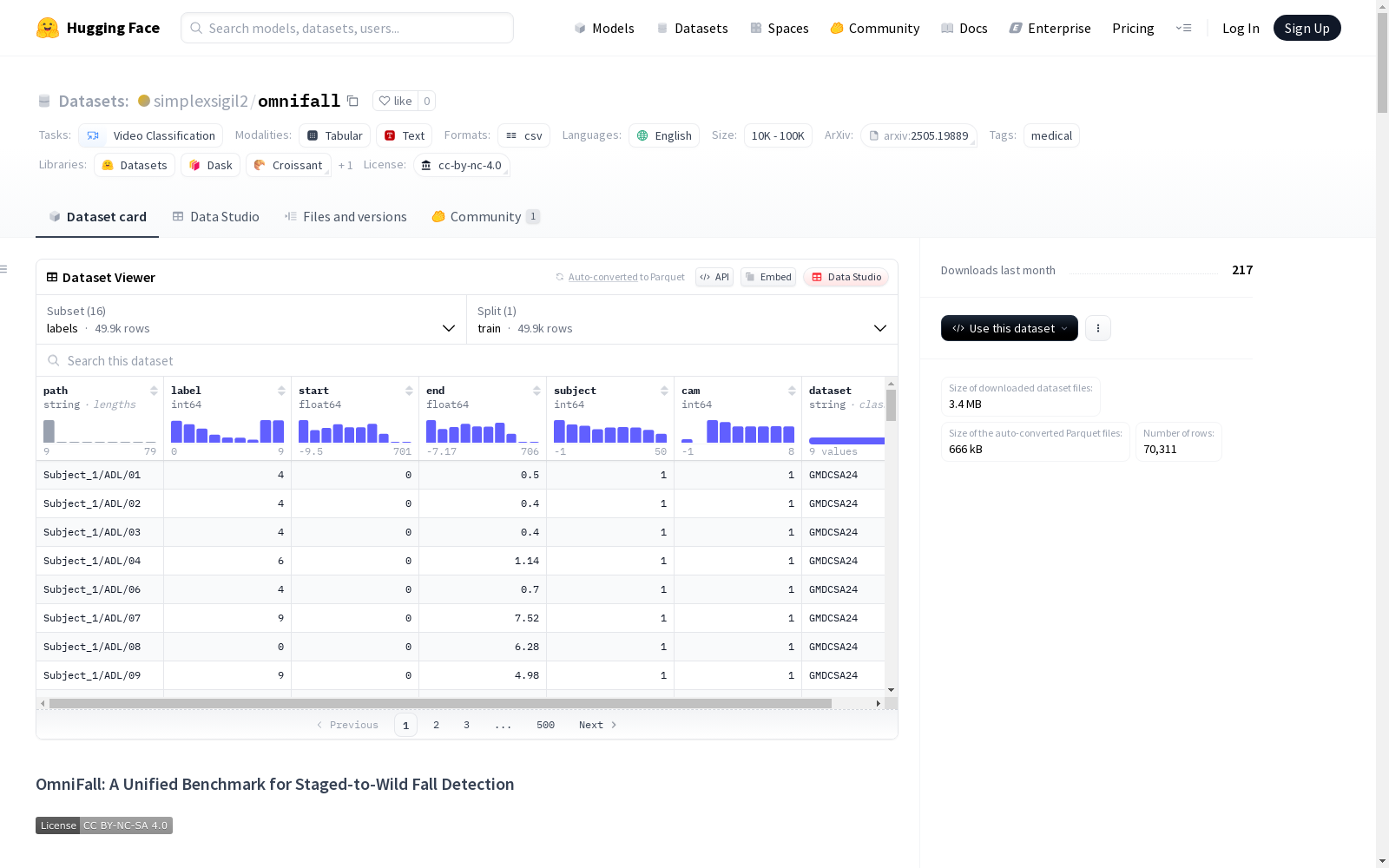

https://huggingface.co/datasets/simplexsigil2/omnifall

下载链接

链接失效反馈资源简介:

OmniFall是一个统一的人体跌倒检测数据集,它统一了八个公开的跌倒检测数据集,包括约14小时的记录、约42小时的多视图数据、101个受试者和29个摄像头视图。该数据集使用一个统一的十类分类法,并提供了标准化的评估协议。此外,OmniFall还包括了从真实事故视频中整理的OOPS-Fall数据集,用于评估模型在真实环境中的泛化能力。

OmniFall is a unified human fall detection dataset that integrates eight publicly available fall detection datasets. It contains approximately 14 hours of recordings, around 42 hours of multi-view data, involving 101 human subjects and 29 camera views. This dataset adopts a unified ten-class taxonomy and provides standardized evaluation protocols. Furthermore, OmniFall includes the OOPS-Fall dataset curated from real-world accident video footage, which is used to evaluate the generalization capability of models in real-world scenarios.

提供机构:

卡尔斯鲁厄理工学院

创建时间:

2025-05-26

原始信息汇总

OmniFall数据集概述

基本信息

- 许可证: CC BY-NC 4.0

- 任务类别: 视频分类

- 语言: 英语

- 标签: 医学

- 数据集名称: OmniFall: A Unified Benchmark for Staged-to-Wild Fall Detection

- 数据规模: 10K < n < 100K

数据集组成

包含以下9个公开数据集:

- CMDFall

- UP Fall

- Le2i

- GMDCSA24

- CAUCAFall

- EDF

- OCCU

- MCFD

- OOPS-Fall

数据结构

配置文件

- labels: 包含所有视频的标签文件

- 文件: labels/GMDCSA24.csv, labels/OOPS.csv等

- cv: 跨视图分割配置

- cs: 跨主体分割配置

- cs-staged: 仅包含实验室数据集的跨主体分割

- cv-staged: 仅包含实验室数据集的跨视图分割

- cs-staged-wild: 实验室数据集训练验证,OOPS-Fall测试

- cv-staged-wild: 实验室数据集训练验证,OOPS-Fall测试

- 各独立数据集配置: OOPS, caucafall, cmdfall等

标签格式

包含以下字段:

- path: 视频路径

- label: 类别ID (0-9)

- start: 开始时间(秒)

- end: 结束时间(秒)

- subject: 主体ID

- cam: 摄像机ID

- dataset: 数据集名称

评估协议

提供多种评估配置:

- 基础配置: default, cs, cv

- 独立数据集配置

- 多数据集评估协议: cs-staged, cv-staged等

引用信息

需引用主论文及所有子数据集论文,提供了完整的BibTeX条目。

许可证

注释和分割定义使用CC BY-NC-SA 4.0许可,原始视频数据需从原来源获取。

联系方式

问题请联系: david.schneider@kit.edu

搜集汇总

数据集介绍

构建方式

OmniFall数据集的构建采用了系统化的方法,整合了八个公开的跌倒检测数据集,涵盖了约14小时的单视角录像和42小时的多视角数据,涉及101名受试者和29个摄像机视角。通过统一的十类分类法和标准化的评估协议,该数据集实现了跨数据集的公平比较。此外,研究者还从真实事故视频中筛选出OOPS-Fall子集,建立了从受控环境到非受控环境的评估流程,以衡量模型的泛化能力。

特点

OmniFall数据集的特点在于其多样性和全面性。它不仅包含了丰富的受控环境下的跌倒数据,还引入了真实世界中的意外跌倒场景,从而填补了现有研究在非受控环境下评估的空白。数据集的十类分类法区分了瞬时动作(如跌倒、坐下)和静态状态(如跌倒后躺卧),有助于开发既能检测跌倒事件又能识别关键医疗状态的系统。此外,数据集提供了完整的视频分割标签,支持细粒度的动作分析。

使用方法

OmniFall数据集的使用方法包括跨受试者和跨视角的评估协议。研究者可以通过将多个数据集的训练分区合并为一个源域,来训练模型,并在OOPS-Fall测试集上评估其在非受控环境中的表现。数据集支持多种评估指标,如平衡准确率、敏感性和特异性,适用于十类分类任务和二分类跌倒检测任务。此外,数据集还可用于时间线分割任务,通过MS-TCN++等模型进行动作分割分析。

背景与挑战

背景概述

OmniFall数据集由卡尔斯鲁厄理工学院的研究团队于2025年提出,旨在解决视频跌倒检测领域长期存在的领域偏差问题。该研究由David Schneider等人主导,整合了8个公开跌倒检测数据集(约14小时单视角视频、42小时多视角数据),构建了首个包含真实意外跌倒场景的标准化基准。数据集创新性地采用十级分类法区分瞬时动作(如跌倒、坐下)与持续状态(如跌倒后躺卧),重点关注医学上关键的'长躺'状态检测。这一工作填补了跌倒检测系统从实验室环境到真实场景的评估空白,为老年监护领域的计算机视觉应用提供了重要研究基础。

当前挑战

OmniFall面临的核心挑战体现在两方面:在领域问题层面,现有跌倒检测系统难以区分真实跌倒与相似动作(如主动躺卧),且在跨环境泛化中存在显著性能下降;在构建过程中,研究团队需克服多源数据集标注体系不兼容(如UR Fall缺乏主体标注)、视觉特征异构(如MUVIM仅含俯视视角)、以及真实意外视频样本稀缺等难题。实验表明,即使采用I3D等预训练骨干网络,模型在受控环境与真实场景间的性能差距仍高达45%,凸显了视觉表征对领域偏移的敏感性。

常用场景

经典使用场景

OmniFall数据集在计算机视觉领域被广泛用于跌倒检测算法的开发与评估。该数据集整合了八个公开的跌倒检测数据集,提供了14小时的记录和42小时的多视角数据,涵盖了101名受试者和29个摄像机视角。其标准化的十类分类法和评估协议使得研究者能够在统一框架下进行跨数据集的公平比较。

实际应用

OmniFall的实际应用主要集中在老年人健康监护领域。跌倒检测系统可以部署在养老院或家庭环境中,通过实时监测老年人的活动状态,及时发现跌倒事件并触发警报。这种技术能够显著减少因跌倒导致的长期躺卧时间,从而降低并发症的风险,提高老年人的生活质量。

衍生相关工作

OmniFall的推出促进了多个相关研究方向的进展。例如,基于该数据集的实验揭示了I3D和VideoMAE等预训练模型在跨域泛化中的性能差异。此外,该数据集还激发了针对真实世界跌倒场景的算法优化研究,如如何在复杂背景和光照条件下提高检测精度。这些工作进一步推动了跌倒检测技术在实际应用中的可靠性和鲁棒性。

以上内容由遇见数据集搜集并总结生成