MMMR

收藏arXiv2025-05-22 更新2025-05-24 收录

下载链接:

https://mmmr-benchmark.github.io/

下载链接

链接失效反馈资源简介:

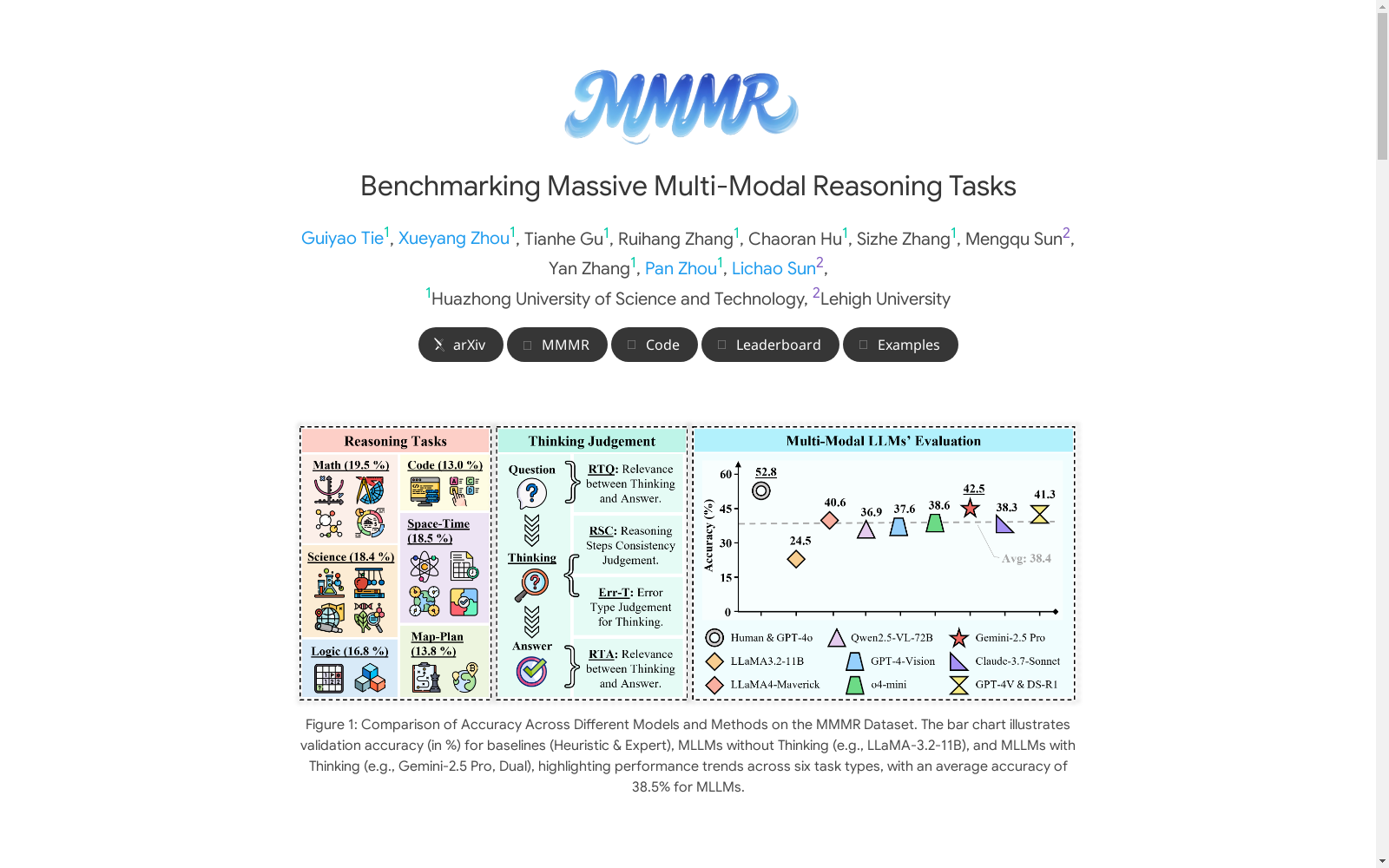

MMMR是一个专为评估多模态大语言模型(MLLMs)的推理能力而设计的数据集。它包含了1083个高难度的问题,涵盖了逻辑、数学、时空、代码、地图和科学六个推理领域。每个问题都融合了文本、图像、表格和图表等多种模态,要求模型进行结构化、符号化和抽象推理。数据集分为验证集和测试集,用于评估模型的推理质量和结构完整性。MMMR旨在帮助研究人员更好地理解和改进多模态推理模型,推动该领域的发展。

提供机构:

华中科技大学, 里海大学

创建时间:

2025-05-22

原始信息汇总

MMMR数据集概述

数据集简介

- 名称:MMMR (Massive Multi-Modal Reasoning)

- 目的:评估多模态大语言模型(MLLMs)在增强中间思维轨迹(MLLMs-T)时的推理能力

- 特点:

- 包含1,083个高难度问题

- 涵盖6种推理类型

- 具有符号深度和多跳需求

- 包含模块化推理轨迹评估管道(RTEP)

数据集组成

- 任务类型:

- 逻辑推理(Logical Reasoning)

- 数学推理(Mathematical Reasoning)

- 时空理解(Spatio-Temporal Understanding)

- 编码(Coding)

- 地图导航(Map Navigation)

- 科学推理(Scientific Reasoning)

- 数据划分:

- 验证集:106个样本

- 测试集:977个样本

- 模态:文本描述、图像和结构化数据(如表格、图形)

性能评估

- 评估指标:

- 准确性(Accuracy %)

- 推理质量(相关性、一致性和结构化错误注释)

- 基准模型表现:

- 随机选择:22.1%(验证集)

- 频繁选择:26.8%(验证集)

- 专家(仅人类):29.23%(验证集)

- 专家(人类+GPT-4o):52.85%(验证集)

模型表现对比

- 最佳无思维模型:

- LLaMA-4-Maverick:40.68%(验证集)

- 最佳有思维模型:

- Gemini-2.5 Pro:42.45%(验证集)

统计信息

- 平均准确率:38.5%(MLLMs)

- 任务分布:

- 逻辑:182题

- 数学:212题

- 时空:200题

- 编码:141题

- 地图:150题

- 科学:198题

引用信息

bibtex @inproceedings{tie2025mmmr, title={MMMR: Benchmarking Massive Multi-Modal Reasoning Tasks}, author={Guiyao Tie and Xueyang Zhou and Tianhe Gu and Ruihang Zhang and Chaoran Hu and Sizhe Zhang and Mengqu Sun and Yan Zhang and Pan Zhou and Lichao Sun}, booktitle={Proceedings of the NeurIPS 2025 Datasets and Benchmarks Track}, year={2025}, }

AI搜集汇总

数据集介绍

构建方式

MMMR数据集通过精心设计的三个阶段构建流程,系统性地整合了多模态推理任务。研究团队首先从网络、教材及重构来源收集了1,083个高难度样本,覆盖逻辑推理、数学运算、时空理解等六大领域,每个任务均融合文本、图像和结构化数据。通过专家标注和双重验证机制确保样本质量,并采用模块化的推理轨迹评估管道(RTEP)对中间思维过程进行结构化标注,最终形成包含验证集(106样本)和测试集(977样本)的标准划分。

特点

该数据集以推理深度为核心特色,包含15种图像类型和16个子领域的细粒度分类体系。其独特价值体现在:1)采用思维轨迹评估指标(RTQ/RTA/RSC)量化推理过程的相关性与一致性;2)设计符号抽象与多跳推理结合的复合型任务,如三维逻辑重构与化学过渡态分析;3)44.6%的重构样本增强了跨模态对齐复杂度,平均每个问题需3.42个推理步骤,95.2%的任务强制要求多模态信息整合。

使用方法

使用MMMR需遵循其三级评估框架:首先加载标准化输入格式(含图文交织的问题描述和选项),通过RTEP管道生成模型的思维轨迹与最终答案。评估时需同时计算答案准确率(ACC)和思维质量指标(RTQ/RTA≥0.75为合格),并参照错误类型标注(如过度思维、不一致性)进行归因分析。对于对比研究,建议采用控制变量法测试不同模态组合下的模型表现,特别注意科学和代码领域存在的10.3%人机性能差距。

背景与挑战

背景概述

MMMR(Massive Multi-Modal Reasoning)基准数据集由华中科技大学和利哈伊大学的研究团队于2025年5月提出,旨在系统评估多模态大语言模型(MLLMs)在复杂推理任务中的表现。该数据集包含1,083个高难度问题,涵盖逻辑推理、数学问题求解、时空理解、代码推理、地图规划和科学分析六大领域,强调跨模态对齐和符号化深度推理。其创新性在于引入了模块化的推理痕迹评估管道(RTEP),通过相关性、一致性和错误类型标注等指标,首次实现了对模型中间推理过程的标准化评估。MMMR填补了现有基准在推理质量诊断方面的空白,为多模态认知架构的发展提供了可扩展的评估框架。

当前挑战

MMMR面临的挑战主要体现在两个维度:领域问题层面,现有MLLMs在符号抽象、多跳推理和跨模态对齐任务中表现不佳,即使引入思维链的模型(如Claude-3.7-Sonnet)仍存在逻辑不一致和过度推理等病理现象;数据构建层面,需平衡六类推理任务的难度分布,确保1,083个问题的模态多样性(15种图像类型)和标注可靠性,同时设计RTEP管道时需解决自动评估中语义对齐、跨模态一致性验证等关键技术难题。实验表明,最佳模型与人类专家性能仍存在10.3%的差距,凸显多模态推理系统在准确性表面之下隐藏的深层次认知缺陷。

常用场景

经典使用场景

MMMR数据集在评估多模态大型语言模型(MLLMs)的推理能力方面具有经典应用场景。该数据集通过涵盖逻辑推理、数学问题解决、时空理解、代码推理、地图规划和科学分析等六个领域的高难度任务,为研究者提供了一个标准化平台,用以测试模型在复杂多模态环境中的表现。特别是在需要符号抽象和多步推理的任务中,MMMR能够有效衡量模型是否能够生成连贯且符合认知逻辑的中间推理过程。

衍生相关工作

MMMR数据集催生了一系列关于多模态推理评估的衍生研究。例如,基于其RTEP框架的工作开始关注推理痕迹的忠实度和认知对齐问题;部分研究尝试将MMMR的任务设计扩展到更具挑战性的零样本学习场景。此外,该数据集启发了对混合人类-AI协作推理系统的评估,如专家与GPT-4o的协同表现分析,为未来人机协同智能的发展提供了基准范式。

数据集最近研究

最新研究方向

随着多模态大语言模型(MLLMs)的快速发展,MMMR数据集应运而生,旨在系统评估模型在多模态推理任务中的表现。该数据集聚焦于逻辑推理、数学问题求解、时空理解、代码推理、地图规划和科学分析等六大领域,通过1,083个高难度问题挑战模型的推理能力。前沿研究主要围绕推理过程的质量评估展开,特别是对中间思维轨迹(Thinking Traces)的标准化评测。研究热点包括开发模块化的推理轨迹评估流程(RTEP),通过相关性(RTQ、RTA)、一致性(RSC)等指标深入分析模型的推理缺陷,如逻辑不一致性和过度思考等问题。这一研究方向不仅揭示了当前模型在准确性与推理质量之间的差距,还为未来多模态推理系统的优化提供了可操作的评估框架。

相关研究论文

- 1MMMR: Benchmarking Massive Multi-Modal Reasoning Tasks华中科技大学, 里海大学 · 2025年

以上内容由AI搜集并总结生成