U2-BENCH

收藏arXiv2025-05-23 更新2025-05-27 收录

下载链接:

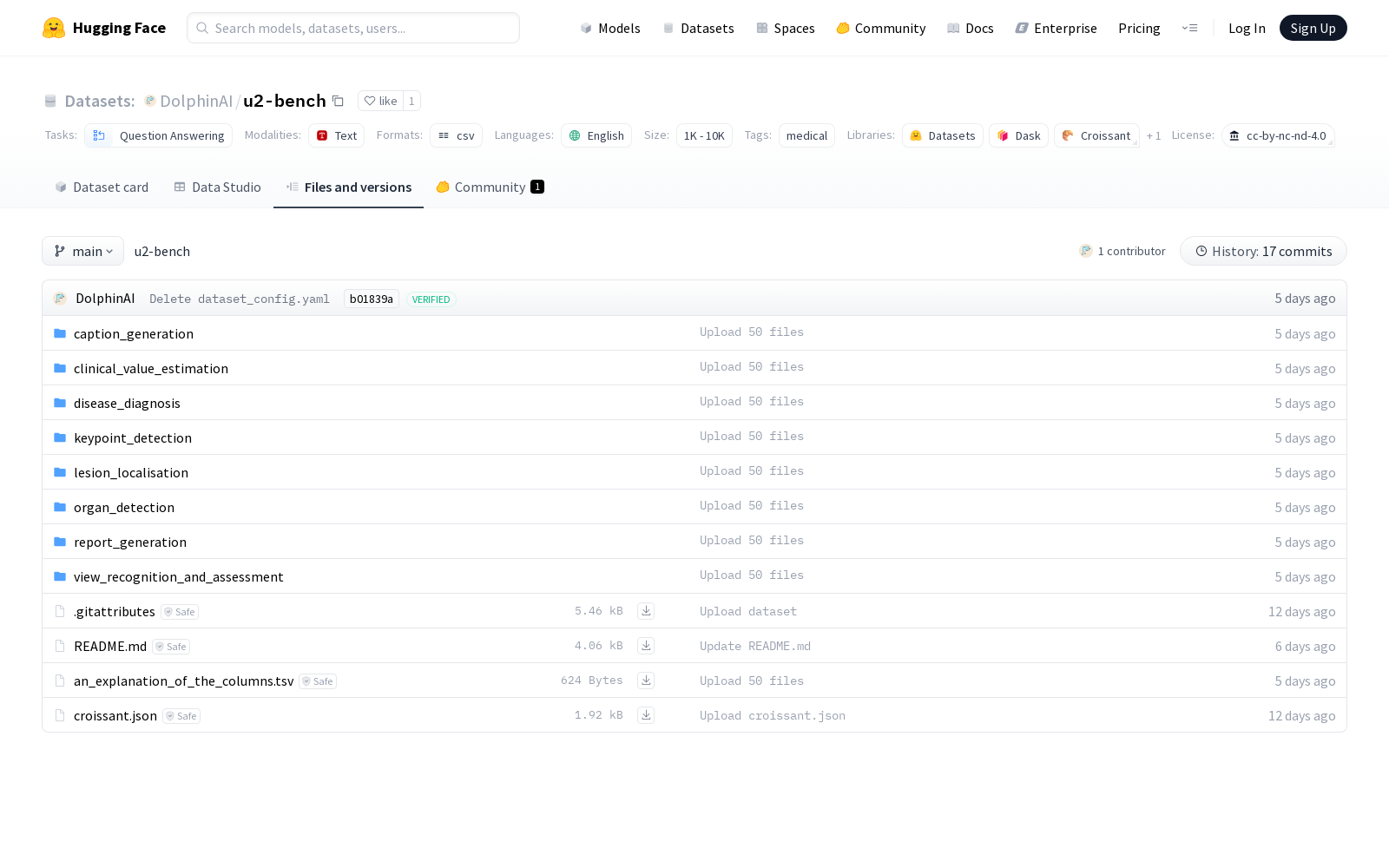

https://huggingface.co/datasets/DolphinAI/u2-bench/tree/main

下载链接

链接失效反馈官方服务:

资源简介:

U2-BENCH数据集是首个全面评估大型视觉语言模型在超声理解方面的基准数据集,涵盖15个解剖区域,7241个病例,并定义了8个临床相关任务,包括诊断、视图识别、病变定位、临床价值评估和报告生成等,共涉及50个超声应用场景。数据集旨在解决超声图像解释中存在的挑战,如操作者依赖、噪声和解剖复杂性等问题。该数据集为LVLM研究提供了严格的统一测试平台,有助于推动LVLM在医疗超声影像领域的多模态理解研究。

U2-BENCH is the first comprehensive benchmark dataset for evaluating large vision-language models (LVLMs) on ultrasound comprehension. It encompasses 15 anatomical regions and 7241 clinical cases, and defines 8 clinically relevant tasks covering a total of 50 ultrasound application scenarios, including diagnosis, view recognition, lesion localization, clinical value assessment, report generation and more. This dataset aims to address the challenges existing in ultrasound image interpretation, such as operator dependence, image noise and anatomical complexity. It provides a rigorous and unified testbed for LVLM research, which helps promote multimodal understanding studies of LVLMs in the field of medical ultrasound imaging.

提供机构:

香港浸会大学

创建时间:

2025-05-23

搜集汇总

数据集介绍

构建方式

U2-BENCH数据集通过系统化的数据收集与标注流程构建,涵盖15个解剖区域的7,241例超声案例。研究团队从40个授权数据源中精选样本,采用病例级别的分层抽样策略确保解剖分布均衡性。数据预处理阶段实施严格的自动化过滤与三重交叉验证的人工审核机制,包括图像格式标准化、关键帧提取及结构化标注转换。针对8类临床任务设计了50种应用场景的标准化提示模板,每个模板包含临床角色定义、任务说明和输出格式规范,以保障评估的一致性与可重复性。

使用方法

使用U2-BENCH需遵循标准化评估协议:首先加载预处理后的DICOM或PNG格式图像及JSON标注文件,通过统一提示模板将原始数据转换为模型输入。评估时调用OpenCompass VLMEvalKit框架,对20个LVLM模型执行批量推理。分类任务采用准确率与F1值,检测任务转化为位置分类评估,回归任务计算RMSE与MAE,文本生成任务使用BLEU-4和ROUGE指标。最终通过加权聚合的U2-Score(权重与样本量成正比)实现模型能力的整体量化比较。用户可通过HuggingFace接口获取数据,或使用提供的Colab Notebook快速复现基准测试。

背景与挑战

背景概述

U2-BENCH是由Dolphin AI、牛津大学、北京航空航天大学等机构的研究团队于2025年推出的首个专注于超声理解的大规模视觉语言模型评测基准。该数据集汇集了来自40个授权数据源的7,241例超声病例,涵盖15个解剖区域和8类临床任务,旨在系统评估LVLMs在超声图像分类、检测、回归和文本生成等多模态任务中的表现。作为超声AI领域的重要里程碑,U2-BENCH通过标准化50个临床应用场景的评估流程,为医学多模态智能研究提供了统一的测试平台。

当前挑战

U2-BENCH面临双重挑战:在领域问题层面,需解决超声图像特有的操作者依赖性、噪声干扰和解剖结构动态性带来的识别难题,尤其在空间推理(如病灶定位)和临床语言生成(如结构化报告)任务中表现显著不足;在构建过程中,需克服多源数据标注异构性(如15个解剖区域的标签体系差异)、视频帧关键帧提取(处理3D动态序列的时序信息),以及医学术语与自然语言的对齐问题(确保生成的报告符合临床规范)。此外,数据平衡性(甲状腺和乳腺病例占比超1/3)与评估指标设计(兼顾分类准确性和文本生成质量)也构成重要挑战。

常用场景

经典使用场景

U2-BENCH数据集在医学影像分析领域具有广泛的应用场景,特别是在超声图像的理解和诊断任务中。该数据集涵盖了15个解剖区域的7,241个病例,包括分类、检测、回归和文本生成等8种临床任务。其经典使用场景包括疾病诊断、视图识别与评估、病变定位、器官检测、关键点检测、临床价值估计、报告生成和标题生成等。这些任务不仅覆盖了超声图像的基本分析需求,还涉及复杂的空间推理和临床语言生成,为研究人员提供了一个全面的测试平台。

解决学术问题

U2-BENCH数据集解决了医学影像分析中的多个关键学术问题。首先,它填补了超声图像理解领域的空白,为大型视觉语言模型(LVLM)在超声图像上的性能评估提供了首个综合性基准。其次,该数据集通过多样化的任务设计,解决了模型在空间推理和临床语言生成方面的挑战。此外,U2-BENCH还揭示了模型在图像级分类任务中的强表现与在空间推理任务中的局限性,为未来的研究方向提供了重要启示。

实际应用

在实际应用中,U2-BENCH数据集为医疗AI的开发提供了重要支持。其丰富的临床任务和多样化的解剖区域覆盖,使得该数据集能够用于开发自动化诊断工具、辅助医生进行超声图像分析以及优化临床工作流程。例如,在疾病诊断任务中,模型可以帮助识别超声图像中的恶性病变;在报告生成任务中,模型可以自动生成结构化的临床报告,减轻医生的工作负担。这些应用不仅提高了诊断效率,还提升了医疗服务的可及性。

数据集最近研究

最新研究方向

随着医学影像与人工智能技术的深度融合,U2-BENCH数据集的推出标志着超声影像理解领域的重要突破。该数据集聚焦于大型视觉语言模型(LVLM)在超声影像多模态理解中的性能评估,涵盖了分类、检测、回归和文本生成等8项临床任务,涉及15个解剖区域和50种应用场景。最新研究揭示了LVLM在超声理解中的显著性能差异:在图像级分类任务中表现优异,但在空间推理和临床报告生成等需要复杂语义理解的任务中仍面临挑战。这一发现为未来研究指明了方向,即通过增强模型的解剖学知识嵌入和空间关系建模能力,提升其在动态超声影像中的临床决策支持价值。数据集建立的标准化评估框架,为跨模态医学人工智能的发展提供了重要基准。

相关研究论文

- 1U2-BENCH: Benchmarking Large Vision-Language Models on Ultrasound Understanding香港浸会大学 · 2025年

以上内容由遇见数据集搜集并总结生成