COCO

收藏github2021-11-18 更新2024-05-31 收录

下载链接:

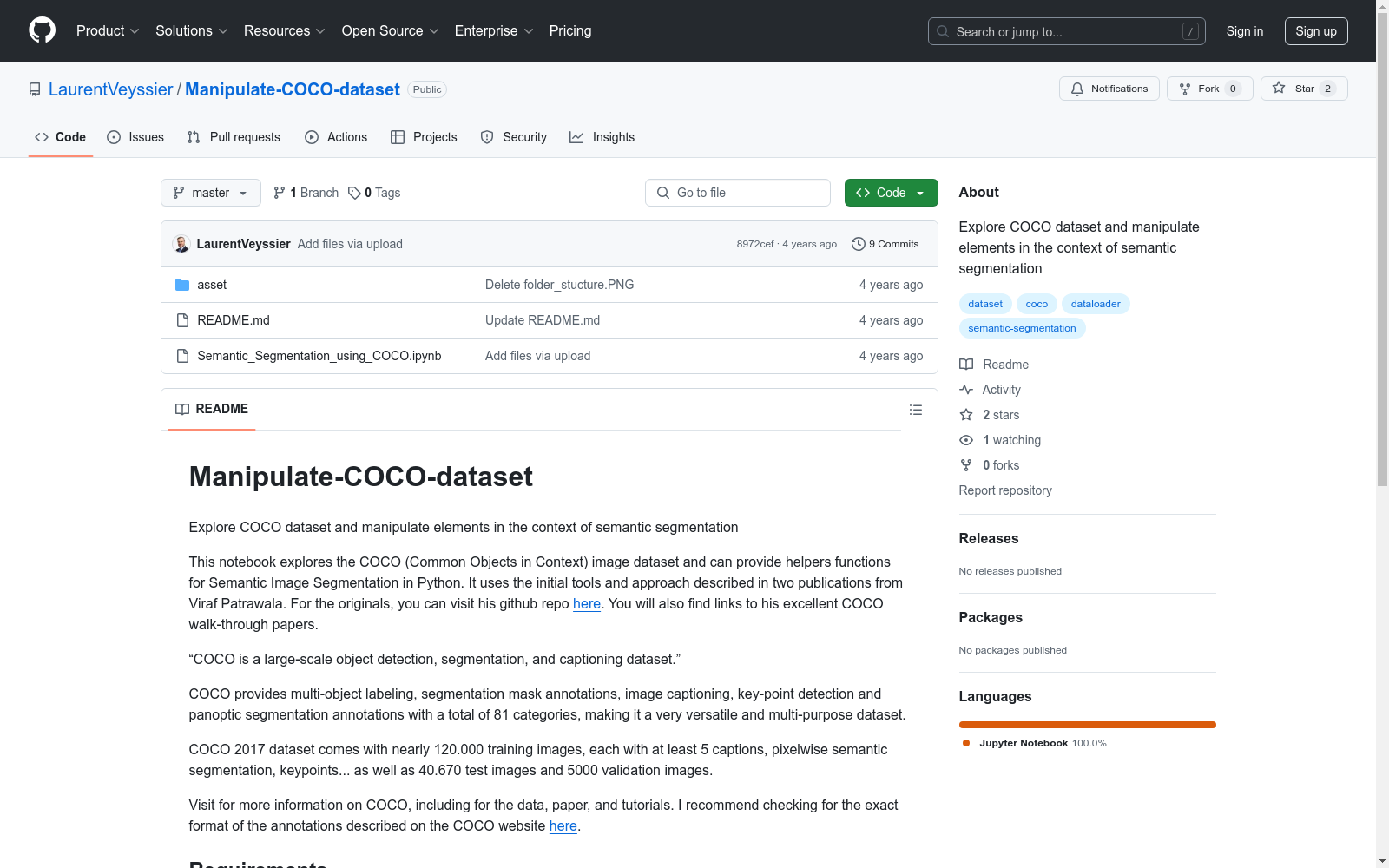

https://github.com/LaurentVeyssier/Manipulate-COCO-dataset

下载链接

链接失效反馈资源简介:

COCO是一个大规模的对象检测、分割和标题数据集,提供多对象标注、分割掩码注释、图像标题、关键点检测和全景分割注释,共有81个类别,是一个多功能和多用途的数据集。

COCO is a large-scale dataset for object detection, segmentation, and captioning, offering multi-object annotations, segmentation mask annotations, image captions, keypoint detection, and panoptic segmentation annotations. It encompasses 81 categories, making it a versatile and multifunctional dataset.

创建时间:

2020-08-30

原始信息汇总

数据集概述

数据集名称

- COCO (Common Objects in Context)

数据集用途

- 对象检测

- 语义分割

- 图像标注

- 关键点检测

- 全景分割

数据集特点

- 包含81个类别

- 提供多对象标注、分割掩码标注、图像标注、关键点检测和全景分割标注

数据集版本

- COCO 2017

数据集内容

- 约120,000训练图像,每张图像至少有5个标注

- 像素级语义分割

- 关键点信息

- 40,670测试图像

- 5,000验证图像

数据集下载

- 下载链接:COCO数据集

- 大小:超过24GB

数据集API

- 下载链接:COCO API

- 提供Matlab、Python、Lua API,用于加载、解析和可视化COCO数据集的标注

搜集汇总

数据集介绍

构建方式

COCO数据集的构建基于对大规模图像数据的广泛收集与标注。该数据集涵盖了超过30万张图像,其中包含超过200万个对象实例,每个实例均被精细地标注了边界框、类别标签以及分割掩码。构建过程中,研究团队采用了多阶段的数据筛选与验证机制,确保了数据的高质量和多样性。此外,COCO还引入了上下文信息和场景描述,进一步丰富了数据集的语义层次。

特点

COCO数据集以其丰富的标注信息和多样的应用场景著称。其特点在于不仅提供了对象的边界框和类别信息,还包含了详细的实例分割和语义分割标注,这使得该数据集在计算机视觉领域的多个任务中具有广泛的应用价值。此外,COCO数据集还特别强调了对象之间的上下文关系和场景理解,这为研究复杂场景下的视觉任务提供了宝贵的资源。

使用方法

COCO数据集广泛应用于图像识别、目标检测、实例分割和语义分割等计算机视觉任务。研究人员可以通过加载COCO数据集的预处理版本,快速进行模型训练和验证。数据集提供了丰富的API和工具,支持用户自定义数据加载和处理流程。此外,COCO还定期举办挑战赛,鼓励学术界和工业界共同推动计算机视觉技术的发展。

背景与挑战

背景概述

COCO(Common Objects in Context)数据集是由微软研究院于2014年创建的,旨在推动计算机视觉领域的发展。该数据集由Tsung-Yi Lin等研究人员主导,包含了超过33万张图像,涵盖了80个常见对象类别。COCO数据集的核心研究问题是如何在复杂场景中进行精确的对象检测和分割,这对于自动驾驶、机器人导航和人机交互等领域具有重要意义。其发布极大地促进了深度学习在图像识别和语义分割方面的应用,成为许多先进算法的标准基准。

当前挑战

尽管COCO数据集在对象检测和分割领域取得了显著成就,但其构建和应用过程中仍面临诸多挑战。首先,数据集的标注工作复杂且耗时,需要大量的人工参与,以确保标注的准确性和一致性。其次,处理大规模图像数据集时,计算资源的消耗和存储需求巨大,这对硬件设施提出了高要求。此外,如何在多样化的场景和光照条件下保持模型的鲁棒性,也是当前研究的重点和难点。

发展历史

创建时间与更新

COCO数据集由微软研究院于2014年首次发布,旨在推动计算机视觉领域的研究。该数据集自发布以来,经历了多次更新,最近一次重大更新是在2017年,进一步丰富了数据内容和标注质量。

重要里程碑

COCO数据集的发布标志着计算机视觉领域的一个重要里程碑。其首次引入的大规模、多类别的图像数据,极大地推动了物体检测、分割和图像描述等任务的研究。2015年,COCO数据集首次举办了COCO挑战赛,吸引了全球研究者的广泛参与,进一步提升了数据集的影响力。此后,每年的COCO挑战赛成为评估和比较最新计算机视觉算法的重要平台。

当前发展情况

当前,COCO数据集已成为计算机视觉领域最广泛使用的基准数据集之一。其丰富的标注信息和多样化的图像数据,为深度学习模型的训练和评估提供了坚实的基础。COCO数据集不仅在学术研究中占据重要地位,也在工业界得到了广泛应用,推动了自动驾驶、智能监控等实际应用的发展。未来,随着数据集的不断更新和扩展,COCO将继续引领计算机视觉技术的进步。

发展历程

- COCO数据集首次发表,由微软研究院提出,旨在推动图像识别和物体检测领域的发展。

- COCO数据集首次应用于图像分割任务,展示了其在多任务学习中的潜力。

- COCO数据集成为国际计算机视觉竞赛(COCO Challenges)的官方数据集,吸引了全球研究者的参与。

- COCO数据集的版本更新,增加了更多的图像和标注,提升了数据集的多样性和复杂性。

- COCO数据集在自然语言处理(NLP)与计算机视觉(CV)的跨领域研究中得到广泛应用,推动了多模态学习的发展。

常用场景

经典使用场景

在计算机视觉领域,COCO数据集以其丰富的多类别标注和复杂的场景结构,成为物体检测、分割和图像描述任务的经典基准。研究者们利用COCO数据集进行模型训练,以提升算法在复杂环境中的识别精度和鲁棒性。通过分析COCO数据集中的大量实例,研究者能够深入理解不同物体在各种场景中的表现,从而推动算法的优化和创新。

衍生相关工作

基于COCO数据集,研究者们开发了多种先进的计算机视觉算法和模型。例如,Mask R-CNN通过结合COCO数据集的实例分割任务,实现了高效的物体检测和分割。此外,COCO数据集还催生了诸如Faster R-CNN和YOLO等经典物体检测框架的改进版本,进一步推动了计算机视觉技术的发展和应用。

数据集最近研究

最新研究方向

在计算机视觉领域,COCO(Common Objects in Context)数据集的最新研究方向主要集中在多模态学习和自监督学习上。研究者们致力于通过结合图像和文本数据,提升模型对复杂场景的理解能力。例如,一些研究通过引入自然语言描述来增强图像识别的准确性,从而在零样本学习和少样本学习任务中取得显著进展。此外,自监督学习方法的引入,使得模型能够在无标签数据上进行预训练,进一步提高了模型的泛化能力和鲁棒性。这些研究不仅推动了计算机视觉技术的发展,也为智能系统的实际应用提供了新的可能性。

相关研究论文

- 1Microsoft COCO: Common Objects in ContextMicrosoft Research · 2014年

- 2Deep Residual Learning for Image RecognitionMicrosoft Research · 2015年

- 3Focal Loss for Dense Object DetectionFacebook AI Research · 2017年

- 4Mask R-CNNFacebook AI Research · 2017年

- 5YOLOv3: An Incremental ImprovementUniversity of Washington · 2018年

以上内容由遇见数据集搜集并总结生成