LSMDC (Large-scale Movie Description Challenge)|视频分析数据集|自然语言处理数据集

收藏

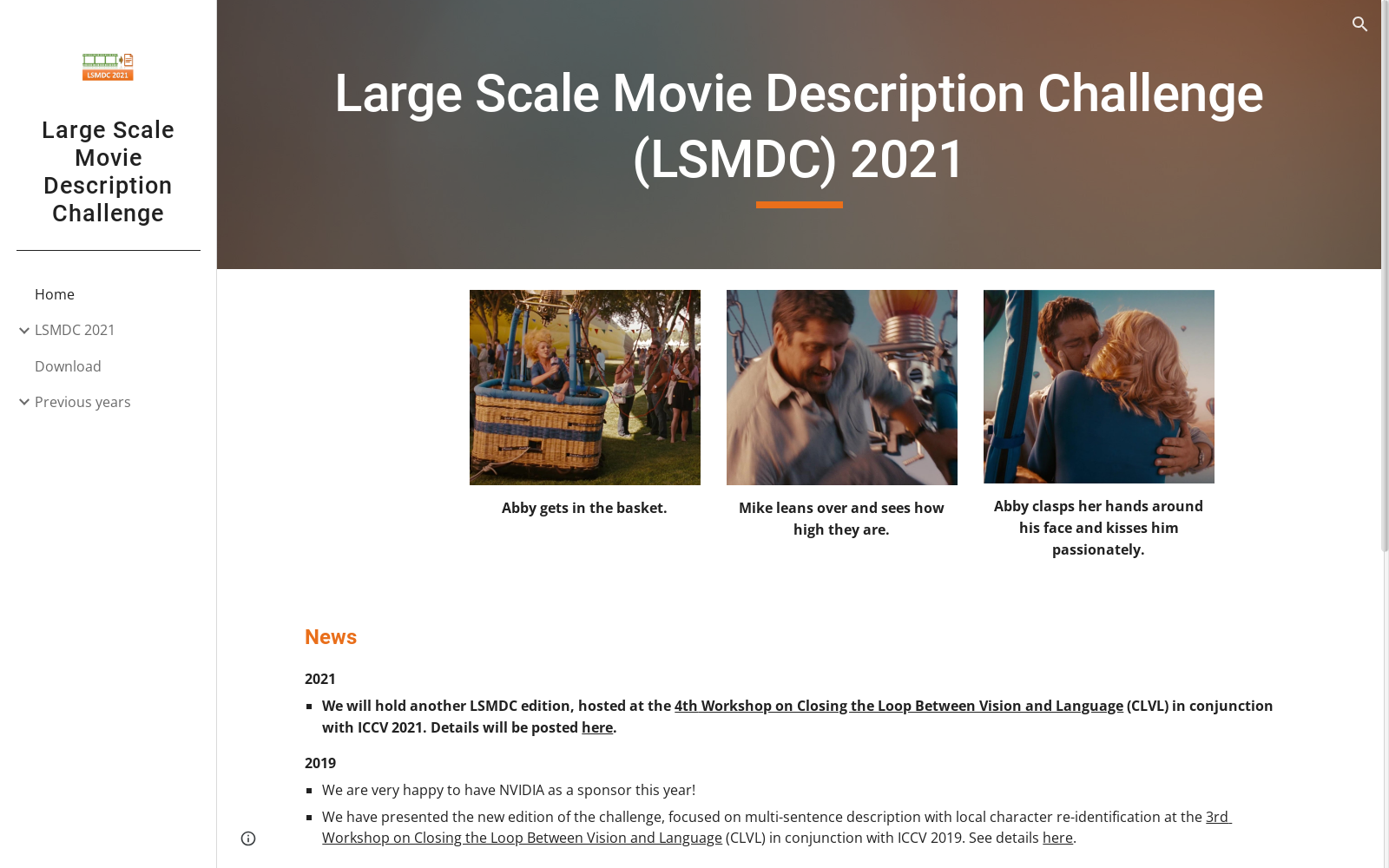

- LSMDC数据集首次发表,标志着大规模电影描述挑战的开始。

- LSMDC首次应用于计算机视觉和自然语言处理领域的研究,推动了视频内容理解和描述技术的发展。

- LSMDC数据集在多个国际会议和竞赛中被广泛使用,成为评估视频描述生成模型性能的重要基准。

- LSMDC数据集的扩展版本发布,增加了更多的电影片段和描述,进一步丰富了数据集的内容和多样性。

- LSMDC数据集在多模态学习领域的研究中得到广泛应用,促进了视频和文本数据联合建模技术的发展。

- LSMDC数据集的最新研究成果在多个顶级期刊和会议上发表,展示了其在视频内容理解和生成领域的持续影响力。

LFW

人脸数据集;LFW数据集共有13233张人脸图像,每张图像均给出对应的人名,共有5749人,且绝大部分人仅有一张图片。每张图片的尺寸为250X250,绝大部分为彩色图像,但也存在少许黑白人脸图片。 URL: http://vis-www.cs.umass.edu/lfw/index.html#download

AI_Studio 收录

AgiBot World

为了进一步推动通用具身智能领域研究进展,让高质量机器人数据触手可及,作为上海模塑申城语料普惠计划中的一份子,智元机器人携手上海人工智能实验室、国家地方共建人形机器人创新中心以及上海库帕思,重磅发布全球首个基于全域真实场景、全能硬件平台、全程质量把控的百万真机数据集开源项目 AgiBot World。这一里程碑式的开源项目,旨在构建国际领先的开源技术底座,标志着具身智能领域 「ImageNet 时刻」已到来。AgiBot World 是全球首个基于全域真实场景、全能硬件平台、全程质量把控的大规模机器人数据集。相比于 Google 开源的 Open X-Embodiment 数据集,AgiBot World 的长程数据规模高出 10 倍,场景范围覆盖面扩大 100 倍,数据质量从实验室级上升到工业级标准。AgiBot World 数据集收录了八十余种日常生活中的多样化技能,从抓取、放置、推、拉等基础操作,到搅拌、折叠、熨烫等精细长程、双臂协同复杂交互,几乎涵盖了日常生活所需的绝大多数动作需求。

github 收录

YOLO-dataset

该数据集用于训练YOLO模型,包括分类、检测和姿态识别模型。目前支持v8版本,未来计划支持更多版本。

github 收录

UAVDT

UAVDT数据集由中国科学院大学等机构创建,包含约80,000帧从10小时无人机拍摄视频中精选的图像,覆盖多种复杂城市环境。数据集主要关注车辆目标,每帧均标注了边界框及多达14种属性,如天气条件、飞行高度、相机视角等。该数据集旨在推动无人机视觉技术在不受限制场景下的研究,解决高密度、小目标、相机运动等挑战,适用于物体检测、单目标跟踪和多目标跟踪等基础视觉任务。

arXiv 收录

FER2013

FER2013数据集是一个广泛用于面部表情识别领域的数据集,包含28,709个训练样本和7,178个测试样本。图像属性为48x48像素,标签包括愤怒、厌恶、恐惧、快乐、悲伤、惊讶和中性。

github 收录