ToolMind

收藏Hugging Face2025-10-23 更新2025-10-24 收录

下载链接:

https://huggingface.co/datasets/Nanbeige/ToolMind

下载链接

链接失效反馈资源简介:

ToolMind是一个大型的开源工具使用数据集,包含推理轨迹,旨在提高代理型大型语言模型的推理和工具调用能力。该数据集通过图采样的方式合成超过160k的回合,涉及超过20k的工具。数据集通过将功能组织为图结构中的节点,采样图上的路径来构建复杂高质量的用户意图,并通过多智能体方式合成轨迹。每个轨迹回合都通过思考模型进行推理回答和正确性过滤,只保留正确且有价值的回合。在Tau-bench、Tau2-bench和BFCL-v4代理基准测试中,使用ToolMind进行微调的模型表现出显著的改进。

创建时间:

2025-10-21

原始信息汇总

ToolMind数据集概述

数据集基本信息

- 许可证: Apache-2.0

- 任务类别: 文本生成

- 语言: 英语

- 标签: 函数调用、工具调用、合成数据

- 官方名称: ToolMind

数据集构成

数据文件配置

- 配置名称: test

- 数据文件分割:

- graph-based-synthetic-data: data/graphsyn.jsonl

- xlam-function-calling-60k: data/xlam-function-calling-60k-query.jsonl

- When2Call: data/When2Call-query.jsonl

- glaive-function-calling-v2: data/glaive-function-calling-v2-query.jsonl

- ToolACE: data/ToolACE-query.jsonl

- BUTTONInstruct: data/BUTTONInstruct-query.jsonl

- APIGen-MT-5k: data/APIGen-MT-5k-query.jsonl

- Tau-bench training set: data/tau-train-query.jsonl

数据集规模与特点

- 包含超过160,000轮对话

- 基于20,000多个工具合成

- 通过图采样和多智能体模拟构建复杂用户意图

- 包含推理轨迹和质量过滤

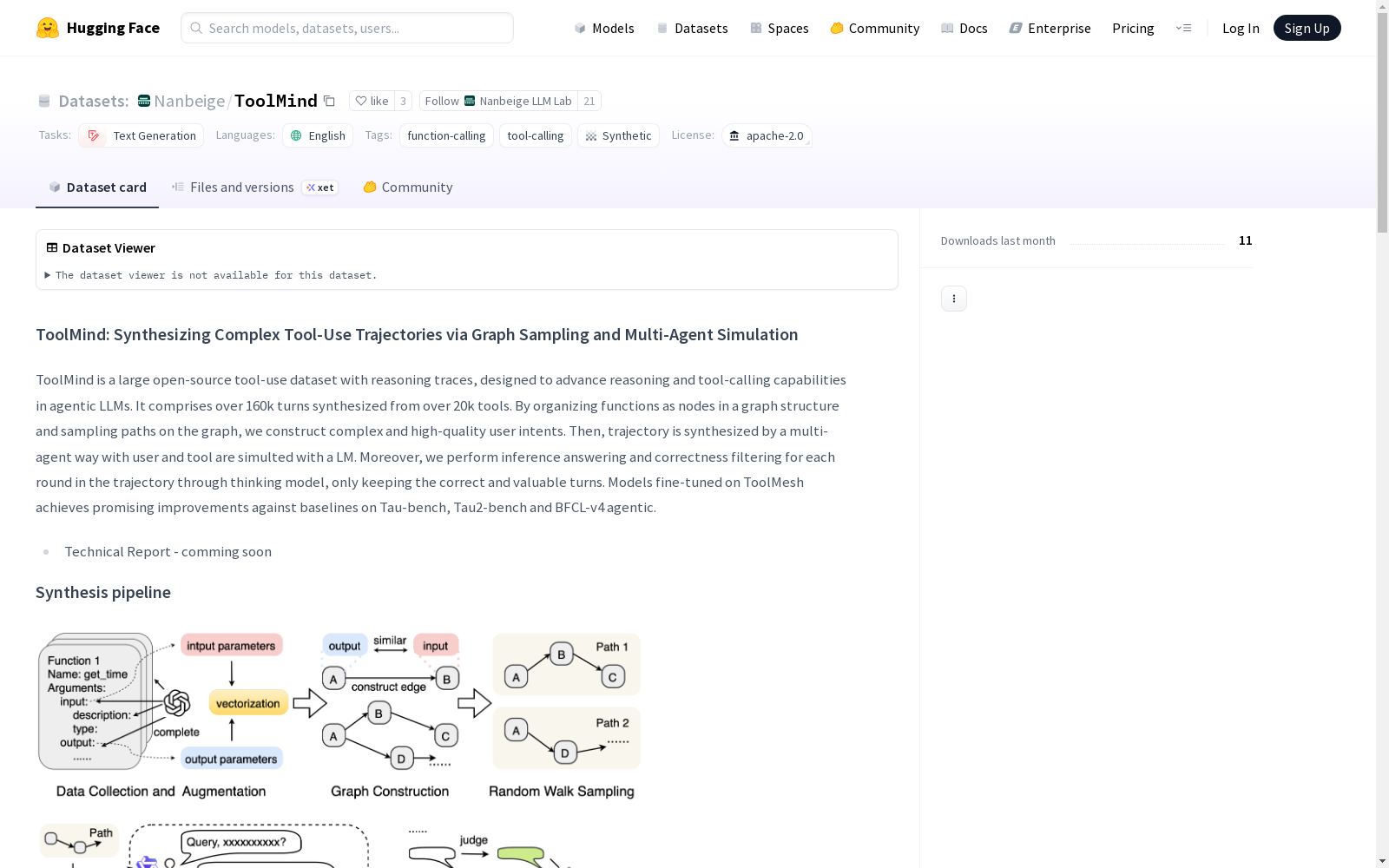

合成流程

数据收集与增强

- 从开源数据集收集函数:xlam-function-calling-60k、glaive-function-calling-v2、ToolACE

- 使用语言模型完善函数描述和参数类型

- 使用Conan-embedding-v1进行向量化

图构建

- 将函数表示为图中的节点

- 基于输入输出参数语义相似度构建边

- 引入随机边构建增加拓扑多样性

随机游走采样

- 使用长度5-20的随机游走采样函数链

- 限制节点访问次数避免过采样

多智能体轨迹合成

- 三个模型分别模拟用户、助手和函数

- 使用思维模型进行质量过滤和错误校正

- 仅保留有效轮次

混合训练数据

整合的开放源代码数据包括:

- xlam-function-calling-60k

- When2Call

- glaive-function-calling-v2

- ToolACE

- BUTTONInstruct

- APIGen-MT-5k

- Tau-bench训练集

性能表现

整体性能

在Tau2-bench和BFCL-v4评估中,使用ToolMind微调的模型相比基线有显著提升:

- Qwen3-8B模型在各项指标上均有明显改进

- Qwen3-14B模型在多数指标上表现更优

消融研究

- 增强的开放源代码数据(20万)在多个指标上带来提升

- 合成数据(16万)在特定领域表现突出

- 完整ToolMind数据集(36万)综合性能最佳

训练注意事项

- 数据基于助手消息进行分割

- 训练时仅对每个样本的最后一条助手消息计算损失

局限性

- 模型输出可能存在意外内容

- 可能生成包含偏见或歧视的有害内容

- 不承担传播不当信息造成的后果责任

引用与联系

- 使用请引用此Huggingface项目

- 联系方式:nanbeige@126.com

AI搜集汇总

数据集介绍

构建方式

在工具调用与智能体推理研究领域,ToolMind数据集通过创新的图采样与多智能体仿真技术构建而成。首先从多个开源数据源收集逾两万种功能函数,利用语言模型统一其参数描述与类型定义,并借助向量嵌入构建功能图结构。基于语义相似性建立函数间的边连接,通过随机游走采样生成长度为5至20的功能链。随后采用多智能体模拟框架,分别由用户、助手和工具模型协同生成交互轨迹,并运用思维模型对每一轮对话进行推理验证与质量过滤,仅保留正确且有价值的交互回合。

特点

该数据集涵盖超过16万轮交互轨迹,其显著特征在于融合了图结构引导的复杂意图合成与多轮对话的因果推理机制。通过功能图的拓扑关系自然衍生出具有逻辑连贯性的用户查询,而多智能体仿真则确保了工具调用的真实性与上下文一致性。数据集不仅包含高质量合成数据,还整合了经过严格筛选的开放源码数据,形成了覆盖多领域工具调用场景的混合训练资源。其对话长度、用户交互轮次及词汇分布均呈现合理的统计特征,为模型提供了丰富的学习样本。

使用方法

该数据集专为提升语言模型的工具调用与推理能力设计,适用于指令微调与智能体策略优化。使用时需注意数据已按助手消息进行分段处理,训练时仅对每个样本的最后一条助手消息计算损失函数。研究人员可直接加载标准化格式的JSONL文件,将其纳入下游任务的微调流程。实验表明,基于该数据集训练的模型在Tau-bench、Tau2-bench和BFCL-v4等基准测试中均展现出显著性能提升,特别在航空、零售与电信领域的复杂工具调用场景中表现优异。

背景与挑战

背景概述

在人工智能领域,工具调用能力是增强大型语言模型实际应用价值的关键方向。ToolMind数据集作为开源工具使用数据集,由研究团队通过整合多源函数库与合成技术构建而成,其核心目标在于提升语言模型在复杂任务中的推理与工具调用效能。该数据集融合了超过两万个工具生成的十六万余轮对话轨迹,采用图结构建模函数关系,并通过多智能体仿真生成高质量用户意图与交互轨迹。实验表明,基于ToolMind微调的模型在Tau-bench等多类评测中均展现出显著性能提升,推动了具身智能与工具导向语言模型的发展。

当前挑战

构建ToolMind数据集面临双重挑战:在领域问题层面,工具调用任务需解决模型在复杂多步推理中的错误累积与逻辑一致性维护,同时确保跨工具参数传递的语义连贯性;在数据构建过程中,原始函数定义往往存在描述缺失与类型不完整问题,需通过语言模型补全与向量化统一表示,而图结构构建与随机游走采样则需平衡路径复杂度与数据多样性,此外多轮对话的轨迹合成与正确性验证依赖思维模型进行逐轮筛选,增加了数据质量控制的难度。

常用场景

经典使用场景

在智能体与工具调用研究领域,ToolMind数据集通过图采样与多智能体模拟技术,构建了包含16万轮交互的大规模轨迹数据。其经典应用体现在训练语言模型执行复杂工具调用任务,例如在航空预订、零售服务和电信支持等场景中,模型需根据用户意图动态选择并串联多个API函数,实现多步骤问题求解。该数据集通过模拟真实对话轨迹,为模型提供了学习工具间逻辑关联与错误修正能力的优质样本。

解决学术问题

ToolMind有效解决了工具调用领域三大核心问题:其一,通过函数图建模打破了传统数据中工具孤立定义的局限,揭示了参数语义关联的传递性;其二,利用多智能体仿真生成带推理轨迹的数据,填补了工具调用中因果链条标注的空白;其三,通过思维模型的质量过滤机制,显著提升了训练数据的逻辑一致性与执行准确性。这些突破为构建具备复杂推理能力的代理型大语言模型奠定了数据基础。

衍生相关工作

基于ToolMind的图采样范式,衍生出多项重要研究工作:Team-ACE团队开发的ToolACE数据集进一步完善了函数描述标准化流程;Sierra Research提出的Tau-bench评估体系构建了工具调用的标准化测试基准;Butterfly框架则借鉴其多智能体仿真思想,实现了更细粒度的工具交互建模。这些工作共同推动了工具学习领域从单函数调用向多工具协作的范式转变。

以上内容由AI搜集并总结生成