【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

JuDGE

收藏arXiv2025-03-20 更新2025-03-20 收录

下载链接:

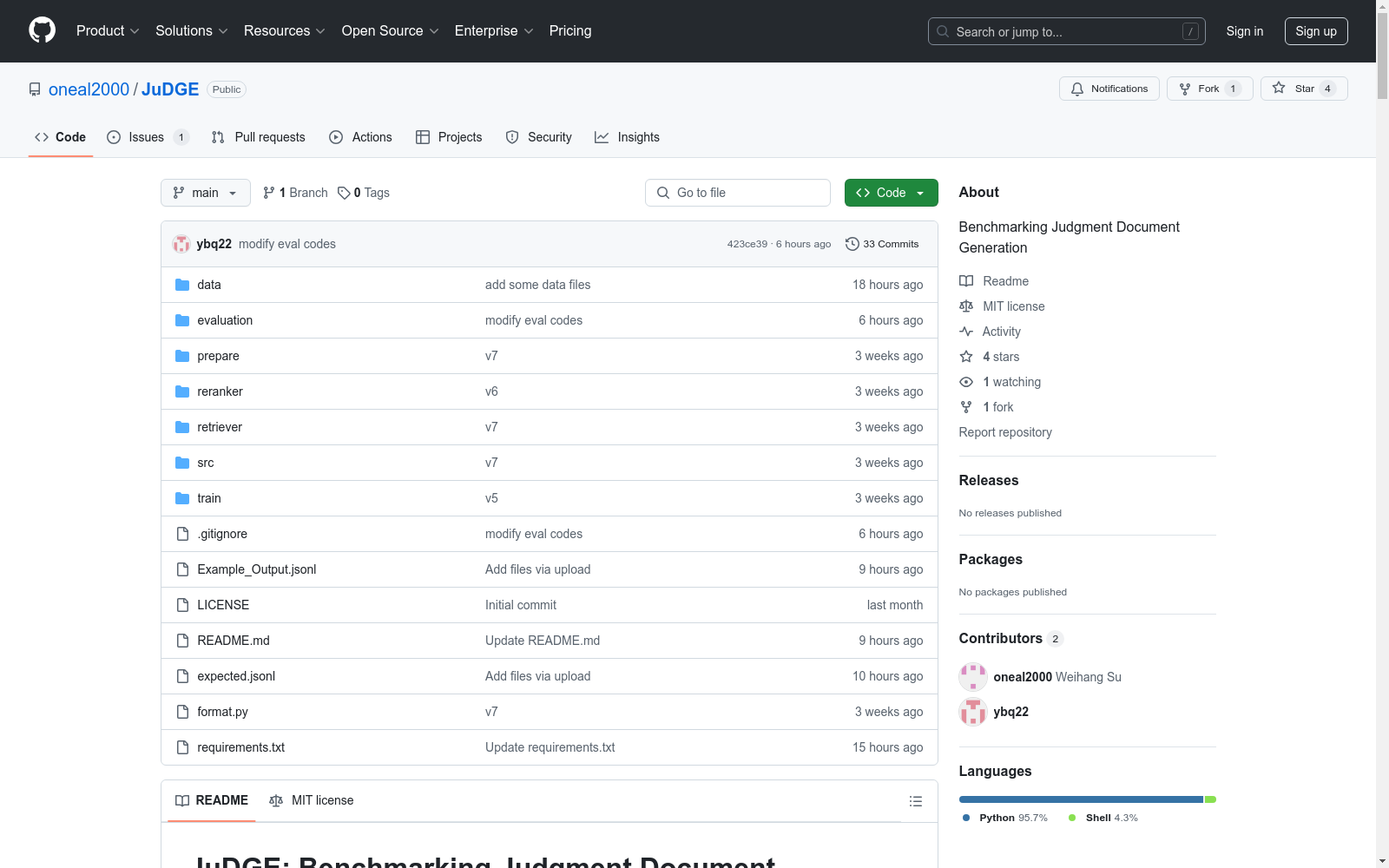

https://github.com/oneal2000/JuDGE

下载链接

链接失效反馈官方服务:

资源简介:

JuDGE数据集是由清华大学计算机科学与技术系构建的,包含真实案件的事实描述及其对应的完整判决书。该数据集还包括两个专门的法律语料库,一个是包含法律法规的语料库,另一个是包含大量过去判决书的语料库,作为任务中法律知识的外部来源。数据集的构建过程包括公开收集案件文档、法律条文,经过预处理和专家标注,以确保数据质量。该数据集旨在用于评估判决书生成性能,并推动相关领域的研究进展。

The JuDGE Dataset is constructed by the Department of Computer Science and Technology, Tsinghua University. It contains factual descriptions of real cases and their corresponding complete judicial judgments. The dataset also includes two specialized legal corpora: one is a corpus containing laws and regulations, and the other is a corpus comprising a large number of past judicial judgments, which serve as external sources of legal knowledge for relevant tasks. The dataset's construction process involves publicly collecting case documents and legal provisions, followed by preprocessing and expert annotation to ensure data quality. This dataset is designed to evaluate the performance of judicial judgment generation and advance research progress in related fields.

提供机构:

清华大学计算机科学与技术系

创建时间:

2025-03-18

搜集汇总

数据集介绍

构建方式

JuDGE数据集的构建过程始于从中国裁判文书网收集公开的刑事案例文档,这些文档涵盖了20年的时间跨度,并随机选自包含约六百万个法律案例的数据库。为了确保数据集的多样性和代表性,筛选过程涵盖了各种法律原则和司法结果。此外,数据集还通过法律专家的详细注释,识别并整合了最新的中国法律法规,确保数据的准确性和时效性。数据集进一步通过自动化脚本将法律条文分割为单独的条款,便于下游任务的检索和应用。最终,数据集经过严格的预处理和专家标注,确保其高质量和一致性。

特点

JuDGE数据集的特点在于其全面性和多样性。数据集包含2,505个事实-判决对,涵盖了142种不同的罪名和182个不同的刑法条款,确保了其在建模各种法律场景中的高度适用性。此外,数据集还补充了两个外部法律语料库,分别包含103,251个判决文档和55,348个法律条文,为任务提供了丰富的法律背景信息。数据集的平均长度和结构反映了其平衡的细节水平,事实描述平均约652个中文字符,判决结果平均约207个中文字符,确保了每个案例的法律背景和细节的充分表达。

使用方法

JuDGE数据集的使用方法主要围绕判决文档生成任务的评估展开。研究人员可以通过提供案例的事实描述,利用数据集生成完整的判决文档,并通过自动化的评估框架对生成文档的质量进行多维度评估。评估框架涵盖了刑罚准确性、定罪准确性、引用准确性和文档相似性四个关键维度。此外,数据集支持多种基线方法的评估,包括少样本上下文学习、监督微调以及多源检索增强生成(RAG)方法。通过这些方法,研究人员可以探索不同模型在判决文档生成任务中的表现,并进一步优化生成模型的法律推理能力和文档质量。

背景与挑战

背景概述

JuDGE(Judgment Document Generation Evaluation)是由清华大学的研究团队于2025年提出的一个针对中国法律系统的判决书生成基准数据集。该数据集旨在评估从案件事实描述生成完整判决书的性能,涵盖了真实法律案件的事实描述及其对应的判决书。JuDGE的创建背景源于近年来大语言模型(LLMs)在法律领域的快速发展,尤其是在合同分析、案例研究和法律文件起草等任务中的应用。判决书生成任务因其能够显著提高司法效率并减少法律工作负担而备受关注。然而,由于缺乏标准化的基准和自动化评估方法,这一领域的研究进展受到限制。JuDGE通过与法律专业人士合作,建立了一个全面的自动化评估框架,涵盖刑罚准确性、定罪准确性、引用准确性和文档相似性等多个维度,为判决书生成任务提供了重要的研究基础。

当前挑战

JuDGE数据集面临的挑战主要体现在两个方面。首先,判决书生成任务本身具有高度复杂性,要求模型能够准确捕捉案件事实细节、正确应用法律条文并执行法律推理。尽管大语言模型在生成文本方面表现出色,但其在法律领域的专业知识有限,难以生成高质量的法律文本。其次,数据集的构建过程也面临诸多挑战。由于判决书涉及大量敏感信息,数据收集和预处理过程中需严格遵守隐私保护原则,确保所有数据经过严格的匿名化处理。此外,判决书的结构复杂,包含多个相互依赖的部分,如事实描述、法律推理和判决结果等,如何确保生成文档的结构一致性和法律有效性是构建过程中的一大难题。尽管JuDGE通过引入外部法律知识库和多源检索增强生成(RAG)方法提升了生成质量,但实验结果仍表明,当前模型在生成高质量判决书方面存在显著不足,未来仍需进一步探索和创新。

常用场景

经典使用场景

JuDGE数据集主要用于评估中文法律系统中判决文档的自动生成能力。其经典使用场景包括基于案件事实描述生成完整的判决文书,涵盖了从事实描述到法律推理、判决结果的完整流程。该数据集通过提供真实的法律案件事实描述及其对应的判决文书,为研究者提供了一个标准化的基准,用于测试和优化生成模型在判决文档生成任务中的表现。

解决学术问题

JuDGE数据集解决了法律领域中判决文档自动生成的多个关键学术问题。首先,它填补了该领域缺乏标准化评估基准的空白,为研究者提供了一个包含真实案件事实和判决文书的对照数据集。其次,数据集通过引入外部法律知识库(如法规和判例),帮助模型更好地理解法律推理过程。此外,JuDGE还提出了一个多维度的自动化评估框架,能够从刑罚准确性、定罪准确性、引用准确性和文档相似性等方面全面评估生成文档的质量,从而推动了法律文本生成领域的研究进展。

衍生相关工作

JuDGE数据集的发布催生了一系列相关研究工作,特别是在法律文本生成和信息检索领域。基于该数据集,研究者提出了多种生成模型优化方法,如基于检索增强的生成(RAG)技术,通过结合外部法律知识库提升生成质量。此外,JuDGE还启发了对法律领域大语言模型(LLMs)的深入研究,推动了法律文本生成与信息检索技术的融合。相关研究还包括对法律判决预测(LJP)任务的扩展,从传统的分类任务转向生成任务,进一步贴近实际司法需求。

以上内容由遇见数据集搜集并总结生成