ScanQA

收藏github2025-03-21 收录

下载链接:

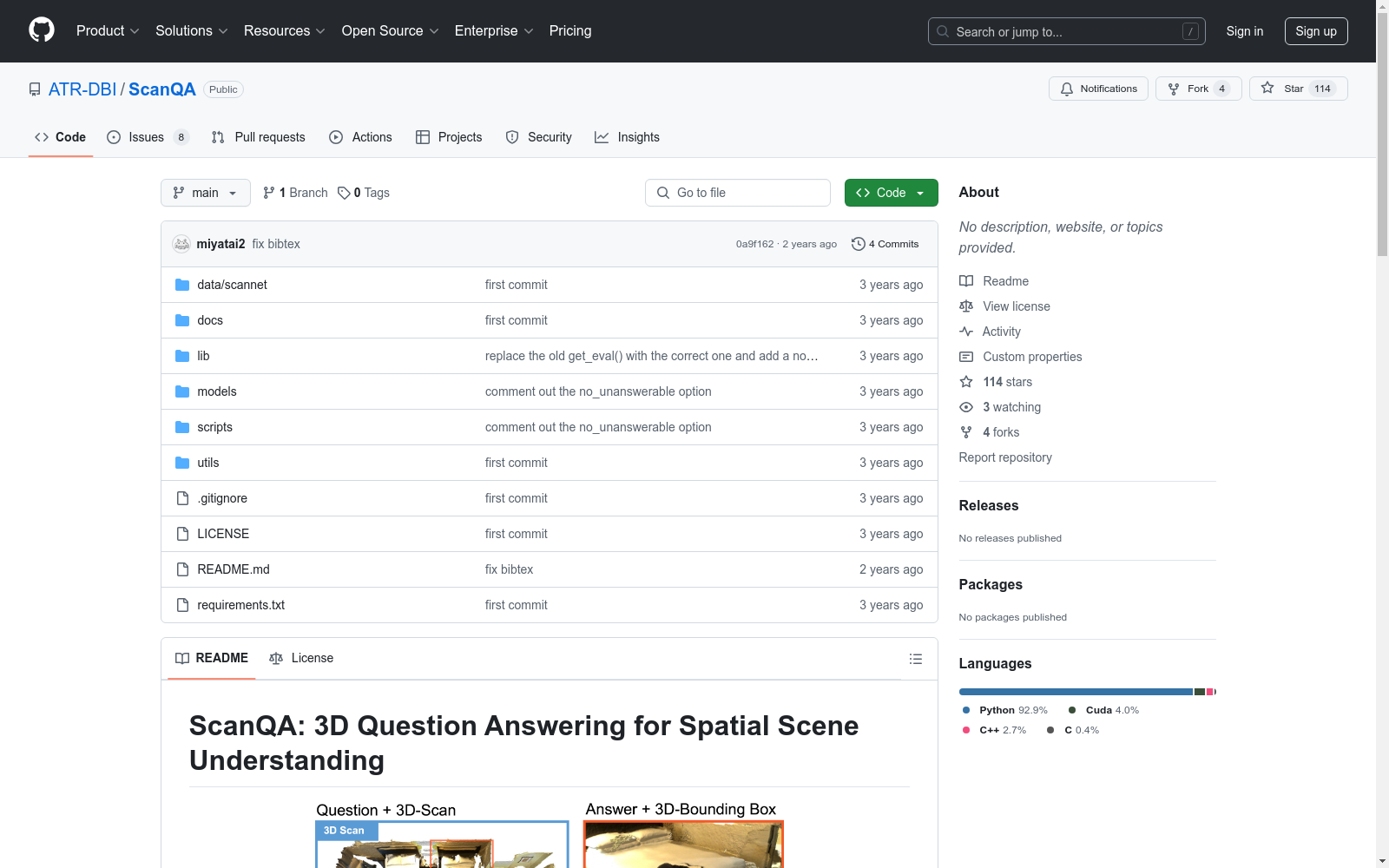

https://github.com/ATR-DBI/ScanQA

下载链接

链接失效反馈资源简介:

ScanQA 数据集由京都大学、ATR、RIKEN AIP 等机构的研究人员共同创建,旨在推动 3D 空间理解任务的发展。该数据集包含超过 41,000 个问答对,覆盖 800 个室内场景,基于 ScanNet 数据集构建。问答对通过自动化生成和人工编辑相结合的方式生成,涵盖了多种类型的自然语言问题,如物体识别、颜色、位置等。数据集的创建过程包括自动从 ScanRefer 数据集的描述中生成问题、人工筛选和编辑问题以及收集自由形式的答案。ScanQA 数据集的应用领域广泛,主要用于训练和评估能够理解 3D 空间信息并回答相关问题的模型。它解决了传统 2D 图像问答模型在 3D 空间理解上的局限性,如物体对齐、方向理解、遮挡问题以及多图像中的物体识别问题。该数据集为开发能够在 3D 环境中进行问答的智能模型提供了丰富的资源,有助于推动机器人导航、虚拟现实交互等领域的研究。

The ScanQA dataset was co-created by researchers from institutions including Kyoto University, ATR, and RIKEN AIP, aiming to advance the development of 3D spatial understanding tasks. This dataset comprises over 41,000 question-answer (QA) pairs spanning 800 indoor scenes, and is constructed based on the ScanNet dataset. The QA pairs are generated via a hybrid approach of automated generation and manual editing, covering diverse types of natural language questions including object recognition, color, location, and more. The construction process of the ScanQA dataset includes automatically generating questions from the descriptions of the ScanRefer dataset, manually screening and revising these questions, and collecting free-form answers. The ScanQA dataset has broad application fields, and is primarily used for training and evaluating models that can comprehend 3D spatial information and respond to relevant queries. It addresses the limitations of traditional 2D image QA models in 3D spatial understanding, such as object alignment, orientation comprehension, occlusion issues, and object recognition across multiple images. This dataset provides a rich resource for developing intelligent models capable of performing question answering in 3D environments, and helps promote research in fields such as robot navigation and virtual reality interaction.

提供机构:

京都大学

原始信息汇总

ScanQA 数据集概述

数据集简介

ScanQA 是一个用于3D空间场景理解的问答数据集,旨在通过3D场景中的视觉信息回答文本问题。该数据集由41,000多个问答对组成,涵盖800个室内场景,这些场景来自ScanNet数据集。

数据集特点

- 任务类型:3D问答(3D-QA),模型需要从3D场景的RGB-D扫描中获取视觉信息,并回答关于该场景的文本问题。

- 问题类型:自由形式的问答对,问题与3D场景中的对象相关联。

- 数据规模:超过41,000个问答对,来自800个室内场景。

数据集使用

- 训练:使用RGB值训练ScanQA模型。

- 推理:对训练好的模型进行评估、评分和预测。

- 基准测试:ScanQA基准测试托管在EvalAI平台上,用户可以通过提交预测结果进行评估。

数据集引用

如果使用该数据集进行研究,请引用以下论文: bibtex @inproceedings{azuma_2022_CVPR, title={ScanQA: 3D Question Answering for Spatial Scene Understanding}, author={Azuma, Daichi and Miyanishi, Taiki and Kurita, Shuhei and Kawanabe, Motoaki}, booktitle={Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)}, year={2022} }

许可证

ScanQA数据集采用Creative Commons Attribution-NonCommercial-ShareAlike 3.0 Unported License许可。

致谢

感谢以下项目的贡献:

- facebookresearch/votenet 提供了3D对象检测代码。

- daveredrum/ScanRefer 提供了3D定位代码库。

AI搜集汇总

数据集介绍

构建方式

ScanQA数据集的构建基于ScanNet数据集中的800个室内场景,通过人工编辑的方式生成了超过41,000个问题-答案对。每个问题-答案对均与3D场景中的具体对象相关联,确保了问题的空间理解基础。数据集的构建过程中,研究人员设计了自由形式的问答对,旨在捕捉3D场景中的复杂空间关系。通过融合3D对象提议和编码的句子嵌入,ScanQA模型能够学习到语言表达与3D扫描几何特征之间的关联,从而实现对3D场景中对象的精确定位。

特点

ScanQA数据集的特点在于其首次将问答任务引入3D空间理解领域,填补了传统2D视觉问答在空间理解上的不足。数据集中的问题-答案对不仅涵盖了对象的存在性,还涉及对象的位置、方向等空间属性,极大地丰富了3D场景理解的研究内容。此外,ScanQA数据集规模庞大,覆盖了多样化的室内场景,为模型的训练和评估提供了坚实的基础。数据集的自由形式答案设计也使得模型能够更好地适应真实世界中的复杂场景。

使用方法

ScanQA数据集的使用方法包括训练、推理和评估三个主要步骤。在训练阶段,用户可以通过命令行启动模型训练,并选择是否使用RGB信息。推理阶段则提供了对验证集和测试集的预测功能,用户可以通过指定文件夹路径加载训练好的模型进行预测。评估阶段则通过EvalAI平台进行,用户需提交生成的预测文件以获取模型的性能评分。此外,ScanQA数据集还提供了详细的安装和数据准备指南,确保用户能够顺利使用该数据集进行研究和开发。

背景与挑战

背景概述

ScanQA数据集由Daichi Azuma、Taiki Miyanishi、Shuhei Kurita和Motoaki Kawanabe等研究人员于2022年提出,旨在解决3D空间场景理解中的问答任务。该数据集基于ScanNet数据集,包含800个室内场景中的超过41,000个问答对,涵盖了丰富的RGB-D扫描数据。ScanQA的提出填补了3D场景理解与自然语言处理之间的空白,为3D环境中的物体定位与问答任务提供了新的研究范式。其核心研究问题在于如何通过3D视觉信息与文本问题的结合,实现对场景中物体的精确定位与理解。ScanQA的发布推动了3D视觉与语言理解领域的交叉研究,为后续的3D场景理解任务提供了重要的数据支持。

当前挑战

ScanQA数据集面临的挑战主要体现在两个方面。首先,3D问答任务要求模型具备对复杂3D场景的深度理解能力,包括物体的空间排列、方向感知以及从文本问题中推断物体位置的能力。传统的2D问答模型在处理这些问题时表现不佳,难以应对3D场景中的空间复杂性。其次,数据集的构建过程也面临诸多挑战,例如如何从丰富的RGB-D扫描数据中生成高质量的问答对,并确保这些问答对能够准确反映3D场景中的物体信息。此外,3D场景数据的标注成本较高,且需要处理大量的点云数据,这对数据集的规模和质量提出了更高的要求。这些挑战推动了3D视觉与语言理解领域的技术创新,同时也为未来的研究提供了方向。

常用场景

经典使用场景

ScanQA数据集主要用于3D空间场景理解中的问答任务,特别是在室内环境中。通过结合RGB-D扫描数据和自然语言问题,模型需要理解复杂的3D场景并回答与场景中物体相关的问题。这种任务不仅要求模型具备视觉理解能力,还需要对空间关系和物体定位有深刻的理解。ScanQA数据集通过提供丰富的3D场景和对应的问答对,为研究者提供了一个理想的平台,用于开发和测试3D问答模型。

衍生相关工作

ScanQA数据集的发布催生了一系列相关研究工作,特别是在3D视觉问答和场景理解领域。例如,基于ScanQA的研究工作进一步优化了3D物体检测和定位算法,提升了模型在复杂场景中的表现。此外,ScanQA还启发了其他3D数据集的建设,推动了多模态学习在3D场景中的应用,为未来的智能系统开发提供了更多可能性。

数据集最近研究

最新研究方向

在三维空间场景理解领域,ScanQA数据集的最新研究方向聚焦于三维问答(3D-QA)任务的深度探索。该任务要求模型从丰富的RGB-D室内扫描数据中提取视觉信息,并结合文本问题生成准确的答案。与传统的二维视觉问答(2D-QA)不同,3D-QA模型需要克服物体对齐和方向的空间理解难题,从而实现从文本问题到三维物体定位的精准映射。ScanQA模型通过融合三维物体提议和编码句子嵌入,学习描述符以关联语言表达与三维几何特征,推动了三维场景中物体定位的回归任务。这一研究方向不仅填补了三维环境中基于物体的问答任务的空白,还为智能机器人、增强现实等应用场景提供了重要的技术支持。

以上内容由AI搜集并总结生成