Monet-SFT-125K

收藏arXiv2025-11-26 更新2025-11-28 收录

下载链接:

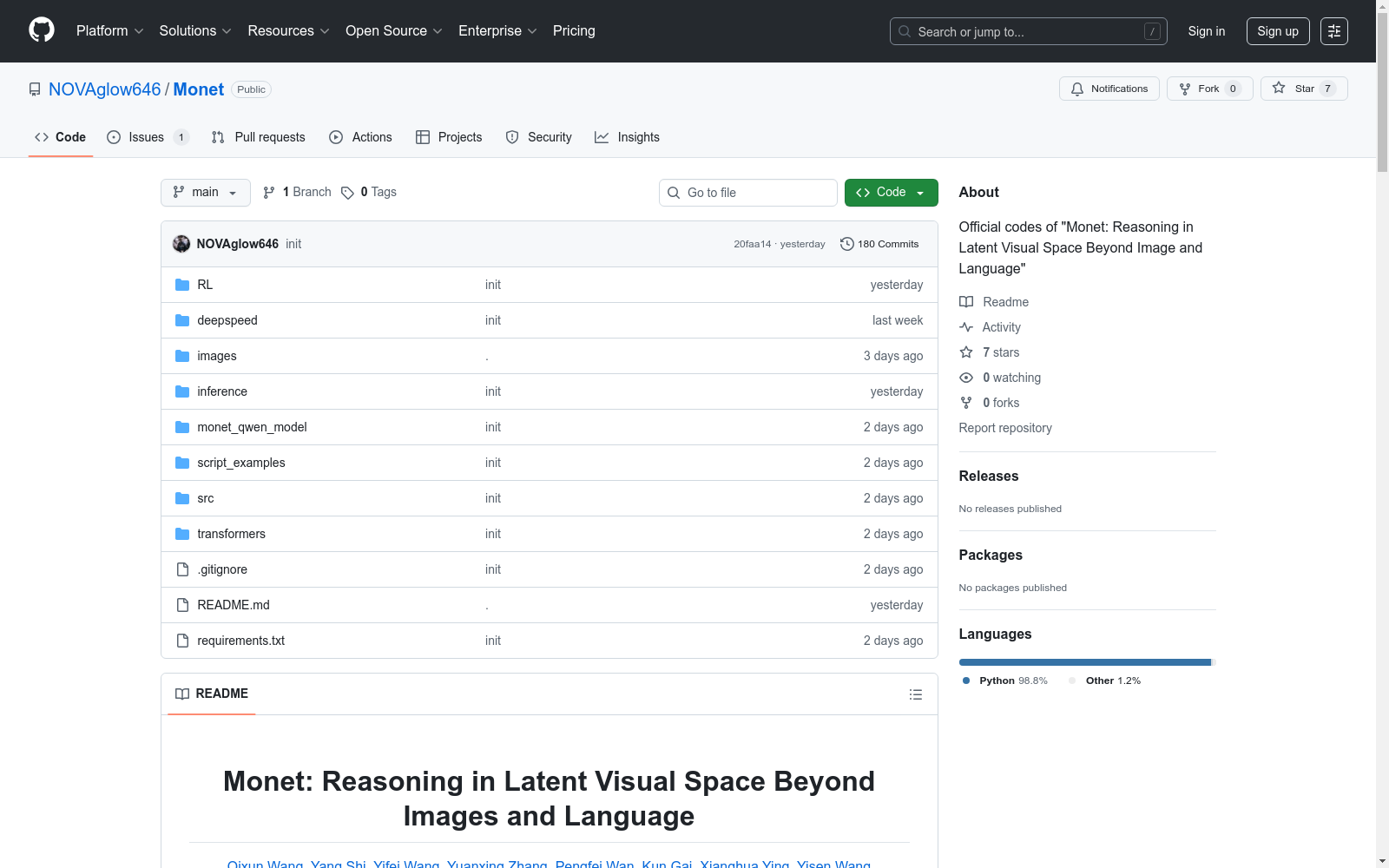

https://github.com/NOVAglow646/Monet

下载链接

链接失效反馈官方服务:

资源简介:

Monet-SFT-125K是由北京大学与Kling团队联合构建的高质量多模态推理数据集,包含12.5万条图文交织的思维链样本。该数据集涵盖真实场景、图表分析、文字识别和几何推理四大领域,数据来源整合了ReFocus、CogCoM等权威基准,通过视觉裁剪、边界框标注和辅助线绘制等操作增强视觉表征。数据集采用三阶段精炼流程构建,首先筛选原始图像无法解决的难题,继而验证辅助图像的有效性,最后通过大模型标注关键视觉观察词元。该数据集专为训练潜在视觉推理模型而设计,旨在解决复杂视觉场景下的抽象推理和跨领域泛化问题。

Monet-SFT-125K is a high-quality multimodal reasoning dataset jointly constructed by Peking University and the Kling team, consisting of 125,000 chain-of-thought samples interleaved with text and images. This dataset covers four core domains: real-world scenarios, chart analysis, text recognition, and geometric reasoning. Its data sources integrate authoritative benchmarks including ReFocus and CogCoM, and visual representations are enhanced through operations such as visual cropping, bounding box annotation, and auxiliary line drawing. The dataset is built via a three-stage refinement pipeline: first, screening out challenging problems that cannot be resolved with raw images; second, verifying the effectiveness of auxiliary images; and finally, annotating key visual observation tokens using large language models. This dataset is specifically designed for training visual reasoning models, aiming to address the challenges of abstract reasoning and cross-domain generalization in complex visual scenarios.

提供机构:

北京大学、Kling团队、麻省理工学院

创建时间:

2025-11-26

原始信息汇总

Monet数据集概述

数据集基本信息

- 数据集名称: Monet

- 核心功能: 支持多模态大语言模型在潜在视觉空间中进行推理的训练框架

- 技术特点: 通过生成连续嵌入作为中间视觉思维,实现潜在空间直接推理

数据集构成

训练数据

- SFT数据: Monet-SFT-125K (https://huggingface.co/datasets/NOVAglow646/Monet-SFT-125K/tree/main)

- RL数据: Thyme-RL (https://huggingface.co/datasets/Kwai-Keye/Thyme-RL)

模型资源

- 预训练模型: Monet-7B (https://huggingface.co/NOVAglow646/Monet-7B)

技术实现

模型架构

- 基于Qwen2.5-VL-7B模型的定制化修改

- 支持潜在推理的Transformers和vLLM代码修改

训练方法

SFT训练

- 修改前向传播过程以支持潜在嵌入

- 主要实现在

modeling_qwen2_5_vl_monet.py文件中

RL训练

- 基于EasyR1框架实现

- 支持潜在推理和文本推理两种采样策略

- 动态采样困难样本进行训练

- 使用外部LLM API进行规则判断

推理功能

关键特性

- 支持潜在-文本交错推理

- 通过

<abs_vis_token>切换潜在思维模式 - 可控制潜在嵌入生成数量

推理设置

- 使用修改后的vLLM代码进行推理

- 支持潜在令牌后处理

- 可设置潜在嵌入大小

评估方法

- 基于VLMEvalKit进行评估

- 使用API判断替代精确匹配评估

- 确保评估准确性

引用文献

bibtex @misc{wang2025monetreasoninglatentvisual, title={Monet: Reasoning in Latent Visual Space Beyond Images and Language}, author={Qixun Wang and Yang Shi and Yifei Wang and Yuanxing Zhang and Pengfei Wan and Kun Gai and Xianghua Ying and Yisen Wang}, year={2025}, eprint={2511.21395}, archivePrefix={arXiv}, primaryClass={cs.CV}, url={https://arxiv.org/abs/2511.21395}, }

搜集汇总

数据集介绍

构建方式

在视觉推理研究领域,构建高质量数据集是推动模型抽象思维能力发展的关键。Monet-SFT-125K通过三阶段数据筛选流程精心构建:首先从多个多模态思维链数据源中筛选出仅凭原始图像无法解决的问题样本,确保辅助图像的必要性;随后利用强模型验证辅助图像的推理有效性,保证视觉线索的准确性;最后通过大语言模型标注关键视觉观察文本,为潜在嵌入学习提供细粒度监督信号。

特点

该数据集涵盖现实场景、图表解析、文字识别和几何推理四大领域,其核心特征在于深度融合文本与图像的交替思维链结构。每个样本包含具有明确视觉操作意图的辅助图像,如区域裁剪、边界框标注、辅助线绘制及动态视觉状态生成等,这些操作共同支撑起从细粒度感知到复杂空间推理的多层次任务需求。数据集通过精准标注的关键观察文本,构建起视觉特征与语义表达间的桥梁。

使用方法

在模型训练过程中,该数据集通过分阶段监督微调框架驱动潜在空间推理能力的演化。第一阶段通过标准指令微调使模型适应图文交替推理模式;第二阶段采用双重监督机制,既对齐关键观察文本的隐层表示,又通过受控注意力流建立“辅助图像→潜在嵌入→观察文本”的信息传递路径;第三阶段则通过潜在嵌入对齐实现无辅助图像条件下的抽象推理能力迁移。这种递进式训练范式使模型能自主决策潜在推理时机,在连续嵌入空间中完成视觉思维的抽象与重构。

背景与挑战

背景概述

Monet-SFT-125K数据集由北京大学、麻省理工学院及Kling团队于2025年联合构建,旨在推动多模态大语言模型在潜在视觉空间中的抽象推理能力。该数据集聚焦于解决传统视觉推理方法依赖外部工具的局限性,通过构建包含12.5万条高质量图文交织链式思维数据,覆盖真实场景、图表、光学字符识别与几何推理等多领域任务。其创新性在于将视觉证据注入中间推理步骤,模拟人类内在感知空间的灵活思考模式,显著提升了模型在复杂视觉任务中的泛化性能与推理效率。

当前挑战

该数据集致力于突破多模态潜在视觉推理的核心难题:一方面,在领域问题层面,需克服传统方法因依赖裁剪、标注等外部工具导致的推理僵化问题,实现从离散语言空间到连续潜在空间的语义迁移;另一方面,在构建过程中面临双重挑战,包括潜在嵌入与视觉特征对齐的高计算成本,以及缺乏对潜在嵌入的有效监督信号。为此,研究团队设计了基于蒸馏的三阶段监督微调流程,并通过视觉潜在策略优化算法显式强化潜在嵌入的优化路径。

常用场景

经典使用场景

在视觉推理研究领域,Monet-SFT-125K数据集作为高质量的多模态思维链数据资源,其经典应用场景集中于训练多模态大语言模型进行潜在空间推理。该数据集通过融合文本与图像交错的推理链条,使模型能够生成连续的潜在嵌入作为中间视觉思维,从而模拟人类在内部感知空间中的抽象推理过程。其覆盖的真实世界场景、图表解析、光学字符识别与几何问题,为模型提供了从具体感知到抽象推理的全方位训练素材。

实际应用

在实际应用层面,Monet-SFT-125K支撑的模型可广泛应用于智能教育系统中的几何解题、商业数据分析中的图表理解、文档数字化处理中的OCR增强以及自动驾驶场景的环境感知。其潜在空间推理能力使模型能够应对需要动态视觉操作的任务,例如通过生成中间视觉状态解决三维物体计数问题,或通过绘制辅助线完成复杂图表解析,显著提升了多模态系统在真实场景中的适应性与可靠性。

衍生相关工作

该数据集催生了多项潜在视觉推理领域的创新研究,例如基于潜在嵌入对齐的LVR方法、结合注意力控制的视觉-潜在优化框架VLPO,以及融合蒸馏策略的多阶段训练管道。这些工作深化了对潜在空间中视觉特征编码机制的理解,推动了如视觉策略优化、跨模态表示对齐等方向的发展。同时,其构建方法论也为后续高质量多模态数据集的创建提供了可借鉴的范式。

以上内容由遇见数据集搜集并总结生成