VLR-BENCH|视觉语言模型数据集|多语言数据集数据集

收藏数据集概述

数据集信息

-

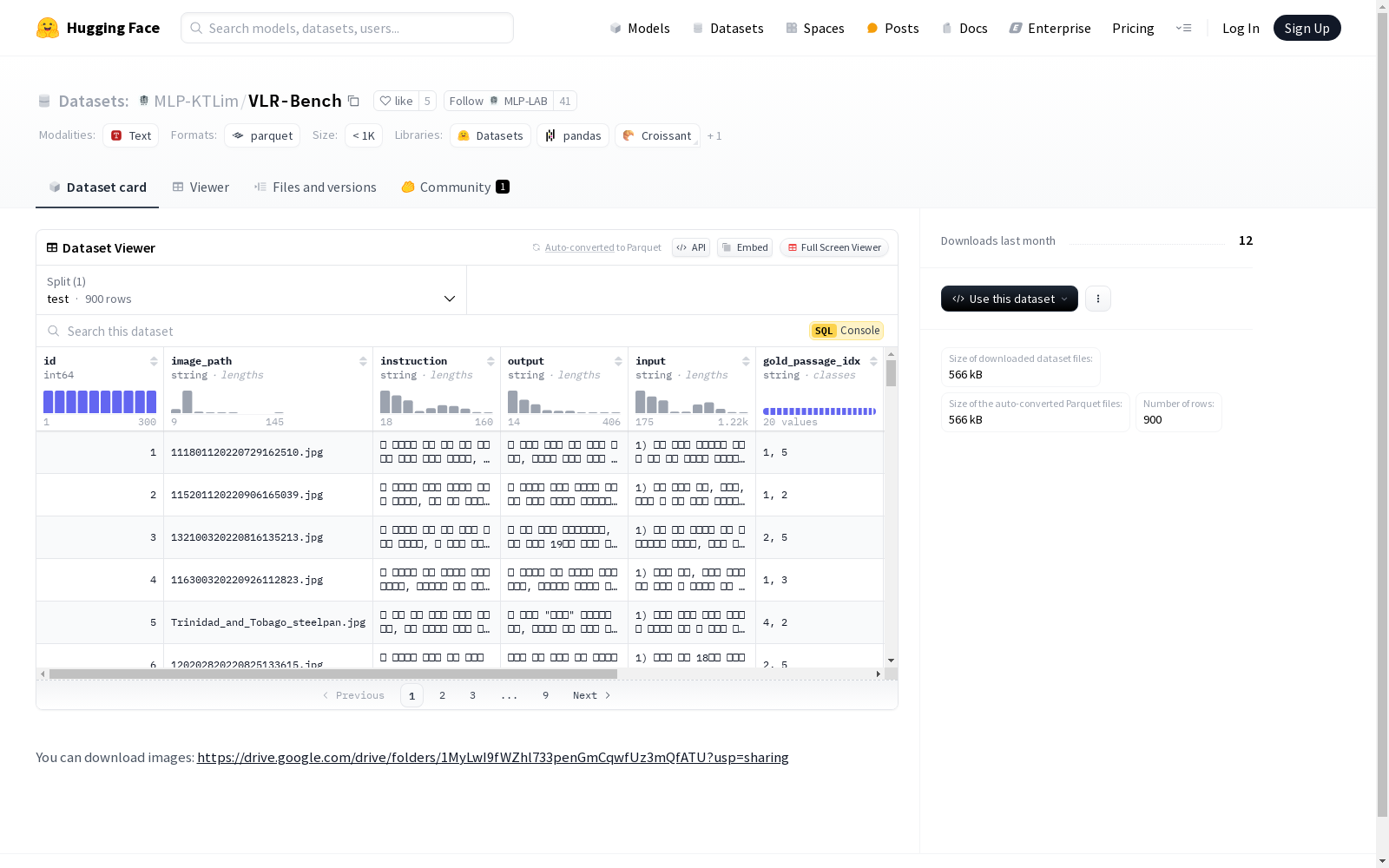

特征(Features):

- id: 数据类型为

int64 - image_path: 数据类型为

string - instruction: 数据类型为

string - output: 数据类型为

string - input: 数据类型为

string - gold_passage_idx: 数据类型为

string - keyword1: 数据类型为

string - keyword2: 数据类型为

string - language: 数据类型为

string

- id: 数据类型为

-

数据分割(Splits):

- test: 包含 900 个样本,数据大小为 1042936 字节

-

数据集大小:

- 下载大小: 565960 字节

- 数据集大小: 1042936 字节

-

配置(Configs):

- default:

- 数据文件路径:

data/test-*

- 数据文件路径:

- default:

其他信息

- 图像下载链接: https://drive.google.com/drive/folders/1MyLwI9fWZhl733penGmCqwfUz3mQfATU?usp=sharing

- 1VLR-Bench: Multilingual Benchmark Dataset for Vision-Language Retrieval Augmented Generation首尔科学技术大学 · 2024年

HazyDet

HazyDet是由解放军工程大学等机构创建的一个大规模数据集,专门用于雾霾场景下的无人机视角物体检测。该数据集包含383,000个真实世界实例,收集自自然雾霾环境和正常场景中人工添加的雾霾效果,以模拟恶劣天气条件。数据集的创建过程结合了深度估计和大气散射模型,确保了数据的真实性和多样性。HazyDet主要应用于无人机在恶劣天气条件下的物体检测,旨在提高无人机在复杂环境中的感知能力。

arXiv 收录

Wind Turbine Data

该数据集包含风力涡轮机的运行数据,包括风速、风向、发电量等参数。数据记录了多个风力涡轮机在不同时间点的运行状态,适用于风能研究和风力发电系统的优化分析。

www.kaggle.com 收录

UAV123

从低空无人机捕获的视频与流行的跟踪数据集 (如OTB50,OTB100,VOT2014,VOT2015,TC128和ALOV300) 中的视频本质上不同。因此,我们提出了一个新的数据集 (UAV123),其序列来自空中视点,其子集用于长期空中跟踪 (UAV20L)。我们新的UAV123数据集包含总共123个视频序列和超过110K帧,使其成为仅次于ALOV300的第二大对象跟踪数据集。所有序列都用直立的边界框完全注释。数据集可以很容易地与视觉跟踪器基准集成。它包括无人机数据集的所有边界框和属性注释。还请使用包含序列和跟踪器配置的修改后的文件 “configSeqs.m” 和 “configTrackers.m” 下载修改后的跟踪器基准。另外,请注意,文件 “perfPlot.m” 已根据本文中描述的属性进行了修改以进行评估。

OpenDataLab 收录

Literature Database, XML, NBVC, Oct 2017

Literature Database, XML format, the Natural Resources of Naval Base Ventura County

Mendeley Data 收录

UAV-VisLoc - 用于无人机视觉定位的大规模数据集

UAV-VisLoc数据集由北京邮电大学、中科院和香港城市大学联合构建,旨在解决无人机在失去全球导航卫星系统信号时的精确定位问题。该数据集涵盖了中国11个不同地点的无人机图像,捕获了多样化的地形特征,包括固定翼无人机和多地形无人机在不同高度和方向上拍摄的6742张图像以及11幅卫星地图。每张图像均附有经纬度、高度、拍摄日期和航向角等元数据,为模型的训练与测试提供了丰富多元的数据支持。UAV-VisLoc数据集用于支持无人机视觉定位任务,为无人机视觉定位任务提供了训练和测试样本,通过匹配无人机拍摄的地面向下视角图像与正射卫星地图,实现无人机的自主视觉定位。

github 收录