WikiLingua

收藏arXiv2020-10-07 更新2024-06-21 收录

下载链接:

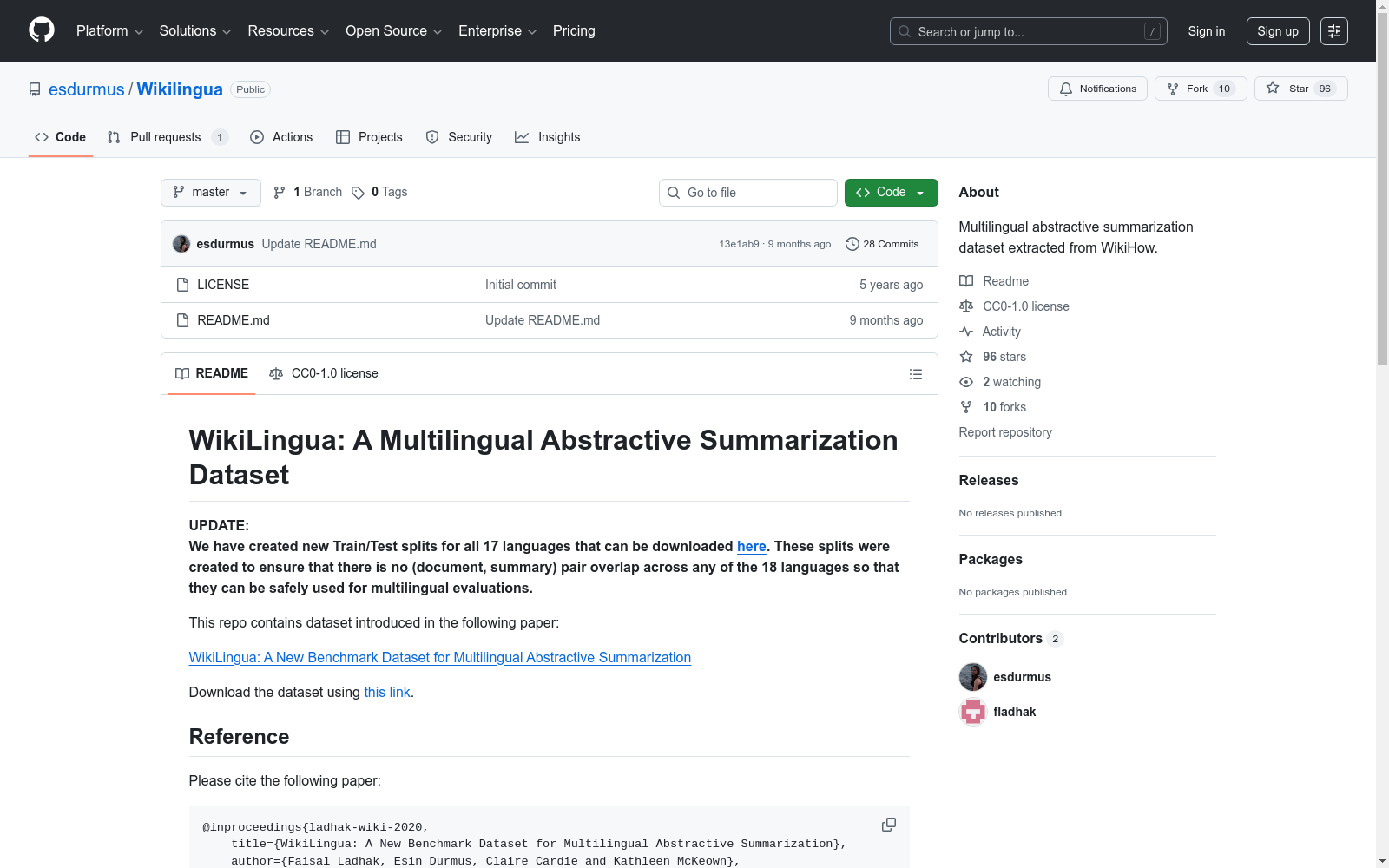

https://github.com/esdurmus/Wikilingua

下载链接

链接失效反馈资源简介:

WikiLingua是一个大规模的多语言数据集,用于评估跨语言抽象摘要系统。该数据集从WikiHow中提取了18种语言的文章和摘要对,通过图像对每篇文章的步骤进行对齐,创建了跨语言的黄金标准文章-摘要对齐。数据集包含高质量的协作编写的操作指南,每个文章和摘要都由23人编写和16人审核,确保内容的高质量。WikiLingua旨在解决跨语言抽象摘要资源缺乏的问题,为研究提供了丰富的数据资源,适用于探索新的跨语言和多语言摘要方法。

提供机构:

哥伦比亚大学

创建时间:

2020-10-07

搜集汇总

数据集介绍

构建方式

在跨语言抽象摘要研究领域,高质量多语言数据集的稀缺长期制约着相关进展。WikiLingua的构建巧妙地利用了WikiHow这一高质量协作式指南平台,通过提取18种语言的步骤化文章与摘要对,构建了大规模平行语料库。其核心创新在于采用图像对齐策略:由于每种语言的指南步骤均配有专属插图,研究者通过匹配跨语言间相同的视觉内容,实现了文章段落与摘要句子的精准对齐。该方法不仅规避了人工标注的高成本,更确保了跨语言对齐的可靠性,最终形成了包含超过14万篇英语文章及平均4万余篇平行文本的多语言数据集。

特点

WikiLingua的显著特征体现在其规模、质量与结构设计上。该数据集涵盖18种语言,语言类型跨越印欧、乌拉尔-阿尔泰和南亚语系,提供了迄今最大的跨语言摘要平行语料。其文本来源于经过多人撰写与审核的WikiHow指南,确保了内容的流畅性与规范性。在结构上,每篇文章由多个步骤构成,每个步骤包含一句摘要与详细说明段落,这种设计天然消除了新闻摘要中常见的引导偏差,迫使模型学习基于内容本身的摘要生成。数据统计显示,文章与摘要的平均长度分别为391词与39词,形成了适中的摘要压缩比例,为模型训练提供了理想的数据分布。

使用方法

该数据集主要用于训练与评估跨语言抽象摘要系统。研究者可将其分割为训练集、验证集与测试集,并确保不同语言间主题内容无重叠,以严格评估模型泛化能力。典型应用包括:基于多语言预训练模型(如mBART)进行微调,实现从源语言文章到目标语言摘要的直接生成;或作为基准测试平台,对比“摘要后翻译”与“翻译后摘要”等传统方法的性能。数据集支持端到端跨语言摘要模型的开发,此类模型无需在推理阶段依赖外部翻译系统,显著提升了效率与成本效益。此外,其多步骤指南结构也为研究序列化摘要生成提供了独特场景。

背景与挑战

背景概述

跨语言抽象摘要作为自然语言处理领域的前沿研究方向,长期以来因高质量多语言资源的匮乏而进展缓慢。2020年,由哥伦比亚大学与康奈尔大学的研究团队联合构建的WikiLingua数据集应运而生,旨在为跨语言摘要任务提供大规模、高质量的基准数据。该数据集从WikiHow平台提取了涵盖18种语言的教程文章与摘要对,通过共享的步骤插图实现跨语言对齐,核心研究问题聚焦于如何克服语言壁垒,生成语义连贯、信息凝练的跨语言摘要。WikiLingua以其前所未有的数据规模与多语言并行特性,显著推动了跨语言摘要模型的发展,为后续研究提供了坚实的实验基础。

当前挑战

在跨语言摘要领域,核心挑战在于模型需同时掌握语言转换与内容提炼的双重能力,而传统方法依赖分步的翻译与摘要流程,易导致错误传播与推理效率低下。构建WikiLingua数据集时,研究团队面临两大难题:其一,跨语言步骤对齐需依赖共享插图,但部分文章存在图像缺失或差异,需设计精细过滤机制确保对齐质量;其二,如何从协作编写的教程中提取结构化的摘要,并消除语言间步骤顺序差异带来的噪声,这要求创新的数据清洗与对齐策略。这些挑战共同凸显了高质量跨语言数据构建的复杂性与必要性。

常用场景

经典使用场景

在跨语言自然语言处理领域,WikiLingua数据集为跨语言抽象摘要任务提供了基准评估平台。该数据集通过从WikiHow平台提取18种语言的教程文章与摘要对,构建了大规模、高质量的平行语料库。其经典应用场景在于训练和评估端到端的跨语言摘要模型,例如直接生成英文摘要的非英文文章输入,无需依赖中间翻译步骤,从而推动跨语言理解与生成技术的前沿探索。

实际应用

在实际应用中,WikiLingua支持构建多语言智能助手与知识传播系统。例如,在教育与技术领域,系统可自动将英文操作指南摘要为西班牙文或中文,帮助非母语用户快速获取关键信息。其覆盖健康、旅行、艺术等多样主题,使得模型能够适应现实场景中的多领域需求,为全球化内容平台提供高效、低成本的自动化摘要服务,增强信息的可及性与传播广度。

衍生相关工作

基于WikiLingua,研究者衍生出多项经典工作,如结合合成数据与神经机器翻译的预训练方法DC+Synth+MT,显著提升跨语言摘要性能。该数据集还激发了多任务学习框架的探索,例如将文档级翻译与摘要联合训练,以增强模型的语言迁移能力。此外,它促进了跨语言多源摘要架构的研究,为构建支持任意语言互转的通用摘要系统奠定基础。

以上内容由遇见数据集搜集并总结生成