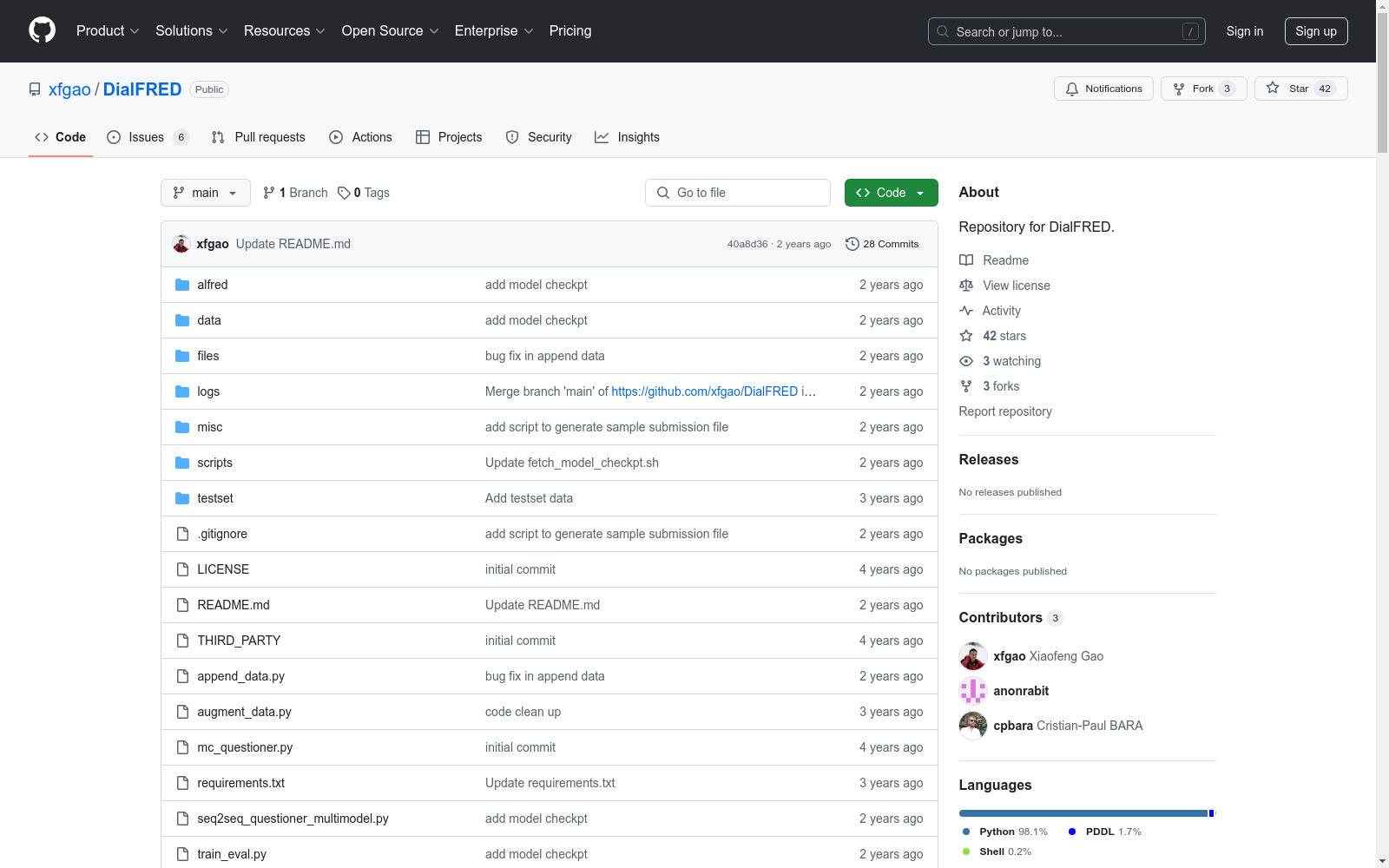

DialFRED|对话型机器人数据集|任务执行数据集

收藏DialFRED: 对话驱动的具身指令跟随数据集

数据集简介

DialFRED是一个基于ALFRED基准的对话驱动的具身指令跟随基准数据集。它允许代理主动向用户提问,利用用户的回应信息更好地完成任务。我们发布了一个人工注释的数据集,包含53K个与任务相关的问答对和一个回答问题的Oracle。

依赖

- numpy

- pandas

- opencv-python

- tqdm

- vocab

- revtok

- numpy

- Pillow

- sacred

- etaprogress

- scikit-video

- lmdb

- gtimer

- filelock

- networkx

- termcolor

- torch==1.7.1

- torchvision==0.8.2

- tensorboardX==1.8

- ai2thor==2.1.0

- stanza

- Werkzeug==2.1.1

- E.T. (https://github.com/alexpashevich/E.T.)

数据准备

- 下载并准备ALFRED数据集。

- 使用脚本合并低级动作到子目标,并分割子目标。

- 创建新的指令以增加语言多样性。

- 构建Oracle以从虚拟环境中提取地面实况信息并生成答案。

人类QA数据

- 数据集包含53K个通过众包收集的任务导向问答对,存储在

./data/dialfred_human_qa.csv。 - 数据集列定义包括数据集分割、任务ID、试验ID、房间类型、任务类型、子目标开始和结束时间、子目标中的低级动作数量、子目标索引、子目标指令、动词、名词1、名词2、问题类型、问题、答案和必要性。

模型训练与评估

- 提供了训练和评估代理的代码,包括训练问题提出者和执行者模型。

- 提供了在未见过的验证集上评估模型的代码。

挑战赛

- 提供了一个测试集来评估模型,包含1092个任务。

- 提供了生成提交文件的示例脚本。

引用

- 如果使用此代码或数据,请引用我们的论文。

bash @article{gao2022dialfred, title={Dialfred: Dialogue-enabled agents for embodied instruction following}, author={Gao, Xiaofeng and Gao, Qiaozi and Gong, Ran and Lin, Kaixiang and Thattai, Govind and Sukhatme, Gaurav S}, journal={arXiv preprint arXiv:2202.13330}, year={2022} }

中国气象数据

本数据集包含了中国2023年1月至11月的气象数据,包括日照时间、降雨量、温度、风速等关键数据。通过这些数据,可以深入了解气象现象对不同地区的影响,并通过可视化工具揭示中国的气温分布、降水情况、风速趋势等。

github 收录

1963-2015年中国主要木本植物春季物候(展叶和开花始期)格网数据产品(V1)

中国物候观测网1963–2015年白蜡、垂柳、刺槐、合欢、桑树、榆树、杏树、紫荆、紫丁香和加拿大杨10种木本植物的展叶始期和开花始期格网数据,时间分辨率为逐年,空间分辨率为0.5°×0.5°。数据集组成包括:(1)数据头文件,内含物种物候期和分布范围格网的头文件信息;(2)物种物候期,内含每个物种展叶始期和开花始期1963–2015年的逐年文件;(3)物种分布范围,内含每个物种的实际分布范围格网。

地球大数据科学工程 收录

TT100K - Tsinghua-Tencent 100K

TT100K数据集是一个用于交通标志检测和识别的大规模数据集,包含100,000张标注的交通标志图像。该数据集主要用于计算机视觉和自动驾驶领域的研究。

cg.cs.tsinghua.edu.cn 收录

AIS数据集

该研究使用了多个公开的AIS数据集,这些数据集经过过滤、清理和统计分析。数据集涵盖了多种类型的船舶,并提供了关于船舶位置、速度和航向的关键信息。数据集包括来自19,185艘船舶的AIS消息,总计约6.4亿条记录。

github 收录

Houston2013, Berlin, Augsburg

本研究发布了三个多模态遥感基准数据集:Houston2013(高光谱和多光谱数据)、Berlin(高光谱和合成孔径雷达数据)和Augsburg(高光谱、合成孔径雷达和数字表面模型数据)。这些数据集用于土地覆盖分类,旨在通过共享和特定特征学习模型(S2FL)评估多模态基线。数据集包含不同模态和分辨率的图像,适用于评估和开发新的遥感图像处理技术。

arXiv 收录