CAP-DATA

收藏arXiv2023-06-16 更新2024-06-21 收录

下载链接:

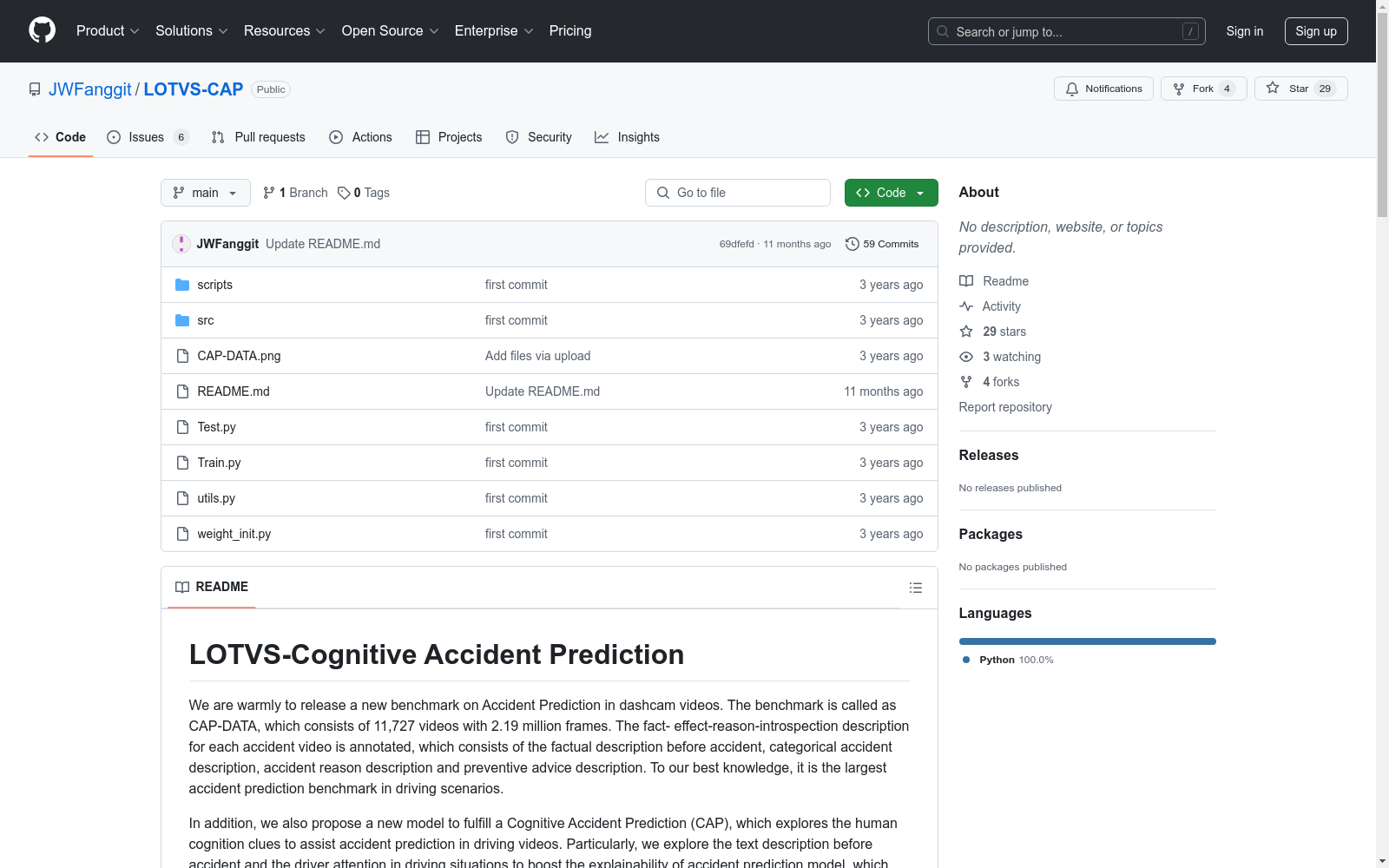

https://github.com/JWFanggit/LOTVS-CAP

下载链接

链接失效反馈官方服务:

资源简介:

CAP-DATA数据集由长安大学交通学院的研究团队创建,包含11,727个交通事故视频,总计超过2.19百万帧。该数据集不仅标注了事故发生的时间窗口,还提供了详细的文本描述,包括事故前的实际情况、事故类别、事故原因和预防建议。数据集的创建旨在通过结合视觉和文本信息,提高交通事故预测的准确性和解释性,从而支持更安全的驾驶决策系统。

The CAP-DATA dataset was developed by a research team from the School of Transportation, Chang'an University. It contains 11,727 traffic accident videos, totaling over 2.19 million frames. Besides annotating the time windows of accident occurrences, it also provides detailed textual descriptions including the actual pre-accident scenario, accident category, accident cause and preventive suggestions. The dataset is created to improve the accuracy and interpretability of traffic accident prediction by combining visual and textual information, thus supporting safer driving decision-making systems.

提供机构:

长安大学交通学院

创建时间:

2022-12-19

搜集汇总

数据集介绍

构建方式

CAP-DATA数据集的构建基于对现有DADA-2000数据集的扩展,新增了11,727个真实世界中的事故视频,共计219万帧。每个视频均标注了事故时间窗口、事实-影响-原因-反思描述(包括事故前的事实描述、事故类别描述、事故原因描述及预防建议),并进一步划分了58种事故类别。数据来源包括公开的事故数据集及多个视频流平台(如YouTube、Bilibili等),确保了数据的多样性和广泛性。

特点

CAP-DATA数据集的特点在于其多模态标注的丰富性。除了视频帧的时间戳标注外,还提供了详细的事故描述文本,涵盖了事故前的事实、事故类别、原因及预防建议。此外,数据集还标注了天气、光照条件、场景类型和道路类型等静态属性,为事故预测模型提供了多维度的上下文信息。数据集规模庞大,涵盖了多种复杂场景,能够有效支持事故检测、因果推理、分类及文本-视频检索等任务。

使用方法

CAP-DATA数据集的使用方法主要包括多模态融合模型的训练与评估。通过结合视频帧和事故前的文本描述,模型能够学习到事故发生的核心语义线索。数据集支持多种任务,如事故预测、因果推理和事故分类等。在训练过程中,模型通过注意力机制融合文本和视觉信息,并在测试阶段仅依赖视频数据进行推理。此外,数据集还提供了驾驶员注意力地图的重建任务,进一步增强了模型的可解释性和预测能力。

背景与挑战

背景概述

CAP-DATA数据集由Jianwu Fang等研究人员于2023年提出,旨在通过多模态方法预测驾驶场景中的交通事故。该数据集包含11,727个真实世界中的事故视频,共计219万帧,涵盖了多种天气、光照和道路条件。CAP-DATA的创建基于对现有DADA-2000数据集的扩展,增加了事故前的文本描述和驾驶员注意力标注。该数据集的核心研究问题是通过结合视觉观察和文本描述,模拟人类认知机制,提升事故预测的准确性和可解释性。CAP-DATA的发布为自动驾驶和辅助驾驶系统的安全决策提供了重要支持,推动了交通事故预测领域的研究进展。

当前挑战

CAP-DATA数据集面临的挑战主要体现在两个方面。首先,交通事故预测本身具有高度复杂性,事故往往发生在极短的时间窗口内,且事故区域通常具有稀疏的时空语义信息。模型需要从正常驾驶状态到事故状态的突然变化中捕捉关键线索,这对模型的时空建模能力提出了极高要求。其次,数据集的构建过程中也面临诸多挑战,包括如何在复杂的环境条件下(如低光照、恶劣天气)准确标注事故前的文本描述和驾驶员注意力,以及如何处理数据集中事故类型的高度不平衡分布。此外,CAP-DATA的规模庞大,标注工作繁重,如何确保标注的一致性和准确性也是一个重要挑战。

常用场景

经典使用场景

CAP-DATA数据集主要用于交通场景中的事故预测研究,特别是在自动驾驶和辅助驾驶系统中。该数据集通过结合视觉观察和驾驶员注意力数据,提供了一个多模态的基准,用于训练和评估事故预测模型。其经典使用场景包括在驾驶视频中预测未来可能发生的交通事故,并为安全驾驶系统提供早期预警。

衍生相关工作

CAP-DATA数据集的发布推动了多个相关领域的研究进展。基于该数据集,研究者们提出了多种改进的事故预测模型,如结合图神经网络和注意力机制的动态时空网络(DSTAN)以及基于强化学习的事故预测模型(DRIVE)。此外,CAP-DATA还促进了多模态融合技术在交通场景中的应用研究,推动了文本-视觉联合推理模型的发展。这些衍生工作不仅提升了事故预测的准确性,还为交通场景中的其他任务(如行为预测和轨迹预测)提供了新的研究思路。

数据集最近研究

最新研究方向

在驾驶场景中的认知事故预测领域,CAP-DATA数据集的最新研究方向聚焦于多模态融合与认知机制的深度结合。通过引入文本描述和驾驶员注意力机制,CAP方法显著提升了事故预测的准确性和可解释性。该数据集不仅扩展了现有的DADA-2000数据集,还构建了一个包含11,727个真实事故视频的大规模基准,涵盖了2.19百万帧的标注数据。前沿研究进一步探索了基于注意力机制的文本-视觉融合模块、场景上下文传递模块以及驾驶员注意力引导的事故预测模块,这些模块通过图神经网络(GNN)和门控循环单元(GRU)等技术,模拟人类认知过程,增强了模型对复杂驾驶环境的适应能力。CAP-DATA的发布为自动驾驶和辅助驾驶系统的安全决策提供了强有力的支持,推动了交通场景中事故预测技术的进一步发展。

相关研究论文

- 1Cognitive Accident Prediction in Driving Scenes: A Multimodality Benchmark长安大学交通学院 · 2023年

以上内容由遇见数据集搜集并总结生成