X2I|图像生成数据集|多任务处理数据集

收藏github2024-09-20 更新2024-09-20 收录

下载链接:

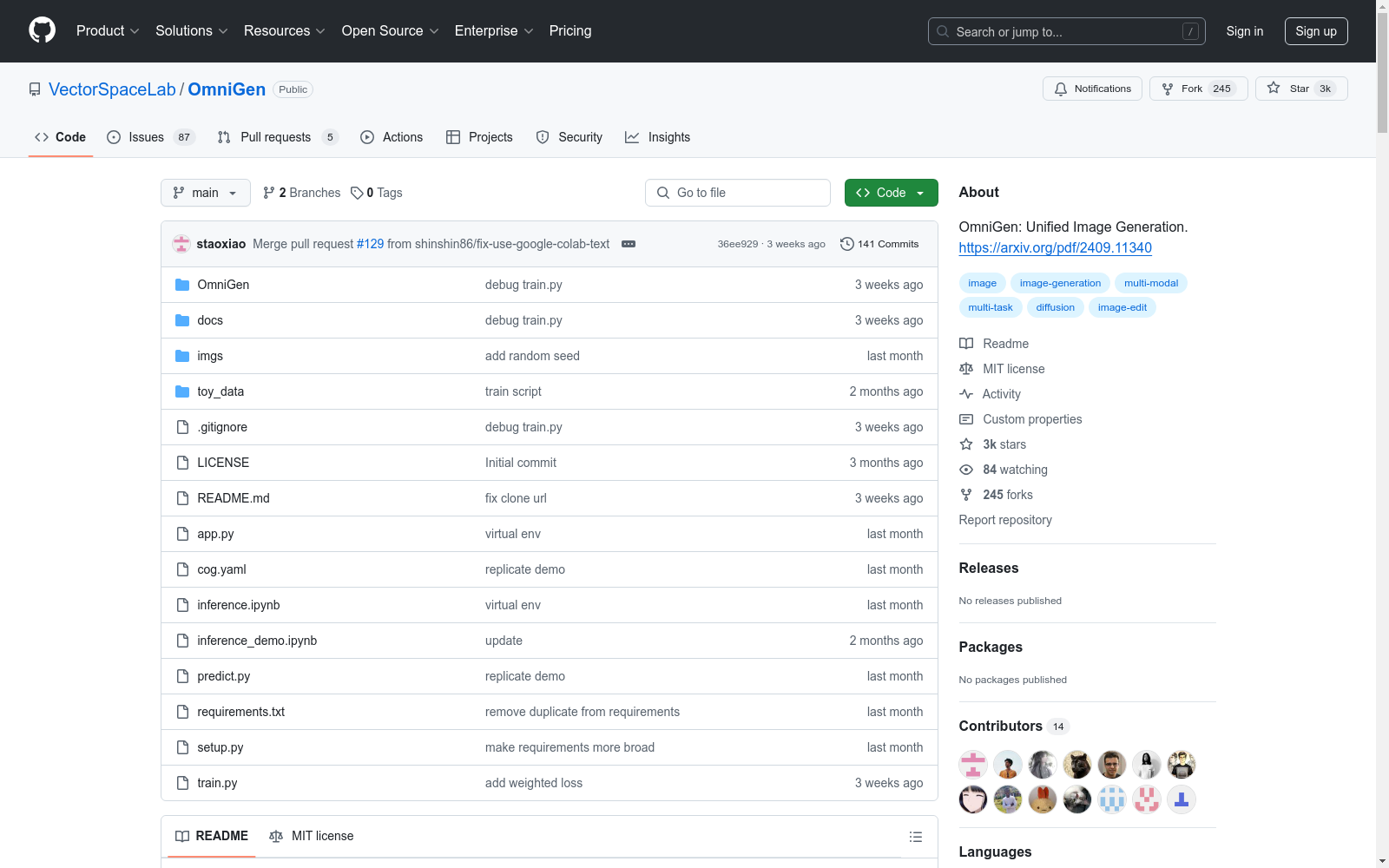

https://github.com/VectorSpaceLab/OmniGen

下载链接

链接失效反馈资源简介:

OmniGen是北京智源研究院提出的一款全新的扩散模型,致力于统一图像生成任务。X2I数据集是为了训练一个强大的统一模型OmniGen而构建的,它是首个大规模统一图像生成数据集,将各种任务统一到了一个格式中。这个数据集包含了大约1亿张图片,涵盖了多种图像生成任务,如文本到图像的生成、多模态到图像的生成、主题驱动的图像生成和计算机视觉任务等。X2I数据集的构建旨在通过统一的格式来训练模型,使其能够在一个框架内处理多种图像生成任务,从而提高模型的泛化能力和多任务处理能力。通过这个数据集,OmniGen模型能够学习到丰富的视觉和文本信息,进而在多种图像生成任务中表现出色。

OmniGen, a novel diffusion model proposed by the Beijing Academy of Artificial Intelligence, is dedicated to unifying image generation tasks. The X2I dataset was constructed to train a robust unified model, OmniGen, and represents the first large-scale unified image generation dataset that consolidates various tasks into a single format. This dataset comprises approximately 100 million images, encompassing a wide range of image generation tasks such as text-to-image generation, multimodal-to-image generation, theme-driven image generation, and computer vision tasks. The creation of the X2I dataset aims to train models through a unified format, enabling them to handle multiple image generation tasks within a single framework, thereby enhancing the model's generalization and multitasking capabilities. Through this dataset, the OmniGen model can learn rich visual and textual information, excelling in various image generation tasks.

提供机构:

BAAI

创建时间:

2024-09-17

原始信息汇总

OmniGen 数据集概述

1. 基本介绍

- 名称: OmniGen

- 类型: 统一图像生成模型

- 特点: 支持多模态提示生成图像,无需额外插件或预处理步骤

- 目标: 实现简单、灵活的图像生成范式

2. 关键功能

- 文本到图像生成

- 主题驱动生成

- 身份保留生成

- 图像编辑

- 图像条件生成

- 参考表达式生成(自动识别输入图像中的对象)

3. 技术特性

- 方法论: 详见论文 arXiv:2409.11340

- 优势: 自动识别输入图像特征(如物体、人体姿态、深度映射等)

- 灵活性: 可通过微调添加新功能

4. 资源获取

- 模型权重: Shitao/OmniGen-v1

- 演示平台:

- 数据集: X2I Dataset

5. 使用方式

-

安装方法: bash git clone https://github.com/VectorSpaceLab/OmniGen.git cd OmniGen pip install -e .

-

快速开始示例代码: 提供文本到图像和多模态到图像的生成示例

-

Diffusers集成: 支持通过Diffusers库使用

6. 微调支持

- 支持LoRA微调

- 提供完整微调选项

- 训练脚本:

train.py - 详细指南: docs/fine-tuning.md

7. 许可信息

- 许可证: MIT License

8. 引用方式

bibtex @article{xiao2024omnigen, title={Omnigen: Unified image generation}, author={Xiao, Shitao and Wang, Yueze and Zhou, Junjie and Yuan, Huaying and Xing, Xingrun and Yan, Ruiran and Wang, Shuting and Huang, Tiejun and Liu, Zheng}, journal={arXiv preprint arXiv:2409.11340}, year={2024} }

AI搜集汇总

数据集介绍

构建方式

OmniGen数据集的构建基于统一图像生成模型的理念,旨在通过多模态提示生成广泛类型的图像。该数据集的构建过程包括收集和标注多模态数据,如文本描述、图像和对象信息,以训练模型识别和生成复杂图像。通过整合多种数据源,OmniGen实现了从简单到复杂的图像生成任务,无需额外插件或预处理步骤。

特点

OmniGen数据集的主要特点在于其统一性和灵活性。它能够处理多种图像生成任务,包括文本到图像生成、主题驱动生成、身份保持生成、图像编辑和图像条件生成。此外,OmniGen无需额外插件或操作,能够自动识别输入图像中的特征,如所需对象、人体姿态和深度映射,从而生成高质量的图像。

使用方法

使用OmniGen数据集,用户可以通过简单的命令行接口或Python脚本进行图像生成。首先,用户需要安装相关依赖并克隆GitHub仓库。随后,可以通过提供的示例代码进行文本到图像或图像到图像的生成。对于更复杂的任务,用户可以参考文档中的详细说明进行微调,以适应特定需求。此外,OmniGen还提供了在线演示和Google Colab集成,方便用户快速上手和实验。

背景与挑战

背景概述

OmniGen数据集,由VectorSpaceLab于2024年发布,旨在推动图像生成领域的统一化与简化。该数据集的核心研究问题是如何通过多模态提示生成多样化的图像,无需额外的插件或预处理步骤。OmniGen的开发团队包括Shitao Xiao、Yueze Wang等研究人员,他们的工作不仅简化了图像生成流程,还为未来的图像生成模型提供了新的范式。OmniGen的影响力在于其能够自动识别输入图像中的特征,并根据文本提示生成新图像,这一创新对图像生成领域具有重要意义。

当前挑战

OmniGen数据集在构建过程中面临的主要挑战包括资源限制下的模型优化,以及如何在多模态输入下保持生成图像的质量和多样性。此外,OmniGen旨在解决现有图像生成模型需要额外插件和预处理步骤的问题,这一目标本身就是一个技术挑战。尽管OmniGen已经展示了其强大的功能,但如何在有限的资源下进一步优化模型,以及如何通过微调扩展其功能,仍然是未来研究的重要方向。

常用场景

经典使用场景

OmniGen数据集的经典使用场景在于其能够通过多模态提示生成广泛的图像。用户可以利用文本、图像或其他输入形式,灵活地控制图像生成的过程,无需额外的插件或预处理步骤。例如,通过输入描述性文本和参考图像,OmniGen能够自动识别并生成符合描述的新图像,这在艺术创作、虚拟现实和游戏设计等领域具有广泛的应用前景。

实际应用

在实际应用中,OmniGen数据集被广泛用于各种图像生成任务,如文本到图像的转换、主题驱动的生成、身份保持生成、图像编辑和基于图像的生成。例如,在广告和市场营销中,OmniGen可以帮助快速生成符合品牌形象的视觉内容;在教育和培训领域,它可以用于创建交互式学习材料。此外,OmniGen的灵活性使其在虚拟现实和增强现实应用中也有着巨大的潜力。

衍生相关工作

OmniGen数据集的发布催生了一系列相关研究和工作。例如,基于OmniGen的改进模型在图像生成质量和效率上取得了显著提升,推动了多模态生成模型的进一步发展。此外,OmniGen的开放性和易用性激发了社区的创造力,许多研究者和开发者在其基础上进行了各种创新实验,包括但不限于图像风格迁移、场景重建和动态图像生成等。

以上内容由AI搜集并总结生成