LongEval

收藏github2023-06-01 更新2025-02-08 收录

下载链接:

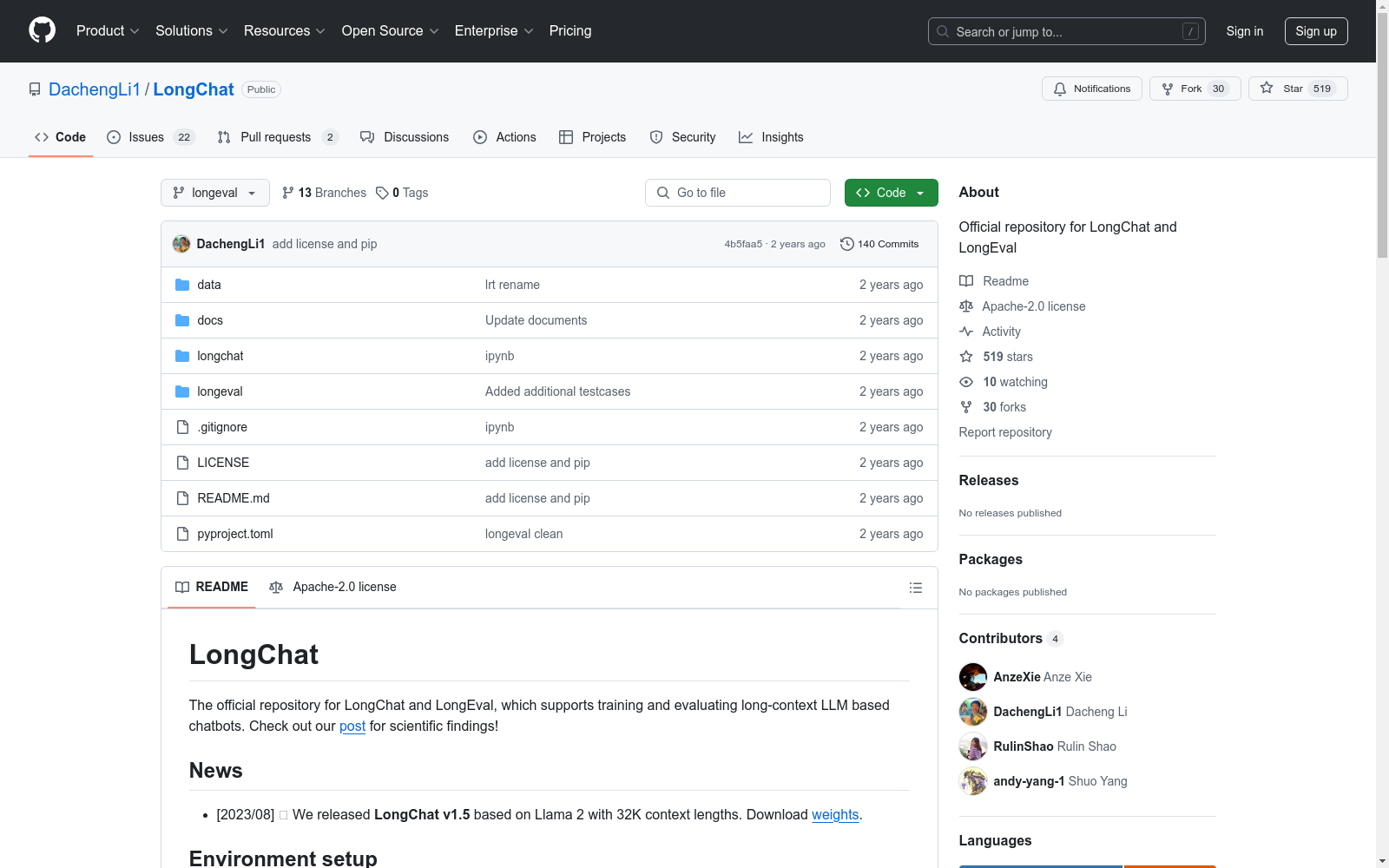

https://github.com/DachengLi1/LongChat

下载链接

链接失效反馈资源简介:

长文评估(LongEval)数据集支持对依赖广泛文本上下文的模型进行评估。任务分为两个不同的难度级别:一个专注于广泛主题检索,另一个强调详细段落检索。评估数据利用代码合成来满足任务规范,提供了一种简单且快速的方法来衡量和比较模型在长文本上的有效性。输入长度范围为5,000到16,000字符。

The LongEval dataset supports the evaluation of models capable of understanding extensive textual context. The task is divided into two different difficulty levels: one focusing on broad topic retrieval and the other emphasizing detailed paragraph retrieval. The evaluation utilizes code synthesis to meet the task specifications, providing a simple and rapid method for measuring and comparing the effectiveness of models on long texts. The input length ranges from 5,000 to 16,000 characters.

提供机构:

LMSYS

创建时间:

2023-06-01

原始信息汇总

LongChat数据集概述

数据集简介

- 官方仓库:支持训练和评估基于长上下文LLM的聊天机器人

- 包含LongChat和LongEval两个主要组件

- 相关科学发现见博客文章

最新动态

- 2023年8月:发布基于Llama 2的LongChat v1.5版本,支持32K上下文长度

模型资源

- 预训练模型:

训练配置

- 训练脚本示例使用8xA100 GPU

- 关键参数:

- 模型最大长度:16384

- 训练周期:3

- 学习率:2e-5

- 批量大小:1(训练)/4(评估)

- 使用FlashAttention处理超长序列

评估功能

- 提供两种评估任务:

- 粗粒度主题召回(topics)

- 行召回(lines)

- 评估脚本支持自定义模型和任务

- 包含测试用例生成功能

引用格式

bibtex @misc{longchat2023, title = {How Long Can Open-Source LLMs Truly Promise on Context Length?}, url = {https://lmsys.org/blog/2023-06-29-longchat}, author = {Dacheng Li*, Rulin Shao*, Anze Xie, Ying Sheng, Lianmin Zheng, Joseph E. Gonzalez, Ion Stoica, Xuezhe Ma, and Hao Zhang}, month = {June}, year = {2023} }

搜集汇总

数据集介绍

构建方式

LongEval数据集的构建基于长上下文语言模型(LLM)的训练与评估需求,采用了Llama 2模型作为基础,并通过32K的上下文长度进行扩展。数据集的构建过程包括从HuggingFace下载预训练模型权重,并使用特定的训练脚本进行微调。训练过程中,采用了分布式训练策略,结合了FlashAttention技术以支持超长序列的处理,确保了模型在长上下文场景下的高效训练与评估。

特点

LongEval数据集的核心特点在于其专注于长上下文对话场景的评估,提供了16K和32K两种上下文长度的模型版本。数据集包含了丰富的对话数据,支持从粗粒度到细粒度的多维度评估任务,如主题召回和行召回任务。此外,数据集还提供了自动化的评估工具,能够通过ChatGPT-3.5-turbo进行自动评分,极大地简化了评估流程,提升了评估的准确性与效率。

使用方法

使用LongEval数据集进行模型评估时,用户可以通过提供的命令行工具或Jupyter Notebook进行任务配置与执行。评估任务包括主题召回和行召回,用户只需指定模型路径和任务类型即可启动评估。对于复杂的主题召回任务,数据集还提供了自动评分工具,用户可以通过设置OPENAI_API_KEY调用ChatGPT-3.5-turbo进行自动评分。此外,用户还可以通过生成新的测试用例配置文件,自定义评估任务的具体参数,以满足不同场景下的评估需求。

背景与挑战

背景概述

LongEval数据集由LMSYS机构于2023年发布,旨在评估长上下文大语言模型(LLM)在对话系统中的表现。该数据集的核心研究问题聚焦于如何有效扩展和评估LLM在处理长上下文对话时的能力。通过提供16K和32K上下文长度的模型训练与评估工具,LongEval为研究人员提供了一个标准化的平台,以探索长上下文对话模型的潜力与局限。该数据集的发布不仅推动了对话系统领域的技术进步,还为开源LLM的上下文长度扩展提供了重要的实验依据。

当前挑战

LongEval数据集面临的挑战主要体现在两个方面。首先,长上下文对话模型的评估本身具有复杂性,尤其是在处理多轮对话时,模型需要准确捕捉并维持上下文信息,这对模型的记忆与推理能力提出了极高要求。其次,数据集的构建过程中,如何生成具有代表性的长上下文对话数据,并确保其多样性与真实性,是一个技术难题。此外,评估过程中,如何设计有效的指标来衡量模型在长上下文任务中的表现,仍需进一步探索与优化。

常用场景

经典使用场景

LongEval数据集主要用于评估和训练长上下文语言模型(LLM)的性能,特别是在处理超长文本序列时的表现。通过提供标准化的评估框架,研究人员可以在统一的基准上测试不同模型的长上下文理解能力。该数据集特别适用于研究模型在长对话、文档摘要、以及多轮问答等场景中的表现,帮助开发者优化模型的长文本处理能力。

解决学术问题

LongEval数据集解决了长上下文语言模型在学术研究中的关键问题,即如何有效评估模型在超长文本序列中的表现。传统评估方法往往难以覆盖长文本的复杂性,而LongEval通过设计精细的评估任务(如主题召回和行召回),为研究者提供了量化模型性能的工具。这一数据集的出现填补了长上下文评估领域的空白,推动了长文本处理技术的进一步发展。

衍生相关工作

LongEval数据集的发布催生了一系列相关研究工作。例如,基于该数据集的研究成果,许多团队开发了改进的长上下文语言模型,如LongChat系列模型。此外,LongEval还启发了更多针对长文本处理的研究方向,如长文本生成、长文档分类等。这些工作不仅扩展了长上下文语言模型的应用范围,也为未来的研究提供了宝贵的参考和工具。

以上内容由遇见数据集搜集并总结生成