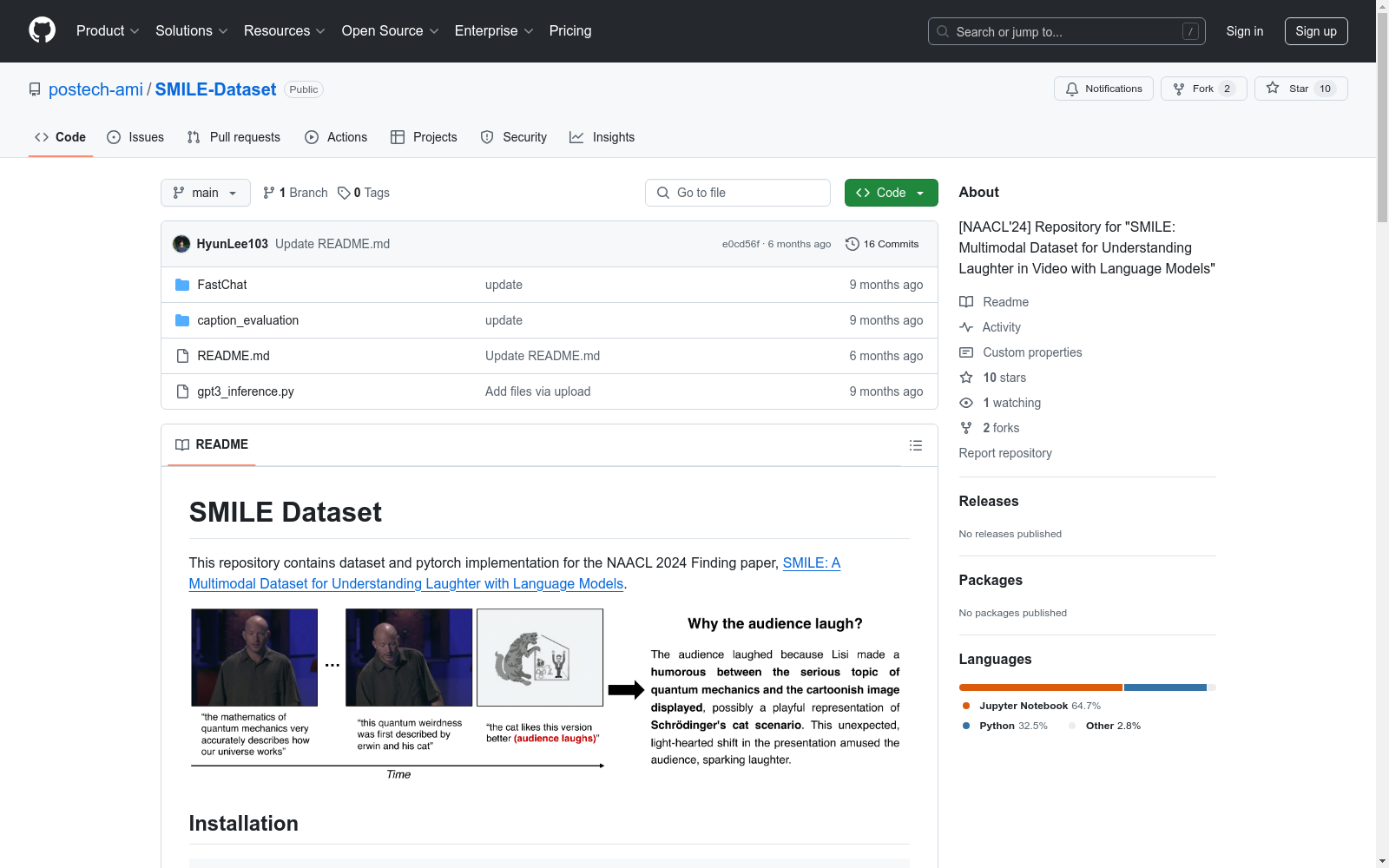

SMILE Dataset

收藏SMILE Dataset 概述

数据集版本

- SMILE Dataset v.2: 当前正在更新,更新后将更新笑的推理基准。

- SMILE Dataset v.1: 提供用于评估的版本。

数据集结构

-

SMILE Dataset v.2:

├── annotations | ├── data_split.json | ├── GT_laughter_reason.json | └── multimodal_textual_representation.json | └── videos └── SMILE_videos.zip ├── video_clips └── video_segments

- data_split.json: 训练、验证、测试分割的关键索引。

- GT_laughter_reason.json: 视频片段的Ground-Truth笑的原因。

- multimodal_textual_representation.json: 从视频片段编码的多模态文本表示。

- video_clips: 来自情景喜剧和TED的887个视频片段。

- video_segments: 从视频片段中修剪的4482个视频段,按话语分割。

-

SMILE Dataset v.1 for evaluation:

├── SMILE_v1_evaluation ├── smile_reasoning_train.json ├── smile_reasoning_val.json ├── sitcom_reasoning_train.json ├── sitcom_reasoning_val.json ├── ted_reasoning_train.json └── ted_reasoning_val.json

评估

- 笑的推理:

- 提供使用GPT3和LLaMA的推理代码。

- GPT3需要用户自己的openai api密钥,并收取运行模型的费用。

- LLaMA提供预训练权重,仅供研究使用。

引用信息

@inproceedings{hyun-etal-2024-smile, title = "{SMILE}: Multimodal Dataset for Understanding Laughter in Video with Language Models", author = "Hyun, Lee and Sung-Bin, Kim and Han, Seungju and Yu, Youngjae and Oh, Tae-Hyun", booktitle = "Findings of the Association for Computational Linguistics: NAACL 2024", publisher = "Association for Computational Linguistics" }