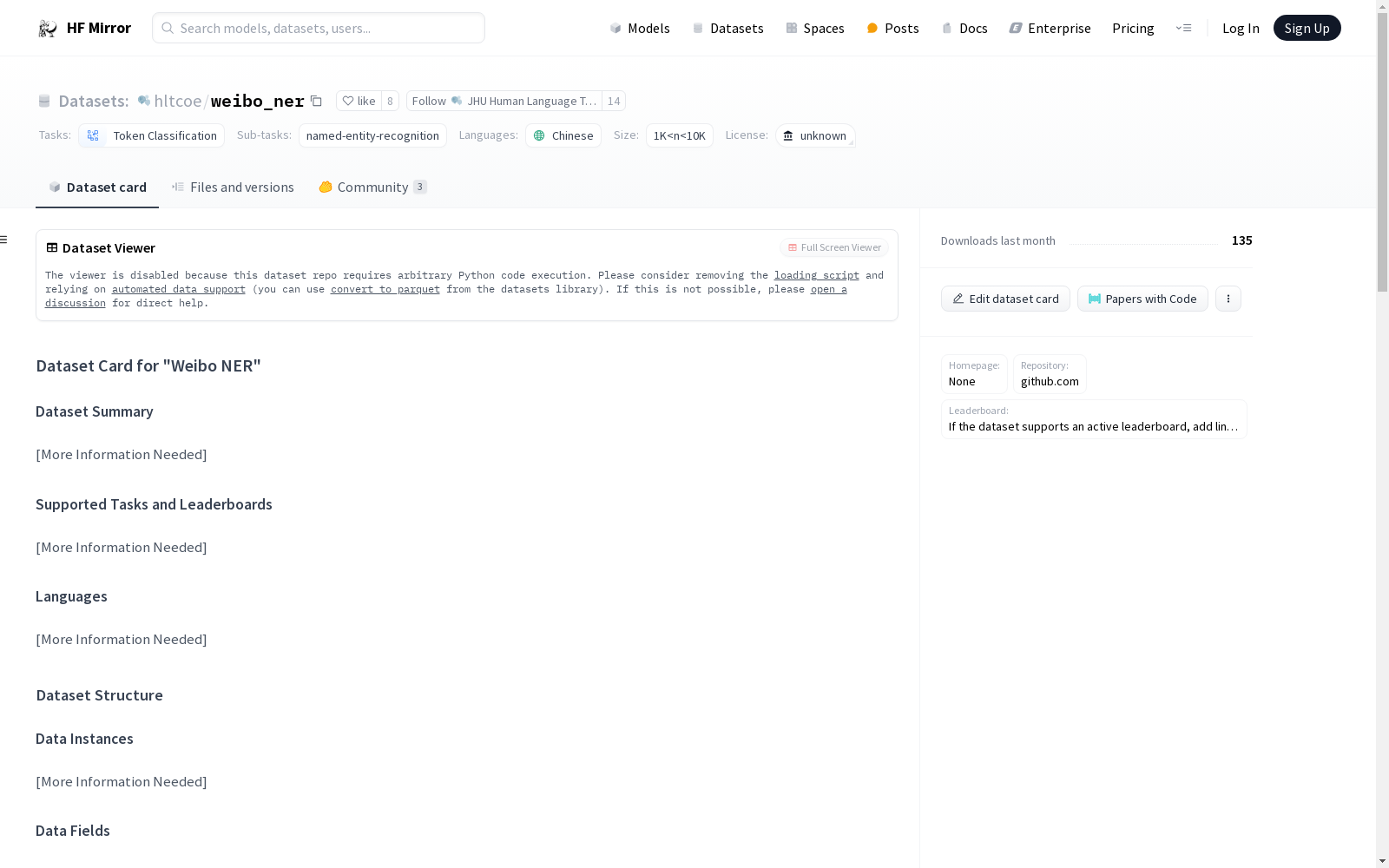

hltcoe/weibo_ner

收藏Hugging Face2024-01-18 更新2024-06-15 收录

下载链接:

https://hf-mirror.com/datasets/hltcoe/weibo_ner

下载链接

链接失效反馈资源简介:

---

annotations_creators:

- expert-generated

language_creators:

- found

language:

- zh

license:

- unknown

multilinguality:

- monolingual

size_categories:

- 1K<n<10K

source_datasets:

- original

task_categories:

- token-classification

task_ids:

- named-entity-recognition

paperswithcode_id: weibo-ner

pretty_name: Weibo NER

dataset_info:

features:

- name: id

dtype: string

- name: tokens

sequence: string

- name: ner_tags

sequence:

class_label:

names:

'0': B-GPE.NAM

'1': B-GPE.NOM

'2': B-LOC.NAM

'3': B-LOC.NOM

'4': B-ORG.NAM

'5': B-ORG.NOM

'6': B-PER.NAM

'7': B-PER.NOM

'8': I-GPE.NAM

'9': I-GPE.NOM

'10': I-LOC.NAM

'11': I-LOC.NOM

'12': I-ORG.NAM

'13': I-ORG.NOM

'14': I-PER.NAM

'15': I-PER.NOM

'16': O

splits:

- name: train

num_bytes: 1179589

num_examples: 1350

- name: validation

num_bytes: 232380

num_examples: 270

- name: test

num_bytes: 237407

num_examples: 270

download_size: 750687

dataset_size: 1649376

train-eval-index:

- config: default

task: token-classification

task_id: entity_extraction

splits:

train_split: train

eval_split: test

col_mapping:

tokens: tokens

ner_tags: tags

metrics:

- type: seqeval

name: seqeval

---

# Dataset Card for "Weibo NER"

## Table of Contents

- [Dataset Description](#dataset-description)

- [Dataset Summary](#dataset-summary)

- [Supported Tasks and Leaderboards](#supported-tasks-and-leaderboards)

- [Languages](#languages)

- [Dataset Structure](#dataset-structure)

- [Data Instances](#data-instances)

- [Data Fields](#data-fields)

- [Data Splits](#data-splits)

- [Dataset Creation](#dataset-creation)

- [Curation Rationale](#curation-rationale)

- [Source Data](#source-data)

- [Annotations](#annotations)

- [Personal and Sensitive Information](#personal-and-sensitive-information)

- [Considerations for Using the Data](#considerations-for-using-the-data)

- [Social Impact of Dataset](#social-impact-of-dataset)

- [Discussion of Biases](#discussion-of-biases)

- [Other Known Limitations](#other-known-limitations)

- [Additional Information](#additional-information)

- [Dataset Curators](#dataset-curators)

- [Licensing Information](#licensing-information)

- [Citation Information](#citation-information)

- [Contributions](#contributions)

## Dataset Description

- **Homepage:** None

- **Repository:** https://github.com/OYE93/Chinese-NLP-Corpus/tree/master/NER/Weibo

- **Paper:** [More Information Needed]

- **Leaderboard:** [If the dataset supports an active leaderboard, add link here]()

- **Point of Contact:** [More Information Needed]

### Dataset Summary

[More Information Needed]

### Supported Tasks and Leaderboards

[More Information Needed]

### Languages

[More Information Needed]

## Dataset Structure

### Data Instances

[More Information Needed]

### Data Fields

[More Information Needed]

### Data Splits

[More Information Needed]

## Dataset Creation

### Curation Rationale

[More Information Needed]

### Source Data

[More Information Needed]

#### Initial Data Collection and Normalization

[More Information Needed]

#### Who are the source language producers?

[More Information Needed]

### Annotations

[More Information Needed]

#### Annotation process

[More Information Needed]

#### Who are the annotators?

[More Information Needed]

### Personal and Sensitive Information

[More Information Needed]

## Considerations for Using the Data

### Social Impact of Dataset

[More Information Needed]

### Discussion of Biases

[More Information Needed]

### Other Known Limitations

[More Information Needed]

## Additional Information

### Dataset Curators

[More Information Needed]

### Licensing Information

[More Information Needed]

### Citation Information

[More Information Needed]

### Contributions

Thanks to [@abhishekkrthakur](https://github.com/abhishekkrthakur) for adding this dataset.

The Weibo NER dataset is a monolingual Chinese dataset specifically designed for Named Entity Recognition tasks. It contains 1350 training samples, 270 validation samples, and 270 test samples. The dataset features include id, tokens, and ner_tags, where ner_tags contains various named entity labels such as locations, organizations, and persons. The annotations in the dataset are expert-generated, and the source data is original.

提供机构:

hltcoe

AI搜集汇总

数据集介绍

构建方式

该数据集的构建基于微博平台上的文本数据,通过专家生成的方式进行命名实体识别(NER)标注。数据集包含了1350条训练样本、270条验证样本和270条测试样本。标注过程涉及对文本中的地理、组织和人物等实体进行分类,使用BIO标签体系,其中B表示实体的开始,I表示实体的内部,O表示非实体。

特点

该数据集的主要特点在于其专注于中文社交媒体文本,特别是微博平台上的内容。这种特定领域的数据为研究社交媒体中的命名实体识别提供了独特的视角。此外,数据集的标注质量高,由专家生成,确保了标注的准确性和一致性。

使用方法

使用该数据集进行命名实体识别任务时,用户可以利用提供的训练、验证和测试集进行模型训练和评估。数据集的特征包括文本ID、分词后的tokens以及对应的NER标签。用户可以通过加载数据集并映射相应的字段,如tokens和ner_tags,来进行模型的训练和测试。

背景与挑战

背景概述

在自然语言处理领域,命名实体识别(Named Entity Recognition, NER)是文本分析中的关键任务之一。hltcoe/weibo_ner数据集由专家生成,专注于中文微博文本的命名实体识别。该数据集由HLTCOE(Human Language Technology Center of Excellence)机构创建,旨在解决微博文本中实体识别的挑战。通过提供微博文本中的实体标注,该数据集为研究者提供了一个评估和改进NER模型性能的平台,对中文社交媒体文本分析领域具有重要影响。

当前挑战

hltcoe/weibo_ner数据集在构建过程中面临多重挑战。首先,微博文本的非正式性和多样性增加了实体识别的复杂性。其次,数据集的标注过程依赖于专家,这可能导致标注一致性和质量的挑战。此外,数据集的规模相对较小,可能限制了模型的泛化能力。最后,数据集的许可信息不明确,可能影响其在学术和商业应用中的使用。

常用场景

经典使用场景

在自然语言处理领域,hltcoe/weibo_ner数据集的经典使用场景主要集中在命名实体识别(Named Entity Recognition, NER)任务上。该数据集通过标注微博文本中的实体,如地理位置、组织、人物等,为研究人员提供了一个丰富的资源,用于训练和评估NER模型。通过分析微博平台上的文本,研究人员可以开发出能够自动识别和分类文本中实体的算法,从而提升信息提取和文本分析的准确性。

解决学术问题

hltcoe/weibo_ner数据集解决了自然语言处理领域中命名实体识别的关键学术问题。通过提供高质量的标注数据,该数据集帮助研究人员克服了在社交媒体文本中识别实体的挑战,尤其是在中文语境下。这不仅推动了NER技术的发展,还为跨语言和跨平台的实体识别研究提供了宝贵的参考。此外,该数据集的引入,促进了相关算法的优化和性能提升,对学术界产生了深远的影响。

衍生相关工作

hltcoe/weibo_ner数据集的发布,催生了一系列相关的经典工作。例如,研究人员基于该数据集开发了多种NER模型,这些模型在多个公开评测中表现优异,推动了NER技术的前沿发展。此外,该数据集还被用于跨语言NER模型的研究,促进了中文与其他语言在实体识别任务上的对比分析。这些衍生工作不仅丰富了NER领域的研究内容,也为实际应用提供了强有力的技术支持。

以上内容由AI搜集并总结生成