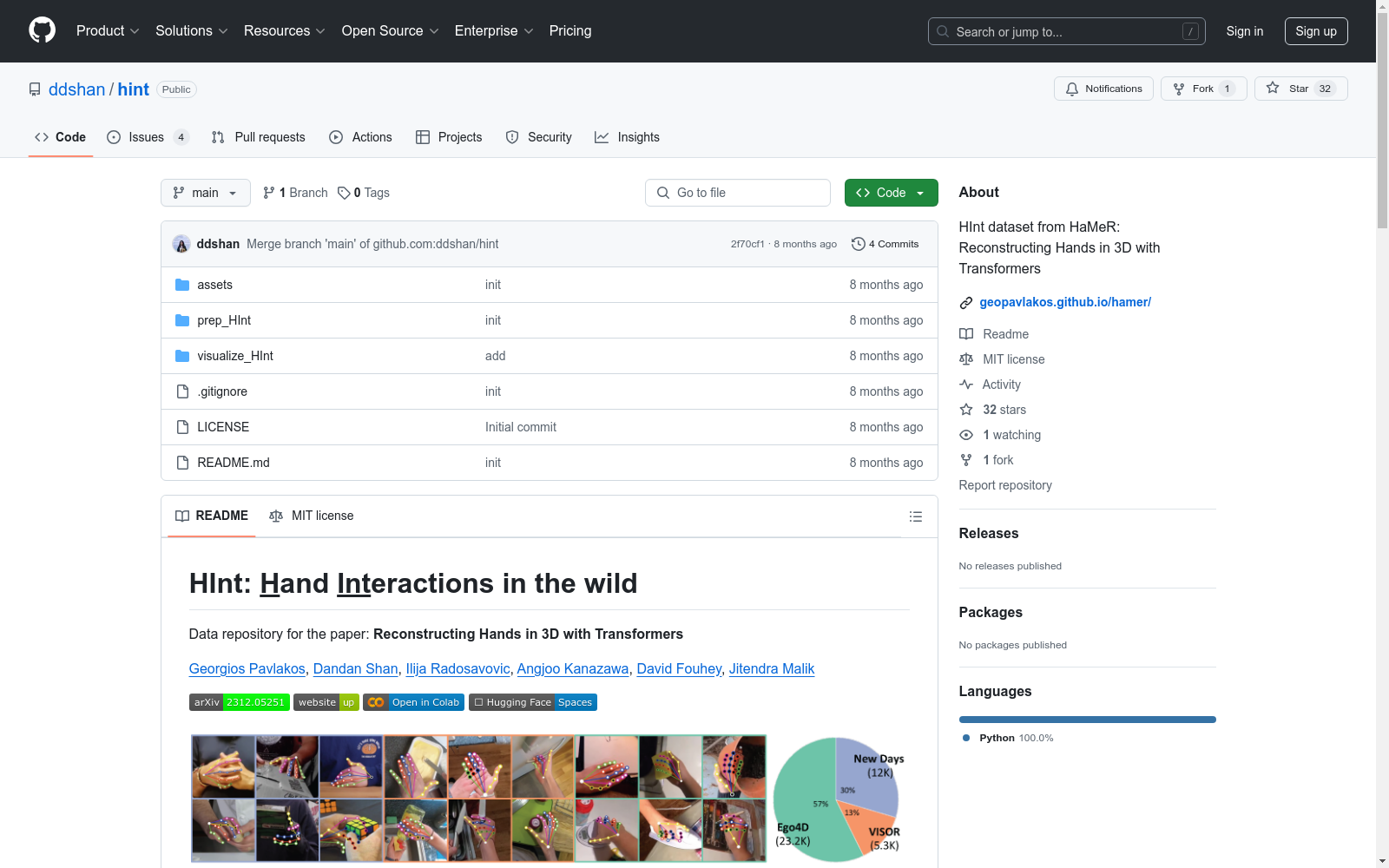

HInt: Hand Interactions in the wild

收藏github2024-05-02 更新2024-05-31 收录

下载链接:

https://github.com/ddshan/hint

下载链接

链接失效反馈资源简介:

The HInt dataset is contributed in the paper, Reconstructing Hands in 3D with Transformers, with the goal to complement existing datasets used for training and evaluation 3D hand pose estimation.

HInt annotates 2D keypoint locations and occlusion labels for 21 keypoints on the hand. It is built off of 3 existing datasets (Hands23, Epic-Kitchens VISOR, and Ego4D) and provides annotations for images from the three existing datasets.

HInt 数据集由论文《利用 Transformer 重建 3D 手部姿态》所贡献,旨在补充用于训练和评估 3D 手部姿态估计的现有数据集。HInt 对手部 21 个关键点的 2D 关键点位置和遮挡标签进行了标注。该数据集基于 3 个现有的数据集(Hands23、Epic-Kitchens VISOR 和 Ego4D)构建,并为这三个数据集的图像提供了标注信息。

创建时间:

2024-05-01

原始信息汇总

数据集概述

HInt数据集是为了补充现有用于训练和评估3D手势估计的数据集而贡献的。该数据集标注了21个手部关键点的2D位置及遮挡标签,基于三个现有数据集:Hands23、Epic-Kitchens VISOR和Ego4D。

数据集准备

下载部分HInt数据集

-

下载并解压

Hint_annotation_partial.zip,该文件包含所有注释、New Days和Epic-Kitchens VISOR的图像帧。 -

解压后,文件结构如下:

HInt_annotation_partial ├── TEST_ego4d_img* ├── TEST_ego4d_seq* ├── TEST_epick_img ├── TEST_newdays_img ├── TRAIN_ego4d_img* ├── TRAIN_epick_img ├── TRAIN_newdays_img ├── VAL_ego4d_img* ├── VAL_ego4d_seq* ├── VAL_epick_img └── VAL_newdays_img

准备Ego4D帧

- 获取访问权限:通过Ego4D官方网站的Start Here页面申请下载权限。

- 设置Ego4D CLI:参考Ego4D Dataset Download CLI设置CLI。

- 下载Ego4D片段:使用命令

ego4d --output_directory="/path/to/save/ego4d_data" --version v1 --datasets clips annotations --metadata下载片段。 - 解码Ego4D片段:使用

prep_ego4d.py脚本解码片段。 - 检索Ego4D帧:使用

prep_ego4d.py脚本填充HInt_annotation_partial中的Ego4D文件夹。 - 验证数据完整性:使用MD5校验确保数据完整性。

数据集可视化

使用依赖于mmengine库的脚本draw_hand.py可视化HInt注释。

引用信息

- HaMeR: Pavlakos et al., 2024

- Epic-Kitchens VISOR: Darkhalil et al., 2022

- Ego4D: Grauman et al., 2022

AI搜集汇总

数据集介绍

构建方式

HInt数据集的构建基于三项现有数据集:Hands23、Epic-Kitchens VISOR和Ego4D。该数据集通过整合这些资源,为图像提供了2D关键点位置和遮挡标签的标注,涵盖了手部21个关键点。构建过程首先从这些数据集中提取图像帧,并进行详细的标注工作,确保数据集的多样性和广泛性。此外,由于Ego4D的版权限制,数据集的部分内容需要通过特定的下载和解码流程获取,以确保数据的完整性和合法性。

特点

HInt数据集的主要特点在于其多样性和精细的标注。它不仅包含了来自多个数据集的图像,还提供了详细的2D关键点标注和遮挡信息,这对于3D手部姿态估计任务尤为重要。此外,数据集的构建考虑了实际应用中的遮挡问题,提供了相应的遮挡标签,增强了数据集在复杂场景下的适用性。

使用方法

使用HInt数据集时,用户需首先下载部分标注数据,并通过特定的步骤获取Ego4D的图像帧。数据集的准备过程包括下载、解码和验证数据完整性。用户可以通过提供的脚本进行数据的可视化和处理,确保数据集的正确使用。此外,数据集的标注信息可以通过mmengine库进行可视化,便于用户直观地理解和分析数据。

背景与挑战

背景概述

HInt数据集,全称为Hand Interactions in the wild,由Georgios Pavlakos、Dandan Shan等研究人员在2024年提出,旨在为3D手势重建任务提供高质量的标注数据。该数据集的核心研究问题是如何在复杂场景中准确重建手部3D姿态,这对于增强现实、虚拟现实和人机交互等领域具有重要意义。HInt数据集通过整合Hands23、Epic-Kitchens VISOR和Ego4D三个现有数据集的图像,提供了21个手部关键点的2D位置和遮挡标签,为3D手势估计模型的训练和评估提供了丰富的资源。

当前挑战

HInt数据集在构建过程中面临多项挑战。首先,整合来自不同数据集的图像和标注,确保数据的一致性和完整性是一个复杂的过程。其次,由于Ego4D数据集的版权限制,获取其图像帧需要经过复杂的申请和下载流程,增加了数据集构建的难度。此外,数据集的标注质量直接影响模型的训练效果,如何确保标注的准确性和一致性也是一个重要挑战。最后,数据集的规模和多样性对于模型的泛化能力至关重要,如何在有限的资源下最大化数据的多样性也是一个需要解决的问题。

常用场景

经典使用场景

HInt数据集在3D手部姿态估计领域中具有经典的使用场景,主要用于训练和评估手部关键点检测模型。通过提供2D关键点位置和遮挡标签的标注,该数据集能够帮助研究人员在复杂场景下对手部进行精确的3D重建。其独特的多源数据融合特性,使得模型能够在不同环境、视角和光照条件下表现出色,从而提升手部姿态估计的鲁棒性和准确性。

解决学术问题

HInt数据集解决了3D手部姿态估计中的多个关键学术问题,特别是在复杂场景下的手部关键点检测和遮挡处理。通过引入多源数据集的标注,HInt有效弥补了现有数据集在多样性和复杂性方面的不足,推动了手部姿态估计技术的发展。此外,该数据集还为遮挡情况下的手部姿态重建提供了新的研究方向,具有重要的学术意义和应用价值。

衍生相关工作

HInt数据集的发布催生了一系列相关研究工作,特别是在手部姿态估计和遮挡处理方面。基于该数据集,研究人员提出了多种改进的3D手部姿态重建算法,提升了模型在复杂场景下的表现。此外,HInt数据集还激发了对手部姿态与物体交互的研究,推动了手部姿态估计与物体识别、抓取等任务的结合,进一步拓展了手部姿态估计的应用范围。

以上内容由AI搜集并总结生成