【我遇到的问题】 • 现象:该数据集的下载链接已失效 【相关信息】 • 可考虑访问这个链接获取类似文件~https://www.selectdataset.com/dataset/3688356173feccbcf1f1e490ddc6bc72

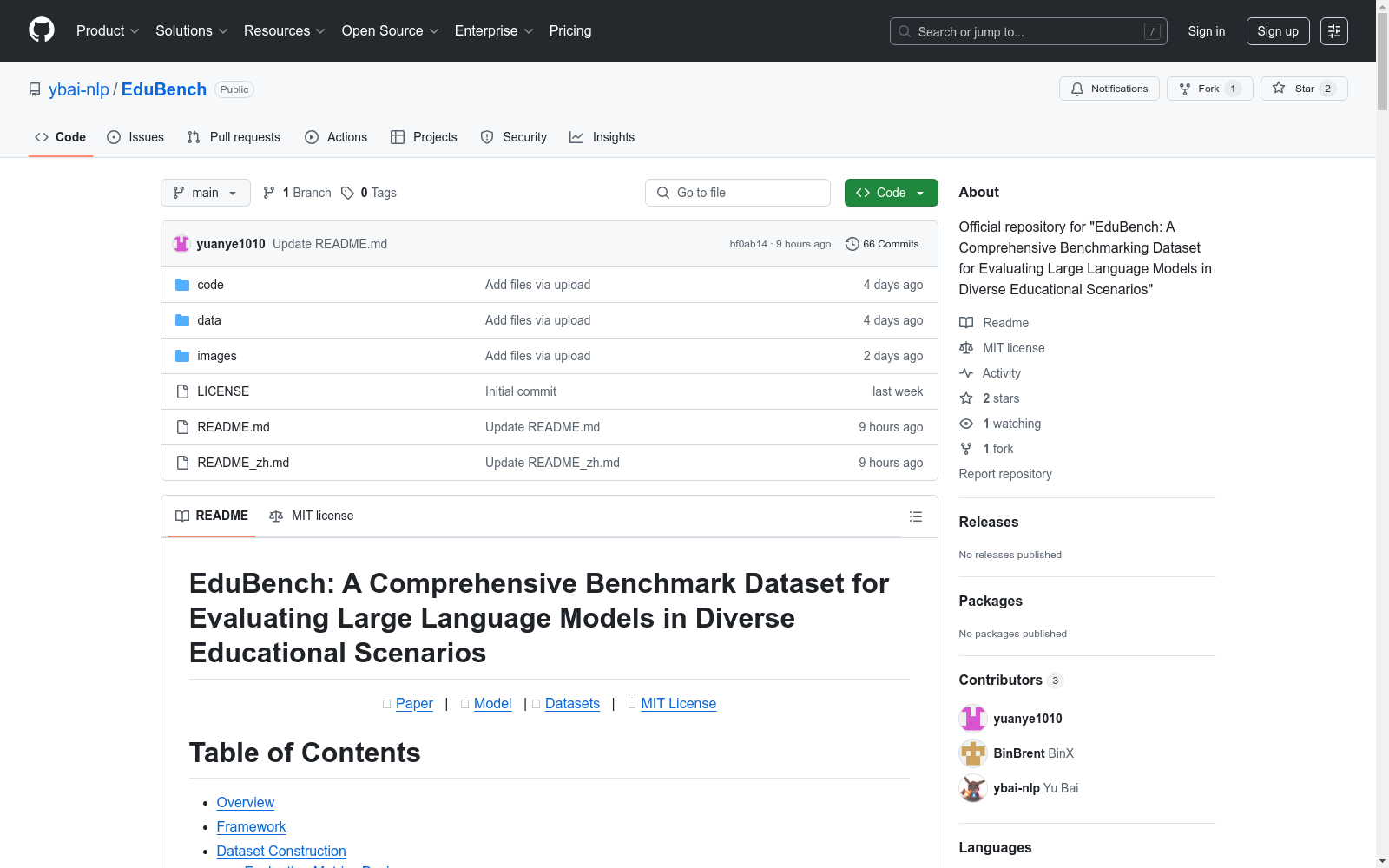

EduBench

收藏github2025-05-26 更新2025-05-27 收录

下载链接:

https://github.com/ybai-nlp/EduBench

下载链接

链接失效反馈官方服务:

资源简介:

EduBench是一个专门为教育场景设计的多样化基准数据集,涵盖9大教育背景和超过4000种不同的教育情境,为教育领域的模型评估提供了新的视角。我们设计了多维度的评估指标,全面覆盖了从教师和学生视角的12个关键维度,确保对场景适应性、事实和推理准确性等方面进行深入评估。

EduBench is a diverse benchmark dataset specifically designed for educational scenarios, covering 9 major educational backgrounds and over 4000 distinct educational contexts, providing a novel perspective for model evaluation in the education field. We have developed multi-dimensional evaluation metrics that comprehensively cover 12 core dimensions from both teacher and student perspectives, enabling in-depth assessments of aspects such as scenario adaptability, factual accuracy and reasoning accuracy.

创建时间:

2025-05-21

原始信息汇总

EduBench 数据集概述

数据集简介

- 名称:EduBench

- 类型:教育场景评估基准数据集

- 特点:

- 覆盖9大教育场景

- 包含4,000+不同教育情境

- 专为教育领域模型评估设计

教育场景分类

I. 学生导向场景

- 问答(Q&A)

- 纠错(EC)

- 观点提供(IP)

- 个性化学习支持(PLS)

- 情感支持(ES)

II. 教师导向场景

- 问题生成(QG)

- 自动评分(AG)

- 教学材料生成(TMG)

- 个性化内容创作(PCC)

评估指标体系

1. 场景适应性

- 指令遵循与任务完成度

- 角色与语气一致性

- 内容相关性与范围控制

- 场景元素整合

2. 事实与推理准确性

- 基础事实准确性

- 领域知识准确性

- 推理过程严谨性

- 错误识别与纠正精度

3. 教学应用性

- 清晰度、简洁性与启发性

- 激励、引导与积极反馈

- 个性化、适应性与学习支持

- 高阶思维与技能发展

数据集构建

- 生成方法:通过代码脚本生成(示例:

python ./code/generation/EC.py) - 数据规模:4,000个样本覆盖全部9个教育场景

评估结果

模型表现

- 最佳表现模型:DeepSeek R1(平均分9.29)

- 最差表现模型:Qwen2.5-7B-Instruct(平均分8.46)

- 关键发现:

- 7B模型在资源受限环境下更具性价比

- DeepSeek R1在"高阶思维与技能发展"表现突出

人类评估

- 人类评估者对所有模型在"推理过程严谨性"上满意度显著较低

- Qwen2.5-7B-Instruct在该指标仅得5.90分

模型蒸馏

- 方法:多源蒸馏过程

- 效果:

- 7B模型在12个指标中的10个有显著提升

- 在"推理过程严谨性"上超越所有其他模型

评估一致性分析

- 模型间一致性:Kendalls W值大多在0.6左右

- 人模一致性:

- DeepSeek V3与人类评估相关性最高

- GPT-4o相关性最低

相关资源

- 论文:https://arxiv.org/pdf/2505.16160

- 模型:https://huggingface.co/DirectionAI/EDU-Qwen2.5-7B

- 数据集:https://huggingface.co/datasets/DirectionAI/EduBench

搜集汇总

数据集介绍

构建方式

EduBench数据集的构建过程体现了教育场景与人工智能技术的深度融合。研究团队首先将教育场景系统划分为学生导向和教师导向两大类别,涵盖问答纠错、个性化学习支持、自动评分等9个核心场景。通过精心设计的12维评估指标体系,从情境适应性、事实推理准确性和教学应用性三个层面构建了科学的评价框架。数据生成采用模块化编程方式,针对不同教育场景开发专用脚本,确保数据生成的规范性和可复现性。在质量把控环节,创新性地采用多层次评估机制,结合专家评审和模型自评,最终形成包含4000余个教育情境的高质量数据集。

使用方法

使用EduBench进行模型评估时,建议采用分层测试策略。首先根据目标应用场景选择对应的子数据集,如教师辅助场景可重点测试自动评分和教学内容生成模块。评估过程需严格遵循数据集提供的多维指标,建议结合自动化评分与人工评估双轨验证。对于模型优化场景,可利用数据集中的对比样本进行消融实验,特别关注12个核心指标的提升情况。知识蒸馏应用时,可参考研究团队提供的多源蒸馏方案,选择各子任务表现最优的模型作为教师模型。数据集支持端到端评估和模块化测试两种模式,用户可根据实际需求灵活选择评估粒度。

背景与挑战

背景概述

EduBench是由DirectionAI团队开发的一个综合性基准数据集,专注于评估大型语言模型在多样化教育场景中的表现。该数据集涵盖了9个主要教育场景和超过4,000种不同的教育情境,旨在为教育领域的模型评估提供全新视角。EduBench设计了多维度的评估指标,全面覆盖了12个关键维度,从教师和学生双重视角深入评估模型的场景适应性、事实与推理准确性等核心能力。通过知识蒸馏技术,该数据集还成功提升了小型模型在教育场景中的表现,使其能够媲美顶尖大型语言模型的性能。

当前挑战

EduBench面临的挑战主要体现在两个方面:在领域问题方面,教育场景具有高度专业性和复杂性,如何准确评估模型在知识准确性、教学原则应用等方面的表现是一大难题;在构建过程方面,设计覆盖多维度教育场景的评估指标体系、确保数据生成的多样性和代表性、以及保持模型评估与人工评估的一致性都带来了显著挑战。特别是不同教育场景对模型能力要求的差异性,使得构建统一的评估框架变得尤为困难。

常用场景

经典使用场景

在教育技术领域,EduBench数据集为评估大型语言模型在多样化教育场景中的表现提供了标准化测试平台。该数据集覆盖9大教育场景和4000余种教学情境,特别适用于检验模型在问答纠错、个性化学习支持等细分任务中的适应性。研究者通过其设计的12维评估体系,能够系统分析模型在指令遵循、知识准确性、教学适用性等关键指标上的表现,为教育智能化研究提供了可量化的比较基准。

解决学术问题

EduBench有效解决了教育场景下模型评估标准缺失的学术难题。通过构建包含师生双视角的评估维度体系,该数据集首次实现了对教学元素整合、高阶思维培养等隐性能力的量化测量。其独创的跨场景一致性评估框架,为揭示模型在知识推理与情感支持等复杂任务中的性能差异提供了方法论支持,推动了教育大模型从通用能力向垂直领域专业化能力的转型研究。

实际应用

在实际教学环境中,EduBench支撑了智能辅导系统的精准优化。基于该数据集开发的7B小模型通过知识蒸馏技术,在个性化内容生成等场景达到与千亿参数模型相当的效能,显著降低了教育AI的部署门槛。多所教育机构已采用其评估体系对教学助手进行质量监控,特别是在自动批改和情感支持模块实现了人工替代率提升30%的突破。

数据集最近研究

最新研究方向

随着人工智能在教育领域的深入应用,EduBench数据集为评估大语言模型在多样化教育场景中的表现提供了全面基准。当前研究聚焦于模型在九大教育场景中的多维评估,涵盖从师生双视角设计的12项核心指标,包括情境适应性、事实与推理准确性及教学应用效果。前沿探索体现在通过知识蒸馏技术提升小模型性能,如Qwen2.5-7B-Instruct在有限数据下达到与DeepSeek V3等顶尖大模型相近的表现。模型与人类评估一致性分析揭示了评估体系的可靠性,而跨场景性能比较为教育资源优化分配提供了实证依据,推动了个性化教育支持系统的创新发展。

以上内容由遇见数据集搜集并总结生成